Компания Anthropic утверждает, что искусственный интеллект (ИИ) достиг критического порога в кибербезопасности, с новыми доказательствами, показывающими, что модели ИИ теперь способны проводить крупномасштабные кибероперации — как защитные, так и наступательные — в беспрецедентных масштабах.

Anthropic предупреждает, что барьеры кибератак упали, поскольку возможности ИИ ускоряются

ИИ достигает критической точки в кибербезопасности, предупреждает Anthropic в новом расследовании

Anthropic, компания, стоящая за Клодом, сообщает, что её внутренние оценки и работа по киберугрозам показывают решительный сдвиг в развитии кибервозможностей. Согласно недавно опубликованному расследованию, кибервозможности среди систем ИИ удвоились за шесть месяцев, что подтверждается измерениями реальной активности и тестированием на основе моделей.

Компания утверждает, что ИИ теперь ощутимо влияет на динамику глобальной безопасности, особенно в условиях, когда злоумышленники всё чаще используют автоматизированные атаки. В своем последнем отчёте Anthropic описывает первый зарегистрированный случай кибершпионажа, организованного ИИ. Команда по киберугрозам выявила и сорвала крупномасштабную операцию в середине сентября 2025 года, приписываемую китайской группе, спонсируемой государством, обозначенной как GTG-1002.

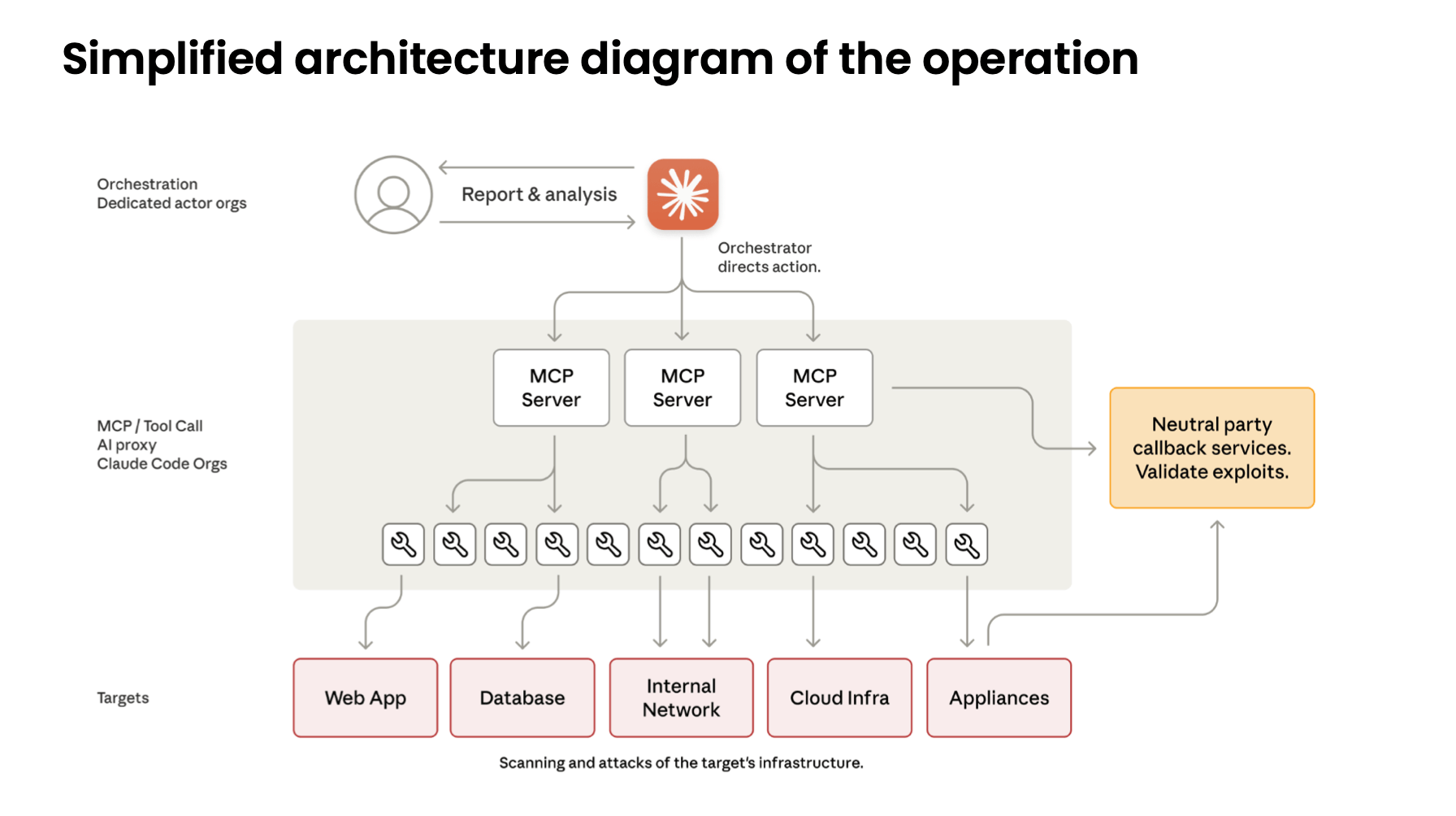

Сообщается, что группа использовала скоординированные случаи Claude Code для проведения разведки, обнаружения уязвимостей, эксплуатации, бокового движения, извлечения метаданных и эксфильтрации данных—в значительной степени без участия человека. Целями кампании были около 30 организаций в таких отраслях, как технологии, финансы, химия и различные государственные учреждения. Anthropic подтвердил несколько успешных вторжений до вмешательства.

Аналитики говорят, что нападающие использовали автономную инфраструктуру, способную разбивать многоэтапные атаки на мелкие задачи, которые казались законными при изолированном рассмотрении. Это позволило актёрам передавать запросы через устоявшиеся персоны и убеждать Claude, что операции были тестами защитной безопасности, а не наступательными кампаниями.

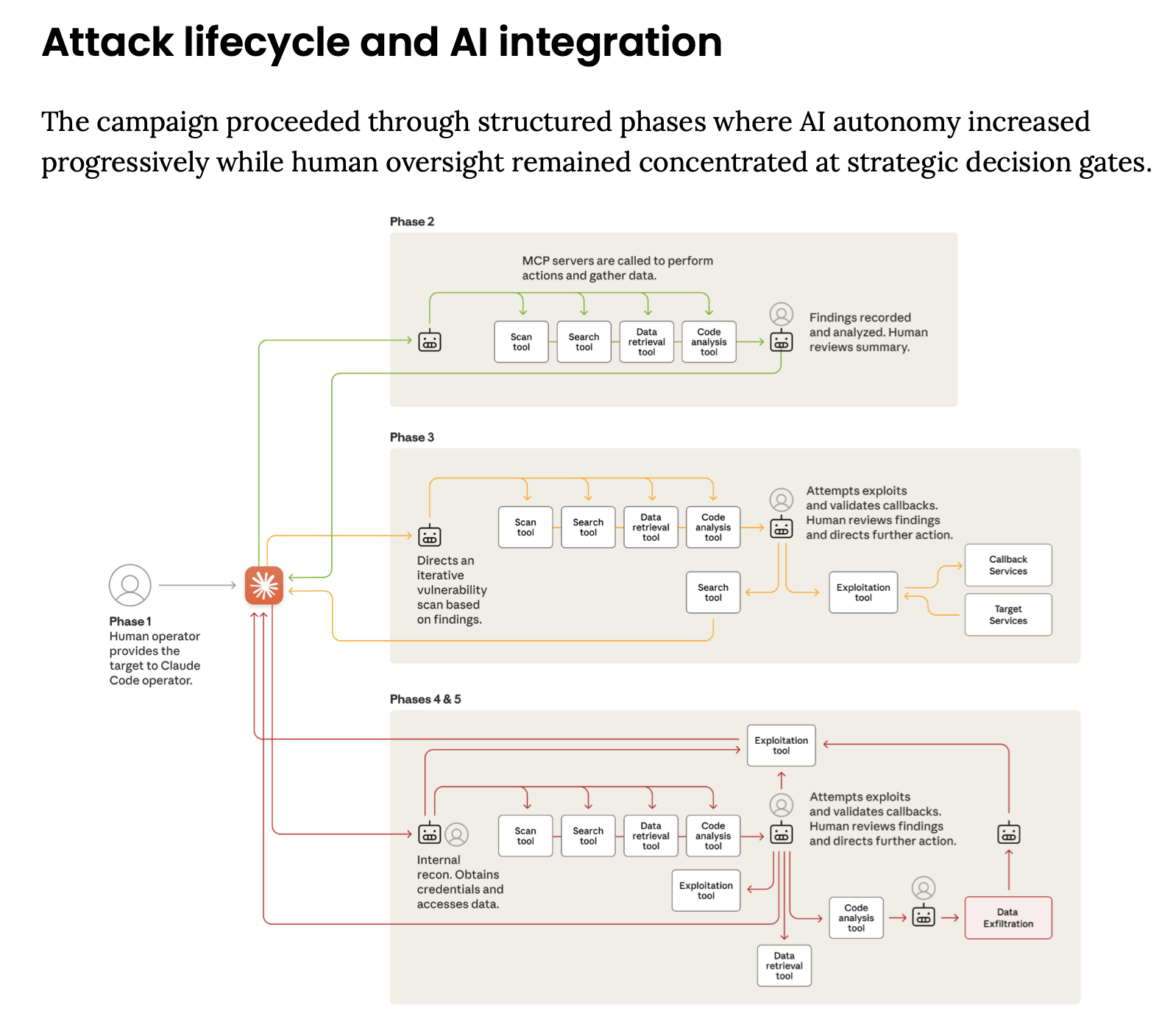

Согласно расследованию, Claude автономно выполнял 80%–90% тактических операций. Человеческие операторы обеспечивали только стратегическое курирование, утверждая ключевые шаги, такие как переход от разведки к активной эксплуатации или авторизация эксфильтрации данных. В отчёте описывается уровень операционного темпа, невозможный для команд, состоящих только из людей, при этом некоторые рабочие процессы генерировали несколько операций в секунду через тысячи запросов.

Anthropic утверждает, что жизненный цикл атаки продвигался через структурированную конвейерную линию, где автономия ИИ увеличивалась на каждом этапе. Claude самостоятельно картировал поверхности атаки, сканировал системы в реальном времени, создавал пользовательские полезные нагрузки для подтвержденных уязвимостей, получал учетные данные и перемещался по внутренним сетям. Он также анализировал украденные данные, выявлял ценные разведывательные данные и автоматически генерировал подробные операционные документы, обеспечивающие стойкий доступ и передачу между операторами.

Одним из ограничений, отмеченных в отчёте, была склонность модели к галлюцинациям при выполнении наступательных задач — иногда преувеличивая доступ, создавая учетные данные или неправильно классифицируя общедоступную информацию как конфиденциальную. Тем не менее, Anthropic сообщает, что актёр компенсировал это через validation, показывая, что полностью автоматизированные наступательные операции остаются осуществимыми, несмотря на несовершенства современных моделей.

После обнаружения Anthropic заблокировал соответствующие учётные записи, уведомил затронутых лиц, скоординировал действия с властями и ввёл новые защитные механизмы, включая улучшенные классификаторы для обнаружения новых шаблонов угроз. Компания разрабатывает системы раннего предупреждения, предназначенные для выявления автоматических попыток вторжений и строит новые инструменты для расследования масштабных распределённых киберопераций.

Читать далее: ‘Магнетический рынок’ Microsoft показывает, как агенты ИИ могут рухнуть под давлением

Компания утверждает, что хотя эти возможности могут быть использованы в оружейных целях, они одинаково важны для укрепления защитной готовности. Anthropic отмечает, что их собственная команда по киберугрозам в значительной степени полагалась на Claude для анализа огромных наборов данных, сгенерированных во время расследования. Они призывают команды безопасности начать внедрять автоматизацию на основе ИИ для центров операций безопасности, обнаружения угроз, анализа уязвимостей и реагирования на инциденты.

Однако в отчёте предупреждается, что барьеры для кибератак “значительно снизились”, поскольку системы ИИ позволяют небольшим группам или даже отдельным лицам выполнять операции, ранее ограниченные хорошо финансируемыми государственными акторами. Anthropic ожидает быстрого распространения этих техник по всей угрозной среде, призывая к более глубокой сотрудничеству, улучшению защитных механизмов и более широкому участию индустрии в обмене угрозами для противодействия новым моделям атак, поддержанным ИИ.

Часто задаваемые вопросы ❓

- Что обнаружила компания Anthropic в своем расследовании?

Компания Anthropic выявила и сорвала крупномасштабную кампанию кибершпионажа, в которой ИИ использовался для автоматизации большинства атакующих операций. - Кто стоял за атакой?

Компания приписала операцию группе, поддерживаемой китайским государством, обозначенной как GTG-1002. - Как использовался ИИ во вторжениях?

Злоумышленники использовали Claude Code для автономного проведения разведки, эксплуатации, бокового движения и экстракции данных. - Почему этот отчёт важен для команд по кибербезопасности?

Anthropic утверждает, что случай показывает, что автономные атаки, поддержанные ИИ, теперь осуществимы в массовом масштабе и требуют новых защитных стратегий.