شرکت Anthropic روز پنجشنبه، ۱۶ آوریل ۲۰۲۶، بهطور رسمی جدیدترین مدل هوش مصنوعی خود، Claude Opus 4.7، را معرفی کرد.

انتروپیک از «کلود اپوس ۴.۷» رونمایی میکند؛ با قرار گرفتن گردشکارهای عاملی در مرکز توجه

نکات کلیدی:

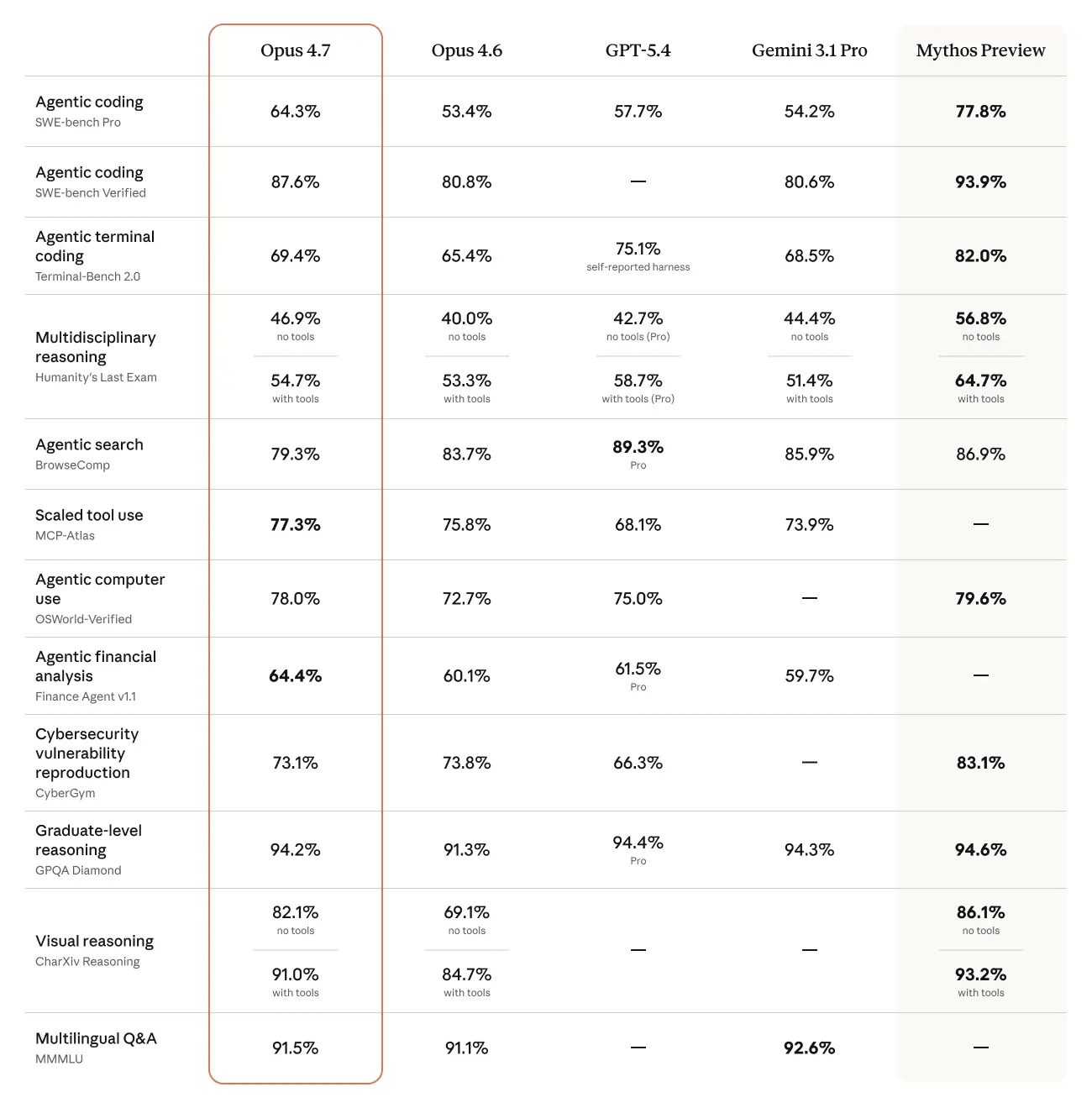

- Anthropic در ۱۶ آوریل ۲۰۲۶ مدل Claude Opus 4.7 را عرضه کرد که در آزمون SWE-bench Verified امتیاز ۸۷.۶٪ کسب کرده است.

- با چرخش صنعت هوش مصنوعی بهسوی خودمختاری عاملمحور، Opus 4.7 در کدنویسی پیچیده و امور مالی از GPT-5.4 پیشی میگیرد.

- توسعهدهندگان باید هزینهها را مدیریت کنند، زیرا مدل جدید نسبت به نسخه قبلی 4.6 بین ۱.۰ تا ۱.۳۵ برابر توکن بیشتری مصرف میکند.

تکامل هوش مصنوعی: عرضه Claude Opus 4.7 با بینایی و حافظه بهبودیافته

استارتاپ هوش مصنوعی مستقر در سانفرانسیسکو این عرضه را بهعنوان توانمندترین مدلِ «بهطور عمومی در دسترس» خود تا امروز معرفی کرد. این نسخه یک ارتقای هدفمند نسبت به نسخه Opus 4.6 است که تنها دو ماه پیش، در فوریه، ارائه شده بود.

در حالی که پیشنمایش محدودِ Claude Mythos همچنان برای امنیت سایبری در آزمونهای محدود باقی مانده است، Opus 4.7 برای بازار گستردهتر ساخته شده است. این مدل بهطور مشخص بر مهندسی نرمافزار، وظایف بلندافق، و تحلیل مالی پیچیده تمرکز دارد.

شاخصهای عملکرد منتشرشده توسط Anthropic نشان میدهد این مدل در جریانکارهای خودمختار پیشرفت چشمگیری داشته است. در بنچمارک کدنویسی SWE-bench Verified، مدل جدید به ۸۷.۶ درصد رسید؛ در حالی که این رقم در عرضه 4.6 برابر با ۸۰.۸ درصد بود.

این مدل همچنین توانست در چندین دسته کلیدی، اندکی از رقبای اصلی خود پیشی بگیرد. Anthropic گزارش داد که Opus 4.7 در آزمونهای استفاده از ابزار و تعامل با رایانه، از GPT-5.4 شرکت OpenAI و Gemini 3.1 Pro شرکت Google عملکرد بهتری داشته است.

یکی از ملموسترین تغییرات، ارتقای بسیار بزرگ در قابلیتهای بینایی مدل است. Claude Opus 4.7 اکنون میتواند تصاویر تا ۲٬۵۷۶ پیکسل در ضلع بلند را پردازش کند که سه برابرِ محدودیت وضوح قبلی است.

این افزایش توان بصری باعث میشود هوش مصنوعی نمودارهای پیچیده، رابطهای کاربری و دیاگرامهای فنی را بهتر تفسیر کند. با این حال، شرکت اشاره کرد که تصاویر با وضوح بالاتر توکنهای بیشتری مصرف میکنند و ممکن است هزینهها را برای کاربران پرتعداد افزایش دهند.

Anthropic همچنین ویژگی جدیدی با نام /ultrareview را در محیط Claude Code معرفی کرد. این ابزار به کاربران حرفهای و سطح max اجازه میدهد نشستهای چندعاملی اجرا کنند تا باگها و ایرادهای طراحی در نرمافزار را شناسایی کنند.

برای متخصصان مالی، این مدل درجه بالاتری از دقت و سختگیری در مدلسازی اقتصادی نشان میدهد. این مدل در ماژول General Finance امتیاز ۰.۸۱۳ کسب کرد که نسبت به امتیاز ۰.۷۶۷ نسخه قبلی، یک جهش معنادار محسوب میشود.

ساختار قیمتگذاری این مدل بدون تغییر باقی مانده است: ۵ دلار بهازای هر یک میلیون توکن ورودی و ۲۵ دلار بهازای هر یک میلیون توکن خروجی. برای کمک به مدیریت هزینهها در اجرایهای خودمختار طولانی، Anthropic قابلیت «بودجه وظیفه» را در نسخه بتای عمومی اضافه کرد.

دقیقاً مطابق دستورالعملها

بازخوردهای اولیه از جامعه توسعهدهندگان نشان میدهد این مدل در پیروی از دستورالعملها لفظیتر و تحتاللفظیتر عمل میکند. این تغییر ممکن است کاربران را مجبور کند پرامپتهای موجودی را که برای نسخههای قدیمیتر خانواده Claude بهینه شده بودند، دوباره تنظیم کنند.

«Claude 4.7 آمده و کار کردن با آن مثل این است که پشت فرمان یک خودروی فرمول ۱ بنشینی. قدرت بسیار بیشتر، و با نهایت سرعت دقیقاً همان کاری را میکند که به آن میگویی. کار تو این است که جهت را انتخاب کنی و پیچها را بپیچی»، یکی از کاربران در X نوشت.

برخی آزمایشکنندگان مشاهده کردهاند که توکنایزرِ بهروزشده میتواند برای همان ورودی تا ۱.۳۵ برابر توکن بیشتری مصرف کند. هرچند این موضوع میتواند به کاهش سریعتر سقف مجاز منجر شود، شرکت استدلال میکند که عملکرد بهازای هر وظیفه، این میزان مصرف را توجیه میکند.

ایمنی همچنان یک تمرکز اصلی است، زیرا مدل شامل محافظتهای خودکار جدیدی برای مسدود کردن کاربردهای پرریسک امنیت سایبری است. کارت سیستم Anthropic بر صداقتِ بهبودیافته و مقاومت قویتر در برابر تولید محتوای آسیبزا تأکید میکند.

این مدل اکنون از طریق Claude API، Amazon Bedrock، Google Vertex AI و Microsoft Foundry در دسترس است. همچنین پنجره زمینه ۱ میلیون توکنی را که اوایل امسال معرفی شده بود حفظ میکند.