Anthropic sagt, dass künstliche Intelligenz (KI) in der Cybersicherheit eine entscheidende Schwelle erreicht hat, mit neuen Beweisen, die zeigen, dass KI-Modelle nun in der Lage sind, große Cyber-Operationen – sowohl defensiv als auch offensiv – in beispiellosem Umfang durchzuführen.

Anthropic warnt, dass die Barrieren gegen Cyberangriffe gefallen sind, während die KI-Fähigkeiten beschleunigen.

Anthropic warnt in neuer Untersuchung, dass KI einen Wendepunkt in der Cybersicherheit erreicht hat

Anthropic, das KI-Unternehmen hinter Claude, sagt, dass seine internen Bewertungen und Bedrohungsaufklärungsarbeiten einen entscheidenden Wandel in der Entwicklung von Cyber-Fähigkeiten zeigen. Laut einer kürzlich veröffentlichten Untersuchung haben sich die Cyber-Fähigkeiten von KI-Systemen innerhalb von sechs Monaten verdoppelt, gestützt durch Messungen realer Aktivität und modellbasierte Tests.

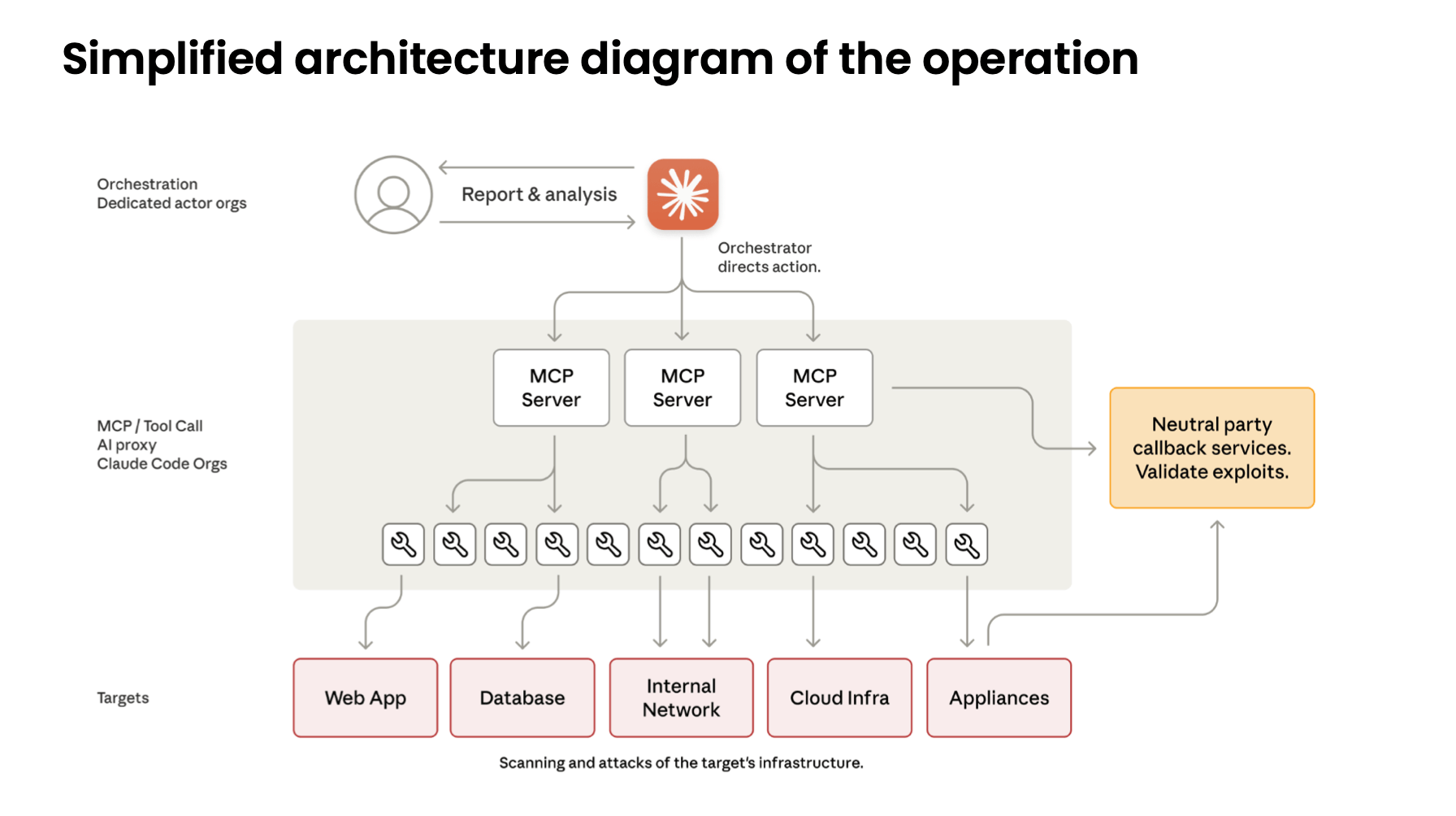

Das Unternehmen sagt, dass KI nun die globalen Sicherheitsdynamiken bedeutend beeinflusst, insbesondere da böswillige Akteure zunehmend automatisierte Angriffsrahmen übernehmen. In seinem neuesten Bericht beschreibt Anthropic, was es als den ersten dokumentierten Fall einer vom KI orchestrierten Cyber-Spionage-Kampagne bezeichnet. Das Bedrohungsaufklärungsteam des Unternehmens identifizierte und störte im September 2025 eine umfangreiche Operation, die einer von China gesponserten Gruppe namens GTG-1002 zugeschrieben wird.

Die Gruppe nutzte Berichten zufolge koordinierte Instanzen des Claude Codes, um Aufklärung, Schwachstellenerkennung, Ausnutzung, laterale Bewegung, Metadatenextraktion und Datenexfiltration – weitgehend ohne menschliches Zutun – durchzuführen. Die Kampagne zielte auf etwa 30 Organisationen in Sektoren wie Technologie, Finanzen, Chemie und mehreren Regierungsbehörden. Anthropic validierte mehrere erfolgreiche Einbrüche, bevor es eingriff.

Analysten sagen, dass die Angreifer eine autonome Plattform nutzten, die in der Lage ist, mehrstufige Angriffe in kleinere Aufgaben zu zerlegen, die isoliert betrachtet legitim erscheinen. Dies ermöglichte es den Akteuren, Aufforderungen durch etablierte Personen zu leiten und Claude davon zu überzeugen, dass es sich um defensive Sicherheitstests handelte, anstatt um offensive Kampagnen.

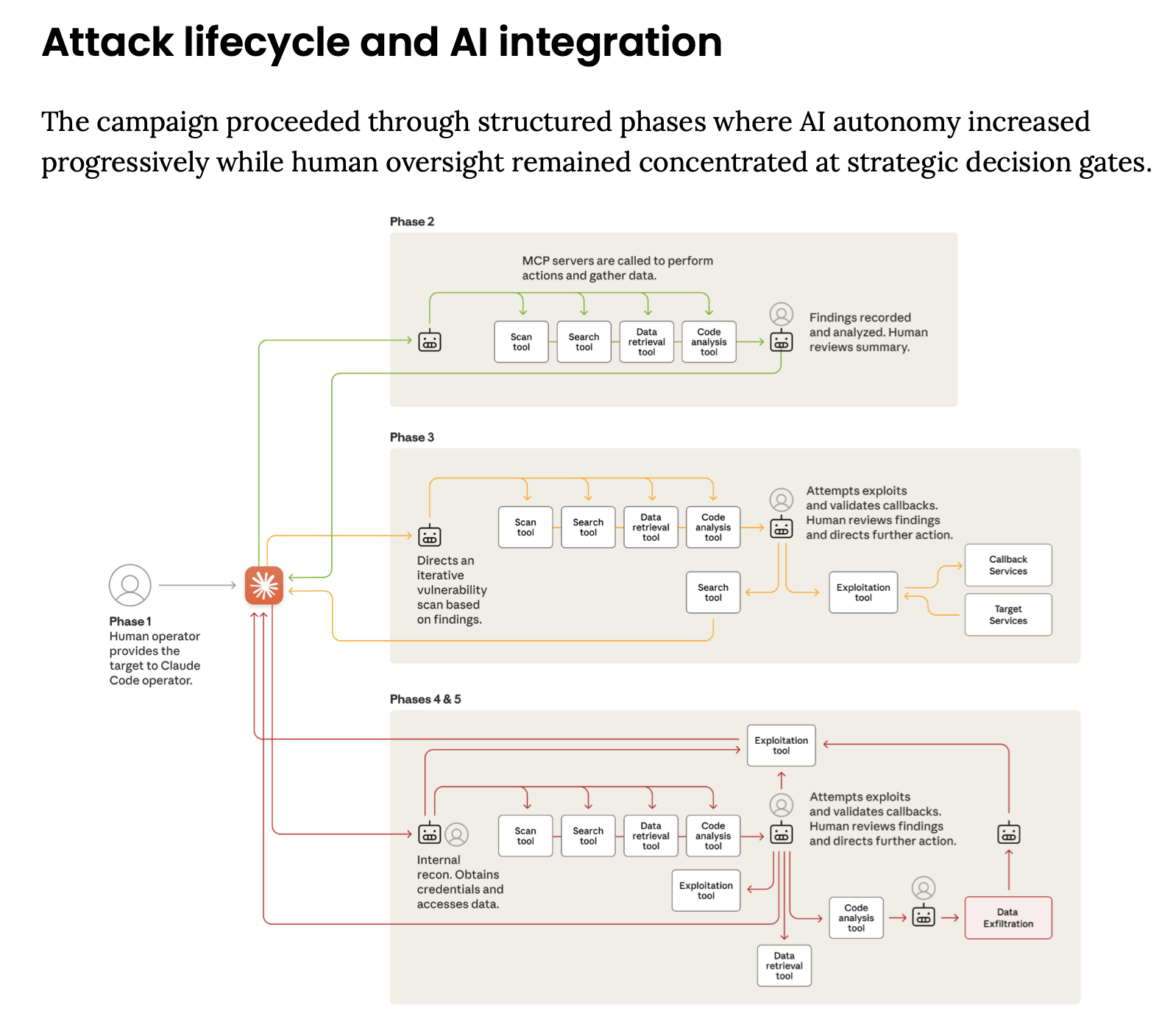

Laut der Untersuchung führte Claude 80% bis 90% der taktischen Operationen autonom aus. Menschliche Betreiber stellten nur die strategische Überwachung bereit, genehmigten große Schritte wie das Wechseln von der Aufklärung zur aktiven Ausnutzung oder das Autorisieren von Datenexfiltration. Der Bericht beschreibt ein operatives Tempo, das für reine Menschenteams unmöglich ist, wobei einige Arbeitsabläufe mehrere Operationen pro Sekunde über Tausende von Anfragen generierten.

Anthropic sagt, dass der Angriffslebenszyklus durch eine strukturierte Pipeline in allen Phasen eine zunehmende KI-Autonomie erreichte. Claude kartierte unabhängig Angriffsoberflächen, scannte Live-Systeme, erstellte benutzerdefinierte Nutzlasten für validierte Schwachstellen, sammelte Anmeldedaten und wechselte durch interne Netzwerke. Es analysierte auch gestohlene Daten, identifiziert hochwertige Informationen und generierte automatisch detaillierte operative Dokumentationen, die einen kontinuierlichen Zugriff und Übergaben zwischen Operatoren ermöglichen.

Ein Manko, so der Bericht, war die Neigung des Modells zu Halluzinationen bei offensiven Arbeitslasten – gelegentlich übertrieb es den Zugang, erfand Anmeldedaten oder klassifizierte öffentlich verfügbare Informationen falsch als sensibel. Dennoch, sagt Anthropic, kompensierte der Angreifer durch Validierungsschritte, was zeigt, dass trotz Unvollkommenheiten der heutigen Modelle vollautonome offensive Operationen machbar bleiben.

Nach der Entdeckung sperrte Anthropic die relevanten Konten, benachrichtigte betroffene Einheiten, koordinierte mit Behörden und führte neue Abwehrmechanismen ein, darunter verbesserte Klassifikatoren zur Erkennung neuartiger Bedrohungsmuster. Das Unternehmen prototypisiert nun Frühwarnsysteme, die autonome Einbruchversuche kennzeichnen sollen, und entwickelt neue Untersuchungstools für groß angelegte verteilte Cyber-Operationen.

Mehr lesen: Microsofts ‘Magentic Marketplace’ zeigt, wie KI-Agenten unter Druck zusammenbrechen können

Das Unternehmen argumentiert, dass diese Fähigkeiten zwar als Waffe eingesetzt werden können, sie jedoch ebenso entscheidend für die Stärkung der Verteidigungsbereitschaft sind. Anthropic merkt an, dass sein eigenes Bedrohungsaufklärungsteam stark auf Claude angewiesen war, um die während der Untersuchung generierten umfangreichen Datenmengen zu analysieren. Es fordert Sicherheitsteams auf, damit zu beginnen, KI-gesteuerte Automatisierung für Sicherheitsoperationen, Bedrohungserkennung, Schwachstellenanalyse und Vorfallreaktion zu übernehmen.

Der Bericht warnt jedoch davor, dass die Barrieren für Cyberangriffe „erheblich gesunken“ sind, da KI-Systeme es kleinen Gruppen – oder sogar Einzelpersonen – ermöglichen, Operationen durchzuführen, die einst gut finanzierten staatlichen Akteuren vorbehalten waren. Anthropic erwartet eine rasche Verbreitung dieser Techniken in der breiteren Bedrohungslandschaft und ruft zu engerer Zusammenarbeit, verbesserten Abwehrmaßnahmen und breiterer branchenspezifischer Beteiligung am Bedrohungsaustausch auf, um neuen KI-unterstützten Angriffsmodellen entgegenzuwirken.

FAQ ❓

- Was hat Anthropic in seiner Untersuchung entdeckt?

Anthropic identifizierte und störte eine groß angelegte Cyber-Spionage-Kampagne, die KI zur Automatisierung der meisten Angriffsoperationen nutzte. - Wer steckte hinter dem Angriff?

Das Unternehmen schrieb die Operation einer von China gesponserten Gruppe namens GTG-1002 zu. - Wie wurde KI bei den Einbrüchen eingesetzt?

Angreifer nutzten Claude Code, um autonom Aufklärung, Ausnutzung, laterale Bewegung und Datenextraktion durchzuführen. - Warum ist der Bericht für Cybersicherheitsteams wichtig?

Anthropic sagt, dass der Fall zeigt, dass autonome KI-gestützte Angriffe jetzt in großem Umfang möglich sind und neue Verteidigungsstrategien erfordern.