一项曾仅限于加密货币圈的去中心化人工智能实验,近日获得了英伟达首席执行官黄仁勋的公开认可,这表明分布式模型训练或许正逐步走向主流。

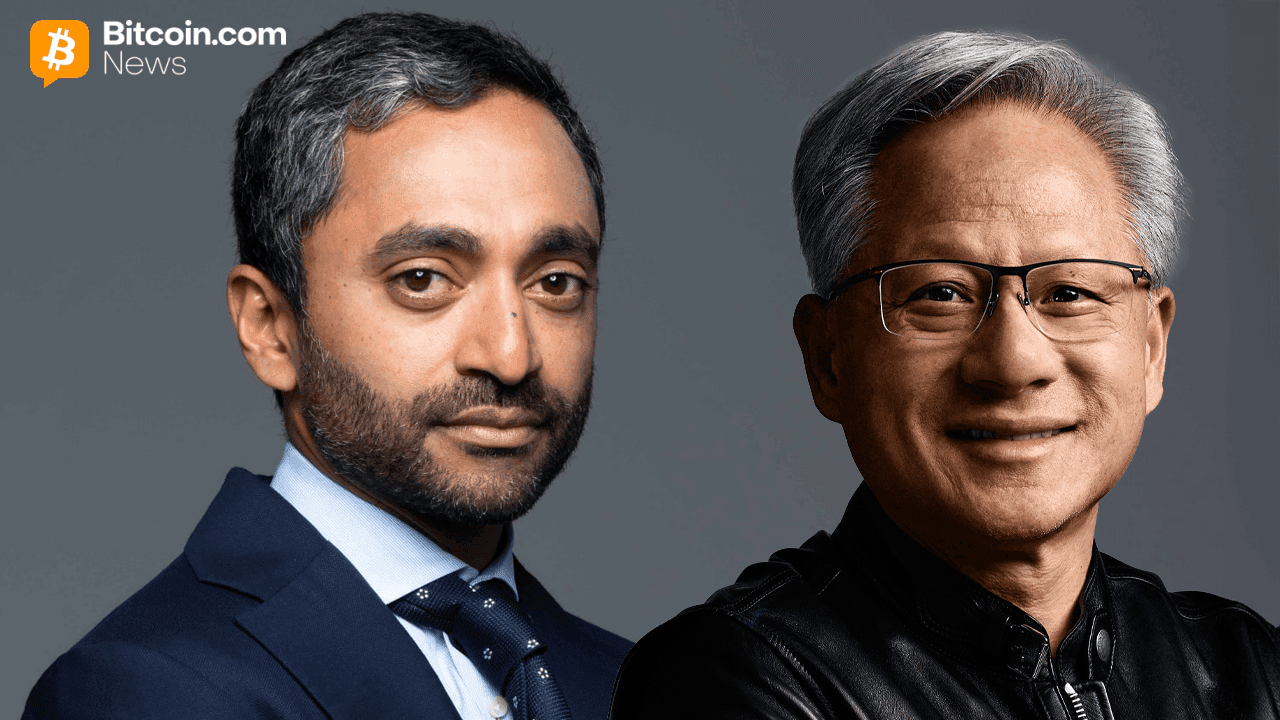

Bittensor的培训里程碑吸引了Chamath Palihapitiya和英伟达首席执行官黄仁勋的关注

英伟达CEO背书,开源AI势头渐强

查马斯·帕利哈皮蒂亚(Chamath Palihapitiya)在《All-In》播客的一期节目中重点介绍了Bittensor的Covenant-72B,将其视为去中心化人工智能(AI)超越理论范畴的切实例证。Bittensor是一个去中心化的、基于区块链的网络,它建立了一个点对点市场,在该市场中,机器学习模型和AI计算资源得以交换并获得激励。

帕利哈皮蒂亚用通俗易懂的语言描述了这一项目:一个无需集中式基础设施、而是由独立贡献者网络驱动的大规模语言模型(LLM)。“他们成功训练了一个拥有40亿参数的LLaMA模型,完全采用分布式方式,依靠众多用户贡献闲置算力,”他表示,并称其为“一项相当惊人的技术成就”。

这一类比让人联想到一个耳熟能详的比喻。“有随机的人参与,每个人都分得一小部分,”帕利哈皮蒂亚补充道,他提到了早期利用全球闲置硬件的分布式计算项目。

黄仁勋并未否定这一构想。相反,他从更广阔的视角审视了AI市场,认为去中心化与专有化两种路径并非相互排斥。“这两者并非非此即彼,而是可以兼而有之,”黄仁勋表示,“这一点毋庸置疑。”

这种双轨愿景反映了人工智能领域日益加深的分歧——以及重叠之处。一端是 ChatGPT、Claude 和 Gemini 这类封闭且高度优化的系统;另一端则是开放式、去中心化的模型,允许开发者和组织根据具体需求定制系统。

黄明确表示,他认为这两条路径都至关重要。“模型是一种技术,而非产品,”他指出,大多数用户将继续依赖成熟、通用的系统,而非从头开始构建自己的系统。

与此同时,他也指出了那些无法回避定制化的行业。“在许多行业中,其领域专业知识……必须以一种可控的方式被整合,”黄解释道,并补充说“这只能通过开放模型来实现。”

这一观点正中Bittensor的下怀。通过其Subnet 3(Templar)开发的Covenant-72B,代表了迄今为止规模最大的去中心化训练项目之一,它在没有中央权威机构的情况下,通过标准互联网连接协调了70多名贡献者。

从技术角度看,该模型突破了界限。它拥有720亿个参数,基于约1.1万亿个代币进行训练,并利用压缩通信协议和分布式数据并行处理等创新技术,使在传统数据中心之外进行训练成为可能。

性能指标表明这绝非单纯的实验。基准测试结果显示其已具备与成熟中心化模型抗衡的能力,这一细节也解释了为何该项目不仅吸引了加密货币圈内人士的关注。

市场同样对此有所反应。自帕利哈皮蒂亚与黄峥的视频在社交媒体上广泛传播以来,该项目代币TAO的价格已上涨24%。

英伟达斥资20亿美元,助力Nebius实现AI工厂计划

了解英伟达如何通过向人工智能云基础设施投入 20 亿美元,重塑计算的未来。 read more.

立即阅读

英伟达斥资20亿美元,助力Nebius实现AI工厂计划

立即阅读了解英伟达如何通过向人工智能云基础设施投入 20 亿美元,重塑计算的未来。 read more.

不过,黄仁勋的言论暗示,真正的故事并非颠覆,而是两者的共存。对于普通用户而言,专有AI系统很可能仍将占据主导地位,而开放且去中心化的模型则会在专业化、注重成本或以主权为导向的应用中开辟出自己的空间。

对于初创企业,英伟达首席执行官勾勒出一套务实的路线图:先开放,再叠加专有优势。“我们目前投资的每一家初创企业,都是先采用开源模式,随后再转向专有模式,”他表示。

换言之,AI的未来或许不属于单一的架构或理念,而是属于那些既能驾驭二者,又懂得何时该使用哪一种的人。

常见问题 🔎

- 什么是 Bittensor 的 Covenant-72B? 这是一个拥有 720 亿参数的语言模型,通过由贡献者组成的去中心化网络进行训练,无需集中式基础设施。

- 黄仁勋如何看待去中心化AI? 他表示开源与专有AI模型将共存,并将其关系描述为“A与B”,而非二者之间的二选一。

- 这一进展为何重要? 它表明大规模AI模型可以在传统数据中心之外进行训练,从而挑战了关于基础设施需求的既定假设。

- 这将如何影响人工智能行业? 这为未来混合模式奠定了基础,届时集中式平台与去中心化模型将在各行业中发挥不同的作用。