Forsvarsminister Pete Hegseth møtte Anthropic-sjef Dario Amodei i Pentagon tirsdag, mens Forsvarsdepartementet presset Anthropic til å fjerne restriksjoner på sitt Claude-system for kunstig intelligens (KI) eller risikere mulige sanksjoner.

Rapport: Anthropics Claude AI står overfor en usikker fremtid i klassifiserte Pentagon-systemer

Militær KI-styring settes på prøve i et høyinnsatsmøte i Pentagon

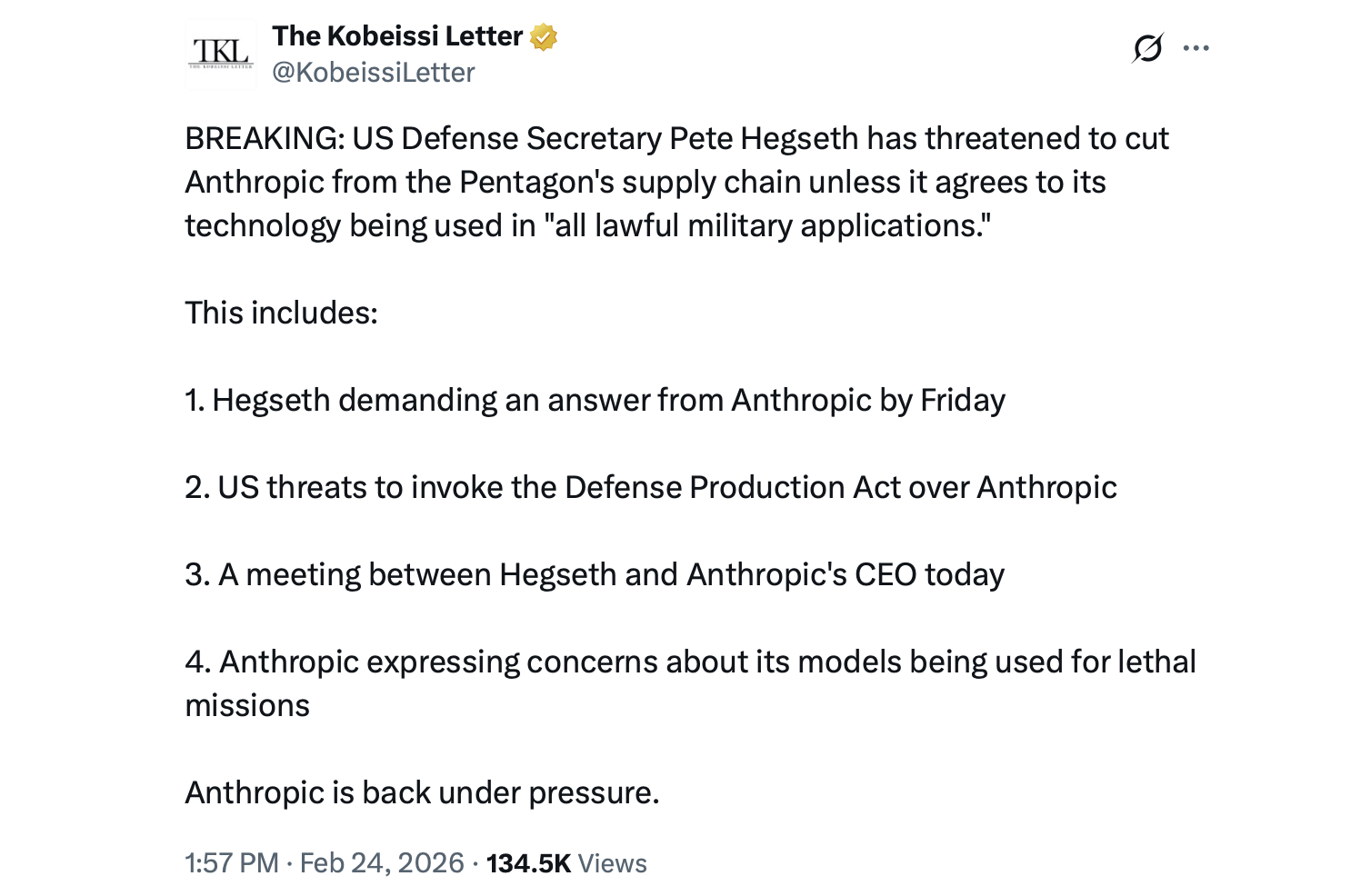

Møtet 24. februar fulgte flere uker med spenning rundt Anthropics retningslinjer for bruk av Claude, den store språkmodellen som er integrert i klassifiserte nettverk i Forsvarsdepartementet under en pilotkontrakt for 2025 verdt opptil 200 millioner dollar. Claude er for tiden den eneste fullt autoriserte store språkmodellen som opererer på tvers av enkelte sikre Pentagon-systemer.

Ifølge Axios sin rapportering protesterte Hegseth, sammen med viseforsvarsminister Steve Feinberg og sjefsjurist Earl Matthews, mot Anthropics restriksjoner på masseovervåking av amerikanere og på fullt autonome våpensystemer som opererer uten menneskelig tilsyn. Forsvarstjenestemenn hevdet at disse begrensningene innskrenker lovlige militære anvendelser og ikke bør overstyre kongressens og den utøvende myndighetens autoritet.

Anthropic har fastholdt at deres sikkerhetstiltak er utformet for å forhindre misbruk, samtidig som de fortsatt muliggjør nasjonale sikkerhetsanvendelser. Selskapet sier at retningslinjene deres ikke blokkerer legitim militær bruk, men forbyr aktiviteter som å spore enkeltpersoner uten samtykke eller å utplassere dødelige systemer uten menneskelig kontroll.

«Ifølge en kilde kjent med samtalene har Anthropic aldri motsatt seg bruk av modellene sine til ‘legitime militære operasjoner’,» rapporterte Fox News’ sjefskorrespondent for nasjonal sikkerhet, Jennifer Griffin, på X. «De sa også til Hegseth at de aldri klaget til Pentagon eller Palantir over bruken av modellene deres i Maduro-razziaen.»

Claude har blitt brukt til etterretningsanalyse, cyberforsvar og operativ planlegging. Rapporter indikerer at den støttet planlegging og sanntidsanalyse under operasjonen 3. januar som resulterte i pågripelsen av Venezuelas president Nicolás Maduro. Anthropic ba senere om avklaringer om modellens involvering som del av en intern etterlevelsesgjennomgang, noe Pentagon-tjenestemenn tolket som kritikk.

Den 9. januar utstedte Hegseth et notat der han oppfordret leverandører av kunstig intelligens (KI) til å fjerne det han beskrev som restriktive vilkår. Dette direktivet la grunnlaget for reforhandlinger og til slutt møtet 24. februar.

Pentagon har satt en frist 27. februar for at Anthropic skal endre sine vilkår. Mulige tiltak inkluderer å påberope seg Defense Production Act for å tvinge frem etterlevelse eller å klassifisere Anthropic som en risiko i forsyningskjeden, et skritt som kan kreve at kontraktører avhender seg fra Claude-relaterte systemer.

Tjenestemenn erkjenner at det vil være operasjonelt komplekst å løsrive Claude fra eksisterende infrastruktur. Likevel har departementet alternativer. Konkurrenter som xAI med Grok-modellen, OpenAI med ChatGPT, og Google med Gemini er under lignende kontrakter med Forsvarsdepartementet og kan være posisjonert til å utvide sine roller dersom samtalene skjærer seg.

Striden fremhever bredere spørsmål om KI-styring i militære sammenhenger, særlig ettersom føderal lovgivning fortsetter å utvikle seg rundt fremvoksende teknologier. På spill står om private KI-utviklere kan opprettholde uavhengige etiske retningslinjer når systemene deres blir innebygd i nasjonale sikkerhetsoperasjoner.

Reaksjonene på tvers av sosiale medieplattformer har vært påfallende direkte. «Overvåking uten kjennelse er tilbake,» skrev en X-bruker som svar på Griffins X-innlegg. «Dette må være mye større nyhet enn det er. Det er en reell sjanse for grunnlovsbrudd,» svarte en annen på Griffins omtale. Andre, med en dose mørk humor, spøkte med at Skynets ankomst kanskje ikke er langt unna. «Skynet er her… 2029-tidslinjen er LIVE,» bemerket vedkommende.

Begge sider har omtalt diskusjonen 24. februar som substansiell. Om Anthropic justerer sine sikkerhetstiltak før fristen kan avgjøre fremtiden til en av Pentagons mest avanserte KI-integrasjoner.

FAQ 🤖

- Hva ble diskutert på Pentagon-møtet 24. februar?

Møtet fokuserte på Anthropics restriksjoner på Claude KI og om de begrenser lovlige militære anvendelser. - Hvorfor presser Pentagon Anthropic?

Forsvarstjenestemenn hevder at selskapets sikkerhetstiltak griper inn i autorisert bruk knyttet til nasjonal sikkerhet. - Hva kan skje hvis Anthropic ikke etterkommer dette?

Pentagon kan påberope seg Defense Production Act eller klassifisere selskapet som en risiko i forsyningskjeden. - Finnes det alternativer til Claude?

Ja, modeller fra xAI, OpenAI og Google er under kontrakter med Forsvarsdepartementet og kan utvides ved behov.