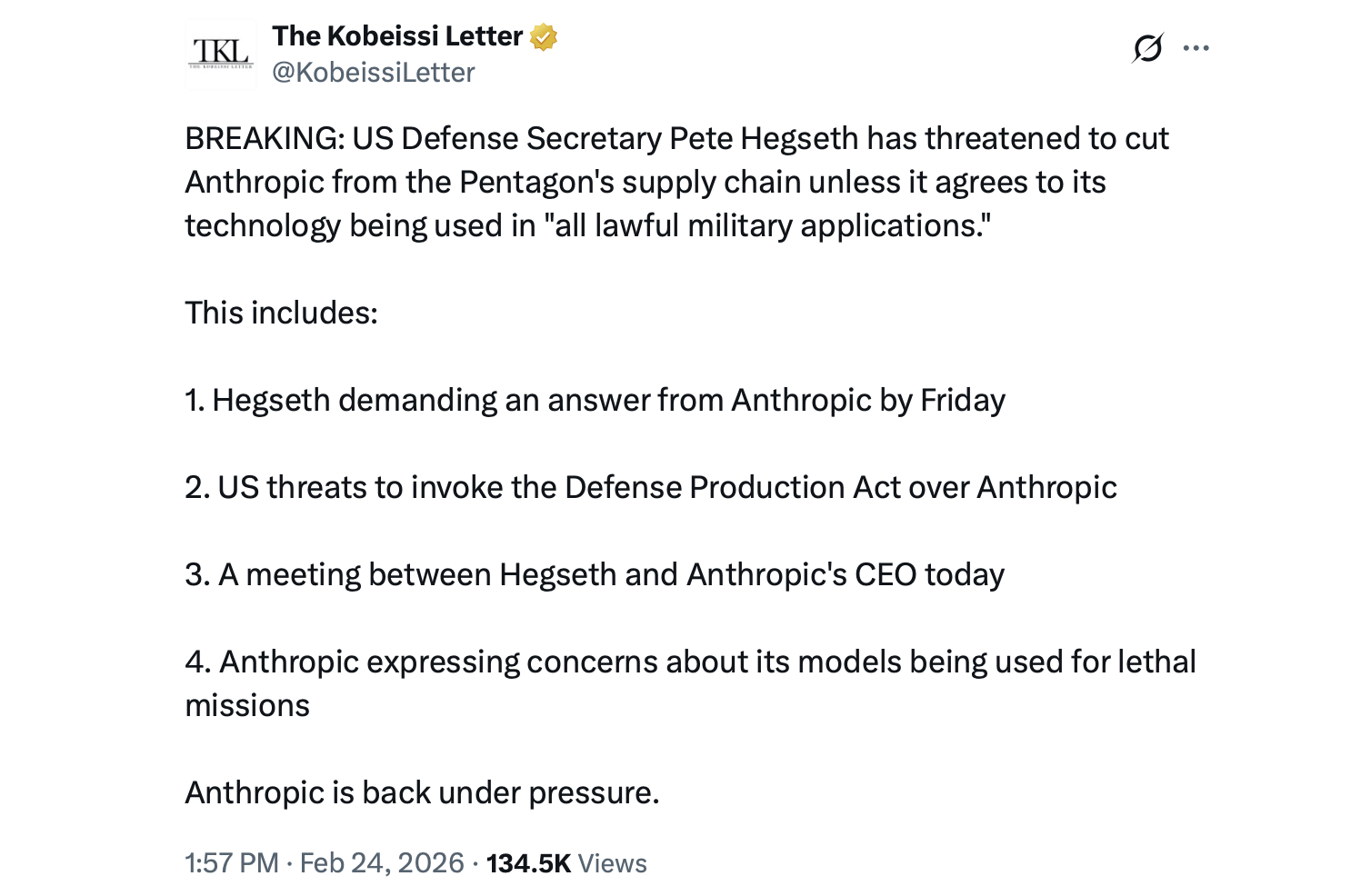

Minister van Defensie Pete Hegseth ontmoette dinsdag Anthropic-CEO Dario Amodei in het Pentagon, terwijl het ministerie van Defensie Anthropic onder druk zette om beperkingen op zijn Claude-systeem voor kunstmatige intelligentie (AI) te verwijderen, anders dreigen mogelijke sancties.

Rapport: Anthropic’s Claude AI staat voor een onzekere toekomst in geclassificeerde Pentagon-systemen

Militaire AI-governance op de proef gesteld in een Pentagon-bijeenkomst met hoge inzet

De bijeenkomst van 24 feb. volgde op weken van spanningen over Anthropics gebruiksbeleid voor Claude, het grote taalmodel dat onder een proefcontract voor 2025, ter waarde van maximaal $200 miljoen, is geïntegreerd in geclassificeerde netwerken van het ministerie van Defensie. Claude is momenteel het enige volledig geautoriseerde grote taalmodel dat draait binnen bepaalde beveiligde Pentagon-systemen.

Volgens berichtgeving van Axios maakten Hegseth, samen met plaatsvervangend minister Steve Feinberg en juridisch adviseur (General Counsel) Earl Matthews, bezwaar tegen Anthropics beperkingen op massasurveillance van Amerikanen en op volledig autonome wapensystemen die zonder menselijk toezicht opereren. Defensiefunctionarissen stelden dat die grenzen rechtmatige militaire toepassingen beperken en niet boven congres- en uitvoerende bevoegdheden zouden mogen staan.

Anthropic heeft volgehouden dat zijn waarborgen bedoeld zijn om misbruik te voorkomen en tegelijk toepassingen voor nationale veiligheid mogelijk te maken. Het bedrijf zegt dat zijn beleid legitiem militair gebruik niet blokkeert, maar activiteiten verbiedt zoals het volgen van individuen zonder toestemming of het inzetten van dodelijke systemen zonder menselijke controle.

“Volgens een bron die bekend is met de gesprekken heeft Anthropic nooit bezwaar gemaakt tegen het gebruik van zijn modellen voor ‘legitieme militaire operaties’,” meldde Fox News’ Chief National Security Correspondent Jennifer Griffin op X. “Het vertelde Hegseth ook dat het nooit bij het Pentagon of Palantir heeft geklaagd over het gebruik van zijn modellen bij de inval op Maduro.”

Claude is gebruikt voor inlichtingenanalyse, cyberverdediging en operationele planning. Berichten geven aan dat het ondersteuning bood bij planning en realtime analyse tijdens de operatie van 3 jan. die leidde tot de gevangenneming van de Venezolaanse president Nicolás Maduro. Anthropic zocht later verduidelijking over de betrokkenheid van het model als onderdeel van een interne compliancecontrole, wat Pentagon-functionarissen interpreteerden als kritiek.

Op 9 jan. gaf Hegseth een memo uit waarin hij aanbieders van kunstmatige intelligentie (AI) opriep om wat hij omschreef als beperkende voorwaarden te verwijderen. Die richtlijn vormde de aanloop naar heronderhandelingen en uiteindelijk de bijeenkomst van 24 feb.

Het Pentagon heeft een deadline van 27 feb. gesteld voor Anthropic om zijn voorwaarden aan te passen. Mogelijke maatregelen zijn onder meer het inroepen van de Defense Production Act om naleving af te dwingen of het aanmerken van Anthropic als een risico voor de toeleveringsketen, een stap die aannemers zou kunnen verplichten om Claude-gerelateerde systemen af te stoten.

Functionarissen erkennen dat het loskoppelen van Claude uit de bestaande infrastructuur operationeel complex zou zijn. Toch heeft het departement alternatieven. Concurrenten zoals xAI met zijn Grok-model, OpenAI met ChatGPT, en Google met Gemini vallen onder vergelijkbare contracten van het ministerie van Defensie en kunnen mogelijk hun rol uitbreiden als de gesprekken vastlopen.

Het geschil benadrukt bredere vragen over AI-governance in militaire context, vooral nu federale wetgeving zich blijft ontwikkelen rond opkomende technologieën. Op het spel staat of particuliere AI-ontwikkelaars onafhankelijke ethische beleidslijnen kunnen handhaven wanneer hun systemen verankerd raken in nationale veiligheidsoperaties.

Reacties op sociale mediaplatforms zijn opvallend openhartig geweest. “Surveillance zonder bevel is terug,” schreef een X-gebruiker in reactie op Griffins X-bericht. “Dit moet veel groter nieuws zijn dan het is. Er is een serieuze kans op grondwetschendingen,” antwoordde een ander op Griffins stuk. Anderen, met een dosis zwarte humor, grapten dat de komst van Skynet misschien niet ver weg is. “Skynet is er… de tijdlijn van 2029 is LIVE,” merkte die persoon op.

Beide partijen hebben de discussie van 24 feb. als inhoudelijk bestempeld. Of Anthropic zijn waarborgen vóór de deadline aanpast, kan de toekomst bepalen van een van de meest geavanceerde AI-integraties van het Pentagon.

FAQ 🤖

- Wat werd er besproken tijdens de Pentagon-bijeenkomst van 24 feb.?

De bijeenkomst ging over Anthropics beperkingen op Claude AI en of die rechtmatige militaire toepassingen beperken. - Waarom zet het Pentagon Anthropic onder druk?

Defensiefunctionarissen stellen dat de waarborgen van het bedrijf de geautoriseerde nationale veiligheidsdoeleinden hinderen. - Wat kan er gebeuren als Anthropic niet meewerkt?

Het Pentagon kan de Defense Production Act inroepen of het bedrijf aanmerken als een risico voor de toeleveringsketen. - Zijn er alternatieven voor Claude?

Ja, modellen van xAI, OpenAI en Google vallen onder contracten van het ministerie van Defensie en kunnen indien nodig uitbreiden.