وزیر دفاع، پیت هگست، روز سهشنبه در پنتاگون با داریو آمودی، مدیرعامل Anthropic، دیدار کرد؛ همزمان وزارت دفاع از Anthropic خواست محدودیتهای سیستم هوش مصنوعی کلود (Claude) را حذف کند، در غیر این صورت ممکن است با جریمههای احتمالی مواجه شود.

گزارش: هوش مصنوعی کلودِ Anthropic با آیندهای نامطمئن در سامانههای طبقهبندیشده پنتاگون روبهرو است

حکمرانی هوش مصنوعی نظامی در نشست پرمخاطره پنتاگون محک خورد

نشست ۲۴ فوریه پس از هفتهها تنش بر سر سیاستهای استفاده Anthropic برای کلود برگزار شد؛ همان مدل زبانی بزرگ که تحت یک قرارداد آزمایشی سال ۲۰۲۵ با ارزشی تا سقف ۲۰۰ میلیون دلار در شبکههای محرمانه وزارت دفاع ادغام شده است. کلود در حال حاضر تنها مدل زبانی بزرگِ کاملاً مجاز است که در برخی سامانههای امن پنتاگون فعالیت میکند.

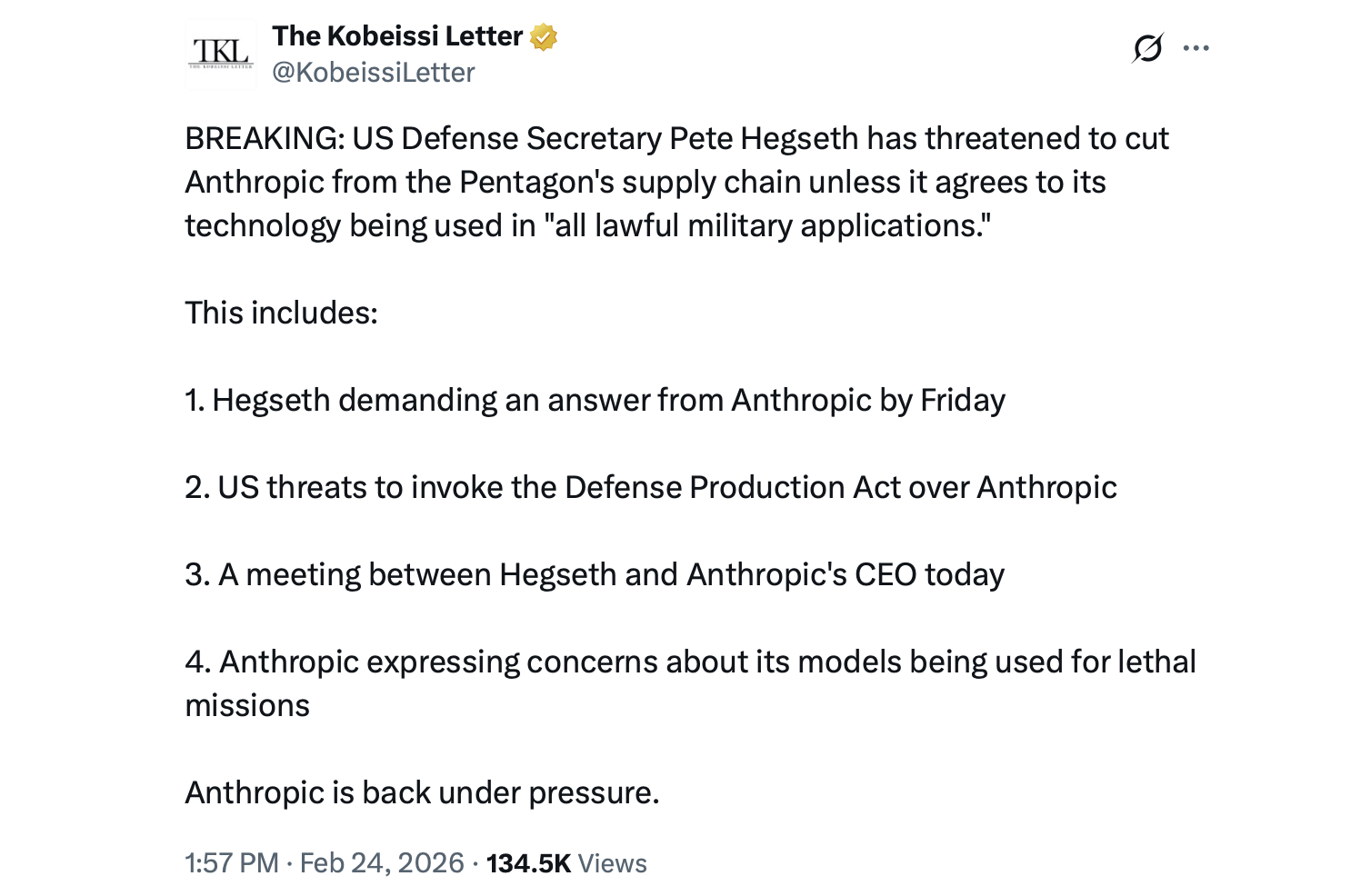

بر اساس گزارش Axios، هگست بههمراه معاون وزیر، استیو فاینبرگ، و مشاور حقوقی ارشد، ارل متیوز، به محدودیتهای Anthropic درباره نظارت انبوه بر آمریکاییها و نیز سامانههای تسلیحاتی کاملاً خودمختار که بدون نظارت انسانی عمل میکنند، اعتراض کردند. مقامهای دفاعی استدلال کردند این محدودیتها کاربردهای قانونی نظامی را محدود میکند و نباید بر اختیار کنگره و قوه مجریه مقدم شود.

Anthropic گفته است که حفاظهایش برای جلوگیری از سوءاستفاده طراحی شدهاند و در عین حال امکان کاربردهای امنیت ملی را فراهم میکنند. این شرکت میگوید سیاستهایش استفاده نظامی مشروع را مسدود نمیکند، اما فعالیتهایی مانند ردیابی افراد بدون رضایت یا بهکارگیری سامانههای مرگبار بدون کنترل انسانی را ممنوع میسازد.

جنیفر گریفین، خبرنگار ارشد امنیت ملی فاکسنیوز، در X گزارش داد: «به گفته یک منبع آگاه از گفتوگوها، Anthropic هرگز با استفاده از مدلهایش برای “عملیاتهای نظامی مشروع” مخالفت نکرده است.» او افزود: «همچنین به هگست گفت هرگز به پنتاگون یا پالانتیر درباره استفاده از مدلهایش در یورش به مادورو شکایتی نکرده است.»

کلود برای تحلیل اطلاعاتی، دفاع سایبری و برنامهریزی عملیاتی به کار رفته است. گزارشها نشان میدهد که این مدل در برنامهریزی و تحلیل لحظهایِ عملیات ۳ ژانویه که به دستگیری رئیسجمهور ونزوئلا، نیکولاس مادورو، انجامید، پشتیبانی ارائه کرده است. Anthropic بعداً بهعنوان بخشی از یک بررسی داخلی انطباق، خواستار شفافسازی درباره میزان دخالت مدل شد؛ اقدامی که مقامهای پنتاگون آن را بهعنوان انتقاد تعبیر کردند.

هگست در ۹ ژانویه یادداشتی صادر کرد و از ارائهدهندگان هوش مصنوعی (AI) خواست آنچه را «شرایط محدودکننده» توصیف کرد، حذف کنند. آن دستورالعمل زمینه را برای مذاکره مجدد و در نهایت نشست ۲۴ فوریه فراهم کرد.

پنتاگون برای Anthropic ضربالاجل ۲۷ فوریه تعیین کرده تا شرایط خود را تغییر دهد. واکنشهای احتمالی شامل توسل به قانون تولید دفاعی برای وادار کردن به تبعیت یا معرفی Anthropic بهعنوان ریسک زنجیره تأمین است؛ اقدامی که میتواند پیمانکاران را ملزم کند از سامانههای مرتبط با کلود خارج شوند.

مقامها اذعان دارند که جدا کردن کلود از زیرساخت موجود از نظر عملیاتی پیچیده خواهد بود. با این حال، وزارت دفاع گزینههای جایگزین دارد. رقیبانی مانند xAI با مدل Grok، OpenAI با ChatGPT، و گوگل با Gemini تحت قراردادهای مشابه وزارت دفاع هستند و ممکن است اگر مذاکرات به بنبست بخورد، برای گسترش نقش خود در موقعیت مناسبی قرار داشته باشند.

این اختلاف، پرسشهای گستردهتری را درباره حکمرانی هوش مصنوعی در محیطهای نظامی برجسته میکند؛ بهویژه در حالی که قانون فدرال پیرامون فناوریهای نوظهور همچنان در حال تکامل است. مسئله این است که آیا توسعهدهندگان خصوصی هوش مصنوعی میتوانند وقتی سامانههایشان در عملیات امنیت ملی جا میافتد، سیاستهای اخلاقی مستقل خود را حفظ کنند یا نه.

واکنشها در پلتفرمهای شبکههای اجتماعی بهطور قابل توجهی صریح بوده است. «نظارت بدون حکم برگشته»، یکی از کاربران X در پاسخ به پست گریفین در X نوشت. «این باید خیلی بیشتر از چیزی که هست خبرساز بشه. احتمال جدی نقض قانون اساسی وجود داره»، کاربر دیگری در نوشته گریفین پاسخ داد. دیگران هم با چاشنی طنز تلخ شوخی کردند که شاید رسیدن اسکاینت چندان دور نباشد. «اسکاینت اینجاست… خط زمانی ۲۰۲۹ فعاله»، آن فرد اظهار کرد.

هر دو طرف، گفتوگوی ۲۴ فوریه را «محتوامحور» توصیف کردهاند. اینکه آیا Anthropic پیش از ضربالاجل حفاظهای خود را تعدیل میکند یا نه، میتواند آینده یکی از پیشرفتهترین یکپارچهسازیهای هوش مصنوعی پنتاگون را تعیین کند.

سوالات متداول 🤖

- در نشست ۲۴ فوریه پنتاگون چه موضوعی مطرح شد؟

تمرکز نشست بر محدودیتهای Anthropic درباره هوش مصنوعی کلود و این بود که آیا این محدودیتها کاربردهای قانونی نظامی را محدود میکنند یا نه. - چرا پنتاگون به Anthropic فشار میآورد؟

مقامهای دفاعی استدلال میکنند حفاظهای شرکت با استفادههای مجاز امنیت ملی تداخل ایجاد میکند. - اگر Anthropic تبعیت نکند چه ممکن است رخ دهد؟

پنتاگون میتواند به قانون تولید دفاعی متوسل شود یا شرکت را بهعنوان ریسک زنجیره تأمین معرفی کند. - آیا جایگزینی برای کلود وجود دارد؟

بله، مدلهایی از xAI، OpenAI و گوگل تحت قراردادهای وزارت دفاع هستند و در صورت نیاز میتوانند گسترش پیدا کنند.