Експеримент із децентралізованим штучним інтелектом, який раніше був відомий лише у криптоспільноті, нещодавно отримав публічну підтримку від генерального директора Nvidia Дженсена Хуанга, що свідчить про те, що навчання розподілених моделей, можливо, поступово наближається до широкого вжитку.

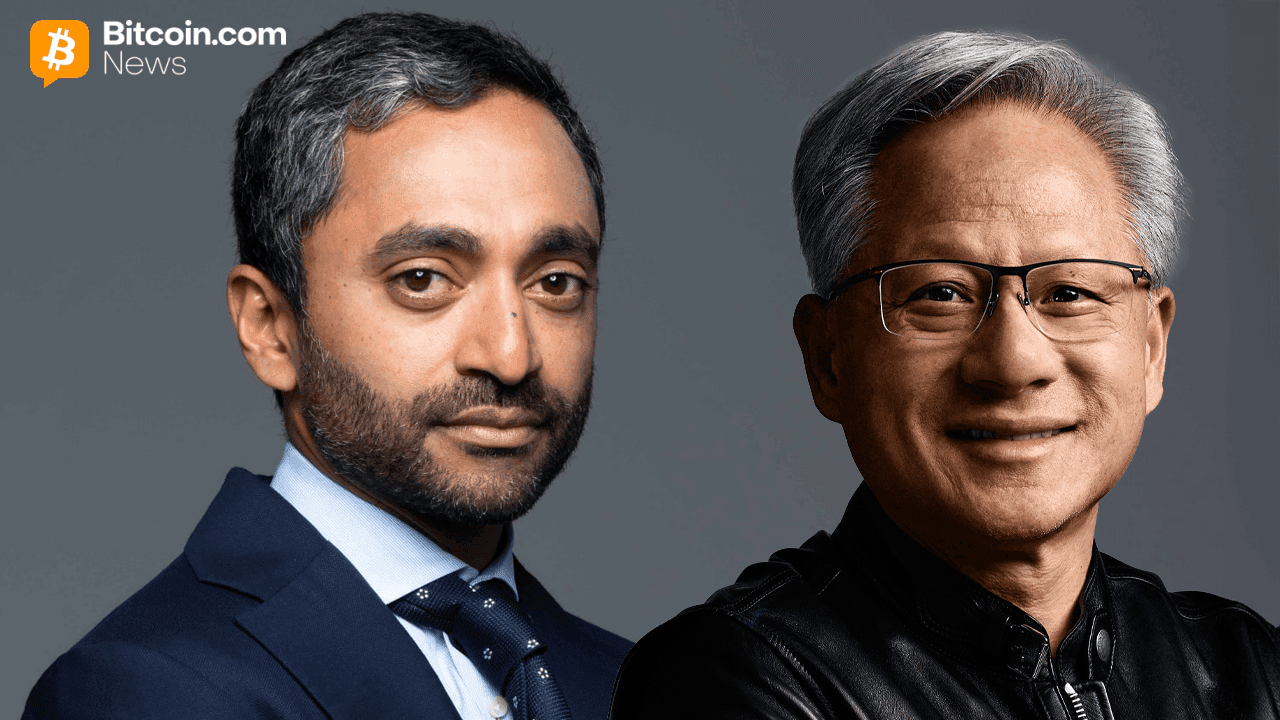

Етап підготовки Bittensor привернув увагу Чамата Паліхапітія та генерального директора Nvidia Дженсена Хуанга

Імпульс відкритого ШІ набирає обертів завдяки підтримці генерального директора Nvidia

Чамат Паліхапітія висвітлив Covenant-72B від Bittensor під час епізоду подкасту All-In, представивши його як конкретний приклад децентралізованого штучного інтелекту (ШІ), що виходить за межі теорії. Bittensor працює як децентралізована мережа на основі блокчейну, яка створює одноранговий ринок, на якому обмінюються та стимулюються моделі машинного навчання та обчислення ШІ.

Паліхапітія описав цю ініціативу простими словами: великомасштабна мовна модель (LLM), навчена без централізованої інфраструктури, що замість цього працює завдяки мережі незалежних учасників. «Їм вдалося навчити модель LLaMA з 4 мільярдами параметрів, повністю розподілену, за допомогою групи людей, які надають надлишкові обчислювальні потужності», — сказав він, назвавши це «досить божевільним технічним досягненням».

Порівняння завершилося знайомою аналогією. «Є випадкові люди, і кожна людина отримує невелику частку», — додав Паліхапітія, посилаючись на ранній проект розподілених обчислень, який використовував незайняте обладнання по всьому світу.

Хуан не відкинув цю ідею. Натомість він схилився до ширшого бачення ринку ШІ, припустивши, що децентралізовані та пропрієтарні підходи не є взаємовиключними. «Ці дві речі — це не А чи Б; це А і Б», — сказав Хуан. «У цьому немає сумнівів».

Ця двояка концепція відображає зростаючий розрив — і перетин — у сфері ШІ. З одного боку — закриті, досконалі системи, такі як ChatGPT, Claude та Gemini. З іншого — відкриті та децентралізовані моделі, що дозволяють розробникам та організаціям налаштовувати системи під конкретні потреби.

Хуан чітко дав зрозуміти, що вважає обидва напрямки однаково важливими. «Моделі — це технологія, а не продукт», — сказав він, зазначивши, що більшість користувачів і надалі покладатимуться на досконалі системи загального призначення, а не створюватимуть власні з нуля.

Водночас він вказав на галузі, де налаштування є обов’язковим. «Є ціла низка галузей, де їхня галузева експертиза… має бути відображена таким чином, щоб вони могли її контролювати», — пояснив Хуан, додавши, що «це можливо лише завдяки відкритим моделям».

Ця заява цілком відповідає профілю діяльності Bittensor. Covenant-72B, розроблений у рамках Subnet 3 (Templar), є одним із найбільших на сьогодні децентралізованих навчальних процесів, що координує понад 70 учасників через стандартні інтернет-з’єднання без центрального органу управління.

З технічної точки зору, модель розширює межі. Побудована з 72 мільярдами параметрів і навчена на приблизно 1,1 трильйона токенів, вона використовує такі інновації, як стислі протоколи зв'язку та розподілений паралелізм даних, щоб зробити навчання можливим поза традиційними дата-центрами.

Показники продуктивності свідчать, що це не просто експеримент. Результати тестування ставлять її в один ряд із відомими централізованими моделями, що допомагає пояснити, чому проект привернув увагу не лише аудиторії, зацікавленої у криптовалютах.

Ринок також це помітив. Після оголошення токен проекту TAO зріс на 24% з моменту, як відео з Паліхапітією та Хуангом поширилося в соціальних мережах.

Nvidia підтримує плани Nebius щодо створення фабрики штучного інтелекту, інвестувавши 2 мільярди доларів

Дізнайтеся, як компанія Nvidia змінює майбутнє обчислювальної техніки, інвестуючи 2 мільярди доларів у хмарну інфраструктуру штучного інтелекту. read more.

Читати

Nvidia підтримує плани Nebius щодо створення фабрики штучного інтелекту, інвестувавши 2 мільярди доларів

Дізнайтеся, як компанія Nvidia змінює майбутнє обчислювальної техніки, інвестуючи 2 мільярди доларів у хмарну інфраструктуру штучного інтелекту. read more.

Читати

Nvidia підтримує плани Nebius щодо створення фабрики штучного інтелекту, інвестувавши 2 мільярди доларів

ЧитатиДізнайтеся, як компанія Nvidia змінює майбутнє обчислювальної техніки, інвестуючи 2 мільярди доларів у хмарну інфраструктуру штучного інтелекту. read more.

Проте коментарі Хуанга вказують на те, що справжня історія полягає не в руйнуванні, а в співіснуванні обох підходів. Пропрієтарні системи штучного інтелекту, ймовірно, залишаться домінуючими для загальних користувачів, тоді як відкриті та децентралізовані моделі займатимуть свою нішу у спеціалізованих, чутливих до вартості або орієнтованих на суверенітет додатках.

Для стартапів генеральний директор Nvidia окреслив прагматичний план дій: починати з відкритості, а потім додавати власні переваги. «Кожен стартап, у який ми зараз інвестуємо, спочатку є відкритим, а потім переходить до власницької моделі», — сказав він.

Іншими словами, майбутнє ШІ може не належати жодній архітектурі чи філософії. Воно може належати тим, хто вміє орієнтуватися в обох — і знає, коли що використовувати.

FAQ 🔎

- Що таке Covenant-72B від Bittensor?

Модель мови з 72 мільярдами параметрів, навчена через децентралізовану мережу учасників без централізованої інфраструктури. - Що сказав Дженсен Хуанг про децентралізований ШІ?

Він зазначив, що відкриті та пропрієтарні моделі ШІ будуть співіснувати, описавши їхні відносини як «А і Б», а не як вибір між ними. - Чому цей розвиток є важливим?

Він показує, що великомасштабні моделі ШІ можна навчати поза традиційними дата-центрами, ставлячи під сумнів припущення щодо потреб в інфраструктурі. - Як це впливає на галузь ШІ?

Це підтримує гібридне майбутнє, де централізовані платформи та децентралізовані моделі виконують різні ролі в різних галузях.