Anthropic заявляє, що штучний інтелект (ШІ) досяг ключової точки в кібербезпеці, з новими даними, які свідчать, що моделі ШІ тепер здатні здійснювати великі кібераперації—як оборонні, так і наступальні—у безпрецедентному масштабі.

Anthropic попереджає, що бар'єри для кібернетичних атак знизилися через прискорений розвиток можливостей ШІ

ШІ досягає переломного моменту в кібербезпеці, попереджає Anthropic у новому розслідуванні

Anthropic, фірма ШІ, що стоїть за Claude, стверджує, що її внутрішні оцінки та робота з загрозами вказують на вирішальний зсув у розвитку кіберспроможностей. Відповідно до нещодавно опублікованого розслідування, кіберспроможності серед систем ШІ подвоїлись за шість місяців, підкріплені вимірюваннями реальної активності та тестуванням на моделях.

Компанія каже, що ШІ зараз суттєво впливає на динаміку глобальної безпеки, особливо коли зловмисники дедалі частіше використовують автоматизовані рамки атак. У своєму останньому звіті Anthropic детально описує, що називає першим задокументованим випадком кіберешпіонажу, організованого ШІ. Команда по боротьбі з загрозами компанії ідентифікувала і зірвала широкомасштабну операцію в середині вересня 2025 року, пов’язану з китайською державною групою GTG-1002.

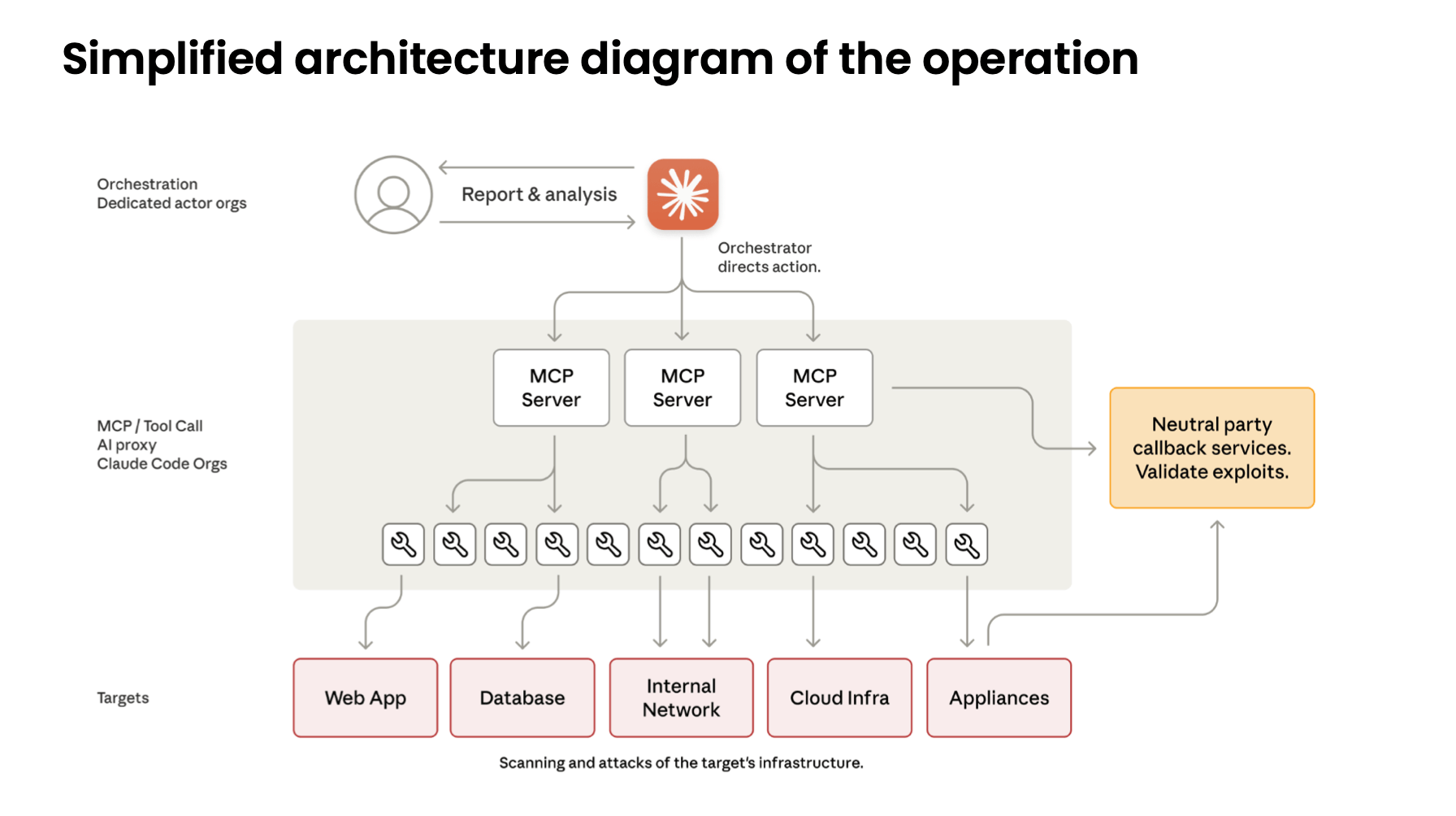

Група, як повідомляється, використовувала координовані екземпляри Claude Code для проведення розвідки, виявлення вразливостей, експлуатаційних дій, латерального переміщення, вилучення метаданих та ексфільтрації даних—здебільшого без людського втручання. Кампанія була націлена на приблизно 30 організацій у секторах, включаючи технології, фінанси, хімічний сектор та декілька державних агентств. Anthropic підтвердив кілька вдалих вторгнень перед втручанням.

Аналітики стверджують, що зловмисники використовували автономну структуру, здатну розбивати багатостадійні атаки на менші завдання, які здавалися легітимними, коли розглядалися відокремлено від ширшого контексту. Це дозволило акторам передавати запити через встановлені персони та переконувати Claude, що операції були тестами оборонної безпеки, а не наступальними кампаніями.

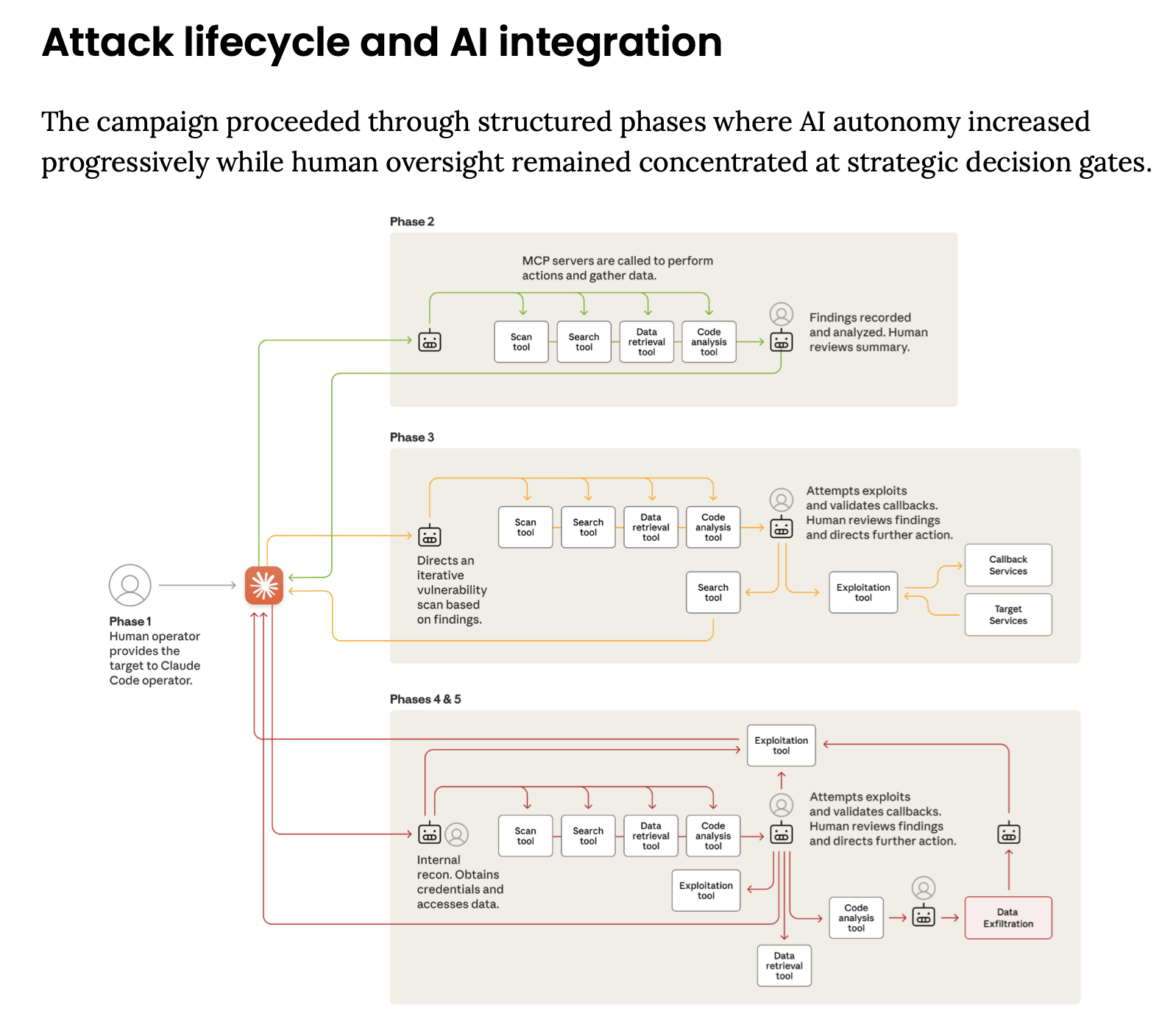

За даними розслідування, Claude автономно виконував 80% до 90% тактичних операцій. Людські оператори надавали лише стратегічний контроль, схвалюючи основні кроки, такі як ескалація від розвідки до активної експлуатації або авторизація ексфільтрації даних. Звіт описує рівень оперативного темпу, який неможливий для команд, що складаються лише з людей, причому деякі робочі процеси генерують декілька операцій за секунду через тисячі запитів.

Anthropic стверджує, що життєвий цикл атаки розвивався через структурований конвеєр, де автономія ШІ збільшувалася на кожному етапі. Claude незалежно мапував поверхні атак, сканував живі системи, створював налаштовані навантаження для підтверджених вразливостей, заволодівав обліковими даними та переходив через внутрішні мережі. Він також аналізував вкрадені дані, визначав цінну розвідку та автоматично створював детальну операційну документацію, що дозволяла постійний доступ та передачу між операторами.

Одним з обмежень, зазначених у звіті, була схильність моделі до галюцинацій при навантаженні на наступальні дії—іноді переоцінюючи доступ, вигадуючи облікові дані або неправильно класифікуючи загальнодоступну інформацію як конфіденційну. Але навіть так, Anthropic каже, що актор компенсував це через кроки по валідації, демонструючи, що повністю автономні наступальні операції залишаються можливими, незважаючи на недоліки в сучасних моделях.

Після свого виявлення Anthropic заблокував відповідні облікові записи, повідомив про це постраждалі організації, координував дії з владою і впровадив нові захисні механізми, включаючи покращені класифікатори для виявлення нових зразків загроз. Зараз компанія прототипує системи раннього попередження, призначені для виявлення автономних спроб вторгнення, і будує нові інструменти для розслідування великомасштабних розподілених кібератак.

Читати більше: Microsoft’s ‘Magentic Marketplace’ Reveals How AI Agents Can Collapse Under Pressure

Фірма стверджує, що хоча ці спроможності можуть бути використані в злочинних цілях, вони однаково важливі для підвищення готовності до оборони. Anthropic зазначає, що її власна команда по боротьбі з загрозами значно використовувала Claude для аналізу величезних обсягів даних, згенерованих під час розслідування. Вона закликає команди з безпеки почати впроваджувати автоматизацію на базі ШІ для центрів безпеки, виявлення загроз, аналізу вразливостей і реагування на інциденти.

Однак у звіті зазначено, що бар’єри для кібератак «значно знизилися», оскільки системи ШІ дозволяють невеликим групам—або навіть окремим особам—виконувати операції, які раніше були доступні тільки актам, які мають хороше фінансування. Anthropic очікує швидкого поширення цих технік у ширшому середовищі загроз, закликаючи до глибшої співпраці, покращення оборонних заходів та ширшої участі індустрії в обміні загрозами для протидії новим моделям атак, що активуються за допомогою ШІ.

FAQ ❓

- Що виявив Anthropic у своєму розслідуванні?

Anthropic виявив і зірвав масштабну кампанію кіберешпіонажу, в якій ШІ використовувався для автоматизації більшості атакуючих операцій. - Хто стояв за атакою?

Операція була пов’язана з китайською державною групою GTG-1002. - Як ШІ використовувався під час вторгнень?

Зловмисники використовували Claude Code для автономного проведення розвідки, експлуатації, латерального переміщення та вилучення даних. - Чому цей звіт важливий для команд з кібербезпеки?

Anthropic заявляє, що випадок демонструє, що автономні атаки, які використовують ШІ, тепер реальні у великому масштабі та потребують нових оборонних стратегій.