Güvenlik araştırmacıları, Perplexity, OpenAI ve Anthropic’ten yapay zeka (AI) destekli tarayıcılar ve ajanların gizli komut enjeksiyon saldırıları ve mahremiyet ihlallerine karşı artan risklerle karşı karşıya olduğunu, kullanıcı verilerini bağlantılı hesaplar ve API’lar aracılığıyla potansiyel olarak açığa çıkarabileceğini uyarıyor.

AI Tarayıcıları Baskı Altında: Gizli Web İstekleri Ajanınızı ve Bağlı Hesaplarınızı Ele Geçirebilir

Yapay Zeka Tarayıcı Güvenlik Açıkları Güvenlik Endişelerini Artırıyor

Perplexity, OpenAI ve Anthropicten yapay zeka tarayıcıları ve ajanları, kullanıcıların web ile nasıl etkileşim kurduğunu yeniden tanımlıyor—ama uzmanlar bu kolaylığın bir bedeli olduğunu söylüyor.

Gözden geçirilen güvenlik denetimleri ve araştırmalara göre, bu sistemlerdeki zayıf noktalar, kötü niyetli kişilerin yapay zeka araçlarının farkında olmadan çalıştırabileceği gizli talimatları web sitelerine yerleştirmesine olanak tanıyor.

Örtülü veya dolaylı komut enjeksiyonu olarak bilinen bu saldırılar, yapay zeka ajanlarını izinsiz işlemler gerçekleştirmeye yönlendirebilir—mesela hassas bilgilerin sızdırılması, kod çalıştırılması veya kullanıcıların phishing sitelerine yönlendirilmesi—bunu açık kullanıcı izni olmaksızın yapabilirler.

Saldırılar Yapay Zeka Ajanlarını Nasıl Etkiliyor?

Örtülü komut enjeksiyon senaryolarında, saldırganlar zararlı komutları bir web sayfasının metnine, meta verilerine veya hatta görünmez öğelerine gizler. Bir yapay zeka bu verileri alır almaz, komutlar kullanıcı niyetini geçersiz kılarak ajanın istenmeyen işlemleri gerçekleştirmesine neden olabilir. Yapılan testler, korunmasız yapay zeka tarayıcılarının bu tür hilelere kontrollü deneylerde dörtte bir oranında yenik düştüğünü gösteriyor.

Perplexity, OpenAI ve Anthropic: Belirlenen Ana Riskler

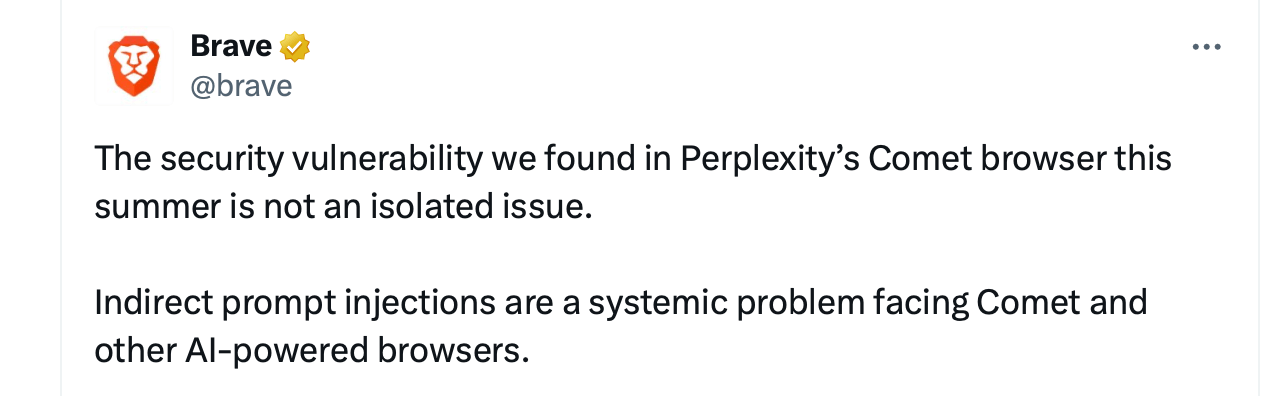

- Perplexity’nin Comet Tarayıcısı: Brave ve Guardio tarafından yapılan denetimlerde aracın Reddit gönderileri veya phishing siteleri üzerinden betik çalıştırma veya kullanıcı verisi çıkarma yoluyla manipüle edilebileceği bulundu.

- OpenAI’nin Tarayıcı Ajanları: ChatGPT’nin ajanik özelliklerine entegre edilmiş olup, kötü niyetli e-posta ve web tabanlı komutlar aracılığıyla bağlantılı hesap erişimi riski taşıdığı gösterildi.

- Anthropic’in Claude Tarayıcı Eklentisi: Kırmızı takım testleri, gizli web sayfası komutlarının zararlı bağlantılara otomatik tıklamalar tetikleyebileceğini ortaya koydu.

Belgelenen Olaylar ve Sektör Uyarıları

Güvenlik araştırmacıları ve Brave, Guardio ve Malwarebytes gibi siber güvenlik firmaları, basit çevrimiçi içeriğin bile yapay zeka araclarını tehlikeye atabileceğini gösteren bulgular yayınladı. Bir testte, bir Reddit gönderisi bir yapay zeka tarayıcısını phishing betikleri çalıştırmaya zorladı. Birkaç üst düzey teknoloji yayını, bu sorunların izinsiz veri erişimine veya hatta finansal hırsızlığa neden olabileceğini uyardı.

Hesap Entegrasyonun Tehlikeleri

Güvenlik analistleri, şifreler veya API’larla bağlantılı yapay zeka ajanları hakkında uyarıda bulundu. Bu tür entegrasyonlara izin vermek e-posta hesaplarını, bulut sürücüleri ve ödeme platformlarını açığa çıkarabilir. Techcrunch ve Cybersecurity Dive, yapay zeka ajanlarının injekte edilen komutlar yoluyla hassas bilgileri ifşa etmeye veya manipüle etmeye yönlendirildiği örnekleri rapor etti.

Önerilen Güvenlik Önlemleri ve Gelecek Görünümü

Uzmanlar, kullanıcıların izinlerini sınırlamalarını, yapay zeka ajanlarına şifre düzeyinde erişim izni vermekten kaçınmalarını ve yapay zeka kayıtlarını anormallikler için izlemelerini öneriyor. Geliştiricilere ayrıca izolasyon sistemleri ve komut filtreleri uygulamaları tavsiye ediliyor. Bazı araştırmacılar, yapay zeka araçları daha sıkı güvenlik önlemleri alana kadar hassas işlemler için geleneksel tarayıcıların kullanılmasını öneriyor.

OpenAI, Anthropic ve Perplexity muhtemelen bu zorlukların farkında olsa da, siber güvenlik uzmanları, yapay zeka destekli web tarayıcılığının 2025’te yüksek riskli bir alan olmaya devam ettiğini bildiriyor. Bu şirketler otonom web etkileşiminde daha da ilerledikçe, sektör gözlemcileri, şeffaflık ve daha güçlü güvenlik standartlarının bu tür araçlar ana akım haline gelmeden önce gerekli olduğunu söylüyor.

SSS 🧭

- Yapay zeka tarayıcılarında örtülü komut enjeksiyonları nelerdir?

Bunlar, kullanıcı izni olmadan yapay zeka ajanlarını zararlı işlemler yapmaya kandıran web içeriğine gömülü gizli komutlardır. - Bu güvenlik açıklarından hangi şirketlerin yapay zeka araçları etkilendi?

Perplexity’nin Comet, OpenAI’nin ChatGPT tarayıcı ajanları ve Anthropic’in Claude tarayıcı özellikleri yakın dönemdeki raporlarda yer aldı. - Yapay zeka ajanlarının kişisel hesaplara bağlanmasından doğan riskler nelerdir?

Yapay zeka araçlarının sürücülere, e-postalara veya API’lara bağlanması veri hırsızlığı, kimlik avı ve izinsiz hesap erişimini mümkün kılabilir. - Kullanıcılar yapay zeka tarayıcı saldırılarından nasıl korunabilir?

İzinleri sınırlayın, şifre entegrasyonlarından kaçının, sanal alan modları kullanın ve güvenlik tavsiyelerinden haberdar olun.