รัฐมนตรีกลาโหม พีท เฮกเซธ พบกับ ดาริโอ อาโมเดอี ซีอีโอของ Anthropic ที่เพนตากอนเมื่อวันอังคาร ขณะที่กระทรวงกลาโหมกดดันให้ Anthropic ยกเลิกข้อจำกัดในระบบปัญญาประดิษฐ์ (AI) Claude ของตน มิฉะนั้นอาจเผชิญบทลงโทษที่เป็นไปได้

รายงาน: Claude AI ของ Anthropic เผชิญอนาคตที่ไม่แน่นอนในระบบเพนตากอนที่เป็นความลับ

ธรรมาภิบาล AI ทางทหารถูกทดสอบในการประชุมเพนตากอนที่เดิมพันสูง

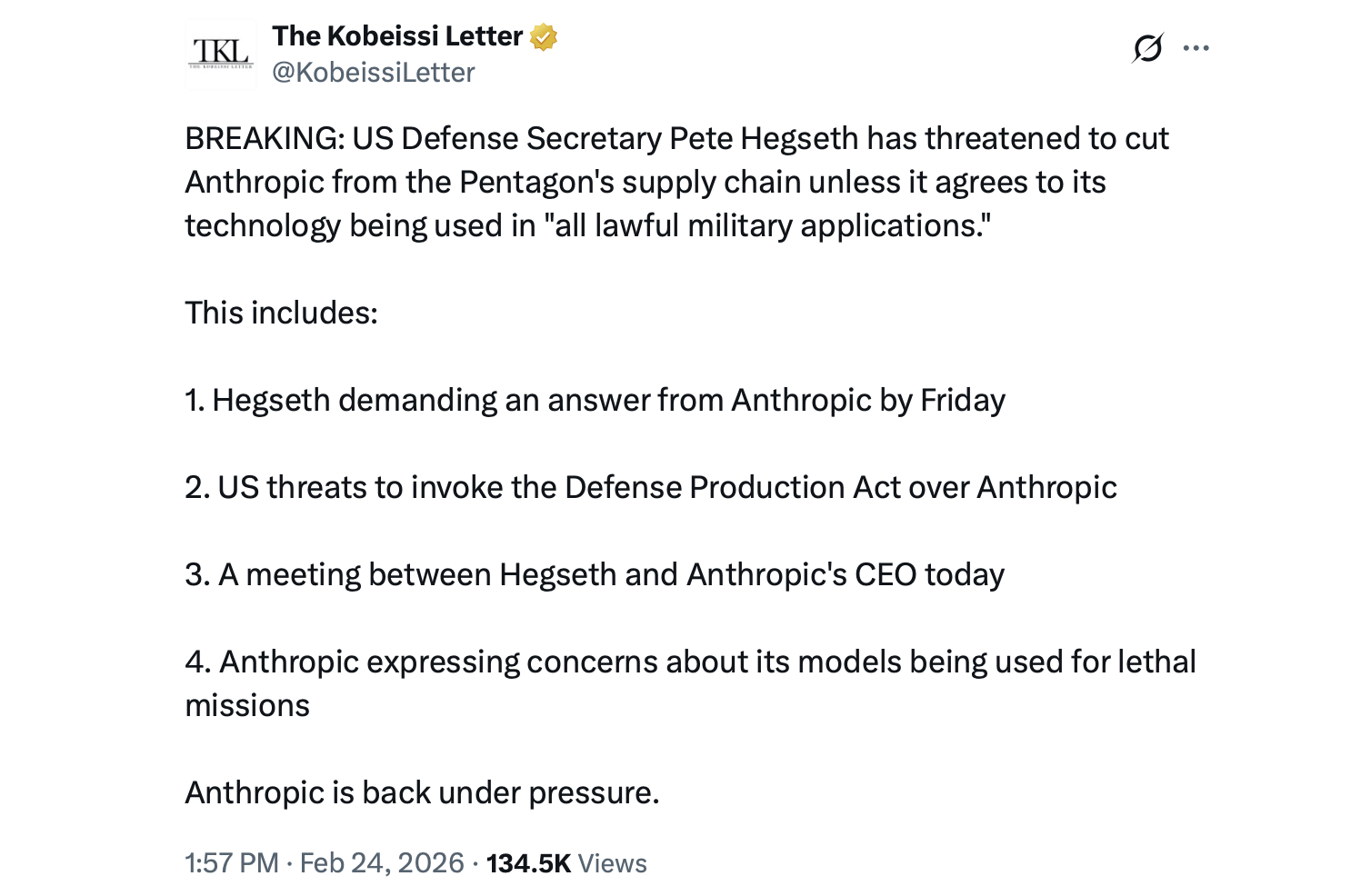

การประชุมเมื่อวันที่ 24 ก.พ. เกิดขึ้นหลังจากหลายสัปดาห์ของความตึงเครียดเกี่ยวกับนโยบายการใช้งาน Claude ของ Anthropic ซึ่งเป็นโมเดลภาษาขนาดใหญ่ที่ถูกรวมเข้ากับเครือข่ายลับของกระทรวงกลาโหมภายใต้สัญญาทดลองปี 2025 มูลค่าสูงสุด 200 ล้านดอลลาร์ ปัจจุบัน Claude เป็นโมเดลภาษาขนาดใหญ่เพียงรายเดียวที่ได้รับอนุญาตอย่างเต็มรูปแบบให้ทำงานบนระบบเพนตากอนที่ปลอดภัยบางส่วน

ตามการรายงานของ Axios reporting เฮกเซธ ซึ่งร่วมประชุมกับรองรัฐมนตรี สตีฟ ไฟน์เบิร์ก และที่ปรึกษากฎหมายทั่วไป เอิร์ล แมทธิวส์ คัดค้านข้อจำกัดของ Anthropic ที่ห้ามการสอดส่องมวลชนต่อชาวอเมริกัน และห้ามระบบอาวุธอัตโนมัติเต็มรูปแบบที่ทำงานโดยไม่มีการกำกับดูแลจากมนุษย์ เจ้าหน้าที่กลาโหมโต้แย้งว่าข้อจำกัดดังกล่าวไปจำกัดการใช้งานทางทหารที่ชอบด้วยกฎหมาย และไม่ควรอยู่เหนืออำนาจของฝ่ายนิติบัญญัติและฝ่ายบริหาร

Anthropic ยืนยันว่าสิ่งคุ้มกันของตนถูกออกแบบมาเพื่อป้องกันการนำไปใช้ในทางที่ผิด ขณะเดียวกันยังเอื้อให้เกิดการใช้งานด้านความมั่นคงแห่งชาติ บริษัทระบุว่านโยบายไม่ได้ปิดกั้นการใช้งานทางทหารที่ชอบธรรม แต่ห้ามกิจกรรม เช่น การติดตามบุคคลโดยไม่ได้รับความยินยอม หรือการนำระบบสังหารไปใช้โดยไม่มีมนุษย์ควบคุม

“ตามแหล่งข่าวที่คุ้นเคยกับการหารือ Anthropic ไม่เคยคัดค้านการใช้โมเดลของตนใน ‘ปฏิบัติการทางทหารที่ชอบธรรม’” เจนนิเฟอร์ กริฟฟิน ผู้สื่อข่าวอาวุโสด้านความมั่นคงแห่งชาติของ Fox News reported บน X “บริษัทยังบอกกับเฮกเซธว่าไม่เคยร้องเรียนต่อเพนตากอนหรือ Palantir เกี่ยวกับการใช้โมเดลของตนในการบุกจู่โจมมาดูโร”

Claude ถูกใช้เพื่อการวิเคราะห์ข่าวกรอง การป้องกันทางไซเบอร์ และการวางแผนปฏิบัติการ Reports ระบุว่ามันสนับสนุนการวางแผนและการวิเคราะห์แบบเรียลไทม์ระหว่างปฏิบัติการวันที่ 3 ม.ค. ซึ่งนำไปสู่การ capture ประธานาธิบดีเวเนซุเอลา นิโกลัส มาดูโร ภายหลัง Anthropic ขอความชัดเจนเกี่ยวกับการมีส่วนเกี่ยวข้องของโมเดลในฐานะส่วนหนึ่งของการทบทวนการปฏิบัติตามกฎภายใน ซึ่งเจ้าหน้าที่เพนตากอน interpreted ว่าเป็นการวิจารณ์

เมื่อวันที่ 9 ม.ค. เฮกเซธ issued a memo เรียกร้องให้ผู้ให้บริการ ปัญญาประดิษฐ์ (AI) ยกเลิกสิ่งที่เขาอธิบายว่าเป็นเงื่อนไขที่จำกัดเกินไป คำสั่งดังกล่าวปูทางไปสู่การเจรจาแก้ไขสัญญา และท้ายที่สุดนำไปสู่การประชุมวันที่ 24 ก.พ.

เพนตากอนได้กำหนดเส้นตายวันที่ 27 ก.พ. ให้ Anthropic ปรับแก้ข้อกำหนดของตน ทางเลือกตอบสนองที่เป็นไปได้รวมถึงการอาศัยกฎหมาย Defense Production Act เพื่อบังคับให้ปฏิบัติตาม หรือการกำหนดให้ Anthropic เป็นความเสี่ยงต่อห่วงโซ่อุปทาน ซึ่งเป็นขั้นตอนที่อาจกำหนดให้ผู้รับเหมาจำเป็นต้องถอนการลงทุนจากระบบที่เกี่ยวข้องกับ Claude

เจ้าหน้าที่ยอมรับว่าการแยก Claude ออกจากโครงสร้างพื้นฐานที่มีอยู่จะมีความซับซ้อนเชิงปฏิบัติการ อย่างไรก็ตาม กระทรวงยังมีทางเลือกอื่น คู่แข่งอย่าง xAI กับโมเดล Grok, OpenAI กับ ChatGPT และ Google กับ Gemini อยู่ภายใต้สัญญากับกระทรวงกลาโหมเช่นกัน และอาจอยู่ในตำแหน่งที่จะขยายบทบาทหากการเจรจาสะดุด

ข้อพิพาทนี้สะท้อนคำถามที่กว้างขึ้นเกี่ยวกับธรรมาภิบาล AI ในบริบททางทหาร โดยเฉพาะอย่างยิ่งเมื่อกฎหมายของรัฐบาลกลางยังคงพัฒนาควบคู่ไปกับเทคโนโลยีเกิดใหม่ ประเด็นเดิมพันคือ นักพัฒนา AI ภาคเอกชนจะสามารถคงนโยบายจริยธรรมที่เป็นอิสระได้หรือไม่ เมื่อระบบของพวกเขาถูกฝังอยู่ในปฏิบัติการด้านความมั่นคงแห่งชาติ

ปฏิกิริยาบนแพลตฟอร์มโซเชียลมีเดียต่าง ๆ ค่อนข้างตรงไปตรงมาอย่างเห็นได้ชัด “การสอดส่องโดยไม่ต้องมีหมายกลับมาแล้ว” ผู้ใช้ X รายหนึ่ง wrote เพื่อตอบโพสต์ X ของกริฟฟิน “นี่ควรเป็นข่าวใหญ่กว่าที่เป็นอยู่มาก มีโอกาสสูงที่จะละเมิดรัฐธรรมนูญ” อีกรายหนึ่ง replied ต่อบทเขียนของกริฟฟิน คนอื่น ๆ พร้อมอารมณ์ขันหม่น ๆ joked ว่าการมาถึงของ Skynet อาจไม่ไกลแล้ว “Skynet มาแล้ว… ไทม์ไลน์ปี 2029 เปิดใช้งานแล้ว” บุคคลนั้นกล่าว

ทั้งสองฝ่ายระบุว่าการหารือวันที่ 24 ก.พ. มีสาระสำคัญว่า Anthropic จะปรับสิ่งคุ้มกันของตนก่อนถึงเส้นตายหรือไม่ อาจเป็นตัวกำหนดอนาคตของหนึ่งในการผสานรวม AI ที่ก้าวหน้าที่สุดของเพนตากอน

FAQ 🤖

- มีการพูดคุยอะไรบ้างในการประชุมเพนตากอนวันที่ 24 ก.พ.?

การประชุมมุ่งเน้นไปที่ข้อจำกัดของ Anthropic ต่อ Claude AI และว่าข้อจำกัดเหล่านั้นจำกัดการใช้งานทางทหารที่ชอบด้วยกฎหมายหรือไม่ - ทำไมเพนตากอนจึงกดดัน Anthropic?

เจ้าหน้าที่กลาโหมโต้แย้งว่าสิ่งคุ้มกันของบริษัทไปรบกวนการใช้งานด้านความมั่นคงแห่งชาติที่ได้รับอนุญาต - อาจเกิดอะไรขึ้นหาก Anthropic ไม่ปฏิบัติตาม?

เพนตากอนอาจอาศัยกฎหมาย Defense Production Act หรือกำหนดให้บริษัทเป็นความเสี่ยงต่อห่วงโซ่อุปทาน - มีทางเลือกอื่นแทน Claude หรือไม่?

มี โมเดลจาก xAI, OpenAI และ Google อยู่ภายใต้สัญญากับกระทรวงกลาโหมและอาจขยายบทบาทได้หากจำเป็น