การทดลอง AI แบบกระจายศูนย์ที่ครั้งหนึ่งเคยจำกัดอยู่ในวงการคริปโต เพิ่งได้รับการกล่าวถึงต่อสาธารณะจาก Jensen Huang ซีอีโอของ Nvidia ซึ่งเป็นสัญญาณว่าการฝึกโมเดลแบบกระจายศูนย์อาจกำลังขยับเข้าใกล้กระแสหลักมากขึ้น

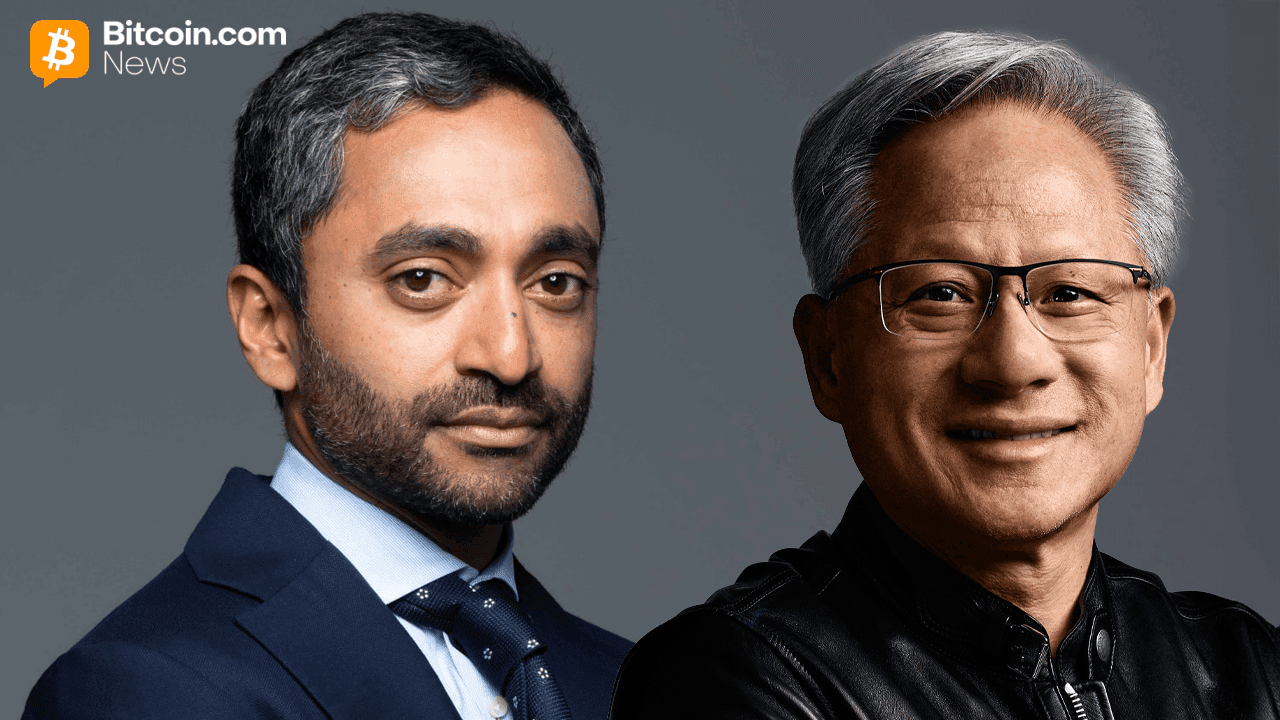

หมุดหมายสำคัญด้านการฝึกอบรมของ Bittensor ดึงดูดความสนใจจาก Chamath Palihapitiya และ Jensen Huang ซีอีโอของ Nvidia

แรงส่งของ AI โอเพนซอร์สเพิ่มขึ้นด้วยการสนับสนุนจากซีอีโอ Nvidia

Chamath Palihapitiya หยิบยก Covenant-72B ของ Bittensor ขึ้นมาพูดถึงระหว่างตอนหนึ่งของพอดแคสต์ All-In โดยวางกรอบว่าเป็นตัวอย่างที่จับต้องได้ของปัญญาประดิษฐ์แบบกระจายศูนย์ (AI) ที่ก้าวข้ามจากทฤษฎีไปสู่การใช้งานจริง Bittensor ทำงานในฐานะเครือข่ายแบบกระจายศูนย์ที่ขับเคลื่อนด้วยบล็อกเชน ซึ่งสร้างตลาดแบบเพียร์ทูเพียร์ที่มีการแลกเปลี่ยนและให้แรงจูงใจแก่โมเดลแมชชีนเลิร์นนิงและกำลังประมวลผลสำหรับ AI

Palihapitiya อธิบายความพยายามนี้ด้วยภาษาง่ายๆ: โมเดลภาษาขนาดใหญ่ (LLM) ที่ฝึกโดยไม่มีโครงสร้างพื้นฐานแบบรวมศูนย์ แต่ขับเคลื่อนด้วยเครือข่ายผู้มีส่วนร่วมอิสระ “พวกเขาสามารถฝึกโมเดล LLaMA ขนาด 4 พันล้านพารามิเตอร์ แบบกระจายศูนย์ทั้งหมด ด้วยการที่ผู้คนจำนวนมากช่วยกันนำพลังประมวลผลส่วนเกินมาร่วม” เขากล่าว พร้อมเรียกมันว่า “เป็นความสำเร็จทางเทคนิคที่บ้าคลั่งพอสมควร”

การเปรียบเทียบนี้เชื่อมโยงด้วยอุปมาอุปไมยที่คุ้นเคย “มีคนแบบสุ่มๆ แล้วแต่ละคนก็ได้ส่วนแบ่งเล็กๆ น้อยๆ” Palihapitiya กล่าวเสริม โดยอ้างถึงโครงการคอมพิวติ้งแบบกระจายศูนย์ยุคแรกที่ดึงเอาฮาร์ดแวร์ที่ว่างอยู่ทั่วโลกมาใช้

Huang ไม่ได้ปัดตกแนวคิดนี้ ตรงกันข้าม เขาขยายกรอบไปสู่ภาพใหญ่ของ ตลาด AI โดยชี้ว่ากรอบคิดแบบกระจายศูนย์และแบบปิดเป็นกรรมสิทธิ์ไม่ได้ขัดแย้งกัน “สองอย่างนี้ไม่ใช่ A หรือ B แต่มันคือ A และ B” Huang กล่าว “ไม่มีข้อกังขาเลย”

วิสัยทัศน์แบบสองรางนี้สะท้อนความแตกต่าง—และส่วนที่ทับซ้อน—ที่เพิ่มขึ้นภายในโลก AI ด้านหนึ่งคือระบบแบบปิดที่ขัดเกลาอย่างดี เช่น ChatGPT, Claude และ Gemini อีกด้านคือโมเดลแบบเปิดน้ำหนัก (open-weight) และแบบกระจายศูนย์ที่เปิดให้ผู้พัฒนาและองค์กรปรับแต่งระบบให้เหมาะกับความต้องการเฉพาะได้

Huang ย้ำชัดว่าเขามองว่าทั้งสองแนวทางมีความจำเป็น “โมเดลคือเทคโนโลยี ไม่ใช่สินค้า” เขากล่าว พร้อมสังเกตว่าผู้ใช้ส่วนใหญ่จะยังคงพึ่งพาระบบเอนกประสงค์ที่ขัดเกลาแล้ว มากกว่าการสร้างของตัวเองขึ้นมาใหม่ตั้งแต่ต้น

ขณะเดียวกัน เขาชี้ไปยังอุตสาหกรรมที่ “การปรับแต่ง” ไม่ใช่ทางเลือก “มีอุตสาหกรรมมากมายที่ความเชี่ยวชาญเฉพาะโดเมนของพวกเขา… ต้องถูกเก็บไว้ในรูปแบบที่พวกเขาสามารถควบคุมได้” Huang อธิบาย และเสริมว่า “สิ่งนั้นเกิดขึ้นได้จากโมเดลแบบเปิดเท่านั้น”

คำกล่าวนั้นเข้ากับสิ่งที่ Bittensor ถนัดโดยตรง Covenant-72B ซึ่งพัฒนาผ่าน Subnet 3 (Templar) เป็นตัวแทนของ หนึ่งในการรันฝึกแบบกระจายศูนย์ที่ใหญ่ที่สุด จนถึงปัจจุบัน โดยประสานผู้มีส่วนร่วมมากกว่า 70 รายผ่านการเชื่อมต่ออินเทอร์เน็ตมาตรฐาน โดยไม่มีหน่วยงานส่วนกลาง

ในเชิงเทคนิค โมเดลดันขอบเขตให้ไกลขึ้น สร้างด้วยพารามิเตอร์ 72 พันล้าน และฝึกด้วยโทเคนราว 1.1 ล้านล้านโทเคน โดยอาศัยนวัตกรรมอย่างโปรโตคอลการสื่อสารแบบบีบอัดและการขนานข้อมูลแบบกระจาย (distributed data parallelism) เพื่อทำให้การฝึกเป็นไปได้แม้อยู่นอกศูนย์ข้อมูลแบบดั้งเดิม

ตัวชี้วัดด้านประสิทธิภาพบ่งชี้ว่ามันไม่ได้เป็นเพียงการทดลอง ผลเบนช์มาร์กจัดให้อยู่ในระดับที่แข่งขันกับโมเดลแบบรวมศูนย์ที่เป็นที่ยอมรับ ซึ่งช่วยอธิบายว่าทำไมโครงการนี้จึงได้รับความสนใจจากผู้ชมที่อยู่นอกกลุ่มคริปโตโดยกำเนิด

ตลาดก็รับรู้เช่นกัน หลังการประกาศ โทเคนของโครงการ TAO ปรับขึ้น 24% นับตั้งแต่วิดีโอของ Palihapitiya และ Huang แพร่กระจายบนโซเชียลมีเดีย

Nvidia ขับเคลื่อนแผนโรงงาน AI ของ Nebius ด้วยการลงทุนมหาศาล 2 พันล้านดอลลาร์

สำรวจว่า Nvidia กำลังกำหนดอนาคตของการประมวลผลใหม่อย่างไร ด้วยการลงทุนมูลค่า 2 พันล้านดอลลาร์ในโครงสร้างพื้นฐานคลาวด์สำหรับ AI read more.

อ่านตอนนี้

Nvidia ขับเคลื่อนแผนโรงงาน AI ของ Nebius ด้วยการลงทุนมหาศาล 2 พันล้านดอลลาร์

สำรวจว่า Nvidia กำลังกำหนดอนาคตของการประมวลผลใหม่อย่างไร ด้วยการลงทุนมูลค่า 2 พันล้านดอลลาร์ในโครงสร้างพื้นฐานคลาวด์สำหรับ AI read more.

อ่านตอนนี้

Nvidia ขับเคลื่อนแผนโรงงาน AI ของ Nebius ด้วยการลงทุนมหาศาล 2 พันล้านดอลลาร์

อ่านตอนนี้สำรวจว่า Nvidia กำลังกำหนดอนาคตของการประมวลผลใหม่อย่างไร ด้วยการลงทุนมูลค่า 2 พันล้านดอลลาร์ในโครงสร้างพื้นฐานคลาวด์สำหรับ AI read more.

อย่างไรก็ตาม ความเห็นของ Huang ชี้ว่าเรื่องจริงอาจไม่ใช่ “การเข้ามาแทนที่” แต่เป็นการอยู่ร่วมกันของทั้งสองแนวทาง ระบบ AI แบบปิดที่เป็นกรรมสิทธิ์น่าจะยังครองความเป็นใหญ่สำหรับผู้ใช้ทั่วไป ขณะที่โมเดลแบบเปิดและแบบกระจายศูนย์จะค่อยๆ สร้างบทบาทในงานเฉพาะทาง งานที่ไวต่อค่าใช้จ่าย หรือการใช้งานที่ขับเคลื่อนด้วยแนวคิดเรื่องอธิปไตย

สำหรับสตาร์ตอัป ซีอีโอ Nvidia วางแนวทางเชิงปฏิบัติไว้: เริ่มจากแบบเปิดก่อน แล้วค่อยเสริมความได้เปรียบแบบกรรมสิทธิ์ “สตาร์ตอัปทุกเจ้าที่เราลงทุนในตอนนี้ เริ่มจากโอเพนซอร์สก่อน แล้วค่อยไปสู่โมเดลแบบกรรมสิทธิ์” เขากล่าว

กล่าวอีกนัยหนึ่ง อนาคตของ AI อาจไม่ได้เป็นของสถาปัตยกรรมหรือปรัชญาเพียงแบบเดียว แต่อาจเป็นของผู้ที่สามารถเดินเกมได้ทั้งสองทาง—และรู้ว่าเมื่อไรควรใช้แบบใด

คำถามที่พบบ่อย 🔎

- Bittensor’s Covenant-72B คืออะไร?

โมเดลภาษาที่มีพารามิเตอร์ 72 พันล้าน ซึ่งฝึกผ่านเครือข่ายผู้มีส่วนร่วมแบบกระจายศูนย์ โดยไม่มีโครงสร้างพื้นฐานแบบรวมศูนย์ - Jensen Huang พูดอะไรเกี่ยวกับ AI แบบกระจายศูนย์?

เขากล่าวว่าโมเดล AI แบบเปิดและแบบกรรมสิทธิ์จะอยู่ร่วมกัน โดยอธิบายความสัมพันธ์ว่าเป็น “A และ B” ไม่ใช่การต้องเลือกอย่างใดอย่างหนึ่ง - ทำไมความคืบหน้านี้จึงสำคัญ?

มันแสดงให้เห็นว่าโมเดล AI ขนาดใหญ่สามารถฝึกได้นอกศูนย์ข้อมูลแบบดั้งเดิม ซึ่งท้าทายสมมติฐานเกี่ยวกับความต้องการโครงสร้างพื้นฐาน - สิ่งนี้ส่งผลต่ออุตสาหกรรม AI อย่างไร?

มันสนับสนุนอนาคตแบบไฮบริดที่แพลตฟอร์มแบบรวมศูนย์และโมเดลแบบกระจายศูนย์จะรับบทบาทต่างกันในแต่ละอุตสาหกรรม