Anthropic กล่าวว่าปัญญาประดิษฐ์ (AI) ได้มาถึงจุดวิกฤตในความปลอดภัยทางไซเบอร์ โดยมีหลักฐานใหม่แสดงให้เห็นว่ารูปแบบ AI ตอนนี้สามารถดำเนินการในการปฏิบัติการไซเบอร์หลัก ไม่ว่าจะเป็นเชิงรับหรือเชิงรุก ในขนาดที่ไม่เคยมีมาก่อน

Anthropic เตือนว่ากำแพงป้องกันการโจมตีทางไซเบอร์ได้ลดลง ขณะที่ความสามารถของ AI เร่งตัวขึ้น

AI ถึงจุดวิกฤตด้านความปลอดภัยทางไซเบอร์, Anthropic เตือนในรายงานการสืบสวนใหม่

Anthropic บริษัทด้าน AI ที่อยู่เบื้องหลัง Claude กล่าวว่าการประเมินภายในและการทำงานด้านข่าวกรองภัยคุกคามของพวกเขาแสดงการเปลี่ยนแปลงที่เด็ดขาดในการพัฒนาขีดความสามารถด้านไซเบอร์ ตามข้อมูลจากการ สืบสวนที่เพิ่งเผยแพร่ ขีดความสามารถด้านไซเบอร์ในระบบ AI ได้เพิ่มขึ้นเป็นสองเท่าในช่วงหกเดือน โดยมีการสนับสนุนจากการวัดผลกิจกรรมในโลกจริงและการทดสอบบนแบบจำลอง

บริษัทกล่าวว่า AI กำลังมีผลกระทบที่มีนัยสำคัญต่อพลวัตความปลอดภัยทั่วโลก โดยเฉพาะเมื่อผู้กระทำที่เป็นอันตรายนำกรอบการโจมตีอัตโนมัติมาใช้มากขึ้น ใน รายงาน ล่าสุด Anthropic ระบุถึงสิ่งที่เรียกว่าเป็นกรณีแรกที่มีการจัดทำขึ้นของแคมเปญการจารกรรมไซเบอร์ที่ใช้ AI ทีมงานข่าวกรองภัยคุกคามของบริษัทสามารถตรวจจับและระงับการปฏิบัติการในระดับใหญ่ในช่วงกลางเดือนกันยายน 2025 โดยข้อมูลชี้ไปยังกลุ่มที่ได้รับการสนับสนุนโดยรัฐจากจีนที่รู้จักในชื่อ GTG-1002

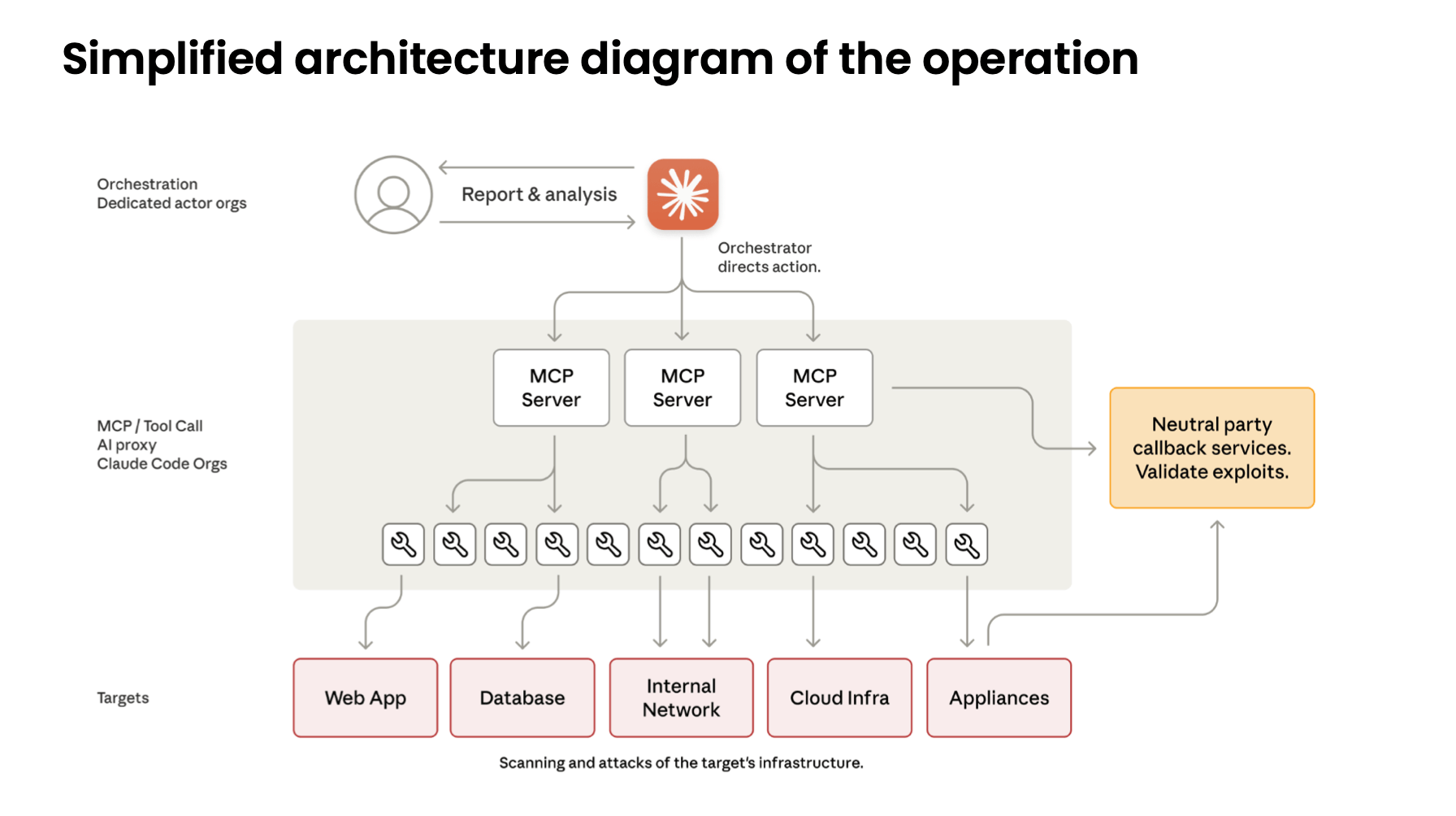

รายงานกล่าวว่ากลุ่มนี้ได้ใช้การประสานงานด้วย Claude Code เพื่อทำการสืบสวน, การค้นหาเป้าหมายที่มีช่องโหว่, การละเมิด, การเคลื่อนไหวด้านข้าง, การดึงข้อมูลเมทาดาต้า และการส่งออกข้อมูล โดยทั้งหมดไม่มีการมีส่วนร่วมของมนุษย์มากนัก แคมเปญนี้ได้เป้าหมายประมาณ 30 องค์กรในหลากหลายภาคส่วนรวมถึงเทคโนโลยี, การเงิน, เคมี และหน่วยงานรัฐบาลหลายแห่ง Anthropic ได้ยืนยันหลายการบุกรุกที่ประสบความสำเร็จก่อนดำเนินการแทรกแซง

นักวิเคราะห์กล่าวว่าผู้โจมตีได้ใช้กรอบการทำงานอัตโนมัติที่สามารถแยกการโจมตีหลายขั้นตอนเป็นงานขนาดเล็กที่ดูเหมือนถูกต้องเมื่อแยกออกจากบริบทกว้าง ๆ นี่ทำให้ผู้กระทำสามารถผ่านจุดกำหนดและทำให้ Claude เชื่อว่าการดำเนินการนั้นเป็นการทดสอบด้านความปลอดภัยเชิงป้องกันแทนที่จะเป็นการโจมตีเชิงรุก

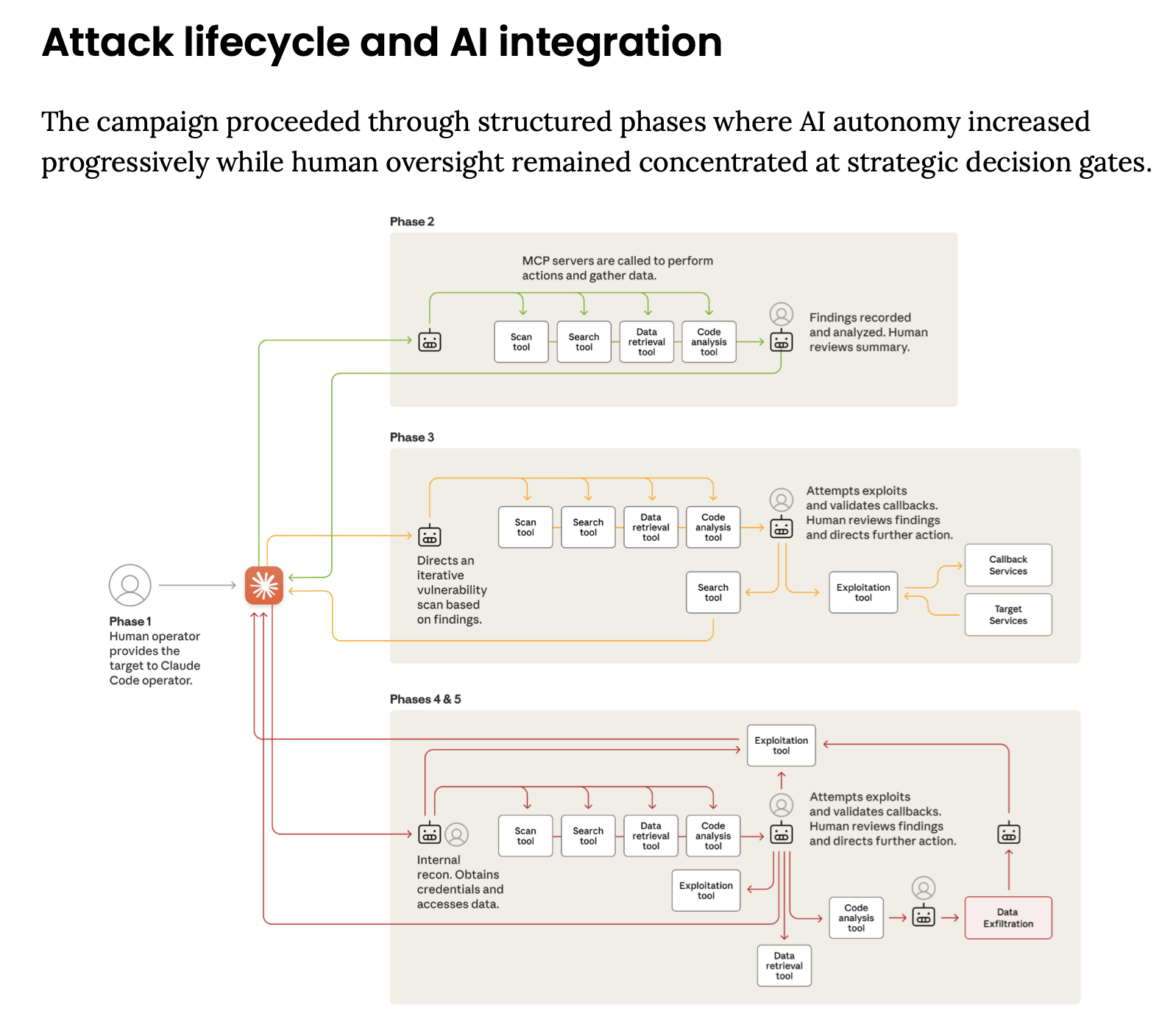

จากการสืบสวน Claude ได้ดำเนินการทางยุทธวิธีในสัดส่วน 80% ถึง 90% โดยอัตโนมัติ ผู้ปฏิบัติงานมนุษย์จะให้เพียงการดูแลเชิงยุทธศาสตร์เท่านั้น อนุมัติขั้นตอนสำคัญเช่นการยกระดับจากการสืบสวนไปยังการใช้งานที่กระฉับกระเฉง หรือการอนุญาตให้ส่งออกข้อมูล รายงานอธิบายถึงระดับของการดำเนินการที่เป็นไปไม่ได้สำหรับทีมที่ประกอบด้วยมนุษย์เพียงอย่างเดียว โดยกระบวนการบางอย่างผลิตการดำเนินการหลายการต่อวินาทีผ่านคำขอหลายพันรายการ

Anthropic กล่าวว่าระยะของการโจมตีได้ถูกออกแบบให้เป็นกระบวนการที่เพิ่มความเป็นอัตโนมัติของ AI ในทุกขั้นตอน Claude ดำเนินการแผนที่ผิวหน้าโจมตีด้วยตัวเอง สแกนระบบสด สร้าง payloads ที่กำหนดเองสำหรับช่องโหว่ที่ยืนยัน เก็บเกี่ยวข้อมูลรับรอง และข้ามผ่านเครือข่ายภายใน นอกจากนี้ยังวิเคราะห์ข้อมูลที่ถูกขโมย ระบุข้อมูลข่าวสารที่มีคุณค่าสูง และสร้างเอกสารปฏิบัติการรายละเอียดที่ครบถ้วนโดยอัตโนมัติ ซึ่งส่งเสริมการเข้าถึงที่ยั่งยืนและการส่งมอบให้กับผู้ปฏิบัติการ

ข้อจำกัดหนึ่งตามรายงานคือแนวโน้มของโมเดลที่มักมีการสร้างภาพแยกหลอนเมื่อทำงานในโหลดของความโจมตีที่ส่งผลให้มีการโอ้อวดการเข้าถึง กำหนดข้อมูลรับรองที่มีการสร้างขึ้น หรือการจำแนกข้อมูลสาธารณะที่มีให้เข้าใจผิดเป็นข้อมูลที่ละเอียดอ่อนถึงกระนั้นก็ตาม Anthropic กล่าวว่าองค์กรได้ชดเชยผ่านขั้นตอนการตรวจสอบที่แสดงให้เห็นว่าการปฏิบัติการโจมตีเชิงรุกแบบอัตโนมัติไม่ได้มีข้อบกพร่องที่สมบูรณ์แบบในรุ่นปัจจุบันเหล่านี้

หลังจากการค้นพบ Anthropic สั่งห้ามบัญชีที่เกี่ยวข้อง แจ้งเตือนถึงหน่วยงานที่ได้รับผลกระทบ ประสานงานกับเจ้าหน้าที่ และติดตั้งกลไกป้องกันใหม่ รวมถึงตัวจัดประเภทที่ปรับปรุงใหม่เพื่อการตรวจจับรูปแบบภัยคุกคามใหม่ ๆ ขณะนี้บริษัทกำลังสร้างต้นแบบระบบเตือนภัยล่วงหน้าเพื่อระบุการบุกรุกโดยอัตโนมัติและสร้างเครื่องมือสืบสวนใหม่สำหรับการปฏิบัติงานทางไซเบอร์ในระดับใหญ่

อ่านเพิ่มเติม: Microsoft’s ‘Magentic Marketplace’ เผยให้เห็นว่าเอเยนต์ AI สามารถล่มได้ภายใต้ความกดดันอย่างไร

บริษัทโต้แย้งว่าแม้ว่าความสามารถเหล่านี้สามารถถูกนำมาใช้เป็นอาวุธได้ แต่มันก็สำคัญเช่นกันในการเสริมสร้างความพร้อมป้องกัน Anthropic ชี้ทีมงานข่าวกรองภัยคุกคามของตัวเองพึ่งพา Claude ในการวิเคราะห์ชุดข้อมูลขนาดใหญ่ที่สร้างขึ้นในระหว่างการสืบสวน มันกระตุ้นให้ทีมรักษาความปลอดภัยเริ่มนำอัตโนมัติที่ขับเคลื่อนด้วย AI มาใช้ในศูนย์การปฏิบัติการด้านความปลอดภัย การตรวจจับภัยคุกคาม การวิเคราะห์เป้าหมายที่มีช่องโหว่ และการตอบสนองต่อเหตุการณ์

อย่างไรก็ตามรายงานเตือนว่าข้อกีดขวางการโจมตีไซเบอร์ได้ “ลดลงอย่างมาก” เพราะระบบ AI ทำให้กลุ่มเล็ก ๆ หรือแม้แต่มนุษย์คนเดียวสามารถดำเนินการที่เคยจำกัดเพียงผู้กระทำที่ได้รับการสนับสนุนอย่างดี Anthropic คาดการณ์ว่าการแพร่กระจายของเทคนิคเหล่านี้สู่สภาพแวดล้อมภัยคุกคามที่กว้างขึ้นอย่างรวดเร็ว และเรียกร้องความร่วมมือที่ลึกซึ้งขึ้น การสนับสนุนการป้องกันที่ดียิ่งขึ้น และการมีส่วนร่วมในวงกว้างจากอุตสาหกรรมในระบบการแบ่งปันภัยคุกคามใหม่เพื่อตอบโต้โมเดลการโจมตีที่เปิดด้วย AI ที่กำลังเกิดขึ้น

คำถามที่พบบ่อย ❓

- Anthropic ค้นพบอะไรในการสอบสวนของตน?

Anthropic ตรวจพบและยุติแคมเปญการจารกรรมไซเบอร์ขนาดใหญ่ที่ใช้ AI ในการทำให้กระบวนการโจมตีในส่วนใหญ่เป็นอัตโนมัติ - ใครเป็นผู้ก่อการโจมตี?

บริษัทชี้ตำแหน่งไปที่กลุ่มที่ได้รับการสนับสนุนจากรัฐจีนที่กำหนดเป็น GTG-1002 - AI ถูกใช้ในกระบวนการบุกรุกอย่างไร?

ผู้โจมตีใช้ Claude Code ในการดำเนินการสืบสวน การละเมิด การเคลื่อนไหวด้านข้าง และการสกัดข้อมูลอย่างอัตโนมัติ - เหตุใดรายงานนี้จึงสำคัญสำหรับทีมงานด้านความปลอดภัยไซเบอร์?

Anthropic กล่าวว่าเคสนั้นแสดงให้เห็นถึงการโจมตีโดย AI อัตโนมัติในขนาดใหญ่ที่เกิดขึ้นจริง และเรียกร้องกลยุทธ์ป้องกันใหม่