Anthropic ได้ดำเนินการที่ไม่ธรรมดาด้วยการฟ้องร้องรัฐบาลสหรัฐฯ หลังจากเพนตากอนระบุว่าบริษัทปัญญาประดิษฐ์ (AI) แห่งนี้เป็น “ความเสี่ยงต่อห่วงโซ่อุปทานด้านความมั่นคงของชาติ” จุดชนวนความขัดแย้งทางกฎหมายที่อาจปรับเปลี่ยนวิธีที่วอชิงตันควบคุมผู้จำหน่ายปัญญาประดิษฐ์ที่ทำงานกับกองทัพ

Anthropic ของ Dario Amodei ฟ้องรัฐบาลสหรัฐฯ โดยระบุว่าเพนตากอนตอบโต้เพราะมาตรการคุ้มกันด้านความปลอดภัยของ AI

Anthropic เปิดศึกกับกระทรวงกลาโหมในคดีความ AI ครั้งประวัติศาสตร์

ตาม รายงานหลายฉบับ ระบุว่า Anthropic ได้ยื่นฟ้องสองคดีเมื่อวันที่ 9 มีนาคมต่อศาลรัฐบาลกลาง เพื่อคัดค้านการดำเนินการของกระทรวงกลาโหมสหรัฐฯ และรัฐบาลทรัมป์ โดยโต้แย้งว่ารัฐบาลได้ ตอบโต้ ต่อบริษัทอย่างมิชอบด้วยกฎหมาย หลังจากบริษัทปฏิเสธที่จะถอดมาตรการป้องกันออกจากระบบปัญญาประดิษฐ์ Claude ของตน คดีดังกล่าวมุ่งเป้าไปที่การจัดประเภทซึ่งโดยปกติใช้กับฝ่ายตรงข้ามต่างชาติที่ต้องสงสัยว่าจารกรรมหรือก่อวินาศกรรม ไม่ใช่บริษัทเทคโนโลยีภายในประเทศ

ข้อพิพาทย้อนกลับไปที่การเจรจาสัญญาระหว่าง Anthropic กับเพนตากอนเกี่ยวกับวิธีที่โมเดล AI Claude ของบริษัทจะถูกใช้โดย หน่วยงานด้านกลาโหมของสหรัฐฯ ก่อนหน้านี้ Anthropic สนับสนุนโครงการริเริ่มด้านความมั่นคงของชาติ และกลายเป็นบริษัท AI แนวหน้า (frontier AI) รายแรกที่นำโมเดลไปใช้งานบนเครือข่ายรัฐบาลสหรัฐฯ ที่เป็นความลับในเดือนมิถุนายน 2024 เพื่อช่วยนักวิเคราะห์และผู้วางแผนทางทหารในการทบทวนข่าวกรอง การจำลอง การวางแผนปฏิบัติการ และงานด้านความมั่นคงไซเบอร์

ความตึงเครียดทวีขึ้นเมื่อกระทรวงกลาโหมเรียกร้องให้เข้าถึง Claude แบบไร้ข้อจำกัดเพื่อ “วัตถุประสงค์ที่ชอบด้วยกฎหมายทั้งหมด” เป็นส่วนหนึ่งของการต่ออายุสัญญา Anthropic ยอมรับเงื่อนไขส่วนใหญ่ แต่ยืนกราน ข้อจำกัดสองประการ: ห้ามใช้ AI ของตนเพื่อการเฝ้าระวังภายในประเทศแบบมวลชนต่อชาวอเมริกัน และป้องกันการนำไปใช้ในระบบอาวุธสังหารที่เป็นอัตโนมัติเต็มรูปแบบ

ผู้บริหารบริษัทโต้แย้งว่าแนวป้องกันเหล่านั้นจำเป็น เพราะโมเดล AI แนวหน้าปัจจุบันยังไม่น่าเชื่อถือพอสำหรับอาวุธอัตโนมัติ และเพราะโครงการเฝ้าระวังขนาดใหญ่อาจขัดแย้งกับการคุ้มครองตามรัฐธรรมนูญ Anthropic ระบุว่าข้อจำกัดดังกล่าวไม่เคยขัดขวางภารกิจทางทหารใดๆ ระหว่างการทำงานกับรัฐบาลก่อนหน้านี้

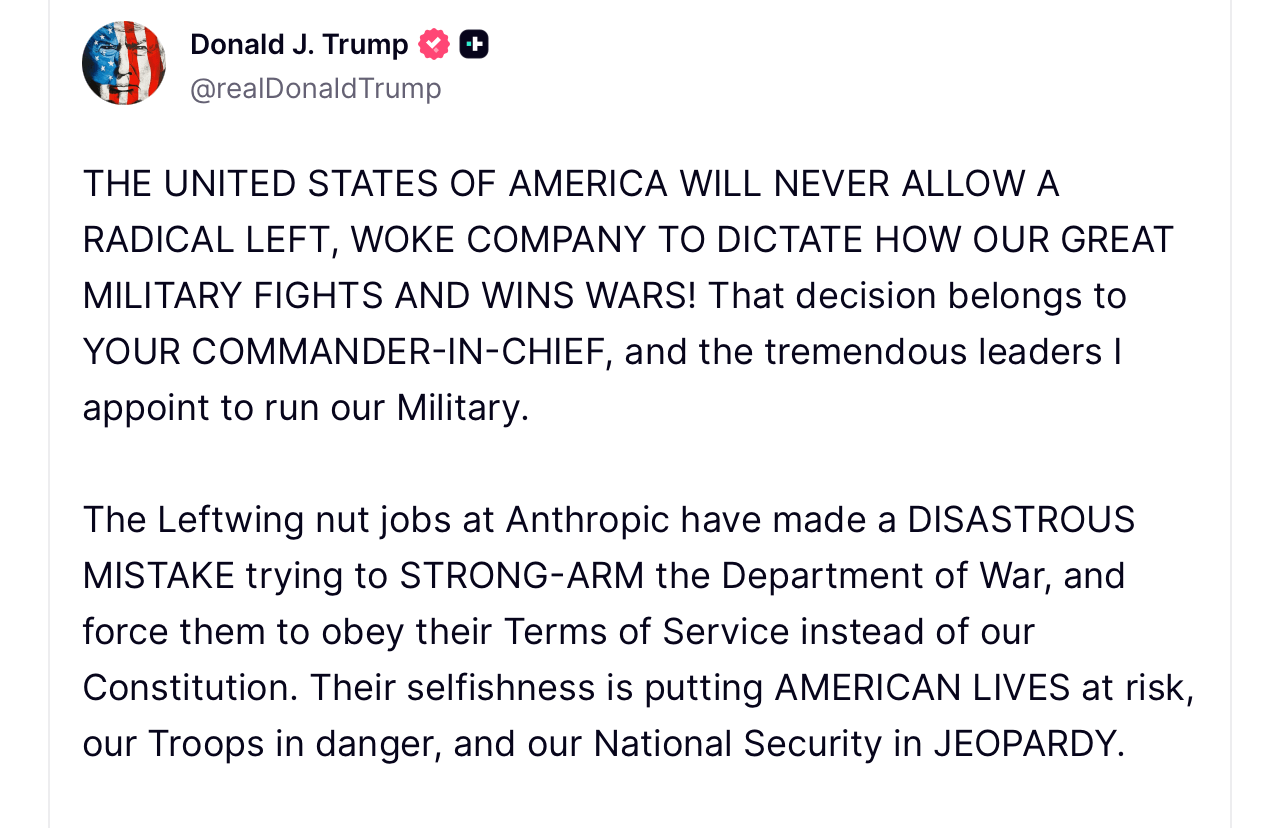

การเจรจาล่มลงหลังการประชุมวันที่ 24 ก.พ. ระหว่างซีอีโอ Anthropic ดาริโอ อาโมเดอี (Dario Amodei) และรัฐมนตรีว่าการกระทรวงกลาโหม พีท เฮกเซธ ไม่กี่วันต่อมา วันที่ 27 ก.พ. ประธานาธิบดีโดนัลด์ ทรัมป์โพสต์บน Truth Social สั่งการให้หน่วยงานรัฐบาลกลาง “ยุติทันที” การใช้เทคโนโลยีของ Anthropic โดยระบุว่าการพึ่งพาบริษัทต่อไปเป็น “ความผิดพลาดที่หายนะ”

ไม่นานหลังจากนั้น เฮกเซธได้ดำเนินการจัดประเภท Anthropic เป็นความเสี่ยงต่อห่วงโซ่อุปทาน ภายใต้อำนาจการจัดซื้อจัดจ้างของรัฐบาลกลางที่ระบุไว้ใน 10 U.S.C. § 3252 การจัดประเภทดังกล่าว ซึ่งยืนยันในจดหมายที่ส่งถึงบริษัทราววันที่ 4 มีนาคม จำกัดไม่ให้ผู้รับเหมาของรัฐบาลบางรายใช้เทคโนโลยีที่ถูกมองว่าเสี่ยงต่อการก่อวินาศกรรมหรืออิทธิพลจากต่างชาติ

Anthropic โต้แย้งว่าการดำเนินการดังกล่าวเป็นการขยายความกฎหมายเกินกว่าจุดประสงค์ที่ตั้งใจไว้มาก ในเอกสารที่ยื่นต่อศาล บริษัทระบุว่าการจัดประเภทนั้นถูกออกแบบมาเพื่อรับมือภัยคุกคามด้านความมั่นคงที่เชื่อมโยงต่างชาติ ไม่ใช่ความเห็นต่างเชิงนโยบายกับซัพพลายเออร์ภายในประเทศ คำฟ้องกล่าวว่ารัฐบาลไม่ได้ใช้ “มาตรการที่จำกัดน้อยที่สุด” ตามที่กฎหมายกำหนด แต่กลับกำหนดสิ่งที่บริษัทเรียกว่าเป็นบัญชีดำที่ไม่เป็นทางการ

เอกสารทางกฎหมายยังหยิบยกความกังวลด้านรัฐธรรมนูญด้วย Anthropic โต้แย้งว่าการจัดประเภทดังกล่าวละเมิดการแก้ไขเพิ่มเติมรัฐธรรมนูญฉบับที่หนึ่ง (First Amendment) ด้วยการลงโทษบริษัทจากการสนับสนุนต่อสาธารณะให้มีข้อจำกัดในการใช้ AI เช่น อาวุธอัตโนมัติและการเฝ้าระวังภายในประเทศ ตามคำร้อง การติดป้ายว่าบริษัทเป็นความเสี่ยงต่อความมั่นคงของชาติทำลายชื่อเสียง และอาจคุกคามสัญญามูลค่าหลายร้อยล้านดอลลาร์

Anthropic ขอให้ศาลสั่งระงับการบังคับใช้การจัดประเภทดังกล่าว สั่งให้หน่วยงานรัฐบาลกลางถอนคำสั่งที่ให้หยุดทำธุรกิจกับบริษัท และป้องกันไม่ให้เกิดการดำเนินการลักษณะเดียวกันในอนาคต บริษัทกล่าวว่าเป้าหมายของตนไม่ใช่การบังคับให้รัฐบาลซื้อเทคโนโลยีของตน แต่เพื่อป้องกันการตอบโต้จากความเห็นต่างด้านนโยบาย

“การขอให้มีการพิจารณาทบทวนโดยศาลไม่ได้เปลี่ยนแปลงความมุ่งมั่นที่เรายึดถือมาโดยตลอดในการนำ AI มาใช้เพื่อปกป้องความมั่นคงของชาติของเรา” โฆษกของ Anthropic กล่าว ในแถลงการณ์ “แต่การดำเนินการนี้เป็นขั้นตอนที่จำเป็นเพื่อปกป้องธุรกิจของเรา ลูกค้าของเรา และพันธมิตรของเรา”

เจ้าหน้าที่เพนตากอนไม่ได้แสดงความคิดเห็นต่อสาธารณะเกี่ยวกับคดี โดยอ้างนโยบายเกี่ยวกับคดีที่อยู่ระหว่างการพิจารณาของศาล ผู้นำด้านกลาโหมบางรายเคยโต้แย้งว่า หน่วยงานทหารต้องคงอำนาจการปฏิบัติการเต็มรูปแบบเหนือเทคโนโลยีของผู้รับเหมาในยามฉุกเฉิน และไม่สามารถปล่อยให้ผู้ขายเป็นผู้กำหนดวิธีการใช้งานระบบได้

สุดสัปดาห์สุดเดือดของ AI: ความปั่นป่วนใน OpenAI, การปะทะกับเพนตากอน และหุ่นยนต์ที่ไม่ยอมตาย

การเปลี่ยนแปลงครั้งใหญ่ของ AI มาเร็ว: ดราม่า OpenAI, การปะทะของเพนตากอนกับ Anthropic, เปิดตัว GPT-5.4, หุ่นยนต์ซ่อมแซมตัวเองได้ และเครื่องมือความปลอดภัยใหม่ๆ read more.

อ่านตอนนี้

สุดสัปดาห์สุดเดือดของ AI: ความปั่นป่วนใน OpenAI, การปะทะกับเพนตากอน และหุ่นยนต์ที่ไม่ยอมตาย

การเปลี่ยนแปลงครั้งใหญ่ของ AI มาเร็ว: ดราม่า OpenAI, การปะทะของเพนตากอนกับ Anthropic, เปิดตัว GPT-5.4, หุ่นยนต์ซ่อมแซมตัวเองได้ และเครื่องมือความปลอดภัยใหม่ๆ read more.

อ่านตอนนี้

สุดสัปดาห์สุดเดือดของ AI: ความปั่นป่วนใน OpenAI, การปะทะกับเพนตากอน และหุ่นยนต์ที่ไม่ยอมตาย

อ่านตอนนี้การเปลี่ยนแปลงครั้งใหญ่ของ AI มาเร็ว: ดราม่า OpenAI, การปะทะของเพนตากอนกับ Anthropic, เปิดตัว GPT-5.4, หุ่นยนต์ซ่อมแซมตัวเองได้ และเครื่องมือความปลอดภัยใหม่ๆ read more.

ข้อพิพาทนี้เกิดขึ้นท่ามกลางการแข่งขันเพื่อคว้าสัญญา AI ทางทหารที่เข้มข้นขึ้น บริษัทคู่แข่ง รวมถึง OpenAI ได้บรรลุข้อตกลงกับเพนตากอนในช่วงเวลาใกล้เคียงกับที่การเจรจาของ Anthropic ล่มลง ขณะเดียวกัน พันธมิตรเทคโนโลยีรายใหญ่ เช่น Google และ Microsoft ระบุว่าตั้งใจจะทำงานร่วมกับ Anthropic ต่อไปในบริการเชิงพาณิชย์ที่ไม่เกี่ยวข้องกับกลาโหม

นักวิเคราะห์อุตสาหกรรมกล่าวว่า ผลของคดีอาจสร้างบรรทัดฐานว่า รัฐบาลกลางกดดันบริษัท AI ให้ปรับนโยบายความปลอดภัยอย่างไรเมื่อมีผลประโยชน์ด้านความมั่นคงของชาติเข้ามาเกี่ยวข้อง สำหรับตอนนี้ ผลิตภัณฑ์สำหรับผู้บริโภคและบริการ AI เชิงพาณิชย์ของ Anthropic ยังคงใช้งานได้ ขณะที่การต่อสู้ทางกฎหมายเกี่ยวกับการจัดประเภทของเพนตากอนเริ่มดำเนินไปในกระบวนการศาล

คำถามที่พบบ่อย 🧭

- ทำไม Anthropic ถึงฟ้องรัฐบาลสหรัฐฯ?

Anthropic ยื่นฟ้องโดยอ้างว่าเพนตากอนติดป้ายบริษัทอย่างมิชอบด้วยกฎหมายว่าเป็นความเสี่ยงต่อห่วงโซ่อุปทานด้านความมั่นคงของชาติ หลังจากบริษัทปฏิเสธที่จะลบข้อจำกัดด้านความปลอดภัยของ AI ออก - อะไรเป็นชนวนข้อพิพาทระหว่าง Anthropic กับเพนตากอน?

ความขัดแย้งเริ่มต้นระหว่างการเจรจาสัญญาเมื่อกระทรวงกลาโหมเรียกร้องให้ใช้ระบบ AI Claude ของ Anthropic ได้โดยไม่มีข้อจำกัด - การจัดประเภท “ความเสี่ยงต่อห่วงโซ่อุปทาน” หมายความว่าอย่างไร?

ป้ายกำกับนี้สามารถจำกัดไม่ให้ผู้รับเหมาของรัฐบาลใช้เทคโนโลยีของบริษัทได้ หากเจ้าหน้าที่เชื่อว่าเทคโนโลยีนั้นก่อให้เกิดความเสี่ยงด้านความมั่นคงหรือความเสี่ยงในการจัดซื้อจัดจ้าง - บริการ AI ของ Anthropic จะยังดำเนินต่อไปในระหว่างคดีหรือไม่?

ใช่ ผลิตภัณฑ์ AI เชิงพาณิชย์และบริการสำหรับผู้บริโภคของ Anthropic ยังคงพร้อมใช้งาน ขณะที่คดีกฎหมายดำเนินต่อไป