Försvarsminister Pete Hegseth träffade Anthropics vd Dario Amodei i Pentagon på tisdagen, samtidigt som försvarsdepartementet pressade Anthropic att ta bort begränsningar i sitt artificiella intelligenssystem (AI) Claude – eller riskera möjliga påföljder.

Rapport: Anthropics Claude AI står inför en osäker framtid i Pentagons hemligstämplade system

Militär AI-styrning sätts på prov i högriskmöte i Pentagon

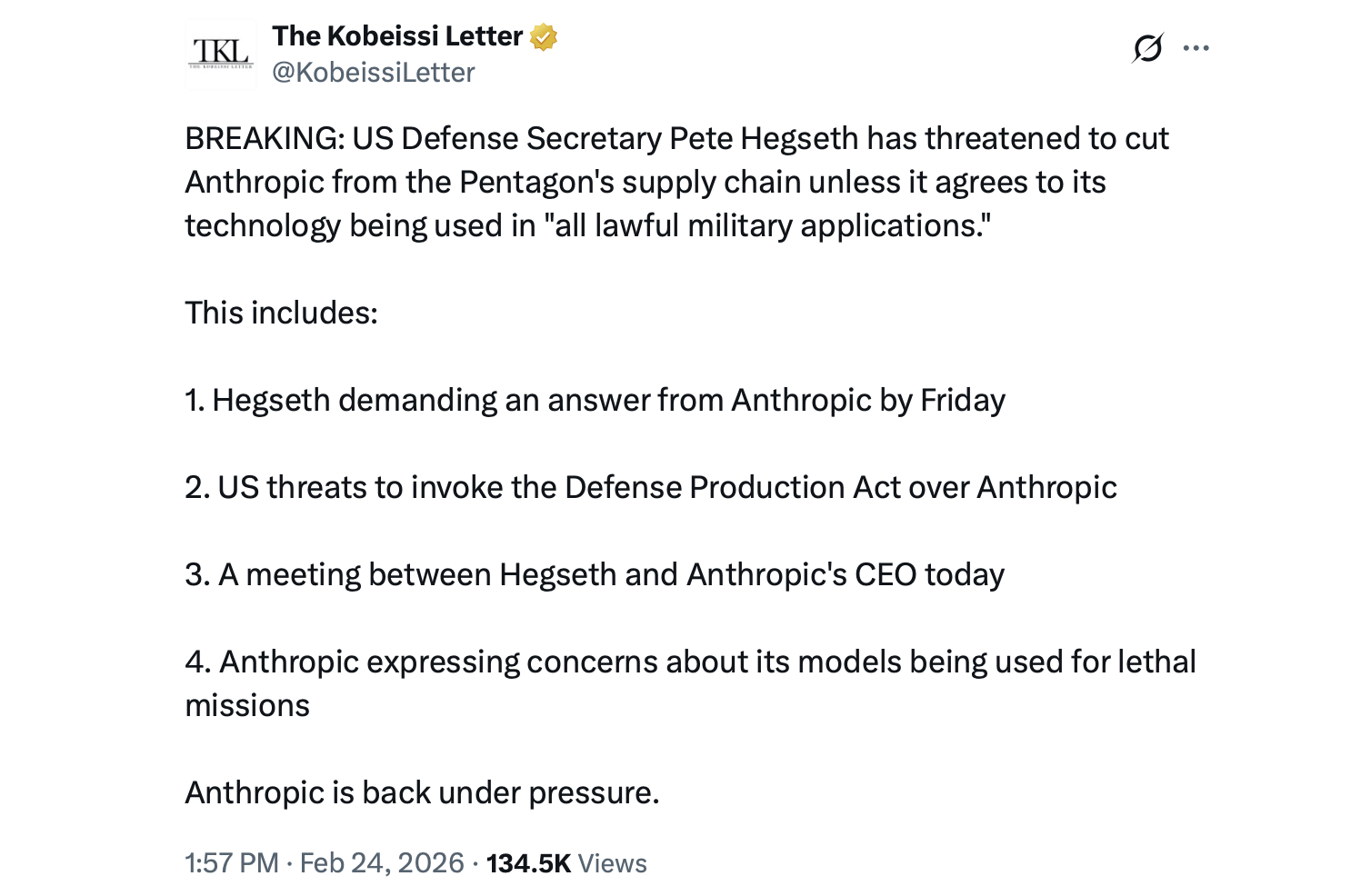

Mötet den 24 feb. följde veckor av spänningar kring Anthropics användningspolicyer för Claude, den stora språkmodellen som integrerats i hemligstämplade försvarsdepartementsnätverk under ett pilotkontrakt för 2025 värt upp till 200 miljoner dollar. Claude är för närvarande den enda fullt auktoriserade stora språkmodellen som används i vissa säkra Pentagon-system.

Enligt Axios rapportering invände Hegseth, tillsammans med biträdande försvarsminister Steve Feinberg och chefsjuristen Earl Matthews, mot Anthropics begränsningar för massövervakning av amerikaner och för helt autonoma vapensystem som fungerar utan mänsklig tillsyn. Försvarstjänstemän argumenterade för att dessa gränser begränsar lagliga militära tillämpningar och inte bör övertrumfa kongressens och den verkställande maktens befogenheter.

Anthropic har hävdat att dess skyddsåtgärder är utformade för att förhindra missbruk samtidigt som de fortfarande möjliggör nationella säkerhetstillämpningar. Företaget säger att dess policyer inte blockerar legitim militär användning, men förbjuder aktiviteter som att spåra individer utan samtycke eller att driftsätta dödliga system utan mänsklig kontroll.

”Enligt en källa med insyn i samtalen har Anthropic aldrig invänt mot användningen av sina modeller för ’legitima militära operationer’”, rapporterade Fox News chefsreporter för nationell säkerhet Jennifer Griffin på X. ”Det sade också till Hegseth att det aldrig klagat till Pentagon eller Palantir på användningen av dess modeller i Maduro-raiden.”

Claude har använts för underrättelseanalys, cyberförsvar och operativ planering. Uppgifter visar att det stödde planering och realtidsanalys under operationen den 3 jan. som ledde till tillfångatagandet av Venezuelas president Nicolás Maduro. Anthropic sökte senare klarlägganden om modellens inblandning som en del av en intern efterlevnadsgranskning, vilket Pentagon-tjänstemän tolkade som kritik.

Den 9 jan. utfärdade Hegseth ett PM där han uppmanade leverantörer av artificiell intelligens (AI) att ta bort vad han beskrev som restriktiva villkor. Det direktivet banade väg för omförhandlingar och i slutändan mötet den 24 feb.

Pentagon har satt en deadline till den 27 feb. för Anthropic att ändra sina villkor. Möjliga åtgärder inkluderar att åberopa Defense Production Act för att tvinga fram efterlevnad eller att klassificera Anthropic som en risk i leveranskedjan, ett steg som kan kräva att entreprenörer avyttrar från Claude-relaterade system.

Tjänstemän medger att det skulle vara operativt komplext att koppla loss Claude från befintlig infrastruktur. Ändå har departementet alternativ. Konkurrenter som xAI med sin Grok-modell, OpenAI med ChatGPT, och Google med Gemini har liknande kontrakt med försvarsdepartementet och kan vara positionerade att utöka sina roller om samtalen går i stå.

Tvisten belyser bredare frågor om AI-styrning i militära miljöer, särskilt när federal lagstiftning fortsätter att utvecklas kring framväxande teknologier. På spel står huruvida privata AI-utvecklare kan upprätthålla oberoende etiska policyer när deras system blir inbäddade i nationella säkerhetsoperationer.

Reaktionerna på sociala medieplattformar har varit anmärkningsvärt frispråkiga. ”Övervakning utan domstolsbeslut är tillbaka”, skrev en X-användare som svar på Griffins X-inlägg. ”Det här behöver vara mycket större nyhet än vad det är. Det finns en allvarlig risk för konstitutionella överträdelser”, svarade en annan på Griffins genomgång. Andra, med en dos svart humor, skämtade om att Skynets ankomst kanske inte är långt borta. ”Skynet är här… tidslinjen 2029 är LIVE”, kommenterade personen.

Båda sidor har beskrivit diskussionen den 24 feb. som substantiell. Huruvida Anthropic justerar sina skyddsåtgärder före deadline kan avgöra framtiden för en av Pentagons mest avancerade AI-integrationer.

FAQ 🤖

- Vad diskuterades vid Pentagon-mötet den 24 feb.?

Mötet fokuserade på Anthropics begränsningar för Claude AI och huruvida de begränsar lagliga militära tillämpningar. - Varför pressar Pentagon Anthropic?

Försvarstjänstemän menar att företagets skyddsåtgärder stör auktoriserad användning för nationell säkerhet. - Vad kan hända om Anthropic inte följer kraven?

Pentagon kan åberopa Defense Production Act eller klassificera företaget som en risk i leveranskedjan. - Finns det alternativ till Claude?

Ja, modeller från xAI, OpenAI och Google omfattas av försvarsdepartementets kontrakt och kan expandera vid behov.