Anthropic har tagit det extraordinära steget att stämma den amerikanska regeringen efter att Pentagon stämplat AI‑bolaget som en ”risk i leveranskedjan för den nationella säkerheten”, vilket har utlöst en juridisk konflikt som kan omforma hur Washington kontrollerar leverantörer av artificiell intelligens som arbetar med militären.

Dario Amodeis Anthropic stämmer USA:s regering och säger att Pentagon hämnades på grund av skyddsräcken för AI-säkerhet

Anthropic tar strid mot försvarsdepartementet i en banbrytande AI-stämning

Enligt flera rapporter lämnade Anthropic in två stämningar den 9 mars i federal domstol där bolaget ifrågasätter åtgärder vidtagna av USA:s försvarsdepartement och Trumpadministrationen, och hävdar att regeringen olagligen hämnades på företaget efter att det vägrat ta bort skyddsräcken från sitt Claude-system för artificiell intelligens. Stämningarna riktar in sig på en klassificering som vanligtvis gäller utländska motståndare som misstänks för spionage eller sabotage, inte inhemska teknikföretag.

Tvisten kan spåras tillbaka till kontraktsförhandlingar mellan Anthropic och Pentagon om hur företagets Claude AI‑modell skulle kunna användas av amerikanska försvarsmyndigheter. Anthropic hade tidigare stött initiativ för nationell säkerhet och blev det första ledande AI‑företaget att driftsätta modeller på hemligstämplade amerikanska myndighetsnätverk i juni 2024, där man hjälpte analytiker och militära planerare med underrättelsegranskning, simuleringar, operativ planering och cybersäkerhetsarbete.

Spänningarna ökade när försvarsdepartementet krävde obegränsad åtkomst till Claude för ”alla lagliga ändamål” som en del av en kontraktsförnyelse. Anthropic gick med på de flesta villkor men insisterade på två begränsningar: att förbjuda användning av bolagets AI för omfattande inhemsk massövervakning av amerikaner och att förhindra driftsättning i helt autonoma dödliga vapensystem.

Företagets ledning hävdade att dessa skyddsräcken var nödvändiga eftersom dagens ledande AI‑modeller fortfarande är för opålitliga för autonoma vapen och eftersom storskaliga övervakningsprogram kan stå i konflikt med konstitutionella skydd. Anthropic uppgav att begränsningarna aldrig hade stört något militärt uppdrag under bolagets tidigare arbete med regeringen.

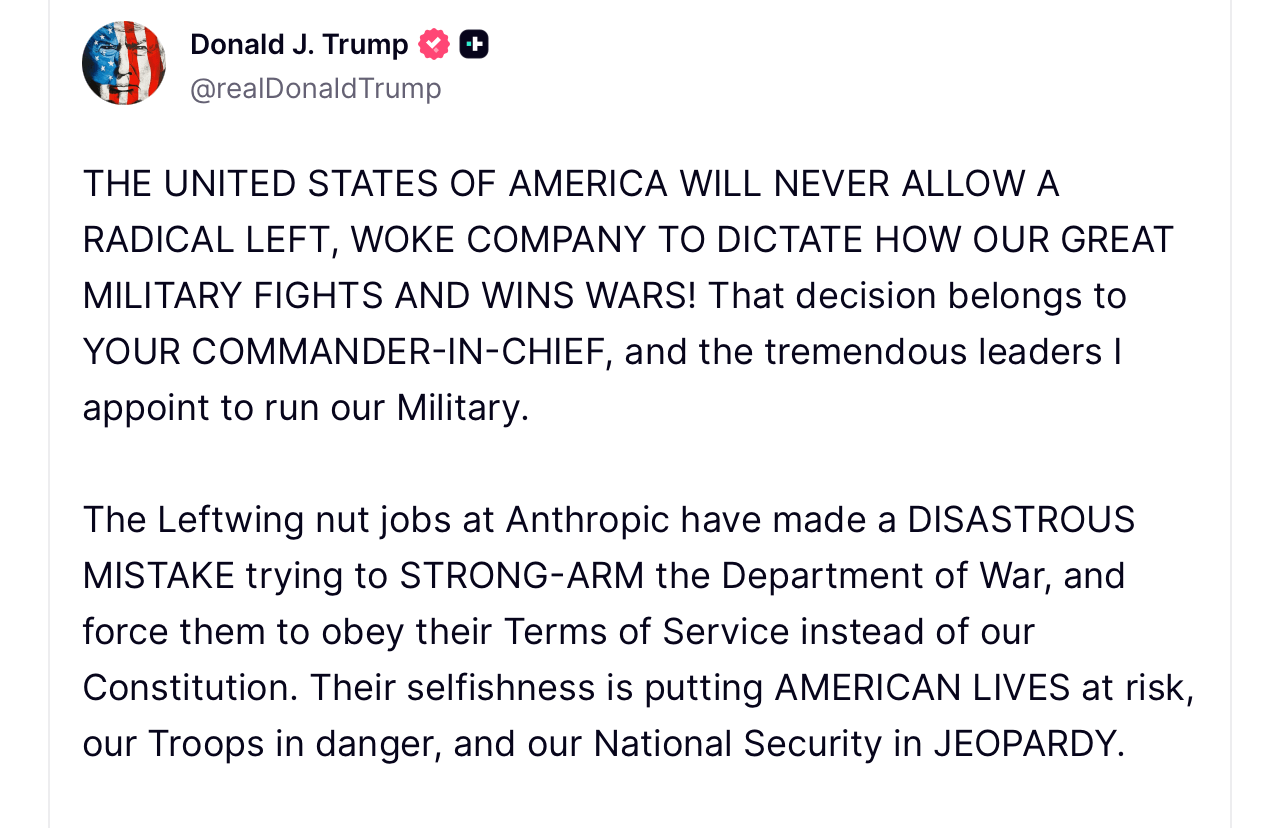

Förhandlingarna bröt samman efter ett möte den 24 februari mellan Anthropics vd Dario Amodei och försvarsminister Pete Hegseth. Några dagar senare, den 27 februari, publicerade president Donald Trump ett inlägg på Truth Social där han uppmanade federala myndigheter att ”omedelbart upphöra” med att använda Anthropic‑teknik och beskrev fortsatt beroende av bolaget som ett ”katastrofalt misstag”.

Kort därefter agerade Hegseth för att klassificera Anthropic som en risk i leveranskedjan enligt federal upphandlingsbefogenhet som beskrivs i 10 U.S.C. § 3252. Klassificeringen, bekräftad i ett brev som skickades till företaget omkring den 4 mars, begränsar vissa statliga entreprenörer från att använda teknik som anses sårbar för sabotage eller utländsk påverkan.

Anthropic menar att åtgärden tänjer på lagen långt bortom dess avsedda syfte. I domstolsinlagor hävdar bolaget att klassificeringen var avsedd för säkerhetshot med utländska kopplingar snarare än policyoenigheter med inhemska leverantörer. Stämningarna påstår att regeringen inte använde de ”minst restriktiva medlen” som krävs enligt lag och i stället införde vad företaget beskriver som en informell svartlistning.

De juridiska inlagorna tar också upp konstitutionella frågor. Anthropic hävdar att klassificeringen bryter mot första tillägget genom att bestraffa bolaget för att offentligt ha förespråkat begränsningar för AI‑användningar som autonoma vapen och inhemsk övervakning. Enligt stämningsansökan skadar etiketteringen av företaget som en nationell säkerhetsrisk dess anseende och kan hota kontrakt värda hundratals miljoner dollar.

Anthropic ber domstolarna att stoppa verkställigheten av klassificeringen, beordra federala myndigheter att dra tillbaka direktiv som stoppar affärer med bolaget och förhindra liknande åtgärder i framtiden. Företaget säger att dess mål inte är att tvinga regeringen att köpa dess teknik, utan att förhindra repressalier på grund av policyskillnader.

”Att begära domstolsprövning förändrar inte vårt långvariga åtagande att använda AI för att skydda vår nationella säkerhet”, sade en talesperson för Anthropic i ett uttalande. ”Men detta är ett nödvändigt steg för att skydda vår verksamhet, våra kunder och våra partners.”

Pentagonföreträdare har inte kommenterat rättsprocessen offentligt och hänvisar till policy kring pågående domstolsärenden. Vissa försvarsledare har tidigare hävdat att militära myndigheter måste behålla full operativ kontroll över entreprenörers teknik under nödsituationer och inte kan tillåta leverantörer att diktera hur systemen används.

AI:s vilda helg: OpenAI-omvälvning, konflikt med Pentagon och robotar som vägrar att dö

AI-omvälvningar slår till snabbt: OpenAI-drama, Pentagon-krock med Anthropic, lansering av GPT-5.4, självläkande robotar och nya säkerhetsverktyg. read more.

Läs nu

AI:s vilda helg: OpenAI-omvälvning, konflikt med Pentagon och robotar som vägrar att dö

AI-omvälvningar slår till snabbt: OpenAI-drama, Pentagon-krock med Anthropic, lansering av GPT-5.4, självläkande robotar och nya säkerhetsverktyg. read more.

Läs nu

AI:s vilda helg: OpenAI-omvälvning, konflikt med Pentagon och robotar som vägrar att dö

Läs nuAI-omvälvningar slår till snabbt: OpenAI-drama, Pentagon-krock med Anthropic, lansering av GPT-5.4, självläkande robotar och nya säkerhetsverktyg. read more.

Tvisten kommer samtidigt som kapplöpningen om att säkra militära AI‑kontrakt intensifieras. Rivaliserande företag, däribland OpenAI, nådde överenskommelser med Pentagon ungefär samtidigt som Anthropics förhandlingar bröt samman. Under tiden har stora teknikpartners som Google och Microsoft indikerat att de avser att fortsätta arbeta med Anthropic kring kommersiella tjänster som inte är kopplade till försvar.

Branschanalytiker säger att utgången i fallet kan skapa ett prejudikat för hur den federala regeringen pressar AI‑bolag att ändra säkerhetspolicyer när nationella säkerhetsintressen är inblandade. För närvarande är Anthropics konsumentprodukter och kommersiella AI‑tjänster fortsatt tillgängliga, medan den juridiska striden om Pentagons klassificering börjar ta sig genom domstolarna.

FAQ 🧭

- Varför stämde Anthropic den amerikanska regeringen?

Anthropic lämnade in stämningar och hävdar att Pentagon olagligen stämplade företaget som en risk i leveranskedjan för nationell säkerhet efter att det vägrat ta bort AI‑säkerhetsbegränsningar. - Vad utlöste tvisten mellan Anthropic och Pentagon?

Konflikten började under kontraktsförhandlingar när försvarsdepartementet krävde obegränsad användning av Anthropics Claude AI‑system. - Vad innebär klassificeringen ”risk i leveranskedjan”?

Etiketten kan begränsa statliga entreprenörer från att använda ett företags teknik om tjänstemän anser att den innebär säkerhets- eller upphandlingsrisker. - Kommer Anthropics AI‑tjänster fortfarande att fungera under stämningen?

Ja, Anthropics kommersiella AI‑produkter och konsumenttjänster förblir tillgängliga medan rättsprocessen fortskrider.