Ett decentraliserat AI-experiment som tidigare var begränsat till kryptovärlden har nu fått ett offentligt erkännande från Nvidias vd Jensen Huang, vilket tyder på att distribuerad modellträning kanske börjar närma sig mainstream.

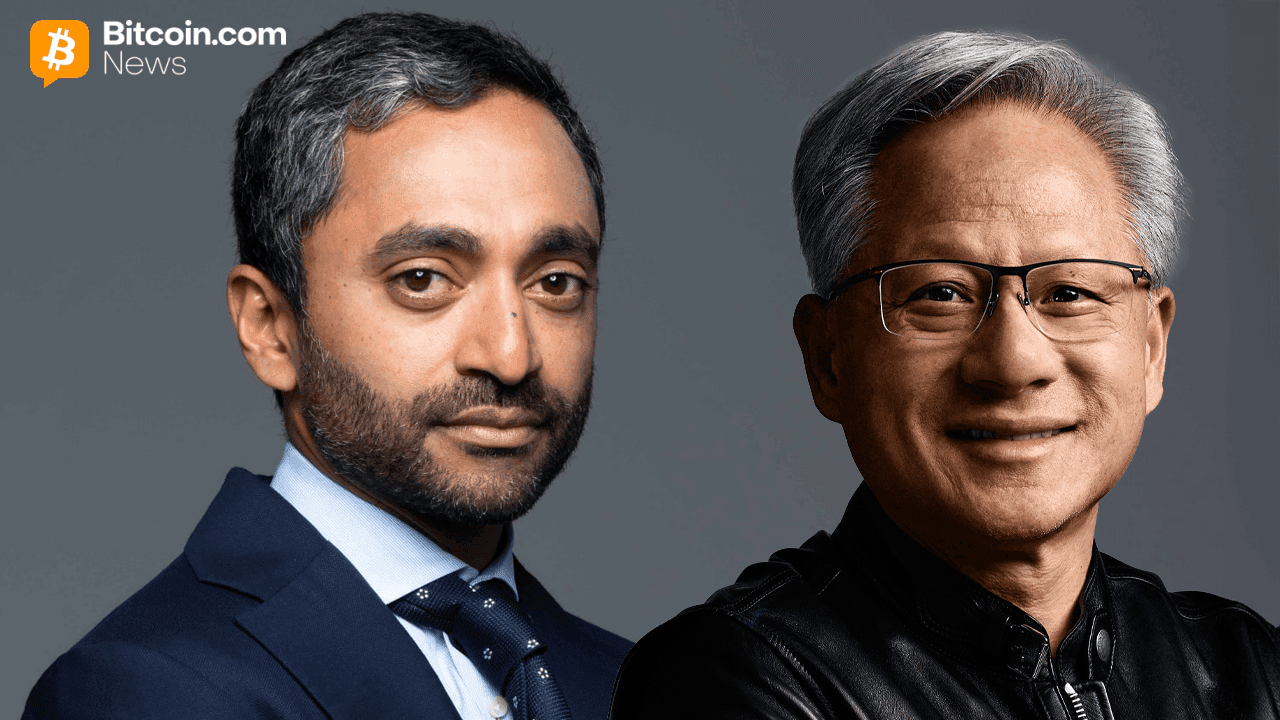

Bittensors milstolpe inom utbildning väcker uppmärksamhet hos Chamath Palihapitiya och Nvidias vd Jensen Huang

Öppen källkods-AI får fart med stöd från Nvidias VD

Chamath Palihapitiya lyfte fram Bittensors Covenant-72B under ett avsnitt av All-In Podcast och beskrev det som ett konkret exempel på decentraliserad artificiell intelligens (AI) som går bortom teorin. Bittensor fungerar som ett decentraliserat, blockkedjedrivet nätverk som etablerar en peer-to-peer-marknadsplats där maskininlärningsmodeller och AI-beräkningar utbyts och belönas.

Palihapitiya beskrev satsningen i enkla termer: en storskalig språkmodell (LLM) som tränats utan centraliserad infrastruktur, utan istället drivs av ett nätverk av oberoende bidragsgivare. ”De lyckades träna en LLaMA-modell med 4 miljarder parametrar, helt distribuerad, med en massa människor som bidrog med överskottsberäkningskraft”, sa han och kallade det ”en ganska galen teknisk bedrift”.

Jämförelsen landade i en välbekant analogi. ”Det finns slumpmässiga människor, och varje person får en liten andel”, tillade Palihapitiya, med hänvisning till det tidiga distribuerade dataprojektet som utnyttjade ledig hårdvara över hela världen.

Huang avfärdade inte idén. Istället lutade han sig mot en bredare ram för AI-marknaden och föreslog att decentraliserade och proprietära tillvägagångssätt inte utesluter varandra. ”Dessa två saker är inte A eller B; det är A och B”, sa Huang. ”Det råder ingen tvekan om det.”

Denna vision med två spår återspeglar en växande klyfta – och överlappning – inom AI. Å ena sidan finns slutna, högpolerade system som ChatGPT, Claude och Gemini. Å andra sidan finns öppna och decentraliserade modeller som gör det möjligt för utvecklare och organisationer att anpassa systemen efter specifika behov.

Huang gjorde klart att han ser båda spåren som väsentliga. ”Modeller är en teknik, inte en produkt”, sade han och noterade att de flesta användare kommer att fortsätta förlita sig på polerade, allmänna system snarare än att bygga sina egna från grunden.

Samtidigt pekade han på branscher där anpassning inte är valfritt. ”Det finns alla dessa branscher där deras domänexpertis… måste fångas upp på ett sätt som de kan kontrollera”, förklarade Huang och tillade att ”det kan bara komma från öppna modeller.”

Det uttalandet passar perfekt in i Bittensors verksamhet. Covenant-72B, utvecklat genom Subnet 3 (Templar), representerar en av de största decentraliserade träningskörningarna hittills, där mer än 70 bidragsgivare samordnas via vanliga internetanslutningar utan någon central myndighet.

Tekniskt sett tänjer modellen på gränserna. Den är byggd med 72 miljarder parametrar och tränad på ungefär 1,1 biljoner tokens, och utnyttjar innovationer som komprimerade kommunikationsprotokoll och distribuerad dataparallellism för att göra träning genomförbar utanför traditionella datacenter.

Prestandamätningar tyder på att det inte bara är experimentellt. Benchmark-resultat placerar det i konkurrens med etablerade centraliserade modeller, en detalj som hjälper till att förklara varför projektet har väckt uppmärksamhet även utanför kryptovalutans inhemska publik.

Marknaden har också lagt märke till detta. Efter tillkännagivandet har projektets token TAO stigit med 24 % sedan videon med Palihapitiya och Huang spreds på sociala medier.

Nvidia stöder Nebius planer på en AI-fabrik med en massiv investering på 2 miljarder dollar

Upptäck hur Nvidia omformar datorbranschens framtid genom en investering på 2 miljarder dollar i molnbaserad AI-infrastruktur. read more.

Läs nu

Nvidia stöder Nebius planer på en AI-fabrik med en massiv investering på 2 miljarder dollar

Upptäck hur Nvidia omformar datorbranschens framtid genom en investering på 2 miljarder dollar i molnbaserad AI-infrastruktur. read more.

Läs nu

Nvidia stöder Nebius planer på en AI-fabrik med en massiv investering på 2 miljarder dollar

Läs nuUpptäck hur Nvidia omformar datorbranschens framtid genom en investering på 2 miljarder dollar i molnbaserad AI-infrastruktur. read more.

Huang antyder dock att den verkliga historien inte handlar om disruption, utan om samexistens mellan de två. Proprietära AI-system kommer sannolikt att förbli dominerande för allmänna användare, medan öppna och decentraliserade modeller kommer att ta plats i specialiserade, kostnadskänsliga eller suveränitetsdrivna applikationer.

För startups skissade Nvidias VD upp en pragmatisk strategi: börja öppet, och lägg sedan till proprietära fördelar. ”Alla startups vi investerar i nu är först öppen källkod, och går sedan över till den proprietära modellen”, sa han.

Med andra ord kanske AI:s framtid inte tillhör en enda arkitektur eller filosofi. Den kanske tillhör dem som kan navigera i båda – och vet när de ska använda vilken.

FAQ 🔎

- Vad är Bittensors Covenant-72B?

En språkmodell med 72 miljarder parametrar som tränats genom ett decentraliserat nätverk av bidragsgivare utan centraliserad infrastruktur. - Vad sa Jensen Huang om decentraliserad AI?

Han sa att öppna och proprietära AI-modeller kommer att samexistera och beskrev förhållandet som ”A och B”, inte som ett val mellan dem. - Varför är denna utveckling viktig?

Den visar att storskaliga AI-modeller kan tränas utanför traditionella datacenter, vilket utmanar antaganden om infrastrukturbehov. - Hur påverkar detta AI-branschen?

Det stöder en hybrid framtid där centraliserade plattformar och decentraliserade modeller fyller olika roller inom olika branscher.