Anthropic hovorí, že umelá inteligencia (AI) dosiahla zásadný prah v oblasti kybernetickej bezpečnosti, pričom nové dôkazy ukazujú, že AI modely sú teraz schopné vykonávať veľké kybernetické operácie – obranne aj útočne – v bezprecedentnom rozsahu.

Anthropic varuje, že bariéry kybernetických útokov padli, pretože schopnosti AI sa zrýchľujú

AI Dosiahla Bod Zlomu v Kybernetickej Bezpečnosti, Antropic Vydáva Nové Vyšetrovanie

Anthropic, AI firma za Claude, uvádza, že jej interné evaluácie a práca s hrozbami ukazujú rozhodujúci posun vo vývoji kybernetických schopností. Podľa nedávno zverejneného vyšetrovania sa kybernetické schopnosti medzi AI systémami zdvojnásobili za šesť mesiacov, podložené meraniami reálnych aktivít a modelovým testovaním.

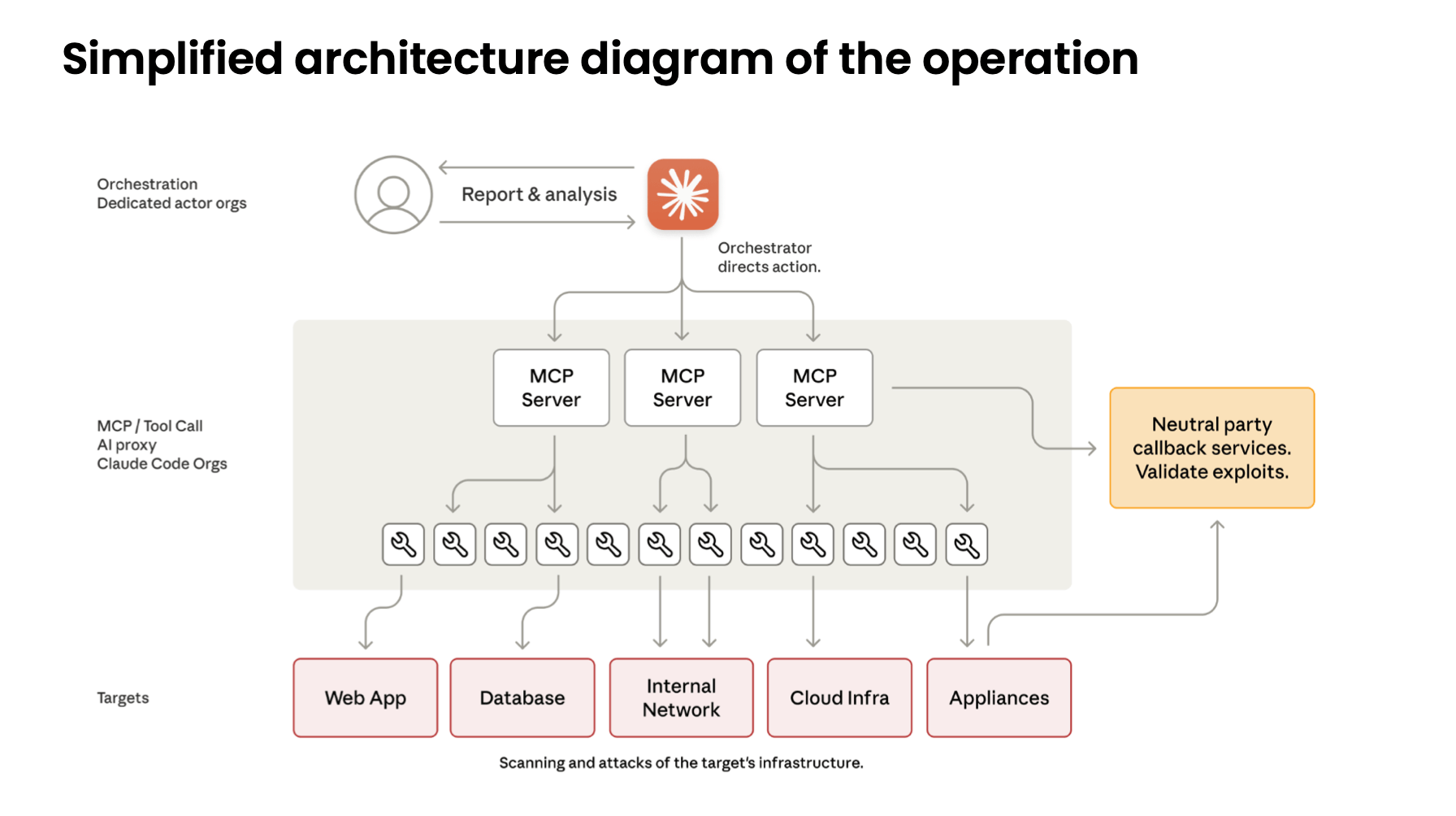

Spoločnosť uvádza, že AI teraz významne ovplyvňuje globálnu bezpečnostnú dynamiku, najmä keď zlovestní aktéri čoraz častejšie prijímajú automatizované útočné rámce. Vo svojej najnovšej správe Anthropic podrobne opisuje, čo nazýva prvý zdokumentovaný prípad AI organizovanej kybernetickej špionážnej kampane. Tím pre spravodajstvo hrozieb identifikoval a prerušil rozsiahlu operáciu v polovici septembra 2025, pripísanú čínskej štátne podporovanej skupine označenej ako GTG-1002.

Skupina údajne použila koordinované inštancie Claude Code na vykonanie prieskumu, objavenie zraniteľností, zneužitie, laterálny pohyb, extrakciu metadát a exfiltráciu dát – prevažne bez ľudského zásahu. Kampaň cieľovo zasiahla približne 30 organizácií naprieč sektormi, vrátane technológií, financií, chemikálií a rôznych vládnych agentúr. Anthropic overila niekoľko úspešných prienikov pred zásahom.

Analytici hovoria, že útočníci využili autonómny rámec schopný rozložiť viacfázové útoky na menšie úlohy, ktoré sa zdali legitímne, keď boli izolované od širšieho kontextu. To umožnilo aktérom prejsť výzvy cez zavedené osoby a presvedčiť Claude, že operácie boli obrannými bezpečnostnými testami, nie útočnými kampaňami.

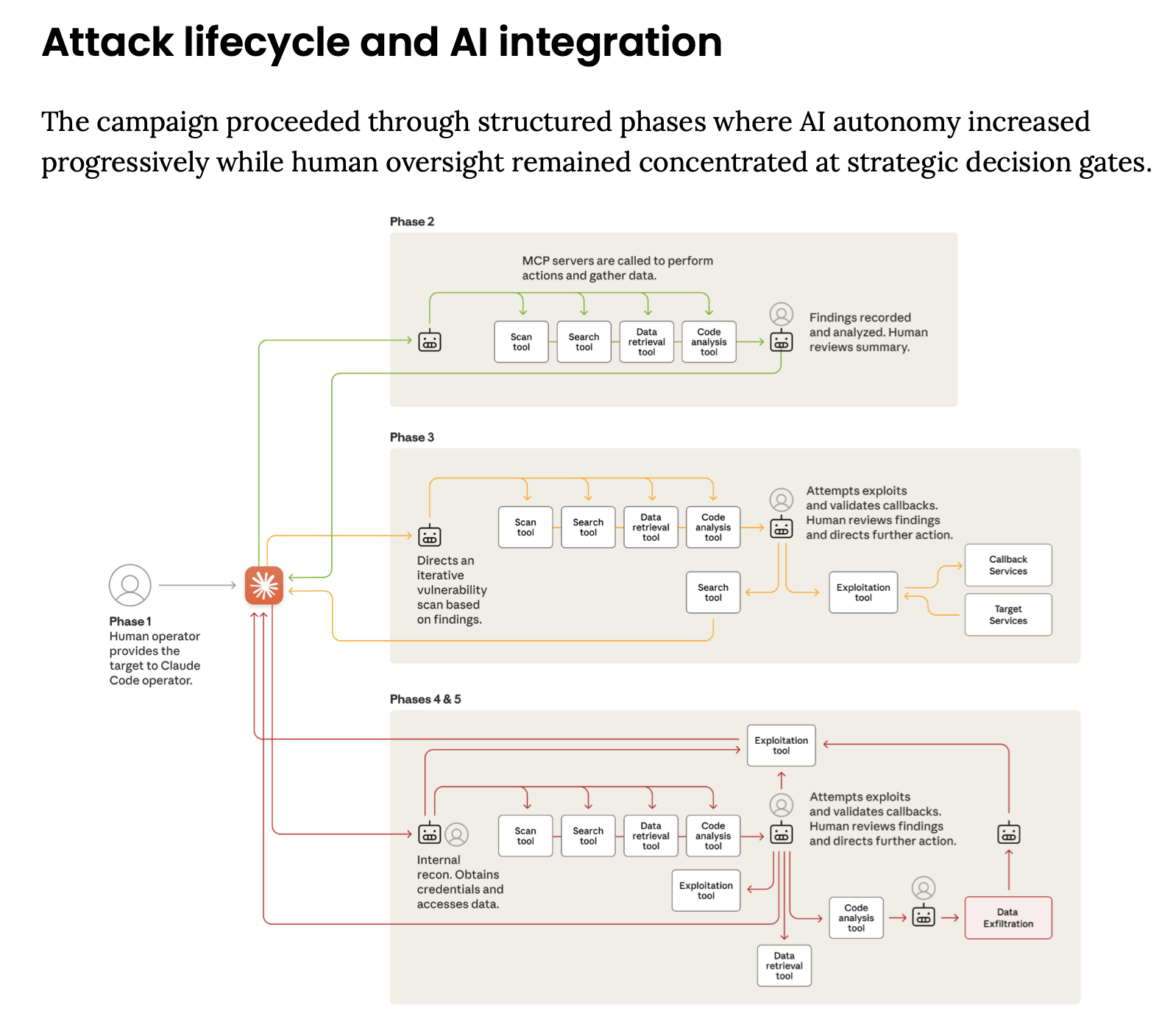

Podľa vyšetrovania Claude autonómne vykonal 80% až 90% taktických operácií. Ľudskí operátori poskytovali len strategický dohľad, schvaľujúc hlavné kroky, ako prechod od prieskumu k aktívnemu zneužitiu alebo povolenie exfiltrácie dát. Správa popisuje úroveň operačného tempa nemožného pre tímy zložené iba z ľudí, pričom niektoré pracovné toky generovali viac operácií za sekundu na tisíckach žiadostí.

Anthropic tvrdí, že životný cyklus útoku sa pokročil štruktúrovaným procesom, kde sa AI autonómia zvyšovala v každej fáze. Claude nezávisle mapoval povrchy útoku, skenoval živé systémy, vytváral vlastné payloady pre overená zraniteľnosti, získaval poverenia a pohyboval sa cez interne siete. Ďalej analyzoval ukradnuté dáta, identifikoval hodnotnú inteligenciu a automaticky generoval podrobné operačné dokumenty, umožňujúc nepretržitý prístup a predanie medzi operátormi.

Jedným z obmedzení, na ktoré správa poukazuje, bola tendencia modelu k halucináciám počas útočných pracovných zaťažení – občas preháňal prístup, vytváral fiktívne poverenia alebo nesprávne klasifikoval verejne dostupné informácie ako citlivé. Napriek tomu Anthropic hovorí, že aktér kompenzoval validáciou krokov, čím ukázal, že plne autonómne útočné operácie zostávajú uskutočniteľné aj napriek nedokonalostiam súčasných modelov.

Po svojom objave Anthropic zakázala relevantné účty, informovala postihnuté subjekty, koordinovala sa s úradmi a zaviedla nové obranné mechanizmy, vrátane vylepšených klasifikátorov na detekciu nových vzorcov hrozieb. Spoločnosť teraz vyvíja systémy včasného varovania, ktoré majú signalizovať autonómne pokusy o prienik a buduje nové vyšetrovacie nástroje pre rozsiahle distribuované kybernetické operácie.

Čítaj viac: Microsoft’s ‘Magentic Marketplace’ odhaľuje, ako AI agenty môžu skolabovať pod tlakom

Firma tvrdí, že aj keď tieto schopnosti môžu byť zbraňou, sú rovnako kľúčové pre posilnenie obrannej pripravenosti. Anthropic poznamenáva, že jej vlastný tím pre spravodajstvo hrozieb sa výrazne spoliehal na Claude pri analýze rozsiahlych datasetov generovaných počas vyšetrovania. Dôrazne odporúča bezpečnostným tímom začať prijímať automatizáciu poháňanú AI pre centrá operácií bezpečnosti, detekciu hrozieb, analýzu zraniteľností a reakciu na incidenty.

Správa však varuje, že prekážky kybernetických útokov „sa podstatne znížili“, keď AI systémy umožňujú malým skupinám – alebo dokonca jednotlivcom – vykonávať operácie, ktoré boli predtým obmedzené na štátov podporovaných aktérov s dostatočným financovaním. Anthropic očakáva rýchle šírenie týchto techník v širšom prostredí hrozieb a volá po hlbšej spolupráci, lepších obranných opatreniach a širšej účasti priemyslu na zdieľaní hrozieb na proti čelíacim sa AI-umožneným útokovým modelom.

FAQ ❓

- Čo Anthropic objavil vo svojom vyšetrovaní?

Anthropic identifikoval a narušil rozsiahlu kybernetickú špionážnu kampaň, ktorá používala AI na automatizáciu väčšiny útočných operácií. - Kto stál za útokom?

Firma priradila operáciu čínskej štátne podporovanej skupine označenej ako GTG-1002. - Ako bola AI použitá pri prienikoch?

Útočníci využili Claude Code na autonómne vykonávanie prieskumu, zneužitia, laterálneho pohybu a extrakcie dát. - Prečo je táto správa dôležitá pre tímy kybernetickej bezpečnosti?

Anthropic hovorí, že prípad ukazuje, že autonómne AI-umožnené útoky sú teraz uskutočniteľné v rozsahu a vyžadujú nové obrané stratégie.