Anthropic urobil mimoriadny krok a zažaloval vládu USA po tom, čo Pentagón označil firmu zaoberajúcu sa umelou inteligenciou (AI) za „riziko dodávateľského reťazca pre národnú bezpečnosť“, čím vyvolal právny spor, ktorý by mohol zmeniť spôsob, akým Washington kontroluje dodávateľov umelej inteligencie spolupracujúcich s armádou.

Anthropic Daria Amodeia žaluje vládu USA a tvrdí, že Pentagón sa pomstil za bezpečnostné zábrany v oblasti AI

Anthropic sa v prelomovej žalobe v oblasti AI púšťa do sporu s Ministerstvom obrany

Podľa niekoľkých správ Anthropic 9. marca podal na federálnom súde dve žaloby, ktorými napadol kroky Ministerstva obrany USA a administratívy Donalda Trumpa. Tvrdí, že vláda voči spoločnosti nezákonne podnikla odvetu po tom, čo odmietla odstrániť ochranné opatrenia zo svojho systému umelej inteligencie Claude. Žaloby sa zameriavajú na označenie, ktoré sa zvyčajne vzťahuje na zahraničných protivníkov podozrivých zo špionáže alebo sabotáže, nie na domáce technologické firmy.

Spor siaha k rokovaniam o zmluve medzi Anthropicom a Pentagónom o tom, ako by mohol byť model Claude AI využívaný obrannými agentúrami USA. Anthropic predtým podporoval iniciatívy národnej bezpečnosti a v júni 2024 sa stal prvou frontier AI spoločnosťou, ktorá nasadila modely na utajovaných sieťach vlády USA, čím pomáhala analytikom a vojenským plánovačom pri vyhodnocovaní spravodajských informácií, simuláciách, operačnom plánovaní a práci v oblasti kybernetickej bezpečnosti.

Napätie eskalovalo, keď Ministerstvo obrany v rámci obnovenia zmluvy požadovalo neobmedzený prístup ku Claude na „všetky zákonné účely“. Anthropic súhlasil s väčšinou podmienok, no trval na dvoch obmedzeniach: zakázať používanie svojej AI na masové domáce sledovanie Američanov a zabrániť nasadeniu v plne autonómnych smrtiacich zbraňových systémoch.

Vedúci predstavitelia spoločnosti argumentovali, že tieto zábrany sú potrebné, pretože súčasné frontier AI modely zostávajú príliš nespoľahlivé pre autonómne zbrane a pretože programy rozsiahleho sledovania by mohli byť v rozpore s ústavnými ochranami. Anthropic uviedol, že obmedzenia nikdy nezasahovali do žiadnej vojenskej misie počas jeho predchádzajúcej spolupráce s vládou.

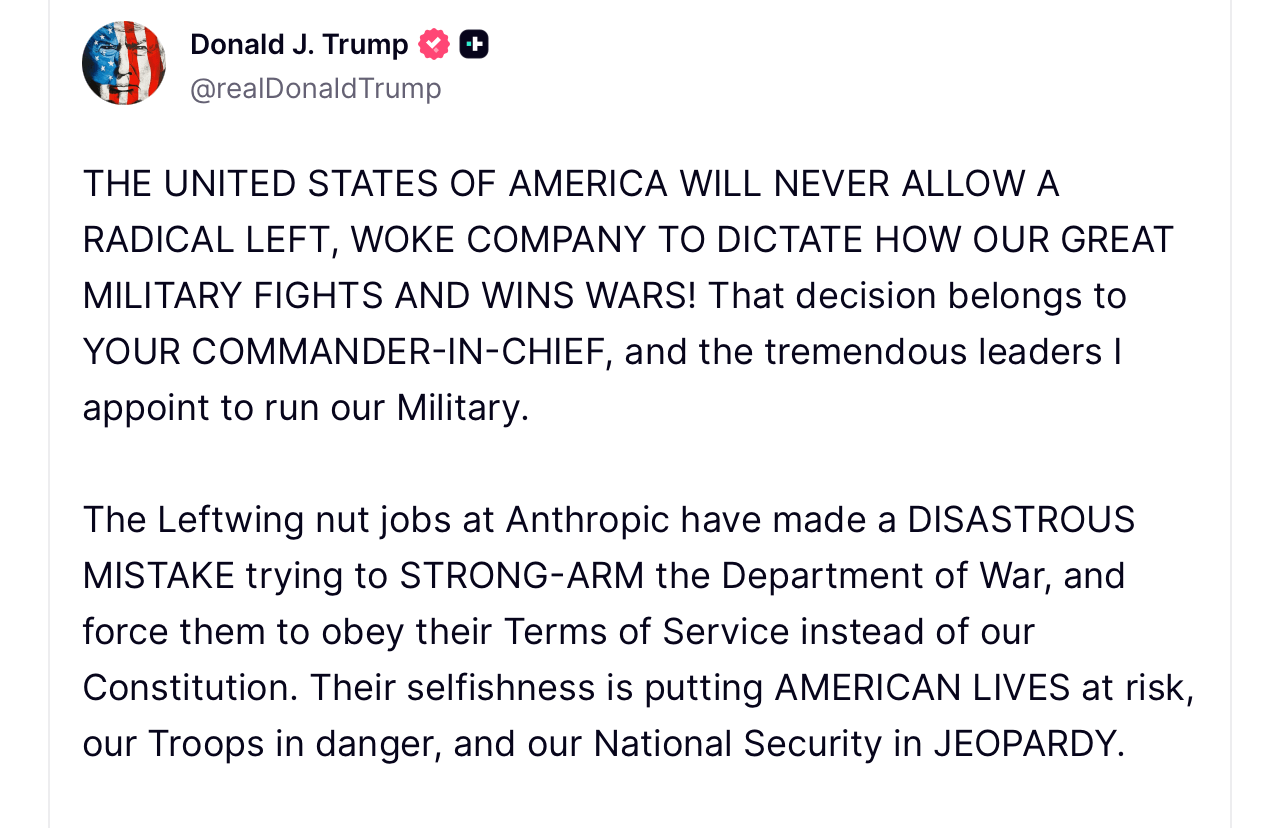

Rokovania sa zrútili po stretnutí 24. februára medzi generálnym riaditeľom Anthropicu Dariom Amodeiom a ministrom obrany Petom Hegsethom. O niekoľko dní neskôr, 27. februára, prezident Donald Trump zverejnil príspevok na Truth Social, v ktorom federálnym agentúram nariadil „okamžite prestať“ používať technológie Anthropicu a pokračujúce spoliehanie sa na spoločnosť označil za „katastrofálnu chybu“.

Krátko nato Hegseth pristúpil ku klasifikácii Anthropicu ako rizika dodávateľského reťazca podľa federálnej obstarávacej právomoci uvedenej v 10 U.S.C. § 3252. Toto označenie, potvrdené v liste zaslanom spoločnosti okolo 4. marca, obmedzuje niektorých vládnych dodávateľov v používaní technológie, ktorá je považovaná za zraniteľnú voči sabotáži alebo zahraničnému vplyvu.

Anthropic tvrdí, že tento krok naťahuje zákon ďaleko za hranice jeho zamýšľaného účelu. V súdnych podaniach spoločnosť uvádza, že označenie bolo určené pre bezpečnostné hrozby napojené na zahraničie, nie pre politické nezhody s domácimi dodávateľmi. Žaloby tvrdia, že vláda nepoužila „najmenej reštriktívne prostriedky“, ktoré vyžaduje zákon, a namiesto toho uvalila to, čo spoločnosť opisuje ako neoficiálnu čiernu listinu.

Právne podania tiež poukazujú na ústavné obavy. Anthropic tvrdí, že označenie porušuje Prvý dodatok tým, že trestá spoločnosť za verejné presadzovanie obmedzení používania AI, ako sú autonómne zbrane a domáce sledovanie. Podľa žaloby označenie firmy za riziko pre národnú bezpečnosť poškodzuje jej povesť a mohlo by ohroziť zmluvy v hodnote stoviek miliónov dolárov.

Anthropic žiada súdy, aby zablokovali vymáhanie označenia, nariadili federálnym agentúram stiahnuť smernice zastavujúce obchodovanie so spoločnosťou a zabránili podobným krokom v budúcnosti. Spoločnosť uviedla, že jej cieľom nie je prinútiť vládu kupovať jej technológie, ale zabrániť odvetným krokom pre politické rozdiely.

„Žiadosť o súdne preskúmanie nemení náš dlhodobý záväzok využívať AI na ochranu našej národnej bezpečnosti,“ uviedol hovorca Anthropicu v stanovisku. „No je to nevyhnutný krok na ochranu nášho podnikania, našich zákazníkov a našich partnerov.“

Predstavitelia Pentagónu sa k súdnemu sporu verejne nevyjadrili s odvolaním sa na pravidlá týkajúce sa prebiehajúcich súdnych konaní. Niektorí lídri v oblasti obrany už predtým tvrdili, že vojenské agentúry musia mať počas núdzových situácií plnú operačnú autoritu nad technológiami dodávateľov a nemôžu umožniť, aby dodávatelia diktovali, ako sa systémy používajú.

Divoký víkend AI: otras v OpenAI, konflikt s Pentagonom a roboty, ktoré odmietajú zomrieť

AI otrasmi otriasli rýchlo: dráma v OpenAI, spor Pentagonu s Anthropic, spustenie GPT-5.4, samoliečiace sa roboty a nové bezpečnostné nástroje. read more.

Čítať teraz

Divoký víkend AI: otras v OpenAI, konflikt s Pentagonom a roboty, ktoré odmietajú zomrieť

AI otrasmi otriasli rýchlo: dráma v OpenAI, spor Pentagonu s Anthropic, spustenie GPT-5.4, samoliečiace sa roboty a nové bezpečnostné nástroje. read more.

Čítať teraz

Divoký víkend AI: otras v OpenAI, konflikt s Pentagonom a roboty, ktoré odmietajú zomrieť

Čítať terazAI otrasmi otriasli rýchlo: dráma v OpenAI, spor Pentagonu s Anthropic, spustenie GPT-5.4, samoliečiace sa roboty a nové bezpečnostné nástroje. read more.

Spor prichádza v čase, keď sa stupňuje preteky o získanie vojenských AI kontraktov. Konkurenčné firmy, vrátane OpenAI, uzavreli s Pentagónom dohody približne v rovnakom čase, keď sa rokovania s Anthropicom rozpadli. Medzitým veľkí technologickí partneri ako Google a Microsoft naznačili, že majú v úmysle pokračovať v spolupráci s Anthropicom na komerčných službách nesúvisiacich s obranou.

Podľa odvetvových analytikov by výsledok prípadu mohol vytvoriť precedens pre to, ako federálna vláda vyvíja tlak na AI spoločnosti, aby upravili bezpečnostné politiky, keď sú v hre záujmy národnej bezpečnosti. Nateraz zostávajú spotrebiteľské produkty Anthropicu a komerčné AI služby dostupné, zatiaľ čo právny boj o označenie Pentagónu si začína raziť cestu súdmi.

FAQ 🧭

- Prečo Anthropic zažaloval vládu USA?

Anthropic podal žaloby s tvrdením, že Pentagón nezákonne označil spoločnosť za riziko dodávateľského reťazca pre národnú bezpečnosť po tom, čo odmietla odstrániť bezpečnostné obmedzenia AI. - Čo spustilo spor medzi spoločnosťou Anthropic a Pentagónom?

Konflikt sa začal počas rokovaní o zmluve, keď Ministerstvo obrany požadovalo neobmedzené používanie systému Claude AI od Anthropicu. - Čo znamená označenie „riziko dodávateľského reťazca“?

Toto označenie môže obmedziť vládnych dodávateľov v používaní technológie spoločnosti, ak sa úradníci domnievajú, že predstavuje bezpečnostné alebo obstarávacie riziká. - Budú AI služby Anthropicu počas súdneho sporu stále fungovať?

Áno, komerčné AI produkty a spotrebiteľské služby Anthropicu zostávajú dostupné, kým právny prípad pokračuje.