Компания Anthropic предприняла необычный шаг, подав иск против правительства США после того, как Пентагон назвал компанию, занимающуюся искусственным интеллектом (ИИ), «угрозой национальной безопасности в сфере цепочки поставок», что вызвало юридический конфликт, который может изменить подход Вашингтона к контролю над поставщиками искусственного интеллекта, работающими с военными.

Компания Anthropic Дарио Амодеи подала иск против правительства США, заявив, что Пентагон принял ответные меры в связи с мерами безопасности в области искусственного интеллекта

Anthropic подает в суд на Министерство обороны в рамках знакового судебного процесса по ИИ

Согласно нескольким сообщениям, 9 марта Anthropic подала два иска в федеральный суд, оспаривая действия Министерства обороны США и администрации Трампа, утверждая, что правительство незаконно применило меры возмездия против компании после того, как она отказалась снять меры безопасности со своей системы искусственного интеллекта Claude. Иски направлены против обозначения, которое обычно применяется к иностранным противникам, подозреваемым в шпионаже или саботаже, а не к отечественным технологическим компаниям.

Спор восходит к переговорам по контракту между Anthropic и Пентагоном о том, как модель искусственного интеллекта Claude компании может быть использована оборонными ведомствами США. Anthropic ранее поддерживала инициативы в области национальной безопасности и в июне 2024 года стала первой передовой компанией в области искусственного интеллекта, которая развернула модели в секретных сетях правительства США, помогая аналитикам и военным планировщикам в анализе разведданных, моделировании, оперативном планировании и работе в области кибербезопасности.

Напряженность усилилась, когда Министерство обороны потребовало неограниченный доступ к Claude для «всех законных целей» в рамках продления контракта. Anthropic согласилась с большинством условий, но настаивала на двух ограничениях: запрете использования ее ИИ для массовой внутренней слежки за американцами и предотвращении внедрения в полностью автономные системы летального оружия.

Руководство компании утверждало, что эти ограничения необходимы, поскольку современные передовые модели ИИ по-прежнему слишком ненадежны для автономного оружия, а крупномасштабные программы слежения могут противоречить конституционным гарантиям. Anthropic заявила, что эти ограничения никогда не мешали выполнению военных миссий в ходе ее предыдущей работы с правительством.

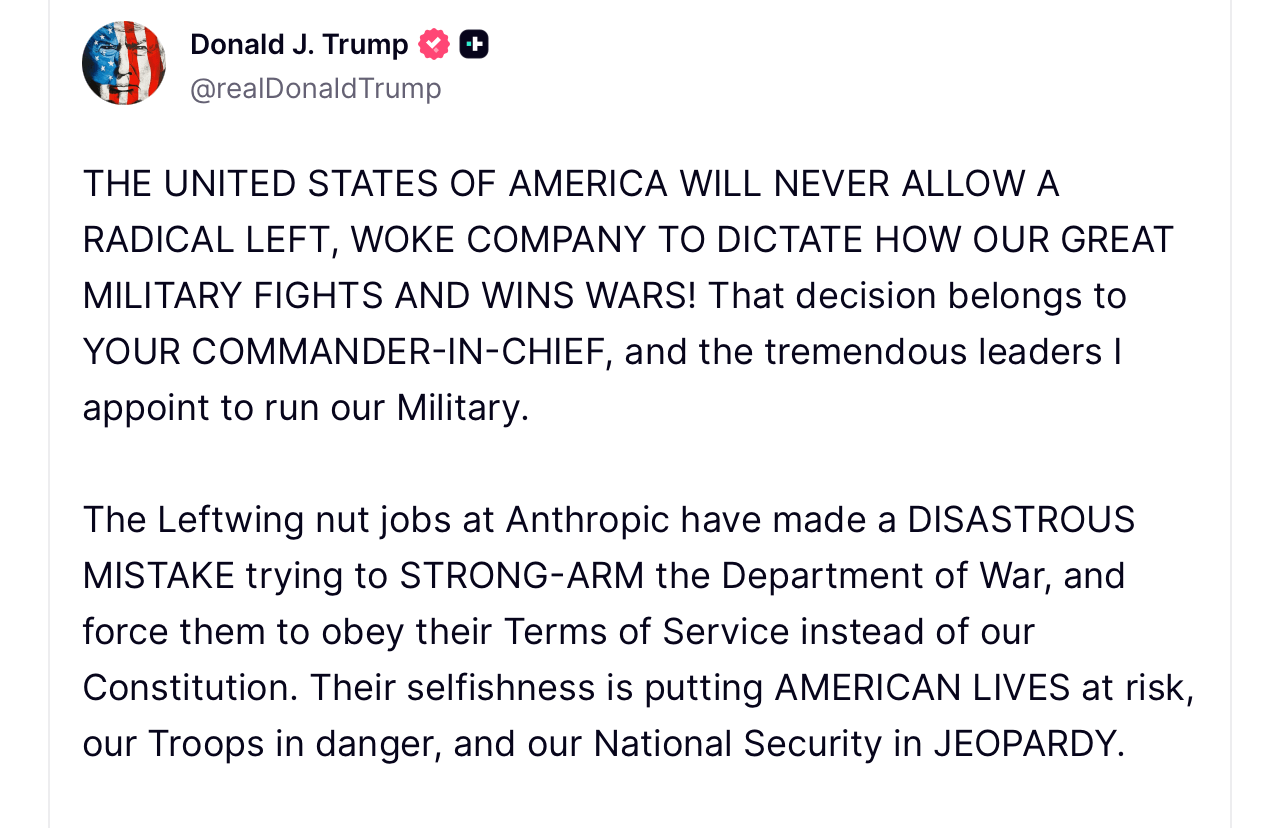

Переговоры сорвались после встречи 24 февраля между генеральным директором Anthropic Дарио Амодеи и министром обороны Питом Хегсетом. Спустя несколько дней, 27 февраля, президент Дональд Трамп опубликовал в Truth Social сообщение, в котором приказал федеральным агентствам «немедленно прекратить» использование технологий Anthropic, назвав дальнейшее сотрудничество с компанией «катастрофической ошибкой».

Вскоре после этого Хегсет принял решение классифицировать Anthropic как риск для цепочки поставок в соответствии с федеральным законом о закупках, изложенным в 10 U.S.C. § 3252. Это решение, подтвержденное в письме, отправленном компании около 4 марта, ограничивает некоторых государственных подрядчиков в использовании технологий, считающихся уязвимыми для саботажа или иностранного влияния.

Anthropic утверждает, что этот шаг выходит далеко за рамки его первоначальной цели. В судебных документах компания утверждает, что это обозначение было предназначено для угроз безопасности, связанных с иностранными государствами, а не для политических разногласий с отечественными поставщиками. В исках утверждается, что правительство не использовало «наименее ограничительные средства», требуемые законом, а вместо этого ввело то, что компания описывает как неофициальный черный список.

В судебных документах также поднимаются вопросы конституционности. Anthropic утверждает, что это обозначение нарушает Первую поправку, наказывая компанию за публичную поддержку ограничений на использование ИИ, таких как автономное оружие и внутреннее наблюдение. Согласно иску, обозначение компании как угрозы национальной безопасности наносит ущерб ее репутации и может поставить под угрозу контракты на сотни миллионов долларов.

Anthropic просит суды заблокировать исполнение этого решения, обязать федеральные агентства отозвать директивы, прекращающие сотрудничество с компанией, и предотвратить подобные действия в будущем. Компания заявила, что ее цель не состоит в том, чтобы заставить правительство приобрести ее технологию, а в том, чтобы предотвратить ответные меры из-за различий в политике.

«Обращение в суд не меняет нашего давнего стремления использовать ИИ для защиты национальной безопасности», — заявил представитель Anthropic в своем заявлении. «Но это необходимый шаг для защиты нашего бизнеса, наших клиентов и наших партнеров».

Представители Пентагона не комментируют публично судебный процесс, ссылаясь на политику в отношении текущих судебных дел. Некоторые руководители оборонного ведомства ранее заявляли, что военные агентства должны сохранять полную оперативную власть над технологиями подрядчиков в чрезвычайных ситуациях и не могут позволять поставщикам диктовать, как использовать системы.

Безумный уик-энд в мире ИИ: перестановки в OpenAI, конфликт с Пентагоном и роботы, которые отказываются умирать

Быстрые перемены в сфере ИИ: драма с OpenAI, конфликт Пентагона с Anthropic, запуск GPT-5.4, самовосстанавливающиеся роботы и новые инструменты безопасности. read more.

Читать

Безумный уик-энд в мире ИИ: перестановки в OpenAI, конфликт с Пентагоном и роботы, которые отказываются умирать

Быстрые перемены в сфере ИИ: драма с OpenAI, конфликт Пентагона с Anthropic, запуск GPT-5.4, самовосстанавливающиеся роботы и новые инструменты безопасности. read more.

Читать

Безумный уик-энд в мире ИИ: перестановки в OpenAI, конфликт с Пентагоном и роботы, которые отказываются умирать

ЧитатьБыстрые перемены в сфере ИИ: драма с OpenAI, конфликт Пентагона с Anthropic, запуск GPT-5.4, самовосстанавливающиеся роботы и новые инструменты безопасности. read more.

Спор возник на фоне обострения конкуренции за военные контракты в области ИИ. Конкурирующие компании, в том числе OpenAI, достигли соглашений с Пентагоном примерно в то же время, когда переговоры с Anthropic зашли в тупик. Между тем, крупные технологические партнеры, такие как Google и Microsoft, заявили о намерении продолжить сотрудничество с Anthropic в сфере коммерческих услуг, не связанных с обороной.

Аналитики отрасли говорят, что исход этого дела может создать прецедент того, как федеральное правительство может оказывать давление на компании, занимающиеся ИИ, с целью изменения политики безопасности, когда речь идет об интересах национальной безопасности. На данный момент потребительские продукты и коммерческие услуги Anthropic в области ИИ остаются доступными, в то время как судебная тяжба по поводу решения Пентагона продолжается.

Часто задаваемые вопросы 🧭

- Почему Anthropic подала в суд на правительство США?

Anthropic подала иски, утверждая, что Пентагон незаконно обозначил компанию как представляющую риск для цепочки поставок в сфере национальной безопасности после того, как она отказалась снять ограничения на использование ИИ. - Что вызвало спор между Anthropic и Пентагоном?

Конфликт начался во время переговоров по контракту, когда Министерство обороны потребовало неограниченного использования системы искусственного интеллекта Claude от Anthropic. - Что означает обозначение «угроза для цепочки поставок»?

Это обозначение может ограничить использование технологий компании государственными подрядчиками, если чиновники считают, что они представляют угрозу для безопасности или закупок. - Будут ли услуги искусственного интеллекта Anthropic по-прежнему работать во время судебного разбирательства?

Да, коммерческие продукты искусственного интеллекта и потребительские услуги Anthropic остаются доступными во время судебного разбирательства.