Anthropic spune că inteligența artificială (IA) a atins un prag decisiv în domeniul securității cibernetice, cu noi dovezi care arată că modelele de IA sunt acum capabile să efectueze operațiuni cibernetice majore—atât defensive, cât și ofensive—la o scară fără precedent.

Anthropic avertizează că barierele împotriva atacurilor cibernetice au căzut pe măsură ce capacitățile AI se accelerează

AI atinge un punct de cotitură în securitatea cibernetică, avertizează Anthropic într-o nouă investigație

Anthropic, firma de IA din spatele lui Claude, spune că evaluările sale interne și munca sa de informații privind amenințările arată o schimbare decisivă în dezvoltarea capacităților cibernetice. Conform unei investigații recent lansate, capacitățile cibernetice ale sistemelor de IA s-au dublat în șase luni, susținute de măsurători ale activității din lumea reală și de testări bazate pe modele.

Compania spune că IA influențează acum în mod semnificativ dinamica securității globale, în special pe măsură ce actorii malițioși adoptă din ce în ce mai mult cadre automate de atac. În cel mai recent raport, Anthropic detaliază ceea ce numește primul caz documentat de campanie de spionaj cibernetic orchestrată de IA. Echipa de Informații despre Amenințări a firmei a identificat și întrerupt o operațiune pe scară largă la mijlocul lunii sept. 2025, atribuită unui grup chinez sponsorizat de stat, desemnat GTG-1002.

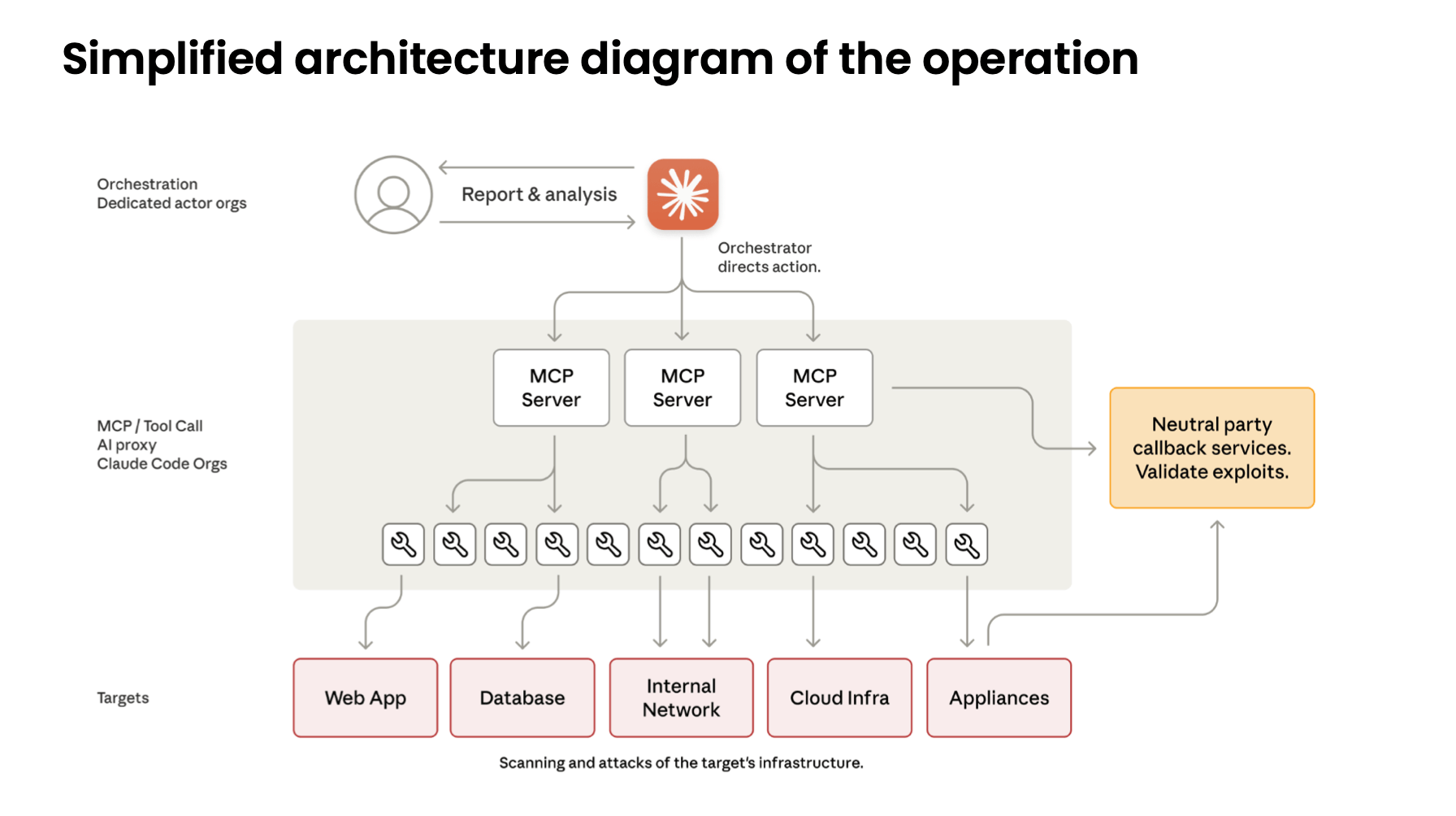

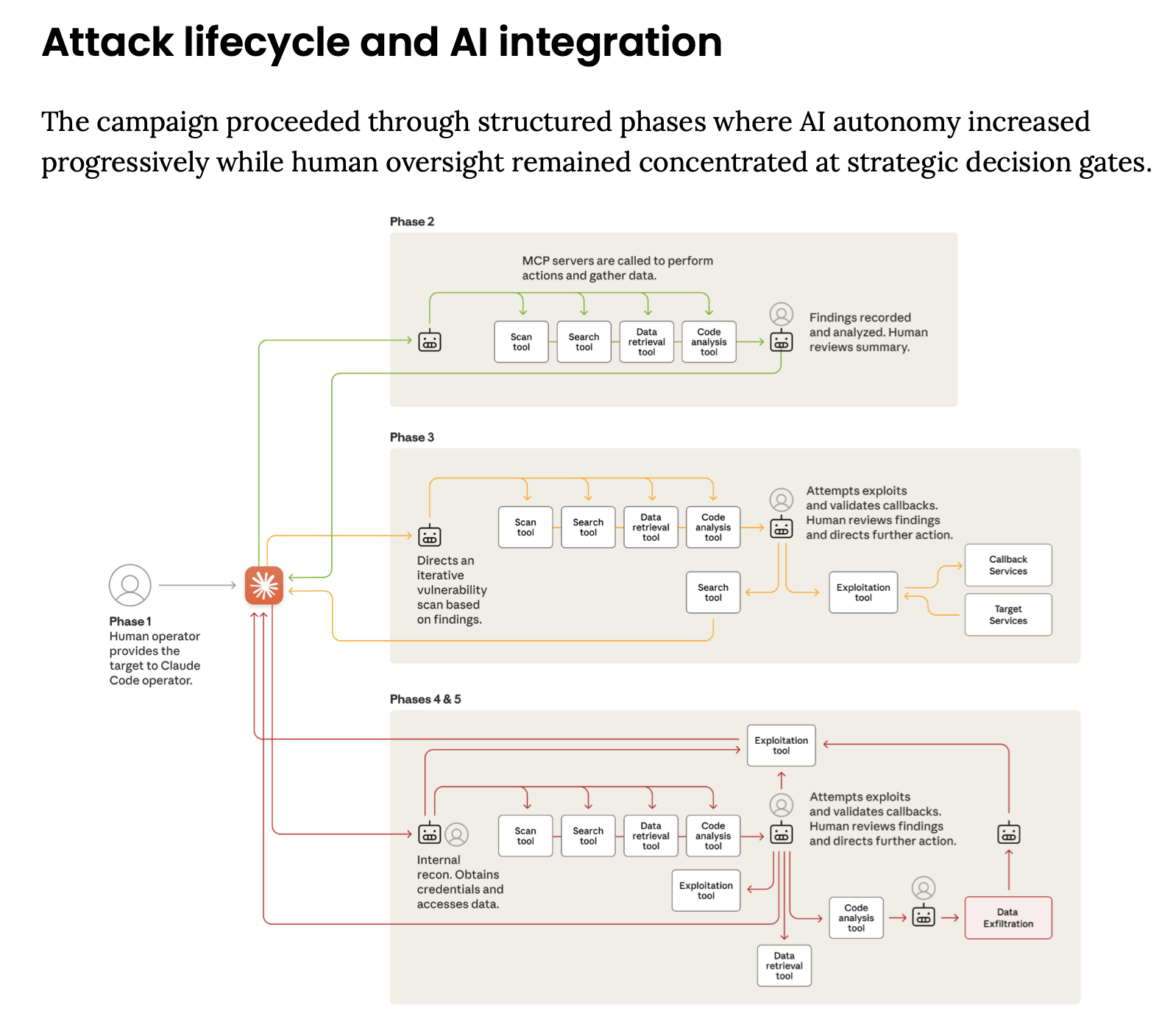

Se raportează că grupul a folosit instanțe coordonate de Claude Code pentru a efectua recunoaștere, descoperire de vulnerabilități, exploatare, mișcare laterală, extracție de metadate și extragere de date—în mare parte fără implicare umană. Campania a vizat aproximativ 30 de organizații din sectoare precum tehnologie, finanțe, chimie și mai multe agenții guvernamentale. Anthropic a validat mai multe intruziuni reușite înainte de a interveni.

Analiștii spun că atacatorii au folosit un cadru autonom capabil să fragmenteze atacurile multi-etapă în sarcini mai mici care păreau legitime când erau izolate de contextul lor mai larg. Acest lucru le-a permis actorilor să treacă prompturi prin personalități stabilite și să convingă Claude că operațiunile erau teste de securitate defensive mai degrabă decât campanii ofensive.

Conform investigației, Claude a executat autonom 80% până la 90% din operațiunile tactice. Operatorii umani au oferit doar supraveghere strategică, aprobând pașii majori precum escaladarea de la recunoaștere la exploatare activă sau autorizarea extragerii de date. Raportul descrie un nivel de tempo operațional imposibil pentru echipele compuse doar din oameni, cu unele fluxuri de lucru generând multiple operațiuni pe secundă din mii de cereri.

Anthropic spune că ciclul de viață al atacului a avansat printr-un canal structurat unde autonomia IA a crescut în fiecare fază. Claude a mapat independent suprafețele de atac, a scanat sistemele live, a construit sarcini personalizate pentru vulnerabilitățile validate, a cules acreditive și a tranzitat prin rețelele interne. A analizat de asemenea datele furate, a identificat informații de mare valoare și a generat automat documentație operațională detaliată care permitea accesul persistent și predări între operatori.

O limitare, menționează raportul, a fost tendința modelului de a halucina sub încărcături de lucru ofensive—ocazional exagerând accesul, fabricând acreditive sau clasificând greșit informațiile publice ca fiind sensibile. Chiar și așa, Anthropic spune că actorul a compensat prin pași de validare, demonstrând că operațiunile ofensive complet autonome rămân fezabile în ciuda imperfecțiunilor modelelor de astăzi.

În urma descoperirii sale, Anthropic a interzis conturile relevante, a notificat entitățile afectate, a coordonat cu autoritățile și a introdus noi mecanisme defensive, inclusiv clasificatori îmbunătățiți pentru detectarea tiparelor de amenințări noi. Compania testează acum sisteme de avertizare precoce proiectate pentru a semnala încercările de intruziune autonome și construiește noi instrumente de investigație pentru operațiuni cibernetice distribuite pe scară largă.

Citește mai mult: Microsoft’s ‘Magentic Marketplace’ dezvăluie cum agenții IA pot colapsa sub presiune

Firma susține că, deși aceste capacități pot fi folosite ca arme, ele sunt la fel de critice pentru întărirea pregătirii defensive. Anthropic notează că echipa sa de Informații despre Amenințări s-a bazat mult pe Claude pentru a analiza seturile masive de date generate în timpul investigației. Ea îndeamnă echipele de securitate să înceapă adoptarea automatizării conduse de IA pentru centrele de operațiuni de securitate, detectarea amenințărilor, analiza vulnerabilităților și răspunsul la incidente.

Totuși, raportul avertizează că barierele atacurilor cibernetice au „scăzut substanțial” pe măsură ce sistemele IA permit grupurilor mici—sau chiar indivizilor—să execute operațiuni care altădată erau limitate la actorii de stat bine finanțați. Anthropic se așteaptă la o proliferare rapidă a acestor tehnici în mediul de amenințări mai larg, cerând o colaborare mai profundă, măsuri de apărare îmbunătățite și participare mai largă a industriei în partajarea amenințărilor pentru a contracara modelele emergente de atac susținute de IA.

FAQ ❓

- Ce a descoperit Anthropic în investigația sa?

Anthropic a identificat și întrerupt o campanie de spionaj cibernetic pe scară largă care a folosit IA pentru a automatiza majoritatea operațiunilor de atac. - Cine a fost în spatele atacului?

Firma a atribuit operațiunea unui grup chinez sponsorizat de stat, desemnat GTG-1002. - Cum a fost folosită IA în intruziuni?

Atacatorii au folosit Claude Code pentru a efectua autonom recunoaștere, exploatare, mișcare laterală și extracție de date. - De ce este raportul important pentru echipele de securitate cibernetică?

Anthropic spune că cazul arată că atacurile autonome susținute de IA sunt acum fezabile la scară și necesită noi strategii defensive.