Anthropic a făcut pasul extraordinar de a da în judecată guvernul SUA după ce Pentagonul a etichetat firma de inteligență artificială (IA) drept un „risc pentru lanțul de aprovizionare la adresa securității naționale”, declanșând un conflict juridic care ar putea remodela modul în care Washingtonul controlează furnizorii de inteligență artificială ce lucrează cu armata.

Anthropic, a lui Dario Amodei, dă în judecată guvernul SUA, afirmând că Pentagonul a ripostat din cauza măsurilor de protecție pentru siguranța AI

Anthropic se confruntă cu Departamentul Apărării într-un proces istoric privind IA

Potrivit mai multor relatări, Anthropic a depus două procese pe 9 martie la o instanță federală, contestând acțiuni întreprinse de Departamentul Apărării al SUA și de administrația Trump, susținând că guvernul a ripostat ilegal împotriva companiei după ce aceasta a refuzat să elimine măsurile de protecție din sistemul său de inteligență artificială Claude. Procesele vizează o desemnare care se aplică de obicei adversarilor străini suspectați de spionaj sau sabotaj, nu firmelor tehnologice interne.

Disputa își are originea în negocierile contractuale dintre Anthropic și Pentagon cu privire la modul în care modelul IA Claude al companiei ar putea fi folosit de agențiile de apărare ale SUA. Anthropic susținuse anterior inițiative de securitate națională și a devenit prima companie de IA de frontieră care a implementat modele pe rețelele guvernamentale clasificate ale SUA în iunie 2024, ajutând analiștii și planificatorii militari la revizuirea informațiilor, simulări, planificare operațională și activități de securitate cibernetică.

Tensiunile au escaladat când Departamentul Apărării a cerut acces nerestricționat la Claude pentru „toate scopurile legale” ca parte a reînnoirii contractului. Anthropic a acceptat majoritatea condițiilor, dar a insistat asupra a două restricții: interzicerea utilizării IA-ului său pentru supravegherea internă în masă a americanilor și împiedicarea implementării în sisteme de arme letale complet autonome.

Conducerea companiei a susținut că aceste garanții sunt necesare deoarece modelele actuale de IA de frontieră rămân prea nesigure pentru arme autonome și deoarece programele de supraveghere la scară largă ar putea intra în conflict cu protecțiile constituționale. Anthropic a declarat că restricțiile nu au interferat niciodată cu vreo misiune militară în timpul colaborării sale anterioare cu guvernul.

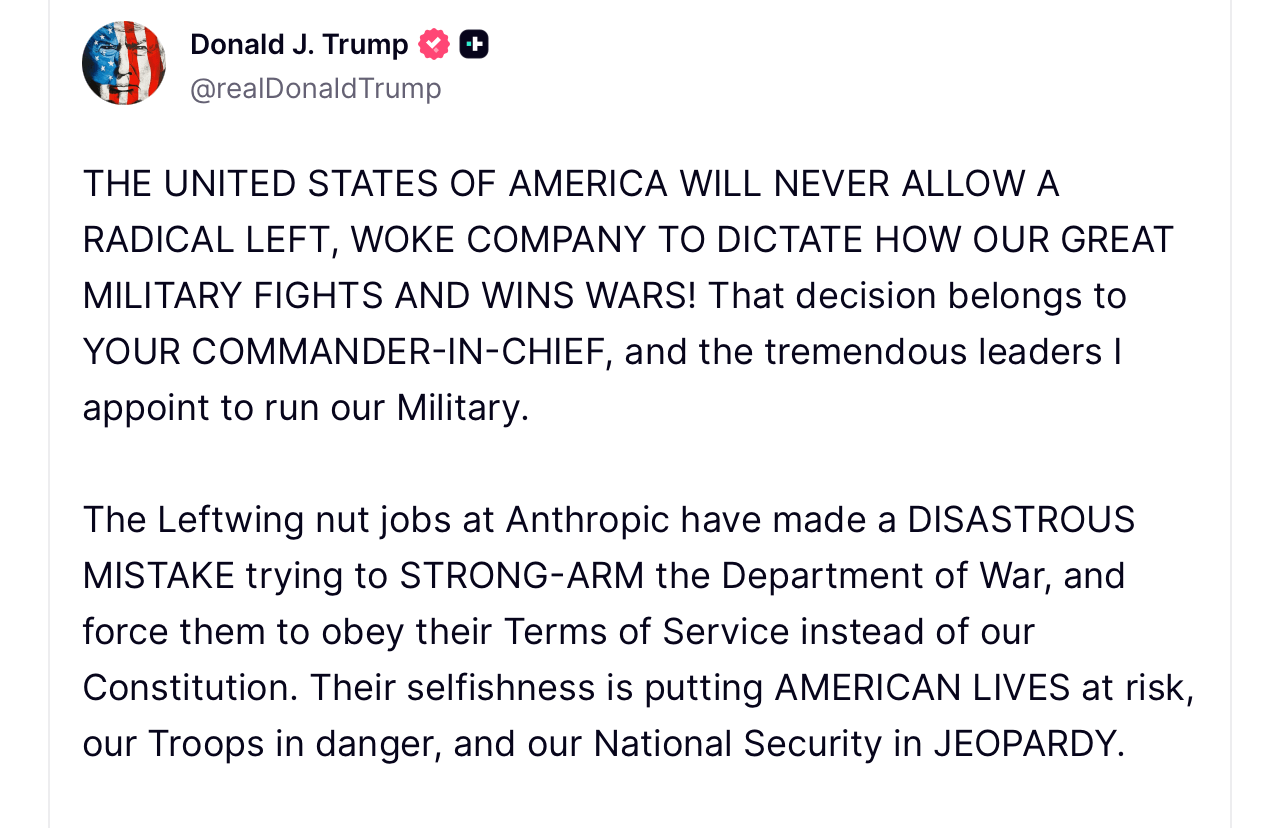

Negocierile s-au prăbușit în urma unei întâlniri din 24 februarie între CEO-ul Anthropic, Dario Amodei, și secretarul apărării Pete Hegseth. Câteva zile mai târziu, pe 27 februarie, președintele Donald Trump a postat pe Truth Social, îndrumând agențiile federale să „înceteze imediat” utilizarea tehnologiei Anthropic, descriind dependența continuă de companie drept o „greșeală dezastruoasă”.

La scurt timp după aceea, Hegseth a inițiat clasificarea Anthropic drept risc pentru lanțul de aprovizionare în temeiul autorității federale de achiziții publice prevăzute în 10 U.S.C. § 3252. Desemnarea, confirmată într-o scrisoare trimisă companiei în jurul datei de 4 martie, restricționează anumiți contractori guvernamentali să folosească tehnologii considerate vulnerabile la sabotaj sau influență străină.

Anthropic susține că această măsură întinde statutul cu mult dincolo de scopul său intenționat. În documentele depuse la instanță, compania afirmă că desemnarea a fost concepută pentru amenințări de securitate cu legături străine, nu pentru neînțelegeri de politică publică cu furnizori interni. Procesele susțin că guvernul nu a folosit „mijloacele cele mai puțin restrictive” cerute de lege și, în schimb, a impus ceea ce compania descrie drept o listă neagră neoficială.

Documentele juridice ridică și îngrijorări constituționale. Anthropic susține că desemnarea încalcă Primul Amendament, pedepsind compania pentru faptul că a susținut public limitarea utilizărilor IA, precum armele autonome și supravegherea internă. Potrivit plângerii, etichetarea firmei drept risc la adresa securității naționale îi afectează reputația și ar putea pune în pericol contracte de sute de milioane de dolari.

Anthropic solicită instanțelor să blocheze aplicarea desemnării, să ordone agențiilor federale să retragă directivele care opresc afacerile cu compania și să prevină acțiuni similare în viitor. Compania a spus că obiectivul său nu este să forțeze guvernul să îi cumpere tehnologia, ci să prevină represaliile din cauza diferențelor de politică.

„Solicitarea controlului judiciar nu schimbă angajamentul nostru de lungă durată de a valorifica IA pentru a ne proteja securitatea națională”, a spus un purtător de cuvânt al Anthropic într-o declarație. „Dar acesta este un pas necesar pentru a ne proteja afacerea, clienții și partenerii.”

Oficialii Pentagonului nu au comentat public litigiul, invocând politica privind cazurile aflate pe rol. Unii lideri din domeniul apărării au susținut anterior că agențiile militare trebuie să păstreze autoritate operațională deplină asupra tehnologiilor contractorilor în timpul situațiilor de urgență și nu pot permite furnizorilor să dicteze modul în care sunt folosite sistemele.

Weekendul sălbatic al AI: zguduirea OpenAI, confruntarea cu Pentagonul și roboți care refuză să moară

Schimbările provocate de AI vin rapid: drama de la OpenAI, ciocnirea Pentagonului cu Anthropic, lansarea GPT-5.4, roboți care se auto-repară și noi instrumente de securitate. read more.

Citește acum

Weekendul sălbatic al AI: zguduirea OpenAI, confruntarea cu Pentagonul și roboți care refuză să moară

Schimbările provocate de AI vin rapid: drama de la OpenAI, ciocnirea Pentagonului cu Anthropic, lansarea GPT-5.4, roboți care se auto-repară și noi instrumente de securitate. read more.

Citește acum

Weekendul sălbatic al AI: zguduirea OpenAI, confruntarea cu Pentagonul și roboți care refuză să moară

Citește acumSchimbările provocate de AI vin rapid: drama de la OpenAI, ciocnirea Pentagonului cu Anthropic, lansarea GPT-5.4, roboți care se auto-repară și noi instrumente de securitate. read more.

Disputa survine pe fondul intensificării cursei pentru obținerea contractelor militare de IA. Firme rivale, inclusiv OpenAI, au ajuns la acorduri cu Pentagonul aproximativ în același timp în care negocierile cu Anthropic s-au destrămat. Între timp, parteneri tehnologici majori precum Google și Microsoft au indicat că intenționează să continue colaborarea cu Anthropic pe servicii comerciale fără legătură cu apărarea.

Analiștii din industrie spun că rezultatul cazului ar putea stabili un precedent pentru modul în care guvernul federal pune presiune pe companiile de IA să își modifice politicile de siguranță atunci când sunt implicate interese de securitate națională. Deocamdată, produsele pentru consumatori și serviciile comerciale de IA ale Anthropic rămân disponibile, în timp ce bătălia juridică privind desemnarea Pentagonului își începe parcursul prin instanțe.

Întrebări frecvente 🧭

- De ce a dat Anthropic în judecată guvernul SUA?

Anthropic a depus procese susținând că Pentagonul a etichetat ilegal compania drept un risc pentru lanțul de aprovizionare al securității naționale după ce aceasta a refuzat să elimine restricțiile de siguranță ale IA. - Ce a declanșat disputa dintre Anthropic și Pentagon?

Conflictul a început în timpul negocierilor contractuale, când Departamentul Apărării a cerut utilizarea nerestricționată a sistemului IA Claude al Anthropic. - Ce înseamnă desemnarea „risc pentru lanțul de aprovizionare”?

Eticheta poate limita contractorii guvernamentali să folosească tehnologia unei companii dacă oficialii cred că aceasta prezintă riscuri de securitate sau de achiziții. - Vor funcționa în continuare serviciile IA ale Anthropic pe durata procesului?

Da, produsele comerciale de IA ale Anthropic și serviciile pentru consumatori rămân disponibile în timp ce cazul juridic avansează.