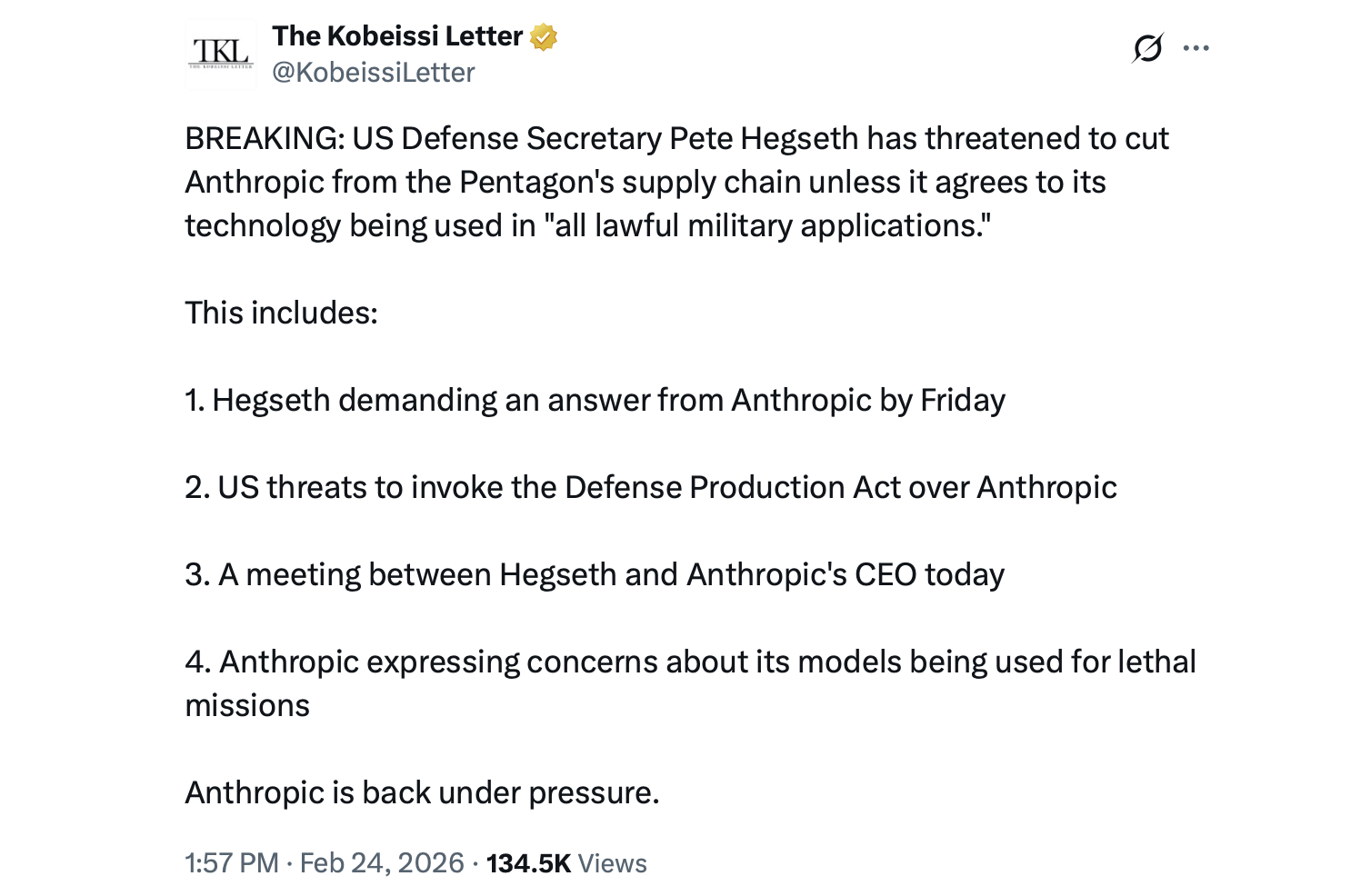

O Secretário de Defesa Pete Hegseth se reuniu com o CEO da Anthropic, Dario Amodei, no Pentágono na terça-feira, enquanto o Departamento de Defesa pressionava a Anthropic a remover restrições do seu sistema de inteligência artificial (IA) Claude ou enfrentar possíveis penalidades.

Relatório: Claude AI da Anthropic enfrenta um futuro incerto em sistemas classificados do Pentágono

Governança de IA Militar Posta à Prova em Reunião de Alto Risco no Pentágono

A reunião de 24 de fevereiro ocorreu após semanas de tensão sobre as políticas de uso da Anthropic para o Claude, o grande modelo de linguagem integrado a redes classificadas do Departamento de Defesa sob um contrato-piloto de 2025 avaliado em até US$ 200 milhões. O Claude é atualmente o único grande modelo de linguagem totalmente autorizado operando em certos sistemas seguros do Pentágono.

De acordo com a reportagem da Axios, Hegseth, acompanhado pelo vice-secretário Steve Feinberg e pelo consultor jurídico-geral Earl Matthews, se opôs às restrições da Anthropic sobre vigilância em massa de americanos e sobre sistemas de armas totalmente autônomos operando sem supervisão humana. Autoridades de Defesa argumentaram que esses limites restringem aplicações militares legais e não deveriam se sobrepor à autoridade do Congresso e do Executivo.

A Anthropic sustentou que suas salvaguardas são projetadas para evitar uso indevido, ao mesmo tempo em que ainda possibilitam aplicações de segurança nacional. A empresa diz que suas políticas não bloqueiam o uso militar legítimo, mas proíbem atividades como rastrear indivíduos sem consentimento ou empregar sistemas letais sem controle humano.

“De acordo com uma fonte familiarizada com as conversas, a Anthropic nunca se opôs ao uso de seus modelos para ‘operações militares legítimas’”, relatou no X a correspondente-chefe de Segurança Nacional da Fox News, Jennifer Griffin. “Também disse a Hegseth que nunca reclamou ao Pentágono ou à Palantir sobre o uso de seus modelos na incursão contra Maduro.”

O Claude tem sido usado para análise de inteligência, defesa cibernética e planejamento operacional. Relatos indicam que ele apoiou o planejamento e a análise em tempo real durante a operação de 3 de janeiro que resultou na captura do presidente venezuelano Nicolás Maduro. A Anthropic posteriormente buscou esclarecimentos sobre o envolvimento do modelo como parte de uma revisão interna de conformidade, o que autoridades do Pentágono interpretaram como crítica.

Em 9 de janeiro, Hegseth emitiu um memorando instando fornecedores de inteligência artificial (IA) a remover o que descreveu como condições restritivas. Essa diretriz preparou o terreno para renegociações e, por fim, para a reunião de 24 de fevereiro.

O Pentágono estabeleceu um prazo até 27 de fevereiro para que a Anthropic modifique seus termos. Possíveis respostas incluem invocar a Lei de Produção de Defesa (Defense Production Act) para compelir a conformidade ou designar a Anthropic como um risco para a cadeia de suprimentos, um passo que poderia exigir que contratantes se desfizessem de sistemas relacionados ao Claude.

As autoridades reconhecem que desvincular o Claude da infraestrutura existente seria operacionalmente complexo. Ainda assim, o departamento tem alternativas. Concorrentes como a xAI com seu modelo Grok, a OpenAI com o ChatGPT, e o Google com o Gemini estão sob contratos semelhantes com o Departamento de Defesa e podem estar posicionados para expandir seus papéis se as conversas fracassarem.

A disputa destaca questões mais amplas sobre governança de IA em ambientes militares, particularmente à medida que a lei federal continua a evoluir em torno de tecnologias emergentes. Em jogo está se desenvolvedores privados de IA podem manter políticas éticas independentes quando seus sistemas passam a ficar incorporados a operações de segurança nacional.

A reação nas plataformas de mídia social tem sido notavelmente franca. “A vigilância sem mandado está de volta”, um usuário do X escreveu em resposta à publicação de Griffin no X. “Isso precisa ser uma notícia muito maior do que está sendo. Há uma chance séria de violações constitucionais”, outro respondeu no texto de Griffin. Outros, com uma dose de humor sombrio, brincaram que a chegada da Skynet talvez não esteja tão distante. “Skynet está aqui… a linha do tempo de 2029 está ATIVA”, comentou a pessoa.

Ambos os lados caracterizaram a discussão de 24 de fevereiro como substancial. Se a Anthropic ajustará suas salvaguardas antes do prazo pode determinar o futuro de uma das integrações de IA mais avançadas do Pentágono.

FAQ 🤖

- O que foi discutido na reunião do Pentágono em 24 de fevereiro?

A reunião se concentrou nas restrições da Anthropic ao Claude IA e se elas limitam aplicações militares legais. - Por que o Pentágono está pressionando a Anthropic?

Autoridades de Defesa argumentam que as salvaguardas da empresa interferem em usos autorizados de segurança nacional. - O que pode acontecer se a Anthropic não cumprir?

O Pentágono pode invocar a Lei de Produção de Defesa (Defense Production Act) ou designar a empresa como um risco para a cadeia de suprimentos. - Há alternativas ao Claude?

Sim, modelos da xAI, OpenAI e Google estão sob contratos do Departamento de Defesa e podem se expandir se necessário.