Uma experiência de IA descentralizada, antes restrita aos círculos de criptomoedas, acaba de receber o apoio público do CEO da Nvidia, Jensen Huang, sinalizando que o treinamento de modelos distribuídos pode estar se aproximando cada vez mais do mainstream.

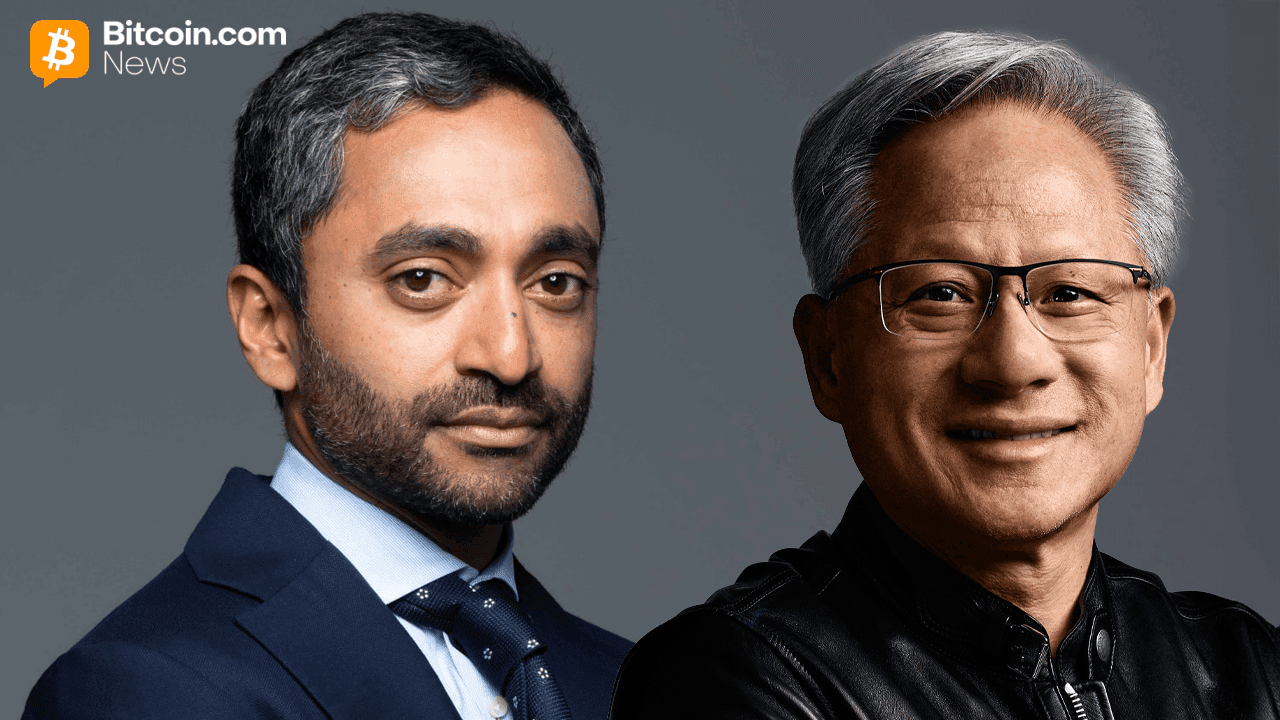

Marco na formação da Bittensor atrai a atenção de Chamath Palihapitiya e do CEO da Nvidia, Jensen Huang

O impulso da IA de código aberto cresce com o apoio do CEO da Nvidia

Chamath Palihapitiya destacou o Covenant-72B da Bittensor durante um episódio do podcast All-In, apresentando-o como um exemplo concreto de inteligência artificial (IA) descentralizada indo além da teoria. A Bittensor opera como uma rede descentralizada, impulsionada por blockchain, que estabelece um mercado peer-to-peer no qual modelos de aprendizado de máquina e computação de IA são trocados e incentivados.

Palihapitiya descreveu a iniciativa em termos simples: um modelo de linguagem em grande escala (LLM) treinado sem infraestrutura centralizada, alimentado, em vez disso, por uma rede de colaboradores independentes. “Eles conseguiram treinar um modelo LLaMA de 4 bilhões de parâmetros, totalmente distribuído, com várias pessoas contribuindo com o excesso de computação”, disse ele, chamando-o de “uma conquista técnica bem louca”.

A comparação resultou em uma analogia familiar. “Existem pessoas aleatórias, e cada uma recebe uma pequena parcela”, acrescentou Palihapitiya, referindo-se ao projeto pioneiro de computação distribuída que aproveitava hardware ocioso em todo o mundo.

Huang não descartou a ideia. Em vez disso, ele se inclinou para uma visão mais ampla do mercado de IA, sugerindo que abordagens descentralizadas e proprietárias não são mutuamente exclusivas. “Essas duas coisas não são A ou B; são A e B”, disse Huang. “Não há dúvida sobre isso.”

Essa visão de duas vertentes reflete uma divisão crescente — e uma sobreposição — dentro da IA. De um lado estão sistemas fechados e altamente refinados, como ChatGPT, Claude e Gemini. Do outro, estão modelos abertos e descentralizados que permitem que desenvolvedores e organizações personalizem sistemas para necessidades específicas.

Huang deixou claro que vê ambas as vertentes como essenciais. “Modelos são uma tecnologia, não um produto”, disse ele, observando que a maioria dos usuários continuará confiando em sistemas refinados e de uso geral, em vez de construir os seus próprios do zero.

Ao mesmo tempo, ele apontou para setores em que a personalização não é opcional. “Existem todos esses setores em que a expertise de domínio… precisa ser capturada de uma forma que eles possam controlar”, explicou Huang, acrescentando que “isso só pode vir de modelos abertos”.

Essa afirmação se encaixa perfeitamente no campo de atuação da Bittensor. O Covenant-72B, desenvolvido por meio de sua Subnet 3 (Templar), representa uma das maiores execuções de treinamento descentralizadas até o momento, coordenando mais de 70 colaboradores por meio de conexões padrão de internet, sem uma autoridade central.

Tecnicamente, o modelo ultrapassa limites. Construído com 72 bilhões de parâmetros e treinado em cerca de 1,1 trilhão de tokens, ele aproveita inovações como protocolos de comunicação compactados e paralelismo de dados distribuídos para viabilizar o treinamento fora dos data centers tradicionais.

As métricas de desempenho sugerem que não se trata de algo meramente experimental. Os resultados dos benchmarks o colocam em concorrência com modelos centralizados já estabelecidos, um detalhe que ajuda a explicar por que o projeto atraiu atenção além do público nativo de criptomoedas.

O mercado também percebeu isso. Após o anúncio, o token do projeto, o TAO, subiu 24% desde que o vídeo de Palihapitiya e Huang circulou nas redes sociais.

A Nvidia impulsiona os planos da Nebius para a fábrica de IA com um investimento maciço de US$ 2 bilhões

Descubra como a Nvidia está remodelando o futuro da computação com um investimento de US$ 2 bilhões em infraestrutura de IA na nuvem. read more.

Leia agora

A Nvidia impulsiona os planos da Nebius para a fábrica de IA com um investimento maciço de US$ 2 bilhões

Descubra como a Nvidia está remodelando o futuro da computação com um investimento de US$ 2 bilhões em infraestrutura de IA na nuvem. read more.

Leia agora

A Nvidia impulsiona os planos da Nebius para a fábrica de IA com um investimento maciço de US$ 2 bilhões

Leia agoraDescubra como a Nvidia está remodelando o futuro da computação com um investimento de US$ 2 bilhões em infraestrutura de IA na nuvem. read more.

Ainda assim, os comentários de Huang sugerem que a verdadeira história não é a ruptura, mas a coexistência entre os dois. Os sistemas de IA proprietários provavelmente continuarão dominantes para usuários em geral, enquanto modelos abertos e descentralizados conquistarão espaço em aplicações especializadas, sensíveis ao custo ou orientadas pela soberania.

Para as startups, o CEO da Nvidia delineou um roteiro pragmático: comece de forma aberta e, depois, incorpore vantagens proprietárias. “Todas as startups nas quais estamos investindo agora são, em primeiro lugar, de código aberto e, depois, seguem para o modelo proprietário”, disse ele.

Em outras palavras, o futuro da IA pode não pertencer a uma única arquitetura ou filosofia. Ele pode pertencer àqueles que conseguem navegar entre ambas — e sabem quando usar cada uma.

Perguntas frequentes 🔎

- O que é o Covenant-72B da Bittensor?

Um modelo de linguagem com 72 bilhões de parâmetros treinado por meio de uma rede descentralizada de colaboradores, sem infraestrutura centralizada. - O que Jensen Huang disse sobre IA descentralizada?

Ele afirmou que modelos de IA abertos e proprietários coexistirão, descrevendo a relação como “A e B”, e não como uma escolha entre eles. - Por que esse desenvolvimento é importante?

Isso mostra que modelos de IA em grande escala podem ser treinados fora dos data centers tradicionais, desafiando suposições sobre as necessidades de infraestrutura. - Como isso afeta o setor de IA?

Isso sustenta um futuro híbrido, no qual plataformas centralizadas e modelos descentralizados desempenham funções diferentes em diversos setores.