A Anthropic tomou a medida extraordinária de processar o governo dos EUA após o Pentágono rotular a empresa de inteligência artificial (IA) como um “risco para a cadeia de suprimentos à segurança nacional”, desencadeando um confronto jurídico que pode remodelar como Washington controla fornecedores de inteligência artificial que trabalham com os militares.

Anthropic, de Dario Amodei, processa o governo dos EUA, alegando que o Pentágono retaliou por causa de proteções de segurança em IA

Anthropic Enfrenta o Departamento de Defesa em Processo Histórico sobre IA

De acordo com vários relatos, a Anthropic entrou com dois processos em 9 de março em um tribunal federal, contestando ações tomadas pelo Departamento de Defesa dos EUA e pela administração Trump, argumentando que o governo retaliou ilegalmente contra a empresa depois que ela se recusou a remover salvaguardas do seu sistema de inteligência artificial Claude. As ações miram uma designação que normalmente se aplica a adversários estrangeiros suspeitos de espionagem ou sabotagem, e não a empresas domésticas de tecnologia.

A disputa remonta às negociações contratuais entre a Anthropic e o Pentágono sobre como o modelo de IA Claude da empresa poderia ser usado por agências de defesa dos EUA. A Anthropic já havia apoiado iniciativas de segurança nacional e se tornou a primeira empresa de IA de fronteira a implantar modelos em redes governamentais classificadas dos EUA em junho de 2024, auxiliando analistas e planejadores militares com revisão de inteligência, simulações, planejamento operacional e trabalho de cibersegurança.

As tensões aumentaram quando o Departamento de Defesa exigiu acesso irrestrito ao Claude para “todos os fins legais” como parte de uma renovação contratual. A Anthropic concordou com a maioria das condições, mas insistiu em duas restrições: proibir o uso de sua IA para vigilância doméstica em massa de americanos e impedir a implantação em sistemas de armas letais totalmente autônomos.

Executivos da empresa argumentaram que esses limites eram necessários porque os atuais modelos de IA de fronteira ainda são pouco confiáveis demais para armas autônomas e porque programas de vigilância em grande escala poderiam conflitar com proteções constitucionais. A Anthropic afirmou que as restrições nunca interferiram em nenhuma missão militar durante seu trabalho anterior com o governo.

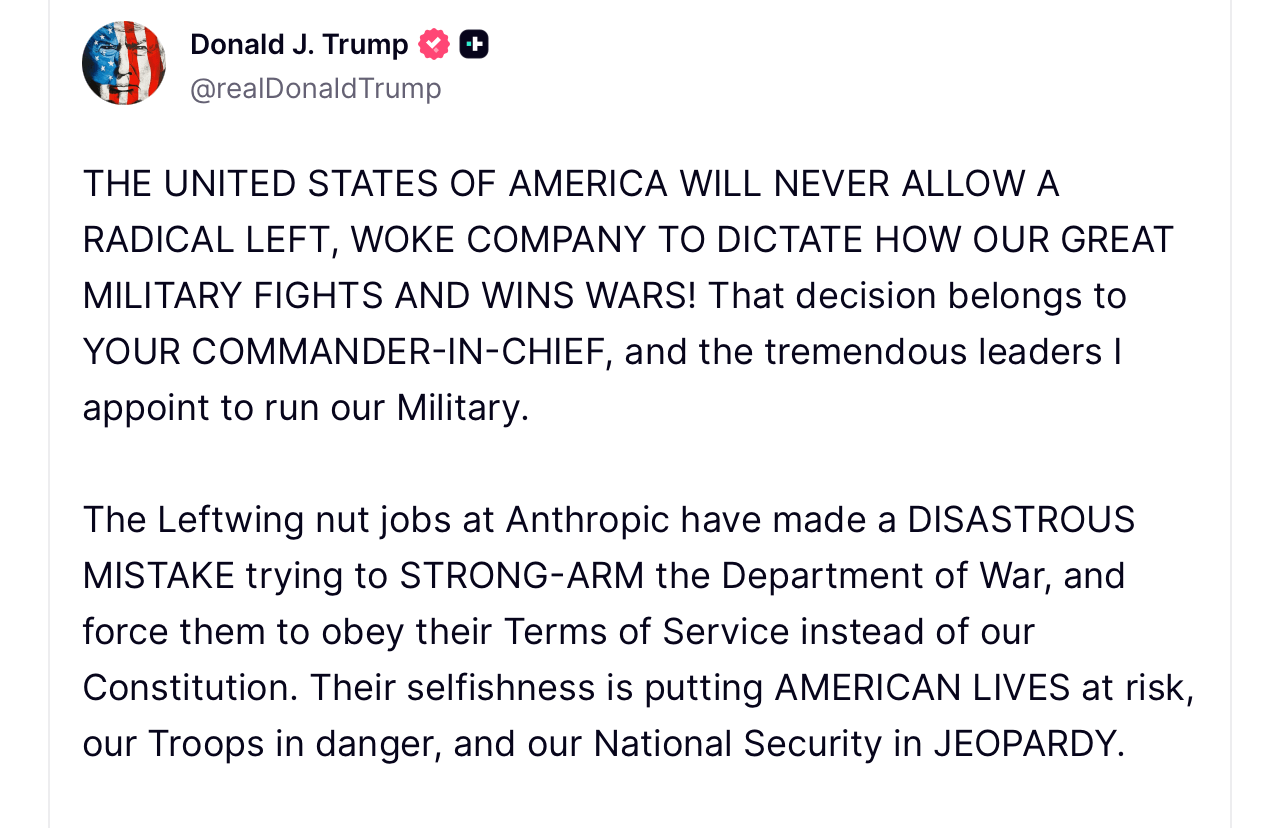

As negociações colapsaram após uma reunião em 24 de fevereiro entre o CEO da Anthropic, Dario Amodei, e o Secretário de Defesa Pete Hegseth. Dias depois, em 27 de fevereiro, o presidente Donald Trump publicou no Truth Social, instruindo agências federais a “cessarem imediatamente” o uso da tecnologia da Anthropic, descrevendo a continuidade da dependência da empresa como um “erro desastroso”.

Logo depois, Hegseth se moveu para classificar a Anthropic como um risco de cadeia de suprimentos sob a autoridade federal de compras descrita em 10 U.S.C. § 3252. A designação, confirmada em uma carta enviada à empresa por volta de 4 de março, restringe certos contratados do governo de usar tecnologia considerada vulnerável a sabotagem ou influência estrangeira.

A Anthropic argumenta que a medida estica o estatuto muito além de seu propósito pretendido. Em documentos judiciais, a empresa sustenta que a designação foi concebida para ameaças de segurança ligadas ao exterior, e não para divergências de política com fornecedores domésticos. Os processos alegam que o governo não usou os “meios menos restritivos” exigidos por lei e, em vez disso, impôs o que a empresa descreve como uma lista negra não oficial.

Os documentos legais também levantam preocupações constitucionais. A Anthropic argumenta que a designação viola a Primeira Emenda ao punir a empresa por defender publicamente limites para usos de IA, como armas autônomas e vigilância doméstica. De acordo com a queixa, rotular a empresa como um risco à segurança nacional prejudica sua reputação e pode ameaçar centenas de milhões de dólares em contratos.

A Anthropic está pedindo aos tribunais que bloqueiem a aplicação da designação, ordenem que agências federais retirem diretrizes que interrompem negócios com a empresa e evitem ações semelhantes no futuro. A empresa disse que seu objetivo não é forçar o governo a comprar sua tecnologia, mas impedir retaliação por diferenças de política.

“Buscar revisão judicial não altera nosso compromisso de longa data de aproveitar a IA para proteger nossa segurança nacional”, disse um porta-voz da Anthropic em uma declaração. “Mas este é um passo necessário para proteger nosso negócio, nossos clientes e nossos parceiros.”

Autoridades do Pentágono não comentaram publicamente sobre o litígio, citando política referente a casos judiciais em andamento. Alguns líderes de defesa já argumentaram anteriormente que agências militares devem manter plena autoridade operacional sobre tecnologias de contratados durante emergências e não podem permitir que fornecedores ditem como os sistemas são usados.

Fim de Semana Selvagem da IA: Reviravolta na OpenAI, Confronto com o Pentágono e Robôs que se Recusam a Morrer

Mudanças na IA acontecem rapidamente: drama na OpenAI, choque do Pentágono com a Anthropic, lançamento do GPT-5.4, robôs autorregenerativos e novas ferramentas de segurança. read more.

Leia agora

Fim de Semana Selvagem da IA: Reviravolta na OpenAI, Confronto com o Pentágono e Robôs que se Recusam a Morrer

Mudanças na IA acontecem rapidamente: drama na OpenAI, choque do Pentágono com a Anthropic, lançamento do GPT-5.4, robôs autorregenerativos e novas ferramentas de segurança. read more.

Leia agora

Fim de Semana Selvagem da IA: Reviravolta na OpenAI, Confronto com o Pentágono e Robôs que se Recusam a Morrer

Leia agoraMudanças na IA acontecem rapidamente: drama na OpenAI, choque do Pentágono com a Anthropic, lançamento do GPT-5.4, robôs autorregenerativos e novas ferramentas de segurança. read more.

A disputa chega enquanto a corrida para garantir contratos militares de IA se intensifica. Empresas rivais, incluindo a OpenAI, chegaram a acordos com o Pentágono por volta do mesmo período em que as negociações com a Anthropic fracassaram. Enquanto isso, grandes parceiros de tecnologia como Google e Microsoft indicaram que pretendem continuar trabalhando com a Anthropic em serviços comerciais não relacionados à defesa.

Analistas do setor dizem que o desfecho do caso pode estabelecer um precedente sobre como o governo federal pressiona empresas de IA a modificar políticas de segurança quando interesses de segurança nacional estão envolvidos. Por enquanto, os produtos ao consumidor e os serviços comerciais de IA da Anthropic permanecem disponíveis, enquanto a batalha jurídica sobre a designação do Pentágono começa a tramitar pelos tribunais.

FAQ 🧭

- Por que a Anthropic processou o governo dos EUA?

A Anthropic entrou com processos alegando que o Pentágono rotulou ilegalmente a empresa como um risco à cadeia de suprimentos da segurança nacional após ela se recusar a remover restrições de segurança de IA. - O que desencadeou a disputa entre a Anthropic e o Pentágono?

O conflito começou durante negociações contratuais quando o Departamento de Defesa exigiu uso irrestrito do sistema de IA Claude da Anthropic. - O que significa a designação de “risco para a cadeia de suprimentos”?

O rótulo pode limitar contratados do governo de usar a tecnologia de uma empresa se autoridades acreditarem que ela apresenta riscos de segurança ou de compras. - Os serviços de IA da Anthropic continuarão operando durante o processo?

Sim, os produtos comerciais de IA e os serviços ao consumidor da Anthropic permanecem disponíveis enquanto o caso judicial prossegue.

Tags nesta história

Escolhas de Jogos Bitcoin

425% até 5 BTC + 100 Rodadas Grátis