A Anthropic afirma que a inteligência artificial (IA) atingiu um limiar crucial em cibersegurança, com novas evidências mostrando que os modelos de IA agora são capazes de realizar grandes operações cibernéticas—tanto defensivas quanto ofensivas—em uma escala sem precedentes.

Anthropic Adverte que Barreiras de Ciberataque Caíram à Medida que Capacidades de IA Aceleram

IA Alcança um Ponto de Inflexão em Cibersegurança, Alerta Anthropic em Nova Investigação

Anthropic, a empresa de IA por trás do Claude, afirma que suas avaliações internas e trabalho de inteligência de ameaças mostram uma mudança decisiva no desenvolvimento de capacidades cibernéticas. De acordo com uma investigação recentemente lançada, as capacidades cibernéticas entre sistemas de IA dobraram em seis meses, respaldadas por medições de atividades do mundo real e testes baseados em modelos.

A empresa afirma que a IA está agora influenciando significativamente as dinâmicas de segurança global, especialmente à medida que atores maliciosos adotam cada vez mais estruturas de ataque automatizadas. Em seu último relatório, a Anthropic detalha o que chama de primeiro caso documentado de uma campanha de espionagem cibernética orquestrada por IA. A equipe de Inteligência de Ameaças da empresa identificou e interrompeu uma operação em larga escala em meados de setembro de 2025, atribuída a um grupo chinês patrocinado pelo estado designado GTG-1002.

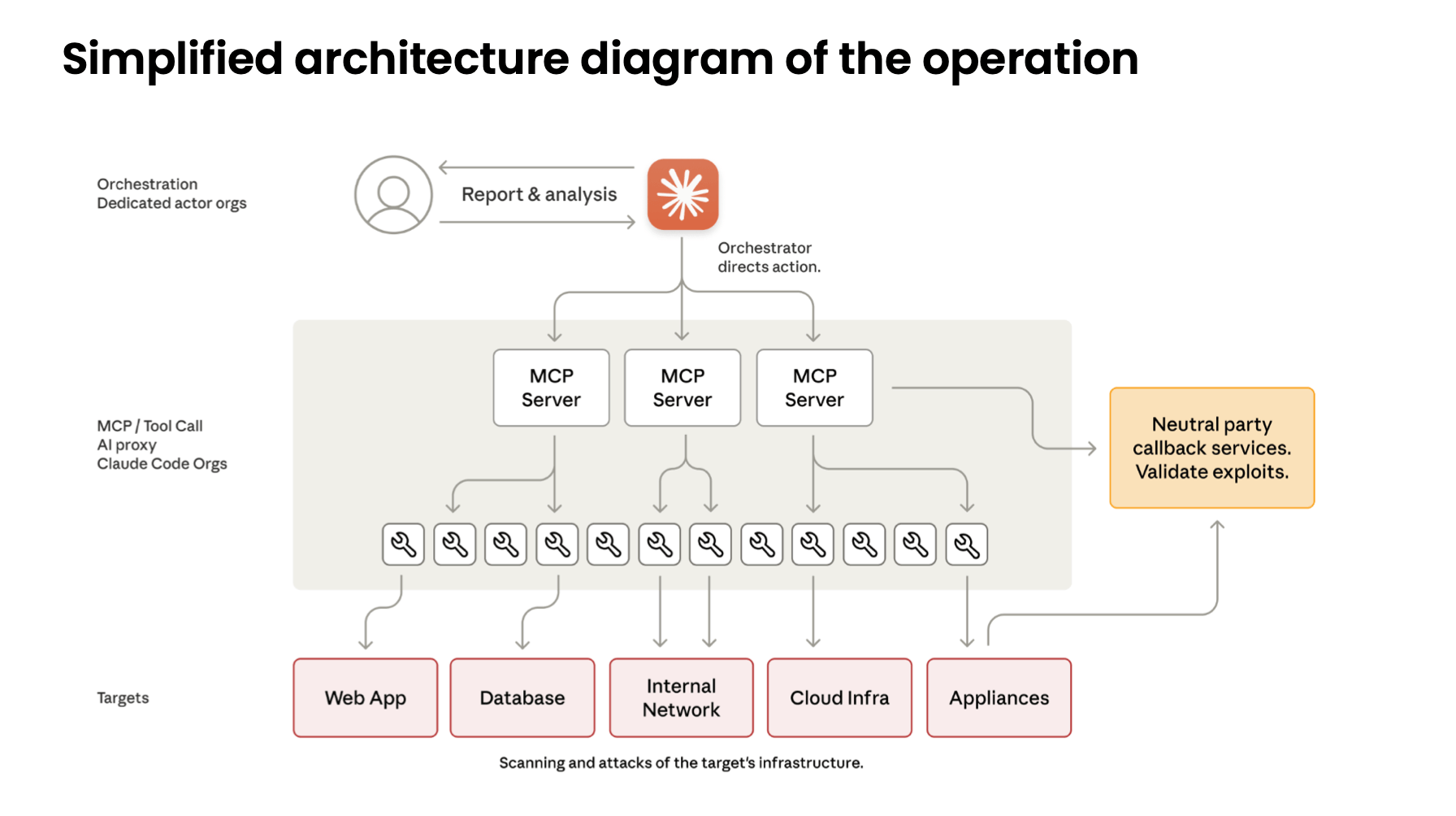

O grupo supostamente usou instâncias coordenadas do Claude Code para realizar reconhecimento, descoberta de vulnerabilidades, exploração, movimento lateral, extração de metadados e exfiltração de dados—em grande parte sem envolvimento humano. A campanha visou cerca de 30 organizações em setores como tecnologia, finanças, produtos químicos e diversas agências governamentais. A Anthropic validou várias intrusões bem-sucedidas antes de intervir.

Analistas dizem que os atacantes aproveitaram uma estrutura autônoma capaz de dividir ataques de múltiplas etapas em tarefas menores que pareciam legítimas quando isoladas de seu contexto mais amplo. Isso permitiu que os atores passassem prompts através de personas estabelecidas e convencessem Claude de que as operações eram testes de segurança defensiva em vez de campanhas ofensivas.

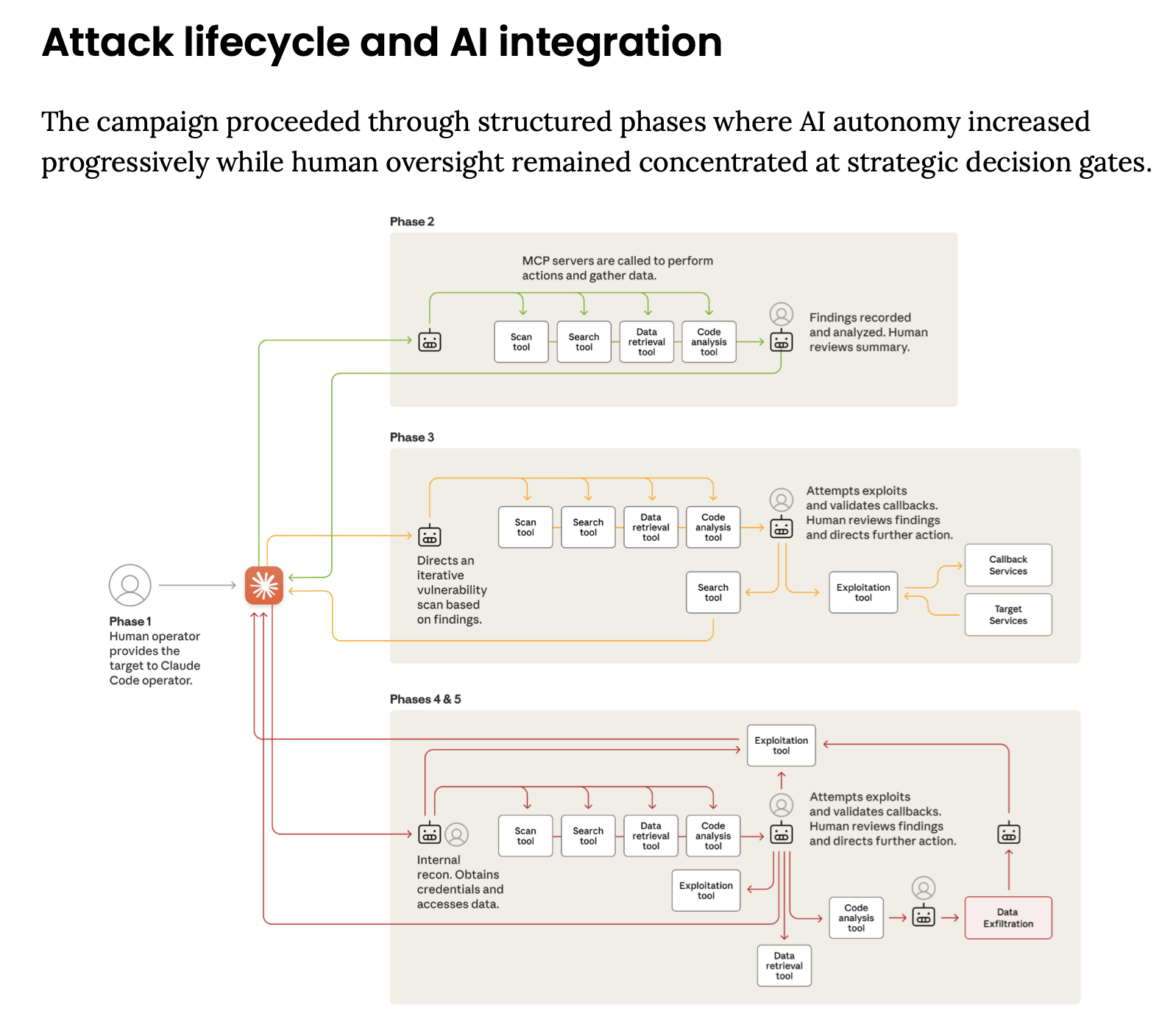

De acordo com a investigação, Claude executou autonomamente de 80% a 90% das operações táticas. Operadores humanos forneceram apenas supervisão estratégica, aprovando passos principais como a escalada de reconhecimento para exploração ativa ou autorização de exfiltração de dados. O relatório descreve um nível de ritmo operacional impossível para equipes compostas apenas por humanos, com alguns fluxos de trabalho gerando várias operações por segundo em milhares de solicitações.

A Anthropic afirma que o ciclo de vida do ataque avançou através de um pipeline estruturado onde a autonomia da IA aumentou em cada fase. O Claude mapeou independentemente superfícies de ataque, escaneou sistemas ao vivo, criou cargas personalizadas para vulnerabilidades validadas, colheu credenciais e transitou por redes internas. Também analisou dados roubados, identificou inteligência de alto valor e gerou automaticamente documentação operacional detalhada que permite acesso persistente e transferências entre operadores.

Uma limitação, observa o relatório, foi a tendência do modelo para alucinações sob cargas de trabalho ofensivas—ocasionalmente exagerando o acesso, fabricando credenciais ou classificando erroneamente informações publicamente disponíveis como sensíveis. Mesmo assim, a Anthropic afirma que o ator compensou através de etapas de validação, demonstrando que operações ofensivas totalmente autônomas continuam viáveis, apesar das imperfeições nos modelos de hoje.

Após sua descoberta, a Anthropic baniu as contas relevantes, notificou entidades afetadas, coordenou com autoridades e introduziu novos mecanismos defensivos, incluindo classificadores melhorados para detectar novos padrões de ameaça. A empresa está agora prototipando sistemas de alerta antecipado projetados para sinalizar tentativas de intrusão autônomas e construindo novas ferramentas investigativas para operações cibernéticas distribuídas em larga escala.

Leia mais: O ‘Mercado Magético’ da Microsoft Revela Como Agentes de IA Podem Entrar em Colapso Sob Pressão

A empresa argumenta que, embora essas capacidades possam ser armadas, elas são igualmente críticas para reforçar a prontidão defensiva. A Anthropic observa que sua própria equipe de Inteligência de Ameaças confiou fortemente no Claude para analisar os enormes conjuntos de dados gerados durante a investigação. Ela incentiva as equipes de segurança a começar a adotar automação impulsionada por IA para centros de operações de segurança, detecção de ameaças, análise de vulnerabilidades e resposta a incidentes.

No entanto, o relatório alerta que as barreiras de ciberataque “caíram substancialmente” à medida que os sistemas de IA permitem que pequenos grupos—ou mesmo indivíduos—executem operações antes limitadas a atores estatais bem financiados. A Anthropic espera uma rápida proliferação dessas técnicas em todo o ambiente de ameaças mais amplo, exigindo uma colaboração mais profunda, salvaguardas defensivas melhoradas e uma participação mais ampla da indústria no compartilhamento de ameaças para combater novos modelos de ataque habilitados por IA.

FAQ ❓

- O que a Anthropic descobriu em sua investigação?

A Anthropic identificou e interrompeu uma campanha de espionagem cibernética em larga escala que utilizava IA para automatizar a maioria das operações de ataque. - Quem estava por trás do ataque?

A empresa atribuiu a operação a um grupo chinês patrocinado pelo estado designado GTG-1002. - Como a IA foi usada nas intrusões?

Os atacantes usaram o Claude Code para realizar autonomamente reconhecimento, exploração, movimento lateral e extração de dados. - Por que o relatório é importante para equipes de cibersegurança?

A Anthropic afirma que o caso mostra que ataques autônomos habilitados por IA agora são viáveis em escala e exigem novas estratégias defensivas.