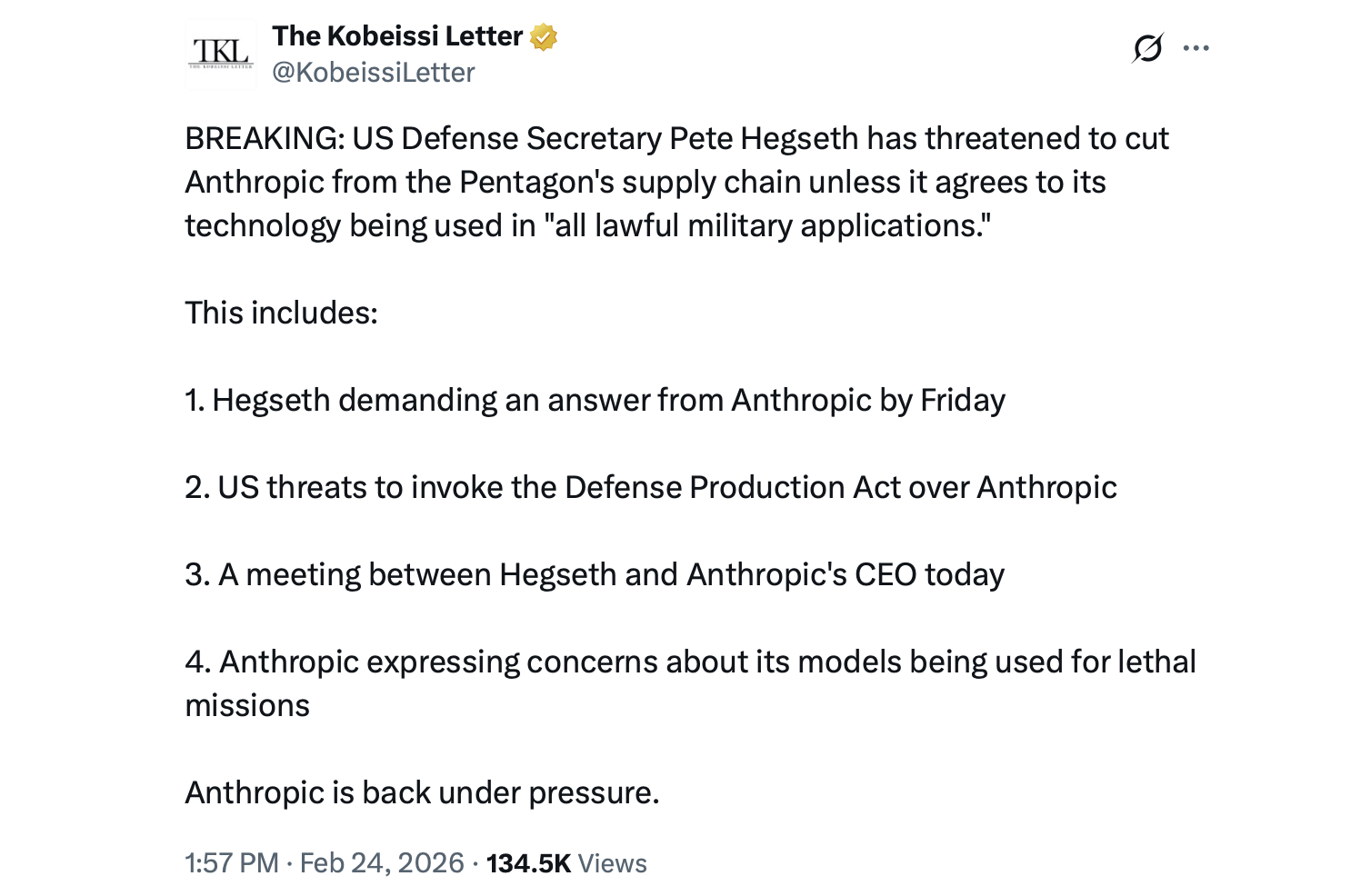

Sekretarz obrony Pete Hegseth spotkał się we wtorek w Pentagonie z dyrektorem generalnym Anthropic, Dario Amodeiem, gdy Departament Obrony naciskał na Anthropic, aby usunęło ograniczenia w swoim systemie sztucznej inteligencji (AI) Claude, w przeciwnym razie grożąc możliwymi sankcjami.

Raport: Claude AI firmy Anthropic stoi w obliczu niepewnej przyszłości w utajnionych systemach Pentagonu

Wysokiej stawki spotkanie w Pentagonie wystawia na próbę zarządzanie wojskową AI

Spotkanie z 24 lutego nastąpiło po tygodniach napięć wokół zasad użytkowania Claude w Anthropic — dużego modelu językowego zintegrowanego z utajnionymi sieciami Departamentu Obrony w ramach pilotażowego kontraktu na 2025 r., wycenionego na nawet 200 mln dolarów. Claude jest obecnie jedynym w pełni autoryzowanym dużym modelem językowym działającym w niektórych bezpiecznych systemach Pentagonu.

Według relacji Axios, Hegseth, któremu towarzyszyli zastępca sekretarza Steve Feinberg oraz radca prawny Earl Matthews, sprzeciwił się ograniczeniom Anthropic dotyczącym masowej inwigilacji Amerykanów oraz w pełni autonomicznych systemów uzbrojenia działających bez nadzoru człowieka. Urzędnicy obrony argumentowali, że te limity ograniczają legalne zastosowania wojskowe i nie powinny mieć pierwszeństwa przed uprawnieniami Kongresu i władzy wykonawczej.

Anthropic utrzymuje, że jego zabezpieczenia mają zapobiegać nadużyciom, a jednocześnie umożliwiać zastosowania w obszarze bezpieczeństwa narodowego. Firma twierdzi, że jej polityki nie blokują legalnego użycia wojskowego, lecz zakazują działań takich jak śledzenie osób bez ich zgody lub wdrażanie śmiercionośnych systemów bez kontroli człowieka.

„Według źródła zaznajomionego z rozmowami, Anthropic nigdy nie sprzeciwiało się wykorzystywaniu swoich modeli do ‘legalnych operacji wojskowych’” — poinformowała na X główna korespondentka Fox News ds. bezpieczeństwa narodowego Jennifer Griffin. „Powiedziało też Hegsethowi, że nigdy nie skarżyło się Pentagonowi ani Palantir na użycie jego modeli w rajdzie na Maduro.”

Claude był wykorzystywany do analizy wywiadowczej, cyberobrony i planowania operacyjnego. Doniesienia wskazują, że wspierał planowanie i analizę w czasie rzeczywistym podczas operacji z 3 stycznia, która zakończyła się schwytaniem prezydenta Wenezueli Nicolása Maduro. Anthropic później zwróciło się o wyjaśnienia dotyczące udziału modelu w ramach wewnętrznego przeglądu zgodności, co urzędnicy Pentagonu zinterpretowali jako krytykę.

9 stycznia Hegseth wydał memorandum, w którym wezwał dostawców sztucznej inteligencji (AI) do usunięcia tego, co określił jako restrykcyjne warunki. Ta dyrektywa stworzyła grunt pod renegocjacje i ostatecznie doprowadziła do spotkania 24 lutego.

Pentagon wyznaczył Anthropic termin do 27 lutego na zmianę warunków. Możliwe działania obejmują powołanie się na ustawę Defense Production Act w celu wymuszenia zgodności lub uznanie Anthropic za ryzyko dla łańcucha dostaw — krok, który mógłby wymagać od wykonawców wycofania się z systemów powiązanych z Claude.

Urzędnicy przyznają, że odłączenie Claude od istniejącej infrastruktury byłoby operacyjnie skomplikowane. Mimo to departament ma alternatywy. Konkurenci tacy jak xAI ze swoim modelem Grok, OpenAI z ChatGPT oraz Google z Gemini są objęci podobnymi kontraktami Departamentu Obrony i mogą być gotowi do rozszerzenia swoich ról, jeśli rozmowy zakończą się fiaskiem.

Spór podkreśla szersze pytania dotyczące ładu (governance) AI w warunkach wojskowych, zwłaszcza że prawo federalne wciąż ewoluuje wokół nowych technologii. Stawką jest to, czy prywatni twórcy AI mogą utrzymać niezależne polityki etyczne, gdy ich systemy stają się osadzone w operacjach bezpieczeństwa narodowego.

Reakcje na platformach społecznościowych były wyjątkowo szczere. „Inwigilacja bez nakazu wróciła” — jeden z użytkowników X napisał w odpowiedzi na wpis Griffin na X. „To powinno być znacznie większą wiadomością, niż jest. Istnieje poważna szansa na naruszenia konstytucji” — odpowiedział inny użytkownik na jej relację. Inni, z dawką czarnego humoru, żartowali, że nadejście Skynetu może nie być daleko. „Skynet jest tutaj… oś czasu 2029 jest AKTYWNA” — skomentowała ta osoba.

Obie strony określiły dyskusję z 24 lutego jako merytoryczną. To, czy Anthropic dostosuje swoje zabezpieczenia przed upływem terminu, może przesądzić o przyszłości jednej z najbardziej zaawansowanych integracji AI w Pentagonie.

FAQ 🤖

- Co omawiano na spotkaniu w Pentagonie 24 lutego?

Spotkanie koncentrowało się na ograniczeniach Anthropic dotyczących Claude AI oraz na tym, czy ograniczają one legalne zastosowania wojskowe. - Dlaczego Pentagon wywiera presję na Anthropic?

Urzędnicy obrony argumentują, że zabezpieczenia firmy ingerują w autoryzowane zastosowania w zakresie bezpieczeństwa narodowego. - Co może się stać, jeśli Anthropic się nie zastosuje?

Pentagon może powołać się na Defense Production Act lub uznać firmę za ryzyko dla łańcucha dostaw. - Czy istnieją alternatywy dla Claude?

Tak, modele od xAI, OpenAI i Google są objęte kontraktami Departamentu Obrony i w razie potrzeby mogą rozszerzyć zakres wykorzystania.