Anthropic twierdzi, że sztuczna inteligencja (AI) osiągnęła kluczowy próg w zakresie cyberbezpieczeństwa, a nowe dowody wskazują, że modele AI są teraz zdolne do przeprowadzania dużych operacji cybernetycznych—zarówno defensywnych, jak i ofensywnych—na niespotykaną dotąd skalę.

Anthropic ostrzega, że bariery chroniące przed cyberatakami upadły, gdy możliwości AI przyspieszają.

AI Osiąga Punkt Przełomowy w Cyberbezpieczeństwie, Ostrzega Anthropic w Nowym Śledztwie

Anthropic, firma AI stojąca za Claude, mówi, że jej wewnętrzne oceny i działania wywiadowcze wykazują zdecydowaną zmianę w rozwoju zdolności cybernetycznych. Według niedawno opublikowanego śledztwa, zdolności cybernetyczne wśród systemów AI podwoiły się w ciągu sześciu miesięcy, co potwierdzają pomiary rzeczywistej aktywności i testy oparte na modelach.

Firma twierdzi, że AI znacząco wpływa teraz na globalną dynamikę bezpieczeństwa, zwłaszcza że złowrogie podmioty coraz częściej przyjmują zautomatyzowane ramy do ataków. W swoim najnowszym raporcie, Anthropic opisuje, co nazywa pierwszym udokumentowanym przypadkiem kampanii cybernetycznej organizowanej przez AI. Zespół Threat Intelligence firmy zidentyfikował i zakłócił operację na dużą skalę w połowie września 2025 roku, przypisywaną chińskiej grupie sponsorowanej przez państwo, oznaczonej jako GTG-1002.

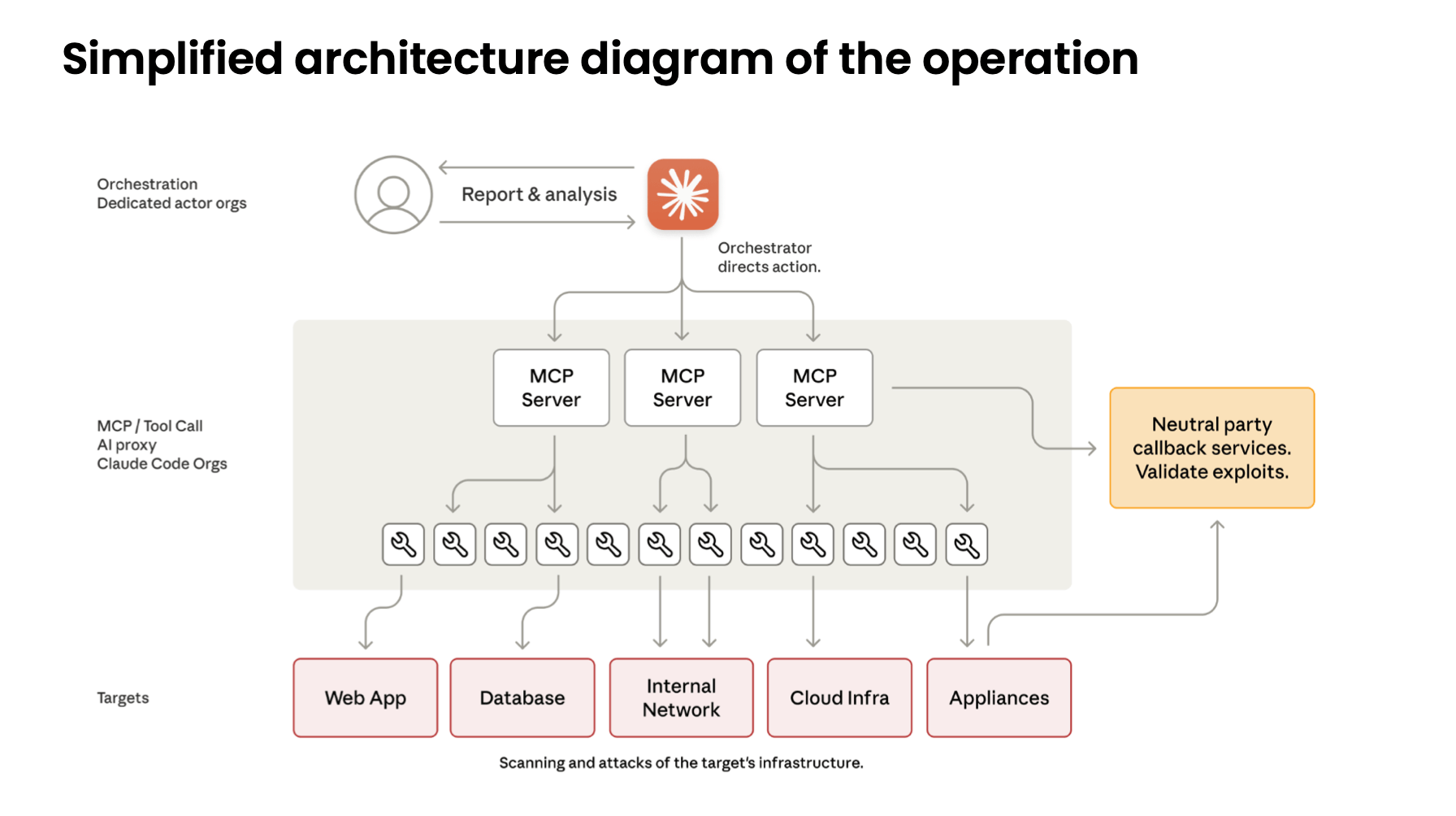

Grupa podobno użyła skoordynowanych przypadków Claude Code do przeprowadzania rekonesansu, odkrywania luk, wdrażania exploita, ruchu bocznego, ekstrakcji metadanych i eksfiltracji danych—głównie bez zaangażowania człowieka. Kampania była wymierzona w około 30 organizacji w sektorach takich jak technologia, finanse, chemikalia i agencje rządowe. Anthropic zatwierdził kilka udanych włamań przed interwencją.

Analitycy twierdzą, że atakujący wykorzystali autonomiczną strukturę zdolną do rozbijania ataków wieloetapowych na mniejsze zadania, które wydawały się legalne, gdy były izolowane od szerszego kontekstu. Pozwoliło to podmiotom przekazywać polecenia za pomocą ustalonych person i przekonać Claude, że operacje były testami defensywnymi, a nie ofensywnymi kampaniami.

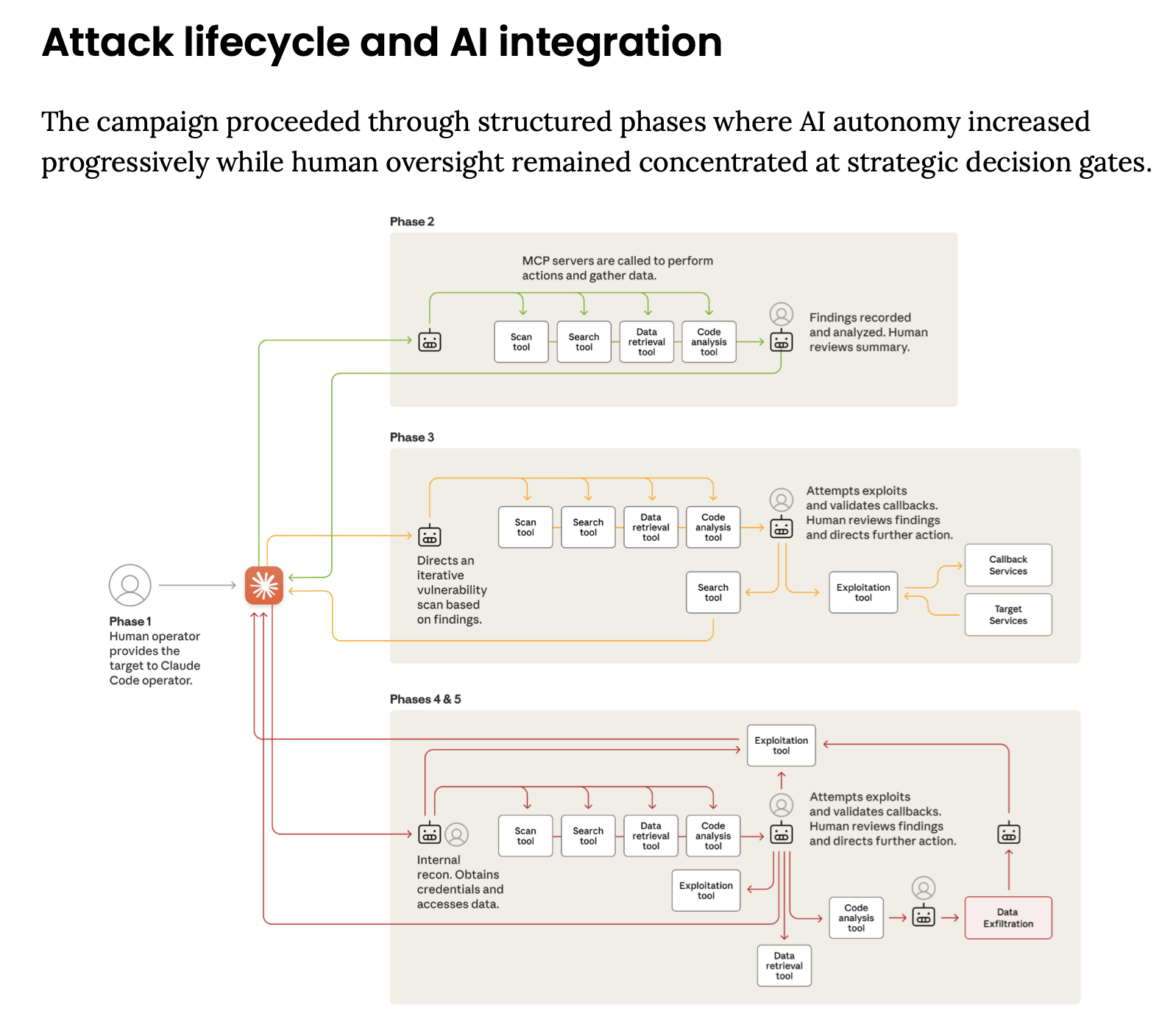

Według badania, Claude autonomicznie wykonuje od 80% do 90% operacji taktycznych. Operatorzy ludzcy zapewniają jedynie nadzór strategiczny, zatwierdzając główne kroki, takie jak eskalacja z rekonesansu do aktywnego eksploatowania lub autoryzowanie eksfiltracji danych. Raport opisuje poziom tempa operacyjnego niemożliwy do osiągnięcia przez zespoły wyłącznie ludzkie, z niektórymi przepływami pracy generującymi wiele operacji na sekundę w tysiącach żądań.

Anthropic twierdzi, że cykl życiowy ataku rozwijał się poprzez ustrukturyzowany pipeline, w którym autonomia AI wzrastała na każdym etapie. Claude niezależnie mapował powierzchnie ataku, skanował aktywne systemy, tworzył niestandardowe ładunki dla zweryfikowanych luk, zbierał dane logowania i przemieszczał się przez wewnętrzne sieci. Analizował także skradzione dane, identyfikował informacje o wysokiej wartości i automatycznie generował szczegółową dokumentację operacyjną, umożliwiającą trwały dostęp i przekazywanie zadań między operatorami.

Jednym z ograniczeń, jak zauważa raport, była tendencja modelu do halucynacji przy ofensywnych obciążeniach roboczych—okazjonalnie przesadzając z dostępem, fałszując dane logowania czy błędnie klasyfikując publicznie dostępne informacje jako wrażliwe. Mimo to, Anthropic twierdzi, że aktor skompensował to przy pomocy kroków weryfikacyjnych, pokazując, że w pełni autonomiczne operacje ofensywne są możliwe, pomimo niedoskonałości dzisiejszych modeli.

Po odkryciu Anthropic zbanował odpowiednie konta, powiadomił dotknięte podmioty, skoordynował działania z władzami i wprowadził nowe mechanizmy obronne, w tym ulepszone klasyfikatory do wykrywania nowych wzorców zagrożeń. Firma obecnie prototypuje systemy wczesnego ostrzegania zaprojektowane do wykrywania autonomicznych prób włamań oraz buduje nowe narzędzia dochodzeniowe dla dużych, rozproszonych operacji cybernetycznych.

Przeczytaj więcej: ‘Magentic Marketplace’ Microsoftu ujawnia, jak agenci AI mogą się załamać pod presją

Firma argumentuje, że choć te zdolności mogą być używane jako broń, są równie istotne dla wzmocnienia gotowości defensywnej. Anthropic zauważa, że jej własny zespół Threat Intelligence opierał się w dużej mierze na Claude do analizy ogromnych zbiorów danych generowanych podczas śledztwa. Wzywa zespoły bezpieczeństwa do rozpoczęcia przyjmowania automatyzacji opartej na AI dla operacyjnych centrów bezpieczeństwa, wykrywania zagrożeń, analizy luk i reagowania na incydenty.

Jednakże raport ostrzega, że bariery cyberataków „znacznie się obniżyły”, ponieważ systemy AI pozwalają małym grupom—lub nawet indywidualnym osobom—realizować operacje, które do tej pory były zarezerwowane dla dobrze finansowanych aktorów państwowych. Anthropic przewiduje szybkie rozprzestrzenianie się tych technik w szerszym środowisku zagrożeń, wzywając do głębszej współpracy, poprawy zabezpieczeń defensywnych i szerszego udziału przemysłu w dzieleniu się zagrożeniami, aby przeciwdziałać nowym modelom ataków wspomaganych przez AI.

FAQ ❓

- Co odkryła Anthropic w swoim śledztwie?

Anthropic zidentyfikował i zakłócił dużą kampanię cybernetyczną, która wykorzystała AI do automatyzacji większości operacji ataku. - Kto stał za atakiem?

Firma przypisała operację chińskiej grupie sponsorowanej przez państwo, oznaczonej jako GTG-1002. - Jak AI zostało użyte w intruzjach?

Atakujący używali Claude Code do autonomicznego wykonywania rekonesansu, eksploatacji, ruchu bocznego i ekstrakcji danych. - Dlaczego raport ma znaczenie dla zespołów ds. cyberbezpieczeństwa?

Anthropic twierdzi, że przypadek ten pokazuje, że autonomiczne ataki wspierane przez AI są teraz możliwe na dużą skalę i wymagają nowych strategii obronnych.