Anthropic podjęło nadzwyczajny krok, pozywając rząd USA po tym, jak Pentagon określił firmę zajmującą się sztuczną inteligencją (AI) jako „ryzyko w łańcuchu dostaw dla bezpieczeństwa narodowego”, wywołując spór prawny, który może przekształcić sposób, w jaki Waszyngton kontroluje dostawców sztucznej inteligencji współpracujących z wojskiem.

Anthropic Dario Amodei pozywa rząd USA, twierdząc, że Pentagon dokonał odwetu za zabezpieczenia dotyczące bezpieczeństwa SI

Anthropic staje do walki z Departamentem Obrony w przełomowym pozwie dotyczącym AI

Według kilku doniesień Anthropic złożyło 9 marca dwa pozwy w sądzie federalnym, kwestionując działania podjęte przez Departament Obrony USA i administrację Trumpa, argumentując, że rząd bezprawnie dokonał odwetu wobec spółki po tym, jak odmówiła ona usunięcia zabezpieczeń z systemu sztucznej inteligencji Claude. Pozwy dotyczą klasyfikacji, która zwykle odnosi się do zagranicznych przeciwników podejrzewanych o szpiegostwo lub sabotaż, a nie do krajowych firm technologicznych.

Spór ma swoje źródło w negocjacjach kontraktowych między Anthropic a Pentagonem dotyczących tego, w jaki sposób model AI Claude mógłby być wykorzystywany przez amerykańskie agencje obronne. Anthropic wcześniej wspierało inicjatywy na rzecz bezpieczeństwa narodowego i w czerwcu 2024 r. stało się pierwszą firmą z obszaru frontier AI, która wdrożyła modele w tajnych sieciach rządu USA, pomagając analitykom i planistom wojskowym w przeglądzie informacji wywiadowczych, symulacjach, planowaniu operacyjnym oraz pracach z zakresu cyberbezpieczeństwa.

Napięcia wzrosły, gdy Departament Obrony zażądał nieograniczonego dostępu do Claude’a „do wszystkich zgodnych z prawem celów” w ramach odnowienia umowy. Anthropic zgodziło się na większość warunków, ale nalegało na dwa ograniczenia: zakaz wykorzystania swojej AI do masowej krajowej inwigilacji Amerykanów oraz zapobieżenie wdrożeniu w w pełni autonomicznych systemach broni śmiercionośnej.

Kierownictwo spółki argumentowało, że te zabezpieczenia są konieczne, ponieważ obecne modele frontier AI pozostają zbyt zawodne dla autonomicznej broni, a programy nadzoru na dużą skalę mogłyby kolidować z ochroną konstytucyjną. Anthropic stwierdziło, że ograniczenia nigdy nie przeszkodziły w żadnej misji wojskowej podczas wcześniejszej współpracy z rządem.

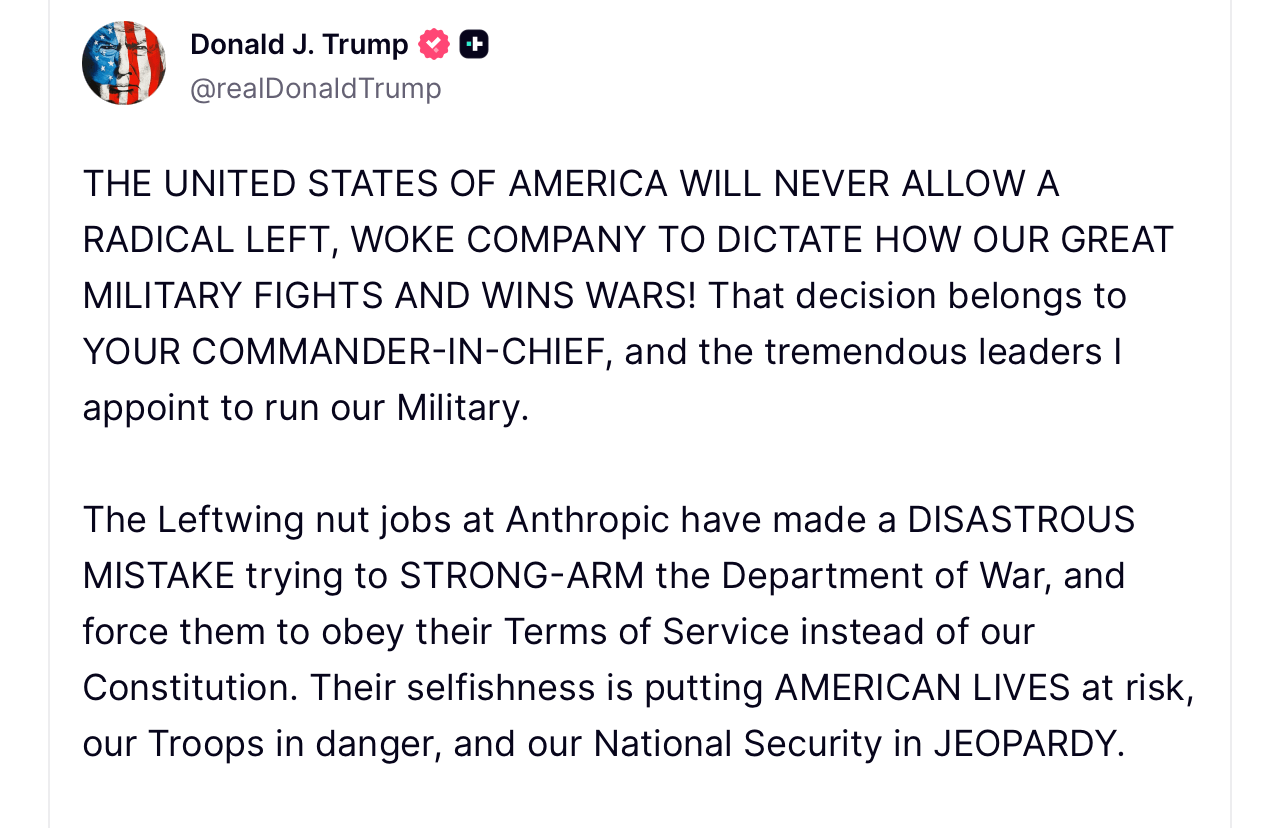

Negocjacje załamały się po spotkaniu 24 lutego między dyrektorem generalnym Anthropic Dario Amodeiem a sekretarzem obrony Pete’em Hegsethem. Kilka dni później, 27 lutego, prezydent Donald Trump opublikował na Truth Social wpis, w którym polecił agencjom federalnym „natychmiast zaprzestać” korzystania z technologii Anthropic, określając dalsze poleganie na tej firmie jako „katastrofalny błąd”.

Wkrótce potem Hegseth podjął kroki, aby sklasyfikować Anthropic jako ryzyko w łańcuchu dostaw na podstawie federalnych uprawnień zakupowych określonych w 10 U.S.C. § 3252. Klasyfikacja, potwierdzona w liście wysłanym do spółki około 4 marca, ogranicza niektórym wykonawcom rządowym możliwość korzystania z technologii uznanej za podatną na sabotaż lub obce wpływy.

Anthropic twierdzi, że to posunięcie nadmiernie rozciąga ustawę daleko poza jej zamierzony cel. W pismach sądowych firma utrzymuje, że klasyfikacja miała dotyczyć zagrożeń bezpieczeństwa powiązanych z zagranicą, a nie sporów politycznych z krajowymi dostawcami. Pozwy wskazują, że rząd nie zastosował „najmniej restrykcyjnych środków” wymaganych przez prawo, a zamiast tego nałożył to, co firma opisuje jako nieoficjalną czarną listę.

W dokumentach prawnych poruszono również kwestie konstytucyjne. Anthropic argumentuje, że klasyfikacja narusza Pierwszą Poprawkę, karząc firmę za publiczne opowiadanie się za ograniczeniami w wykorzystaniu AI, takimi jak autonomiczna broń i krajowa inwigilacja. Zgodnie z pozwem, oznaczenie firmy jako ryzyka dla bezpieczeństwa narodowego szkodzi jej reputacji i może zagrozić kontraktom wartym setki milionów dolarów.

Anthropic prosi sądy o zablokowanie egzekwowania tej klasyfikacji, nakazanie agencjom federalnym wycofania dyrektyw wstrzymujących współpracę z firmą oraz zapobieżenie podobnym działaniom w przyszłości. Spółka podkreśla, że jej celem nie jest zmuszenie rządu do zakupu jej technologii, lecz zapobieżenie odwetowi z powodu różnic w polityce.

„Zwrócenie się o kontrolę sądową nie zmienia naszego wieloletniego zobowiązania do wykorzystywania AI w celu ochrony naszego bezpieczeństwa narodowego” — powiedział rzecznik Anthropic w oświadczeniu. „Ale to konieczny krok, aby chronić naszą działalność, naszych klientów i naszych partnerów.”

Urzędnicy Pentagonu nie skomentowali publicznie sporu, powołując się na politykę dotyczącą toczących się postępowań sądowych. Niektórzy liderzy obrony wcześniej argumentowali, że agencje wojskowe muszą zachować pełną władzę operacyjną nad technologiami wykonawców w sytuacjach kryzysowych i nie mogą pozwalać dostawcom dyktować, w jaki sposób systemy są wykorzystywane.

Dziki weekend AI: wstrząsy w OpenAI, starcie z Pentagonem i roboty, które nie chcą umrzeć

Wstrząsy w świecie AI następują błyskawicznie: dramat w OpenAI, starcie Pentagonu z Anthropic, premiera GPT-5.4, samonaprawiające się roboty i nowe narzędzia bezpieczeństwa. read more.

Czytaj teraz

Dziki weekend AI: wstrząsy w OpenAI, starcie z Pentagonem i roboty, które nie chcą umrzeć

Wstrząsy w świecie AI następują błyskawicznie: dramat w OpenAI, starcie Pentagonu z Anthropic, premiera GPT-5.4, samonaprawiające się roboty i nowe narzędzia bezpieczeństwa. read more.

Czytaj teraz

Dziki weekend AI: wstrząsy w OpenAI, starcie z Pentagonem i roboty, które nie chcą umrzeć

Czytaj terazWstrząsy w świecie AI następują błyskawicznie: dramat w OpenAI, starcie Pentagonu z Anthropic, premiera GPT-5.4, samonaprawiające się roboty i nowe narzędzia bezpieczeństwa. read more.

Spór pojawia się w momencie, gdy nasila się wyścig o wojskowe kontrakty na AI. Konkurencyjne firmy, w tym OpenAI, zawarły porozumienia z Pentagonem mniej więcej w tym samym czasie, gdy negocjacje z Anthropic załamały się. Tymczasem główni partnerzy technologiczni, tacy jak Google i Microsoft, wskazali, że zamierzają kontynuować współpracę z Anthropic przy usługach komercyjnych niezwiązanych z obronnością.

Analitycy branżowi twierdzą, że wynik sprawy może ustanowić precedens dotyczący tego, w jaki sposób rząd federalny wywiera presję na firmy AI, by modyfikowały polityki bezpieczeństwa, gdy w grę wchodzą interesy bezpieczeństwa narodowego. Na razie produkty konsumenckie Anthropic i komercyjne usługi AI pozostają dostępne, podczas gdy batalia prawna o klasyfikację Pentagonu rozpoczyna swoją drogę przez sądy.

FAQ 🧭

- Dlaczego Anthropic pozwało rząd USA?

Anthropic złożyło pozwy, twierdząc, że Pentagon bezprawnie oznaczył firmę jako ryzyko w łańcuchu dostaw dla bezpieczeństwa narodowego po tym, jak odmówiła usunięcia ograniczeń bezpieczeństwa AI. - Co wywołało spór między Anthropic a Pentagonem?

Konflikt rozpoczął się podczas negocjacji umowy, gdy Departament Obrony zażądał nieograniczonego wykorzystania systemu AI Claude firmy Anthropic. - Co oznacza oznaczenie „ryzyko w łańcuchu dostaw”?

Ta etykieta może ograniczać wykonawcom rządowym możliwość korzystania z technologii danej firmy, jeśli urzędnicy uznają, że stwarza ona ryzyka w zakresie bezpieczeństwa lub zamówień. - Czy usługi AI Anthropic będą nadal działać w trakcie pozwu?

Tak, komercyjne produkty AI Anthropic i usługi dla konsumentów pozostają dostępne, podczas gdy postępowanie sądowe toczy się dalej.