Anthropic har tatt det ekstraordinære steget å saksøke den amerikanske regjeringen etter at Pentagon stemplet kunstig intelligens (KI)-selskapet som en «forsyningskjederisiko for nasjonal sikkerhet», noe som har utløst en juridisk konflikt som kan omforme hvordan Washington kontrollerer leverandører av kunstig intelligens som jobber med militæret.

Dario Amodeis Anthropic saksøker den amerikanske regjeringen og sier at Pentagon tok hevn på grunn av sikkerhetsrekkverk for KI

Anthropic tar opp kampen mot forsvarsdepartementet i en banebrytende KI-rettssak

Ifølge flere rapporter leverte Anthropic inn to søksmål 9. mars i føderal domstol som utfordrer handlinger utført av det amerikanske forsvarsdepartementet og Trump-administrasjonen, og hevder at regjeringen ulovlig gjengjeldte mot selskapet etter at det nektet å fjerne sikkerhetstiltak fra sitt Claude-system for kunstig intelligens. Søksmålene retter seg mot en klassifisering som vanligvis gjelder utenlandske motstandere mistenkt for spionasje eller sabotasje, ikke innenlandske teknologiselskaper.

Konflikten kan spores tilbake til kontraktsforhandlinger mellom Anthropic og Pentagon om hvordan selskapets Claude KI-modell kunne brukes av amerikanske forsvarsorganer. Anthropic hadde tidligere støttet initiativer for nasjonal sikkerhet og ble det første frontier-KI-selskapet som distribuerte modeller på graderte amerikanske myndighetsnettverk i juni 2024, og bistod analytikere og militære planleggere med etterretningsgjennomgang, simuleringer, operativ planlegging og cybersikkerhetsarbeid.

Spenningene eskalerte da forsvarsdepartementet krevde ubegrenset tilgang til Claude for «alle lovlige formål» som del av en kontraktsfornyelse. Anthropic gikk med på de fleste vilkår, men insisterte på to begrensninger: å forby bruk av KI-en til masse innenlandsk overvåking av amerikanere og å hindre utplassering i fullt autonome dødelige våpensystemer.

Selskapets ledere argumenterte for at disse rekkverkene var nødvendige fordi dagens frontier-KI-modeller fortsatt er for upålitelige for autonome våpen, og fordi storskala overvåkingsprogrammer kan komme i konflikt med konstitusjonelle rettigheter. Anthropic uttalte at begrensningene aldri hadde forstyrret noen militær oppgave under selskapets tidligere arbeid med regjeringen.

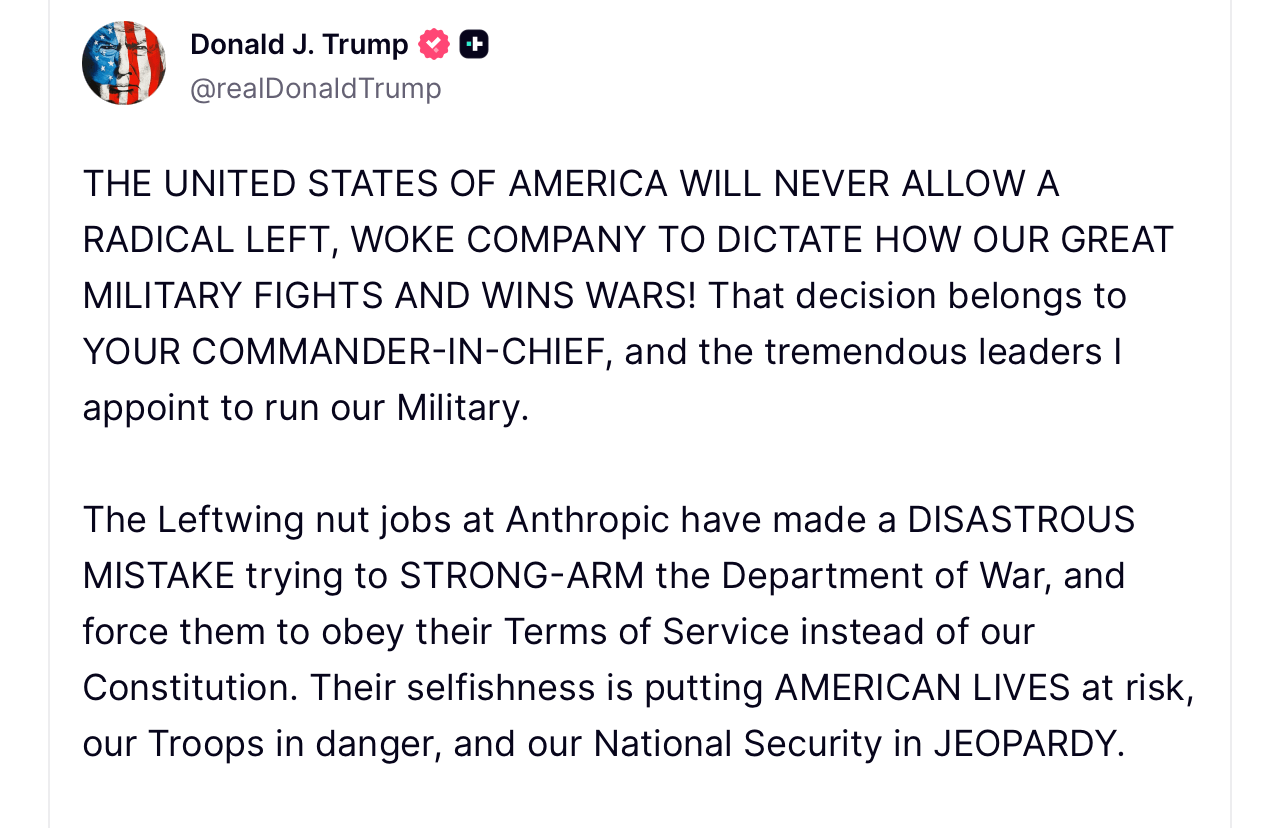

Forhandlingene brøt sammen etter et møte 24. februar mellom Anthropic-sjef Dario Amodei og forsvarsminister Pete Hegseth. Dager senere, 27. februar, la president Donald Trump ut på Truth Social og instruerte føderale etater om «umiddelbart å slutte» å bruke Anthropic-teknologi, og beskrev fortsatt avhengighet av selskapet som en «katastrofal feil».

Kort tid etterpå gikk Hegseth inn for å klassifisere Anthropic som en forsyningskjederisiko under føderal anskaffelsesmyndighet slik den er beskrevet i 10 U.S.C. § 3252. Klassifiseringen, bekreftet i et brev sendt til selskapet rundt 4. mars, begrenser enkelte statlige kontraktører fra å bruke teknologi som anses sårbar for sabotasje eller utenlandsk påvirkning.

Anthropic hevder at tiltaket tøyer lovbestemmelsen langt utover dens tiltenkte formål. I rettsdokumenter anfører selskapet at klassifiseringen var ment for sikkerhetstrusler med utenlandske forbindelser, ikke politiske uenigheter med innenlandske leverandører. Søksmålene hevder at regjeringen ikke benyttet «minste restriktive middel» som loven krever, og i stedet påla det selskapet beskriver som en uoffisiell svarteliste.

De juridiske dokumentene reiser også konstitusjonelle bekymringer. Anthropic hevder at klassifiseringen krenker Første grunnlovstillegg ved å straffe selskapet for offentlig å ha tatt til orde for begrensninger på KI-bruk som autonome våpen og innenlandsk overvåking. Ifølge klagen skader det å stemple firmaet som en nasjonal sikkerhetsrisiko omdømmet og kan true kontrakter verdt hundrevis av millioner dollar.

Anthropic ber domstolene om å stanse håndhevingen av klassifiseringen, pålegge føderale etater å trekke tilbake direktiver som stanser forretninger med selskapet, og hindre lignende tiltak i fremtiden. Selskapet sier målet ikke er å tvinge regjeringen til å kjøpe teknologien deres, men å forhindre gjengjeldelse på grunn av politiske uenigheter.

«Å be om domstolsprøving endrer ikke vår langvarige forpliktelse til å utnytte KI for å beskytte vår nasjonale sikkerhet», sa en talsperson for Anthropic i en uttalelse. «Men dette er et nødvendig steg for å beskytte virksomheten vår, kundene våre og partnerne våre.»

Pentagon-tjenestemenn har ikke kommentert rettsprosessen offentlig, med henvisning til retningslinjer for pågående rettssaker. Noen forsvarsledere har tidligere argumentert for at militære etater må beholde full operativ kontroll over kontraktørers teknologier under nødsituasjoner og ikke kan tillate at leverandører dikterer hvordan systemer brukes.

AI’s Ville Helg: OpenAI-omveltning, Pentagon-sammenstøt og roboter som nekter å dø

AI-omveltninger kommer raskt: OpenAI-drama, Pentagon-kollisjon med Anthropic, GPT-5.4-lansering, selvhelende roboter og nye sikkerhetsverktøy. read more.

Les nå

AI’s Ville Helg: OpenAI-omveltning, Pentagon-sammenstøt og roboter som nekter å dø

AI-omveltninger kommer raskt: OpenAI-drama, Pentagon-kollisjon med Anthropic, GPT-5.4-lansering, selvhelende roboter og nye sikkerhetsverktøy. read more.

Les nå

AI’s Ville Helg: OpenAI-omveltning, Pentagon-sammenstøt og roboter som nekter å dø

Les nåAI-omveltninger kommer raskt: OpenAI-drama, Pentagon-kollisjon med Anthropic, GPT-5.4-lansering, selvhelende roboter og nye sikkerhetsverktøy. read more.

Konflikten kommer samtidig som kappløpet om å sikre militære KI-kontrakter tilspisser seg. Rivaliserende selskaper, inkludert OpenAI, inngikk avtaler med Pentagon omtrent samtidig som Anthropics forhandlinger brøt sammen. I mellomtiden har store teknologipartnere som Google og Microsoft signalisert at de har til hensikt å fortsette å samarbeide med Anthropic om kommersielle tjenester som ikke er relatert til forsvar.

Bransjeanalytikere sier utfallet av saken kan etablere en presedens for hvordan den føderale regjeringen presser KI-selskaper til å endre sikkerhetspolicyer når nasjonale sikkerhetsinteresser står på spill. Foreløpig er Anthropics forbrukerprodukter og kommersielle KI-tjenester fortsatt tilgjengelige, mens den juridiske kampen om Pentagon-klassifiseringen begynner sin gang gjennom domstolene.

FAQ 🧭

- Hvorfor saksøkte Anthropic den amerikanske regjeringen?

Anthropic leverte inn søksmål og hevder at Pentagon ulovlig stemplet selskapet som en forsyningskjederisiko for nasjonal sikkerhet etter at det nektet å fjerne KI-sikkerhetsbegrensninger. - Hva utløste konflikten mellom Anthropic og Pentagon?

Konflikten begynte under kontraktsforhandlinger da forsvarsdepartementet krevde ubegrenset bruk av Anthropics Claude KI-system. - Hva betyr klassifiseringen «forsyningskjederisiko»?

Stempelet kan begrense statlige kontraktører fra å bruke et selskaps teknologi dersom tjenestemenn mener den utgjør sikkerhets- eller anskaffelsesrisiko. - Vil Anthropics KI-tjenester fortsatt fungere under søksmålet?

Ja, Anthropics kommersielle KI-produkter og forbrukertjenester forblir tilgjengelige mens rettssaken pågår.