Et desentralisert KI-eksperiment som tidligere var begrenset til kryptomiljøer, fikk nettopp en offentlig anerkjennelse fra Nvidia-sjef Jensen Huang—noe som signaliserer at distribuert modelltrening kan være på vei nærmere mainstream.

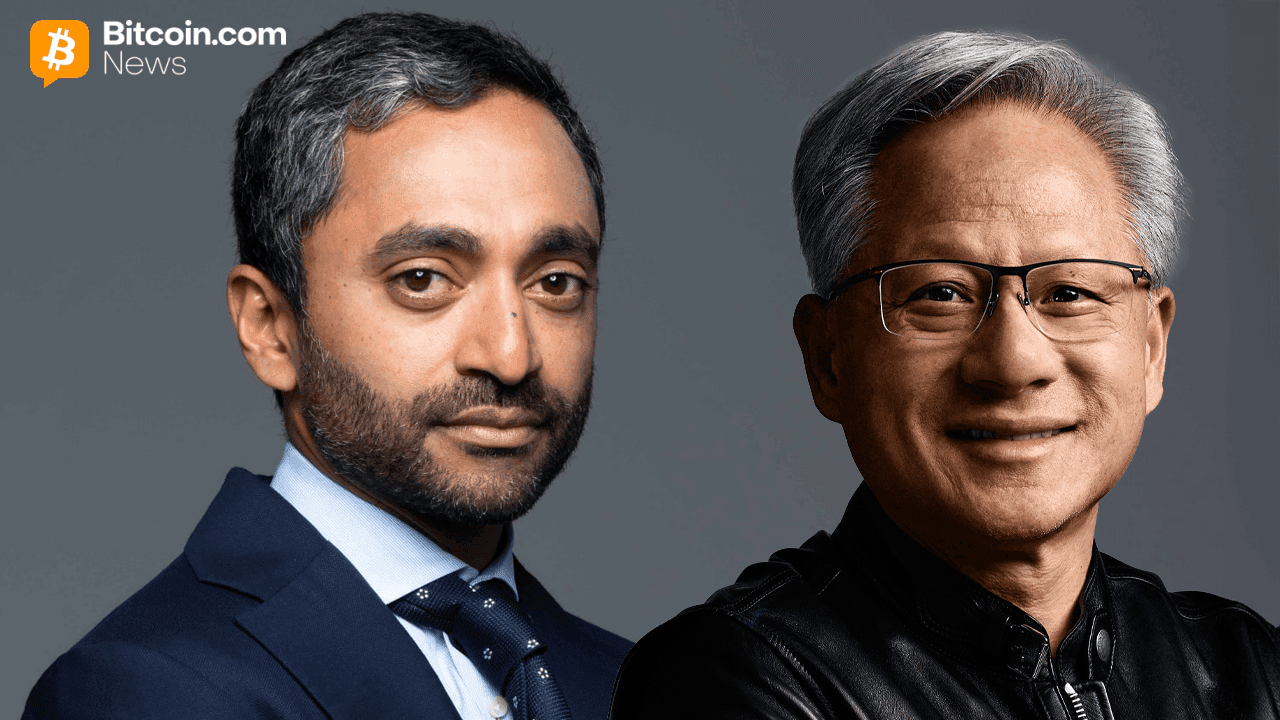

Bittensor-opplæringsmilepæl trekker oppmerksomhet fra Chamath Palihapitiya og Nvidia-sjef Jensen Huang

Åpen kildekode-KI får økt momentum med støtte fra Nvidia-sjefen

Chamath Palihapitiya trakk frem Bittensors Covenant-72B under en episode av All-In Podcast, og beskrev det som et håndfast eksempel på desentralisert kunstig intelligens (KI) som beveger seg forbi teori. Bittensor fungerer som et desentralisert, blokkjede-drevet nettverk som etablerer en peer-to-peer-markedsplass der maskinlæringsmodeller og KI-beregning byttes og insentiveres.

Palihapitiya beskrev innsatsen i enkle ord: en språkmodell i stor skala (LLM) trent uten sentralisert infrastruktur, drevet i stedet av et nettverk av uavhengige bidragsytere. «De klarte å trene en LLaMA-modell med 4 milliarder parametere, helt distribuert, med en haug av folk som bidro med overskuddskapasitet på beregning,» sa han, og kalte det «en ganske vill teknisk bragd».

Sammenligningen traff med en velkjent analogi. «Det er tilfeldige personer, og hver person får en liten andel,» la Palihapitiya til, med henvisning til det tidlige distribuerte databehandlingsprosjektet som utnyttet ledig maskinvare verden over.

Huang avfeide ikke ideen. I stedet løftet han den inn i en bredere innramming av KI-markedet, og antydet at desentraliserte og proprietære tilnærminger ikke utelukker hverandre. «Disse to tingene er ikke A eller B; det er A og B,» sa Huang. «Det er det ingen tvil om.»

Denne tosporede visjonen gjenspeiler et voksende skille—og overlapp—innen KI. På den ene siden finnes lukkede, høypolerte systemer som ChatGPT, Claude og Gemini. På den andre siden finnes åpne vekter og desentraliserte modeller som lar utviklere og organisasjoner skreddersy systemer for spesifikke behov.

Huang gjorde det klart at han ser begge sporene som nødvendige. «Modeller er en teknologi, ikke et produkt,» sa han, og bemerket at de fleste brukere vil fortsette å lene seg på polerte systemer for generelle formål fremfor å bygge sine egne fra bunnen av.

Samtidig pekte han på bransjer der skreddersøm ikke er valgfritt. «Det finnes alle disse bransjene der deres domeneekspertise … må fanges på en måte som de kan kontrollere,» forklarte Huang, og la til at «det kan bare komme fra åpne modeller».

Den uttalelsen treffer midt i Bittensors kjerneområde. Covenant-72B, utviklet gjennom Subnet 3 (Templar), representerer en av de største desentraliserte treningskjøringene til dags dato, og koordinerer mer enn 70 bidragsytere over standard internettforbindelser uten en sentral myndighet.

Teknisk sett flytter modellen grensene. Bygget med 72 milliarder parametere og trent på rundt 1,1 billioner tokens, utnytter den innovasjoner som komprimerte kommunikasjonsprotokoller og distribuert dataparellisme for å gjøre trening mulig utenfor tradisjonelle datasentre.

Ytelsesmålinger tyder på at den ikke bare er eksperimentell. Benchmark-resultater plasserer den i konkurranse med etablerte sentraliserte modeller, en detalj som bidrar til å forklare hvorfor prosjektet har tiltrukket seg oppmerksomhet utover krypto-native publikum.

Markedet la også merke til det. Etter kunngjøringen har prosjektets token TAO steget 24% siden videoen av Palihapitiya og Huang gikk sin runde i sosiale medier.

Nvidia driver Nebius AI Factory-planer med en massiv investering på 2 milliarder dollar

Utforsk hvordan Nvidia omformer fremtiden for databehandling med en investering på 2 milliarder dollar i AI-skyinfrastruktur. read more.

Les nå

Nvidia driver Nebius AI Factory-planer med en massiv investering på 2 milliarder dollar

Utforsk hvordan Nvidia omformer fremtiden for databehandling med en investering på 2 milliarder dollar i AI-skyinfrastruktur. read more.

Les nå

Nvidia driver Nebius AI Factory-planer med en massiv investering på 2 milliarder dollar

Les nåUtforsk hvordan Nvidia omformer fremtiden for databehandling med en investering på 2 milliarder dollar i AI-skyinfrastruktur. read more.

Likevel antyder Huangs kommentarer at den egentlige historien ikke handler om fortrengning, men om sameksistens mellom de to. Proprietære KI-systemer vil sannsynligvis forbli dominerende for vanlige brukere, mens åpne og desentraliserte modeller finner roller i spesialiserte, kostnadssensitive eller suverenitetsdrevne anvendelser.

For oppstartsbedrifter skisserte Nvidia-sjefen en pragmatisk oppskrift: start åpent, og bygg deretter inn proprietære fortrinn. «Hver oppstart vi investerer i nå er åpen kildekode først, og går deretter over til den proprietære modellen,» sa han.

Med andre ord: Fremtiden for KI tilhører kanskje ikke én enkelt arkitektur eller filosofi. Den kan tilhøre dem som kan navigere begge—og vet når de skal bruke hver av dem.

FAQ 🔎

- Hva er Bittensors Covenant-72B?

En språkmodell med 72 milliarder parametere trent gjennom et desentralisert nettverk av bidragsytere uten sentralisert infrastruktur. - Hva sa Jensen Huang om desentralisert KI?

Han sa at åpne og proprietære KI-modeller vil sameksistere, og beskrev forholdet som «A og B», ikke et valg mellom dem. - Hvorfor er denne utviklingen viktig?

Den viser at KI-modeller i stor skala kan trenes utenfor tradisjonelle datasentre, og utfordrer antakelser om infrastrukturbehov. - Hvordan påvirker dette KI-bransjen?

Det støtter en hybrid fremtid der sentraliserte plattformer og desentraliserte modeller fyller ulike roller på tvers av bransjer.