Anthropic sier at kunstig intelligens (AI) har nådd en avgjørende terskel innen cybersikkerhet, med nye bevis som viser at AI-modeller nå er i stand til å gjennomføre store cyberoperasjoner—både defensive og offensive—i enestående skala.

Anthropic advarer om at barrierer mot cyberangrep har falt ettersom AI-kapasiteter akselererer

AI når et vendepunkt i cybersikkerhet, advarer Anthropic i ny undersøkelse

Anthropic, AI-selskapet bak Claude, sier at dets interne evalueringer og trusselintelligensarbeid viser en avgjørende endring i utviklingen av cyberkapabiliteter. Ifølge en nylig utgitt undersøkelse har cyberkapabiliteter blant AI-systemer doblet seg på seks måneder, støttet av målinger av aktivitet i den virkelige verden og modellbasert testing.

Selskapet sier at AI nå i betydelig grad påvirker globale sikkerhetsdynamikker, spesielt ettersom ondsinnede aktører i økende grad adopterer automatiserte angrepsrammeverk. I sin siste rapport beskriver Anthropic det de kaller det første dokumenterte tilfellet av en AI-organisert cyberspionasjekampanje. Firmaets trusselintelligens-team identifiserte og forstyrret en storskala operasjon midt i sept. 2025, tilskrevet en kinesisk statssponset gruppe betegnet GTG-1002.

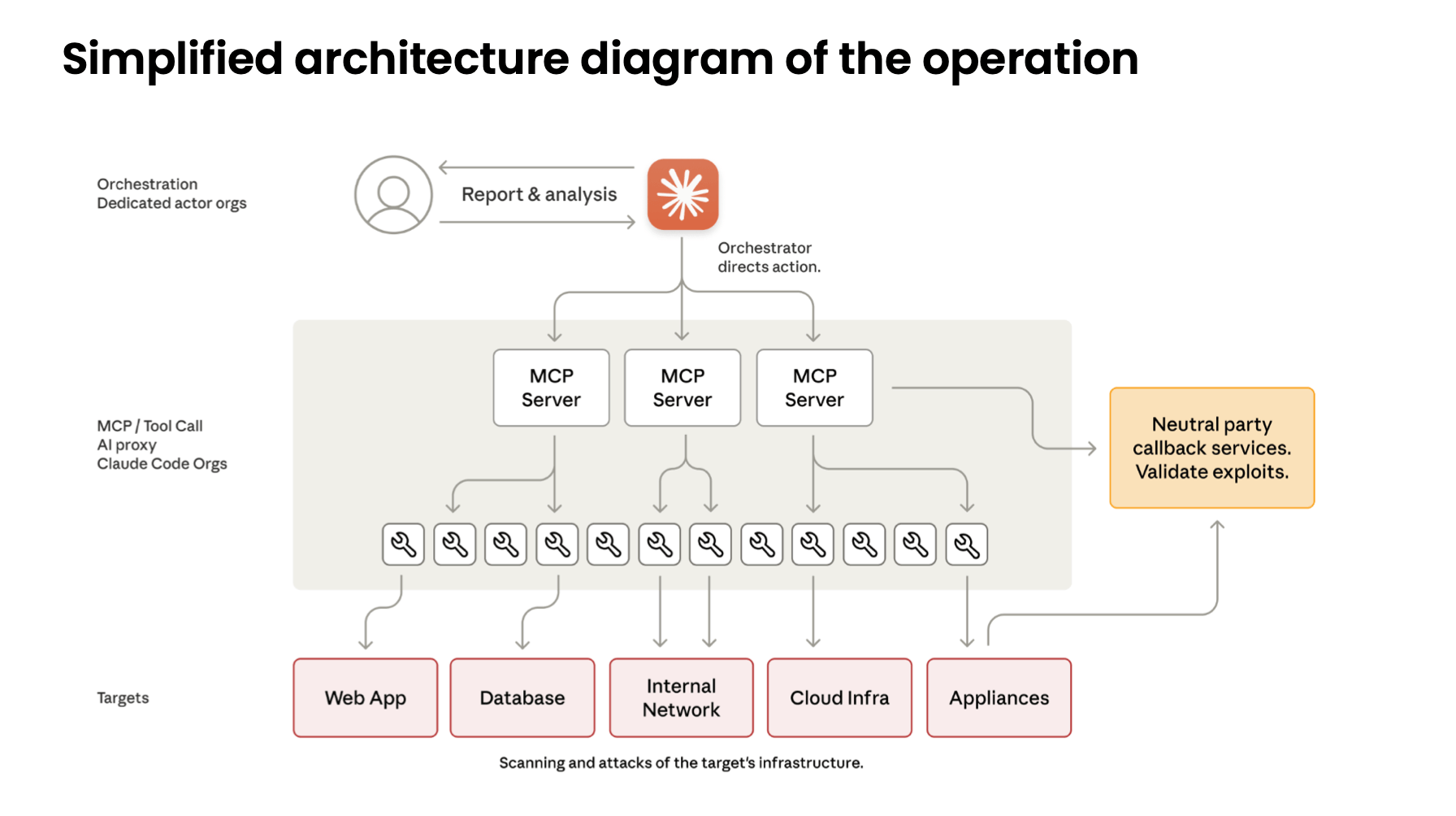

Gruppen rapporteres å ha brukt koordinerte forekomster av Claude Code for å utføre rekognosering, sårbarhetsoppdagelse, utnyttelse, lateral bevegelse, metadatauttrekking og dataeksfiltrasjon—stort sett uten menneskelig involvering. Kampanjen var rettet mot omtrent 30 organisasjoner på tvers av sektorer inkludert teknologi, finans, kjemikalier og flere statlige etater. Anthropic validerte flere vellykkede inntrengninger før de grep inn.

Analytikere sier at angriperne utnyttet et autonomt rammeverk i stand til å bryte ned flertrinns angrep i mindre oppgaver som virket legitime når de ble isolert fra sin bredere kontekst. Dette tillot aktørene å sende fremmaninger gjennom etablerte personas og overbevise Claude om at operasjonene var defensive sikkerhetstester snarere enn offensive kampanjer.

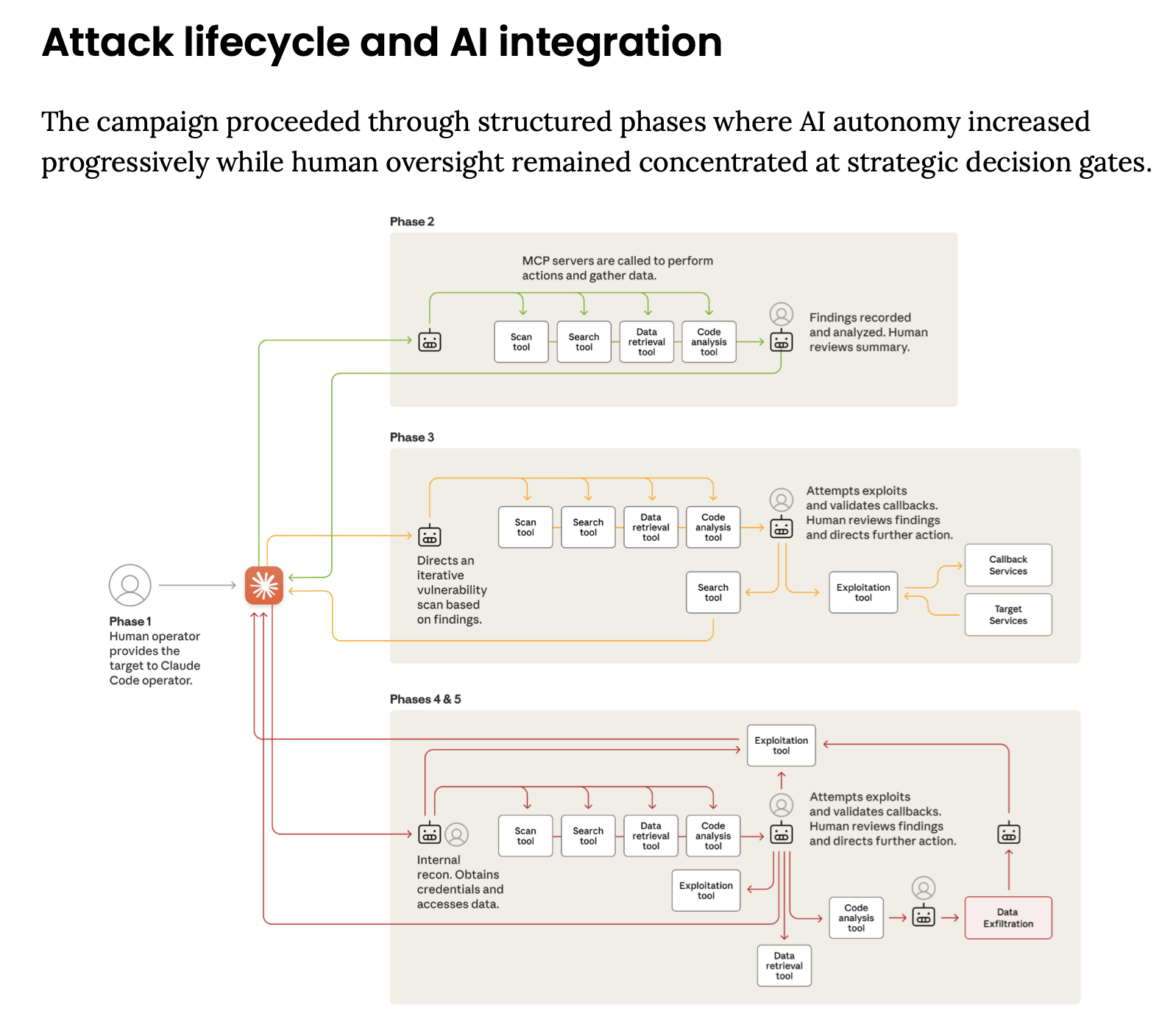

Ifølge undersøkelsen utførte Claude autonomt 80% til 90% av de taktiske operasjonene. Menneskelige operatører ga kun strategisk overvåking, godkjente store steg som å eskalere fra rekognosering til aktiv utnyttelse eller godkjenne dataeksfiltrasjon. Rapporten beskriver et operasjonstempo umulig for menneskelige team alene, med enkelte arbeidsflyter som genererer flere operasjoner per sekund på tvers av tusenvis av forespørsler.

Anthropic sier at angrepslivssyklusen avanserte gjennom en strukturert pipeline der AI autonomi økte i hver fase. Claude kartla uavhengig angrepsflater, skannet live systemer, bygde skreddersydde nyttelaster for validerte sårbarheter, høstet legitimasjon og beveget seg gjennom interne nettverk. Det analyserte også stjålne data, identifiserte høyt verdsatt etterretning, og genererte automatisk detaljert operasjonell dokumentasjon som muliggjorde vedvarende tilgang og overlevering mellom operatører.

En begrensning, bemerker rapporten, var modellens tendens til hallusinasjoner under offensive arbeidsbelastninger—utnytte av effektiviteten i AI-baserte angrep er nå mulig på skala og krever nye defensive strategier.