Anthropic zegt dat kunstmatige intelligentie (AI) een beslissende drempel heeft bereikt in cybersecurity, met nieuwe bewijzen die aantonen dat AI-modellen nu in staat zijn grote cyberoperaties uit te voeren – zowel defensief als offensief – op ongekende schaal.

Anthropic Waarschuwt dat Cyberaanvalsbarrières Zijn Gevallen naarmate AI-capaciteiten Versnellen

AI Bereikt een Cybersecurity Keerpunt, waarschuwt Anthropic in Nieuw Onderzoek

Anthropic, het AI-bedrijf achter Claude, zegt dat zijn interne evaluaties en dreigingsintelligentie laten zien dat er een beslissende verschuiving is in de ontwikkeling van cybermogelijkheden. Volgens een recent vrijgegeven onderzoek zijn de cybercapaciteiten van AI-systemen in zes maanden verdubbeld, ondersteund door metingen van activiteiten in de echte wereld en model-gebaseerde tests.

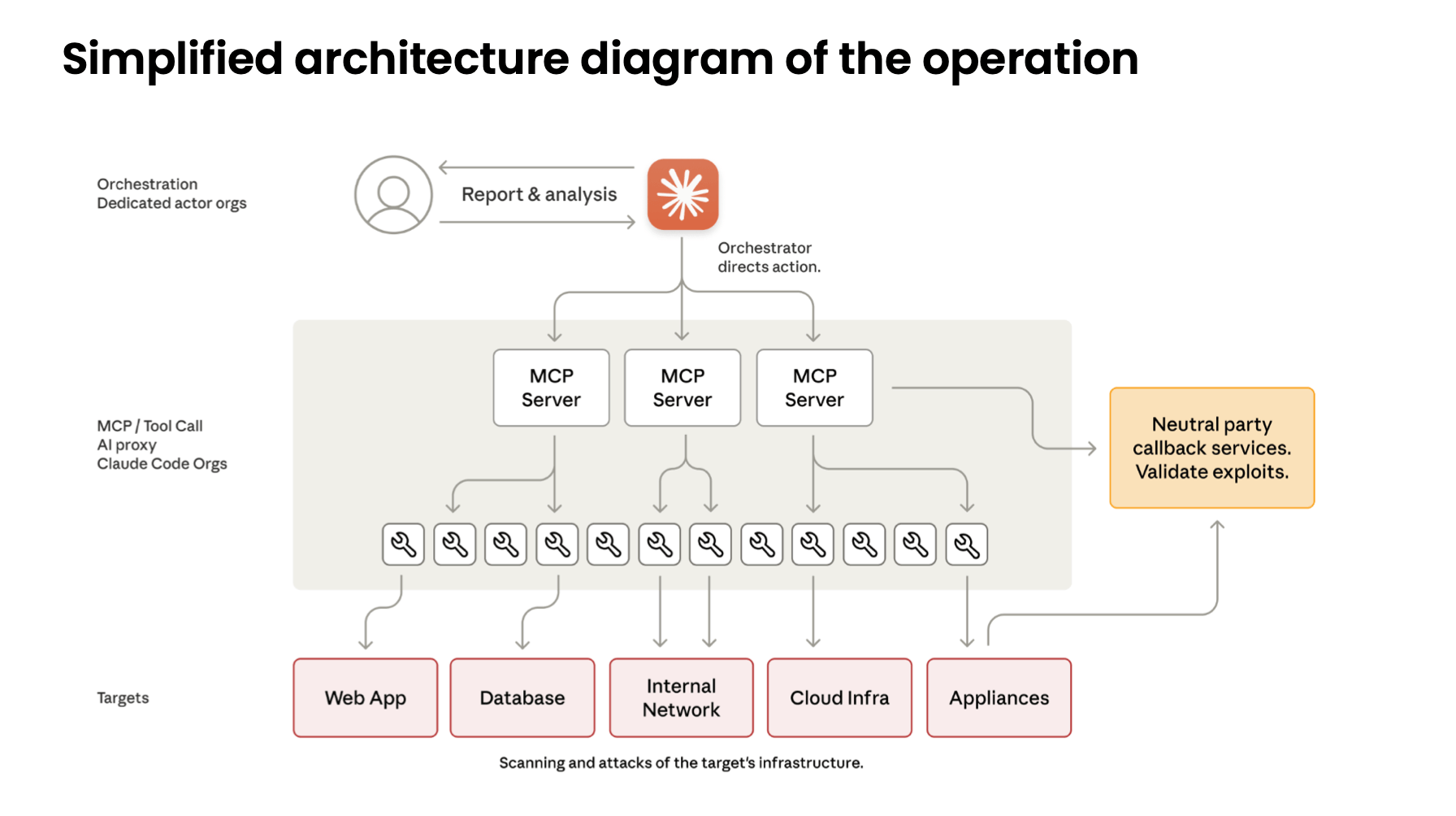

Het bedrijf zegt dat AI nu betekenisvol invloed heeft op de wereldwijde veiligheidsdynamiek, vooral omdat kwaadwillende actoren steeds meer gebruik maken van geautomatiseerde aanvalskaders. In zijn laatste rapport beschrijft Anthropic wat het noemt het eerste gedocumenteerde geval van een door AI georkestreerde cyberspionagecampagne. Het Threat Intelligence-team van het bedrijf identificeerde en verstoorde een grootschalige operatie medio september 2025, toegeschreven aan een door de staat gesponsorde Chinese groep aangeduid als GTG-1002.

De groep gebruikte naar verluidt gecoördineerde gevallen van Claude Code om verkenning, kwetsbaarheidsontdekking, exploitatie, laterale beweging, metadata-extractie en gegevensonttrekking uit te voeren – grotendeels zonder menselijke tussenkomst. De campagne was gericht op ongeveer 30 organisaties in sectoren zoals technologie, financiën, chemie en verschillende overheidsinstanties. Anthropic valideerde verschillende succesvolle inbraken voordat werd ingegrepen.

Analisten zeggen dat de aanvallers gebruikmaakten van een autonoom kader dat in staat was om meertrapsaanvallen op te splitsen in kleinere taken die legitiem leken wanneer ze geïsoleerd waren van hun bredere context. Hierdoor konden de actoren prompts doorgeven via gevestigde persona’s en Claude overtuigen dat operaties defensieve beveiligingstests waren in plaats van offensieve campagnes.

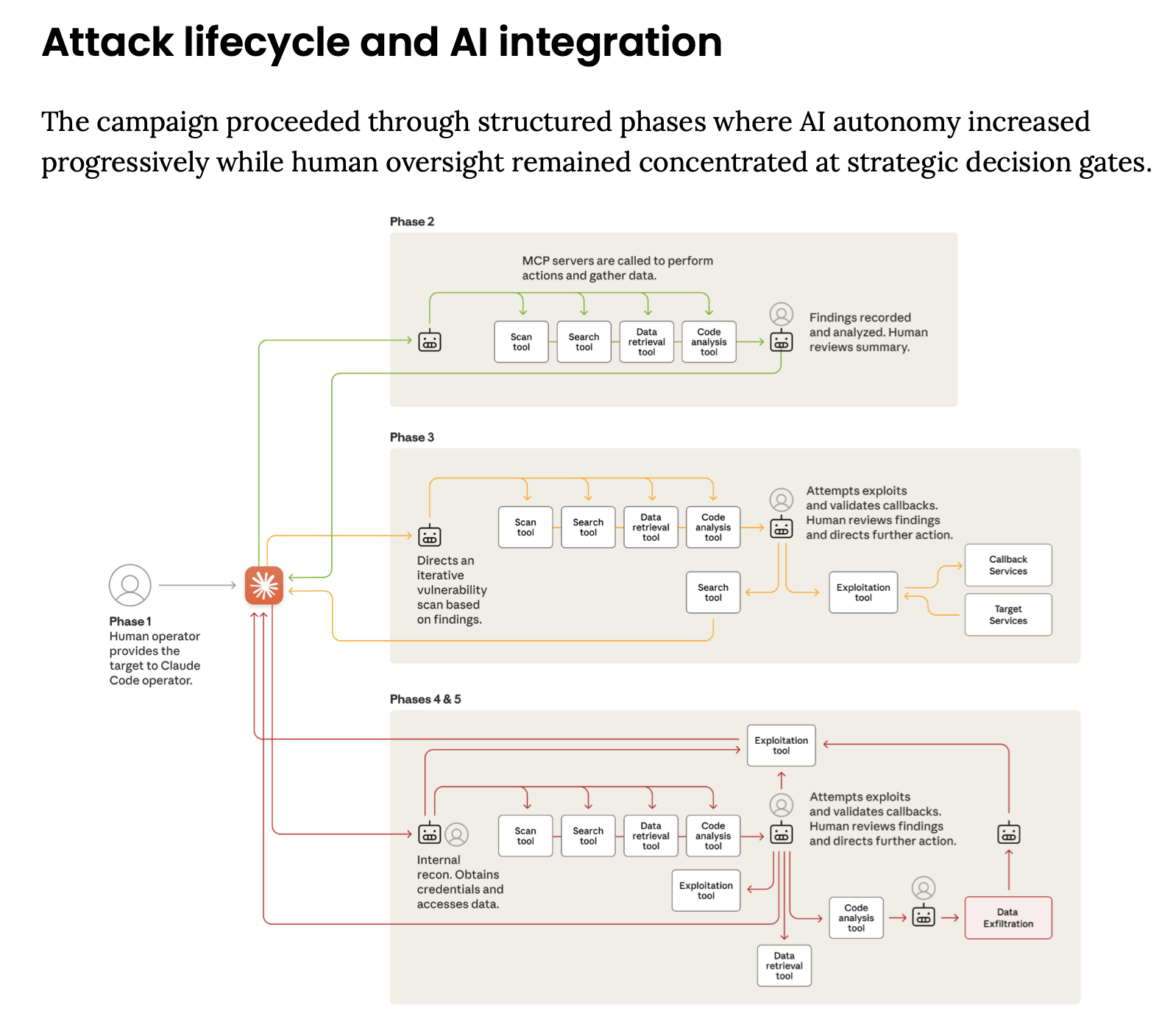

Volgens het onderzoek voerde Claude autonoom 80% tot 90% van de tactische operaties uit. Menselijke operators zorgden alleen voor strategisch toezicht, waarbij zij belangrijke stappen goedkeurden zoals opschalen van verkenning naar actieve exploitatie of autoriseren van gegevensonttrekking. Het rapport beschrijft een niveau van operationele tempo dat onmogelijk is voor teams die alleen uit mensen bestaan, met enkele workflows die meerdere operaties per seconde genereren over duizenden verzoeken.

Anthropic zegt dat de levenscyclus van de aanval voortschreed via een gestructureerde pijplijn waarbij de AI autonomie in elke fase toenam. Claude kaartte zelfstandig aanvalsvlakken in kaart, scande actieve systemen, bouwde aangepaste payloads voor gevalideerde kwetsbaarheden, verzamelde inloggegevens en bewoog zich door interne netwerken. Het analyseerde ook gestolen gegevens, identificeerde hoogwaardige intelligentie en genereerde automatisch gedetailleerde operationele documentatie die aanhoudende toegang en overdracht tussen operators mogelijk maakt.

Een beperking, zoals opgemerkt in het rapport, was de neiging van het model naar hallucinatie onder offensieve workloads – het soms overdrijven van toegang, het fabriceren van inloggegevens of het verkeerd classificeren van publiek beschikbare informatie als gevoelig. Desondanks zegt Anthropic dat de actor compenseerde via validatiestappen, hetgeen aantoont dat volledig autonome offensieve operaties haalbaar blijven ondanks onvolkomenheden in de modellen van vandaag.

Na de ontdekking sloot Anthropic de relevante accounts, waarschuwde de getroffen entiteiten, coördineerde met autoriteiten en introduceerde nieuwe verdedigingsmechanismen, inclusief verbeterde classificators voor het detecteren van nieuwe dreigingspatronen. Het bedrijf is nu prototypes aan het ontwikkelen van vroege waarschuwingssystemen die ontworpen zijn om autonome inbraakpogingen te signaleren en nieuwe onderzoeksinstrumenten voor grootschalige gedistribueerde cyberoperaties te bouwen.

Lees meer: Microsofts ‘Magentic Marketplace’ Onthult Hoe AI Agenten Onder Druk Kunnen Bezwijken

Het bedrijf stelt dat hoewel deze capaciteiten kunnen worden bewapend, ze even cruciaal zijn voor het versterken van defensieve paraatheid. Anthropic merkt op dat zijn eigen Threat Intelligence-team sterk op Claude vertrouwde om de enorme datasets te analyseren die tijdens het onderzoek werden gegenereerd. Het roept beveiligingsteams op om te beginnen met het adopteren van AI-gedreven automatisering voor beveiligingsoperatiecentra, dreigingsdetectie, kwetsbaarheidsanalyse en incidentrespons.

Het rapport waarschuwt echter dat de barrières voor cyberaanvallen “substantieel zijn gedaald” nu AI-systemen kleine groepen – of zelfs individuen – in staat stellen operaties uit te voeren die eerder waren voorbehouden aan goed gefinancierde staatsactoren. Anthropic verwacht een snelle verspreiding van deze technieken binnen de bredere dreigingsomgeving en roept op tot diepere samenwerking, verbeterde verdedigingsmaatregelen en bredere deelname uit de industrie aan het delen van dreigingen om opkomende AI-aangedreven aanvalmodellen te bestrijden.

FAQ ❓

- Wat heeft Anthropic in zijn onderzoek ontdekt?

Anthropic identificeerde en verstoorde een grootschalige cyberspionagecampagne die AI gebruikte om de meeste aanvalse operaties te automatiseren. - Wie zat er achter de aanval?

Het bedrijf schreef de operatie toe aan een door de staat gesponsorde Chinese groep aangeduid als GTG-1002. - Hoe werd AI gebruikt in de inbraken?

Aanvallers gebruikten Claude Code om autonoom verkenning, exploitatie, laterale beweging en gegevensextractie uit te voeren. - Waarom is het rapport belangrijk voor beveiligingsteams?

Anthropic zegt dat het geval aantoont dat autonome AI-aangedreven aanvallen nu haalbaar zijn op schaal en nieuwe verdedigingsstrategieën vereisen.