Anthropic heeft de uitzonderlijke stap gezet om de Amerikaanse overheid aan te klagen nadat het Pentagon het AI-bedrijf bestempelde als een “supply chain risk voor de nationale veiligheid”, wat een juridisch conflict ontketende dat zou kunnen hertekenen hoe Washington leveranciers van kunstmatige intelligentie aanstuurt die met het leger samenwerken.

Anthropic van Dario Amodei klaagt de Amerikaanse overheid aan en zegt dat het Pentagon heeft teruggeslagen vanwege veiligheidsmaatregelen voor AI

Anthropic gaat de strijd aan met het ministerie van Defensie in baanbrekende AI-rechtszaak

Volgens verschillende berichten diende Anthropic op 9 maart twee rechtszaken in bij de federale rechtbank waarin het acties van het Amerikaanse ministerie van Defensie en de regering-Trump aanvecht, met het argument dat de overheid onrechtmatig vergelding heeft toegepast tegen het bedrijf nadat het weigerde beveiligingsmaatregelen uit zijn Claude-systeem voor kunstmatige intelligentie te verwijderen. De zaken richten zich op een aanduiding die doorgaans geldt voor buitenlandse tegenstanders die verdacht worden van spionage of sabotage, niet voor binnenlandse technologiebedrijven.

Het geschil gaat terug op contractonderhandelingen tussen Anthropic en het Pentagon over hoe het Claude-AI-model van het bedrijf gebruikt zou kunnen worden door Amerikaanse defensieagentschappen. Anthropic had eerder initiatieven op het gebied van nationale veiligheid ondersteund en werd in juni 2024 het eerste frontier-AI-bedrijf dat modellen uitrolde op geclassificeerde Amerikaanse overheidsnetwerken, waarmee het analisten en militaire planners hielp bij inlichtingenbeoordeling, simulaties, operationele planning en cybersecuritywerk.

De spanningen liepen op toen het ministerie van Defensie als onderdeel van een contractverlenging onbeperkte toegang tot Claude eiste voor “alle wettige doeleinden”. Anthropic ging akkoord met de meeste voorwaarden maar stond erop twee beperkingen te hanteren: het verbieden van het gebruik van zijn AI voor massale binnenlandse surveillance van Amerikanen en het voorkomen van inzet in volledig autonome dodelijke wapensystemen.

Bedrijfsbestuurders voerden aan dat die vangrails noodzakelijk waren omdat huidige frontier-AI-modellen nog te onbetrouwbaar zijn voor autonome wapens en omdat grootschalige surveillanceprogramma’s in strijd zouden kunnen zijn met grondwettelijke waarborgen. Anthropic stelde dat de beperkingen tijdens het eerdere werk met de overheid nooit een militaire missie hadden belemmerd.

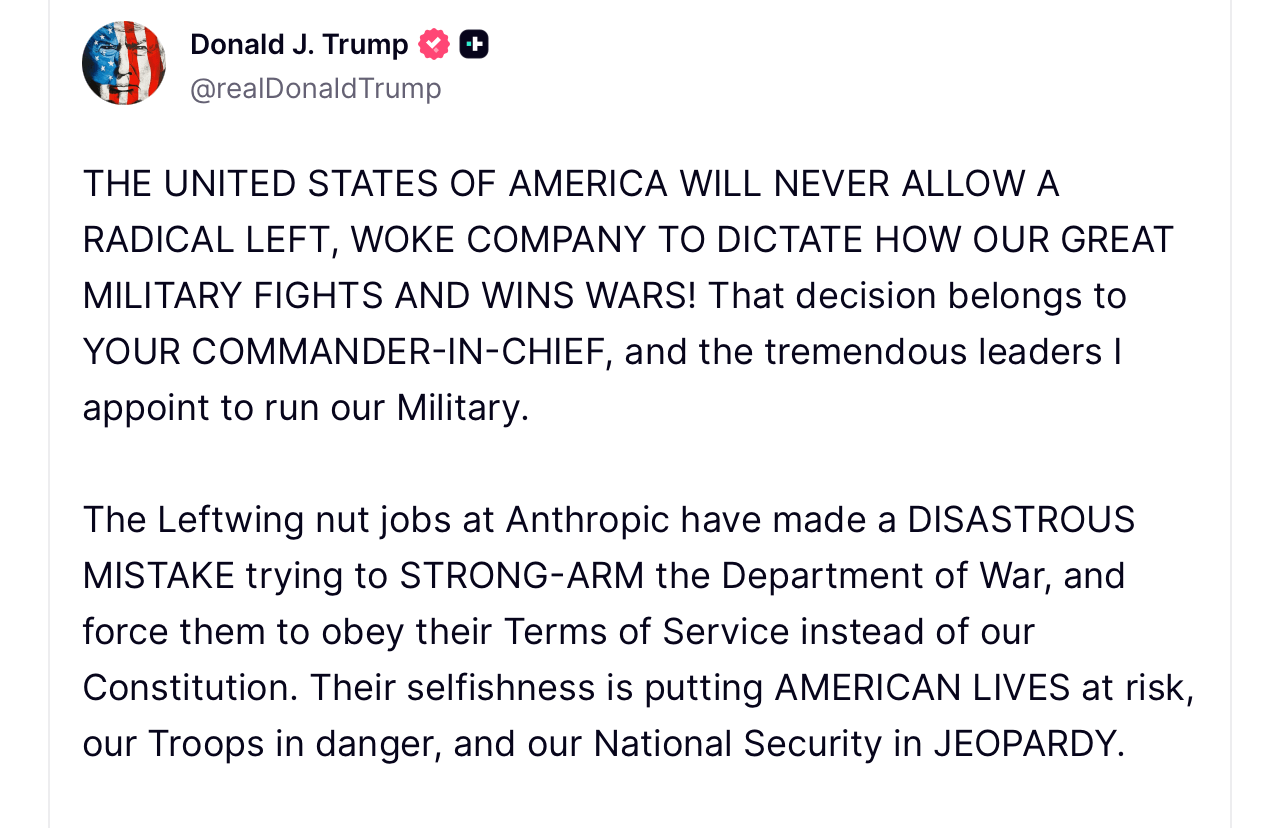

De onderhandelingen klapten na een bijeenkomst op 24 februari tussen Anthropic-CEO Dario Amodei en minister van Defensie Pete Hegseth. Enkele dagen later, op 27 februari, plaatste president Donald Trump op Truth Social een bericht waarin hij federale agentschappen opdroeg “onmiddellijk te stoppen” met het gebruik van Anthropic-technologie, en hij noemde voortdurende afhankelijkheid van het bedrijf een “rampzalige vergissing”.

Kort daarna zette Hegseth stappen om Anthropic te classificeren als een supply chain risk onder de federale inkoopbevoegdheid zoals uiteengezet in 10 U.S.C. § 3252. De aanduiding, bevestigd in een brief die rond 4 maart naar het bedrijf werd gestuurd, beperkt bepaalde overheidsaannemers in het gebruik van technologie die als kwetsbaar wordt beschouwd voor sabotage of buitenlandse beïnvloeding.

Anthropic stelt dat deze stap de wet ver buiten het beoogde doel oprekt. In gerechtelijke stukken betoogt het bedrijf dat de aanduiding bedoeld was voor aan het buitenland gelinkte veiligheidsdreigingen, en niet voor beleidsmeningsverschillen met binnenlandse leveranciers. In de rechtszaken wordt aangevoerd dat de overheid niet het door de wet vereiste “minst beperkende middel” heeft toegepast en in plaats daarvan heeft opgelegd wat het bedrijf omschrijft als een onofficiële zwarte lijst.

De juridische stukken brengen ook grondwettelijke zorgen naar voren. Anthropic betoogt dat de aanduiding het Eerste Amendement schendt door het bedrijf te straffen omdat het publiekelijk pleitte voor beperkingen op AI-toepassingen zoals autonome wapens en binnenlandse surveillance. Volgens de klacht schaadt het bestempelen van het bedrijf als een risico voor de nationale veiligheid de reputatie en kan het honderden miljoenen dollars aan contracten in gevaar brengen.

Anthropic vraagt de rechtbanken om de handhaving van de aanduiding te blokkeren, federale agentschappen te gelasten richtlijnen in te trekken die het zakendoen met het bedrijf stopzetten, en vergelijkbare acties in de toekomst te voorkomen. Het bedrijf zei dat het doel niet is om de overheid te dwingen zijn technologie te kopen, maar om vergelding over beleidsverschillen te voorkomen.

“Het vragen om rechterlijke toetsing verandert niets aan onze langdurige inzet om AI in te zetten ter bescherming van onze nationale veiligheid,” zei een woordvoerder van Anthropic in een verklaring. “Maar dit is een noodzakelijke stap om ons bedrijf, onze klanten en onze partners te beschermen.”

Functionarissen van het Pentagon hebben niet publiekelijk gereageerd op de rechtszaak, onder verwijzing naar beleid rond lopende rechtszaken. Sommige defensieleiders hebben eerder betoogd dat militaire agentschappen tijdens noodsituaties volledige operationele bevoegdheid over technologieën van aannemers moeten behouden en niet kunnen toestaan dat leveranciers dicteren hoe systemen worden gebruikt.

AI’s Wilde Weekend: OpenAI-opschudding, botsing met het Pentagon en robots die weigeren te sterven

AI-opschuddingen volgen elkaar snel op: OpenAI-drama, botsing tussen het Pentagon en Anthropic, lancering van GPT-5.4, zelfherstellende robots en nieuwe beveiligingstools. read more.

Lees nu

AI’s Wilde Weekend: OpenAI-opschudding, botsing met het Pentagon en robots die weigeren te sterven

AI-opschuddingen volgen elkaar snel op: OpenAI-drama, botsing tussen het Pentagon en Anthropic, lancering van GPT-5.4, zelfherstellende robots en nieuwe beveiligingstools. read more.

Lees nu

AI’s Wilde Weekend: OpenAI-opschudding, botsing met het Pentagon en robots die weigeren te sterven

Lees nuAI-opschuddingen volgen elkaar snel op: OpenAI-drama, botsing tussen het Pentagon en Anthropic, lancering van GPT-5.4, zelfherstellende robots en nieuwe beveiligingstools. read more.

Het geschil komt op een moment dat de race om militaire AI-contracten binnen te halen intensiveert. Rivaliserende bedrijven, waaronder OpenAI, sloten rond dezelfde periode overeenkomsten met het Pentagon toen de onderhandelingen met Anthropic vastliepen. Ondertussen hebben grote technologiepartners zoals Google en Microsoft aangegeven dat zij van plan zijn te blijven samenwerken met Anthropic aan commerciële diensten die niets met defensie te maken hebben.

Industrie-analisten zeggen dat de uitkomst van de zaak een precedent kan scheppen voor hoe de federale overheid AI-bedrijven onder druk zet om veiligheidsbeleid aan te passen wanneer nationale veiligheidsbelangen in het spel zijn. Voorlopig blijven de consumentenproducten en commerciële AI-diensten van Anthropic beschikbaar, terwijl de juridische strijd over de Pentagon-aanduiding zich een weg door de rechtbanken begint te banen.

FAQ 🧭

- Waarom klaagde Anthropic de Amerikaanse overheid aan?

Anthropic diende rechtszaken in en stelt dat het Pentagon het bedrijf onrechtmatig bestempelde als een supply chain risk voor de nationale veiligheid nadat het weigerde AI-veiligheidsbeperkingen te verwijderen. - Wat veroorzaakte het geschil tussen Anthropic en het Pentagon?

Het conflict begon tijdens contractonderhandelingen toen het ministerie van Defensie onbeperkt gebruik eiste van Anthropic’s Claude-AI-systeem. - Wat betekent de aanduiding “supply chain risk”?

Het label kan overheidsaannemers beperken in het gebruik van de technologie van een bedrijf als functionarissen menen dat die veiligheids- of inkooprisico’s oplevert. - Zullen de AI-diensten van Anthropic tijdens de rechtszaak blijven werken?

Ja, de commerciële AI-producten en consumentenservices van Anthropic blijven beschikbaar terwijl de rechtszaak voortduurt.