かつて暗号資産業界に限られていた分散型AIの実験が、NVIDIAのジェンセン・フアンCEOから公の場で評価を受けました。これは、分散型モデルトレーニングが主流に一歩近づきつつあることを示唆しています。

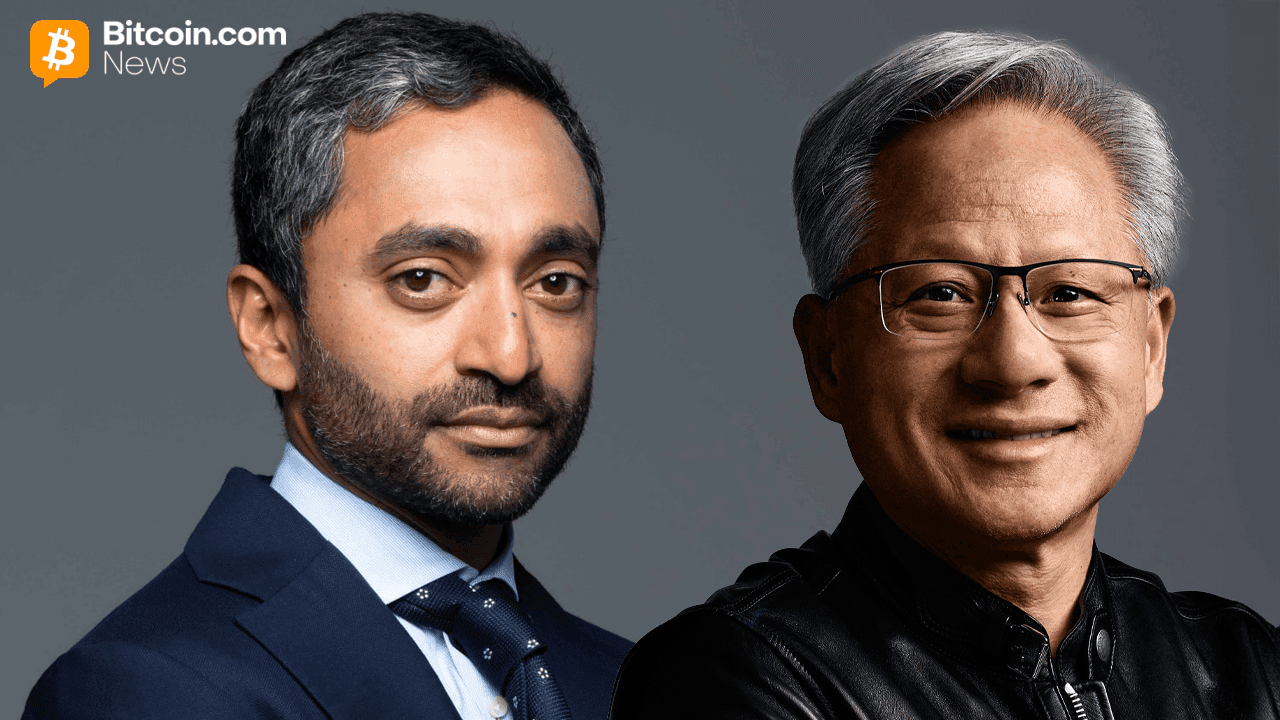

Bittensorのトレーニングに関するマイルストーンが、チャマス・パリハピティヤ氏とNVIDIAのジェンセン・フアンCEOの注目を集めています

NVIDIA CEOの支持を受け、オープンソースAIの勢いが加速

チャマス・パリハピティヤ氏はポッドキャスト『All-In』のエピソードで、Bittensorの「Covenant-72B」を取り上げ、分散型AIが理論の域を超えた具体的な事例であると紹介した。Bittensorは、機械学習モデルとAIコンピューティングを交換し、インセンティブを与えるピアツーピア(P2P)マーケットプレイスを構築する、分散型でブロックチェーン駆動のネットワークである。

パリハピティヤ氏は、この取り組みを平易な言葉で説明した。中央集権的なインフラなしで訓練された大規模言語モデル(LLM)であり、その代わりに独立した貢献者たちのネットワークによって駆動されているという。「彼らは、余剰な計算リソースを提供する多くの人々の協力により、完全に分散化された状態で40億パラメータのLLaMAモデルを訓練することに成功した」と述べ、これを「かなりクレイジーな技術的成果」と呼んだ。

この比喩は聴衆に馴染みやすいものとして受け止められました。「無作為に選ばれた人々がいて、一人ひとりがわずかなシェアを得る」とパリハピティヤ氏は付け加え、世界中の遊休ハードウェアを活用した初期の分散コンピューティングプロジェクトに言及しました。

Huang氏はこれを否定しませんでした。むしろ、AI市場のより広範な枠組みに言及し、分散型アプローチと独自開発型アプローチは互いに排他的ではないと示唆しました。「これら2つは『AかBか』ではなく、『AでありBでもある』のです」とHuang氏は述べました。「それについては疑いの余地はありません。」

この二本立てのビジョンは、AI分野内で拡大しつつある分断と、そして重なり合いを反映しています。一方には、ChatGPT、Claude、Geminiのようなクローズドで高度に洗練されたシステムがあります。もう一方には、開発者や組織が特定のニーズに合わせてシステムをカスタマイズできる、オープンソースかつ分散型のモデルがあります。

黄氏は、両方のアプローチが不可欠であると明確に述べました。「モデルは技術であり、製品ではない」と語り、ほとんどのユーザーはゼロから独自に構築するのではなく、洗練された汎用システムに依存し続けるだろうと指摘しました。

同時に、カスタマイズが必須となる業界にも言及しました。「特定の業界では、その分野の専門知識を……自らが制御できる形で取り込む必要がある」とHuang氏は説明し、「それはオープンモデルからしか得られない」と付け加えました。

この発言はまさにBittensorの得意分野に直結します。同社のSubnet 3(Templar)を通じて開発されたCovenant-72Bは、中央集権的な管理主体なしに標準的なインターネット接続を介して70人以上の貢献者を調整した、これまでで最大規模の分散型トレーニングの実例の一つです。

技術面でもこのモデルは限界を押し広げています。720億のパラメータを持ち、約1.1兆のトークンで学習された同モデルは、圧縮通信プロトコルや分散データ並列処理といった革新的な技術を活用することで、従来のデータセンターの外でもトレーニングを可能にしています。

性能指標は、これが単なる実験的な試みではないことを示唆しています。ベンチマーク結果によれば、確立された集中型モデルと互角の性能を発揮しており、この点が、本プロジェクトが暗号資産業界の枠を超えて注目を集めている理由の一つとなっています。

市場もこれを受け止めました。発表後、パリハピティヤ氏と黄氏の動画がソーシャルメディアで拡散されると、プロジェクトのトークン「TAO」は24%上昇しました。

Nvidia、20億ドルという巨額の投資でNebiusのAIファクトリー計画を後押しします

NvidiaがAIクラウドインフラに20億ドルを投資し、コンピューティングの未来をいかに変革しようとしているかをご紹介します。 read more.

今すぐ読む

Nvidia、20億ドルという巨額の投資でNebiusのAIファクトリー計画を後押しします

NvidiaがAIクラウドインフラに20億ドルを投資し、コンピューティングの未来をいかに変革しようとしているかをご紹介します。 read more.

今すぐ読む

Nvidia、20億ドルという巨額の投資でNebiusのAIファクトリー計画を後押しします

今すぐ読むNvidiaがAIクラウドインフラに20億ドルを投資し、コンピューティングの未来をいかに変革しようとしているかをご紹介します。 read more.

とはいえ、Huang氏によれば、真のストーリーは「破壊」ではなく、両者の「共存」にあるようです。一般ユーザー向けにはプロプライエタリなAIシステムが引き続き主流となる一方、オープンで分散型のモデルは、専門性の高い、コスト重視の、あるいは主権を重視するアプリケーションにおいて独自の役割を切り開いていくでしょう。

スタートアップ企業に対して、NVIDIAのCEOは現実的な戦略を示しました。まずオープンな形で始め、その後で独自技術の優位性を重ねていくというものです。「現在我々が投資しているスタートアップはすべて、まずオープンソースから始め、その後で独自モデルへと移行しています」と彼は述べました。

言い換えれば、AIの未来は単一のアーキテクチャや哲学に帰属するものではないかもしれません。それは、両方を巧みに使いこなし、それぞれをいつ活用すべきかを知っている人々の手に委ねられるでしょう。

FAQ 🔎

- BittensorのCovenant-72Bとは何ですか? 中央集権的なインフラを持たず、分散型の貢献者ネットワークを通じてトレーニングされた、720億パラメータの言語モデルです。

- ジェンセン・フアン氏は分散型AIについて何と言及しましたか? 彼は、オープンなAIモデルとプロプライエタリなAIモデルが共存すると述べ、その関係を「AとB」であり、どちらか一方を選ぶことではないと説明しました。

- この進展が重要な理由は? 大規模なAIモデルを従来のデータセンター外で学習できることを示しており、インフラ要件に関する従来の常識に疑問を投げかけています。

- これはAI業界にどのような影響を与えるのでしょうか? これは、中央集権型プラットフォームと分散型モデルが業界ごとに異なる役割を果たす、ハイブリッドな未来を後押しするものです。