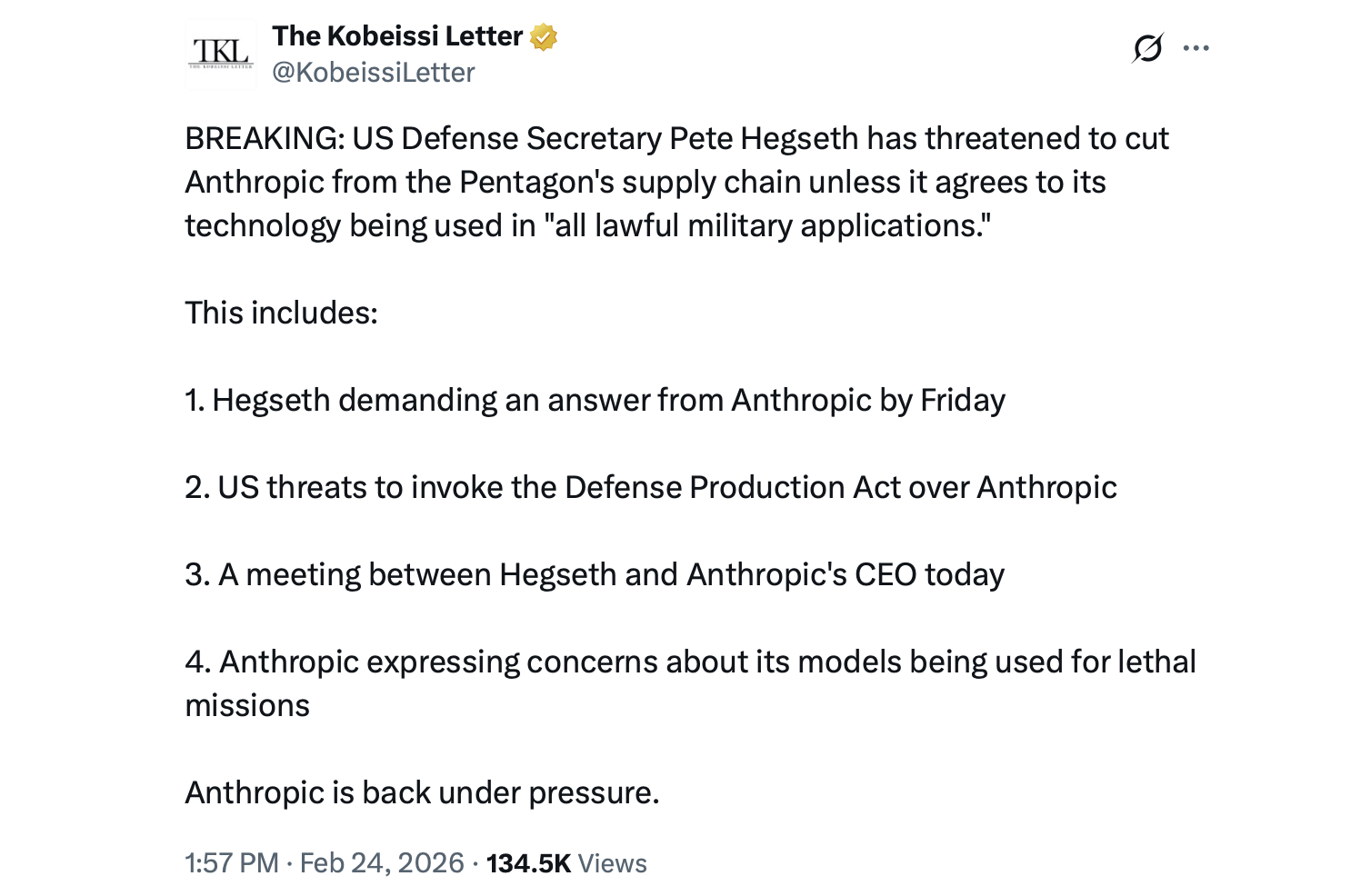

Martedì il segretario alla Difesa Pete Hegseth ha incontrato il CEO di Anthropic Dario Amodei al Pentagono, mentre il Dipartimento della Difesa ha esercitato pressioni su Anthropic affinché rimuovesse le restrizioni sul suo sistema di intelligenza artificiale (AI) Claude, pena l'applicazione di possibili sanzioni.

Rapporto: Claude AI di Anthropic affronta un futuro incerto nei sistemi classificati del Pentagono

La governance dell'IA militare messa alla prova in un incontro ad alto rischio al Pentagono

L'incontro del 24 febbraio è arrivato al culmine di settimane di tensione sulle politiche di utilizzo di Anthropic per Claude, il grande modello linguistico integrato nelle reti classificate del Dipartimento della Difesa nell'ambito di un contratto pilota del 2025 del valore di 200 milioni di dollari. Claude è attualmente l'unico modello linguistico di grandi dimensioni completamente autorizzato che opera su alcuni sistemi sicuri del Pentagono.

Secondo quanto riportato da Axios, Hegseth, affiancato dal vice segretario Steve Feinberg e dal consigliere generale Earl Matthews, ha contestato le restrizioni imposte da Anthropic sulla sorveglianza di massa degli americani e sui sistemi d'arma completamente autonomi che operano senza supervisione umana. I funzionari della Difesa hanno sostenuto che tali limiti ostacolano le applicazioni militari legittime e non dovrebbero prevalere sull'autorità del Congresso e dell'esecutivo.

Anthropic ha sostenuto che le sue misure di sicurezza sono progettate per prevenire un uso improprio, pur consentendo applicazioni di sicurezza nazionale. L'azienda afferma che le sue politiche non bloccano l'uso militare legittimo, ma vietano attività come il tracciamento di individui senza il loro consenso o l'impiego di sistemi letali senza controllo umano.

"Secondo una fonte vicina ai colloqui, Anthropic non ha mai obiettato all'uso dei suoi modelli per 'operazioni militari legittime'", ha riferito Jennifer Griffin, corrispondente capo per la sicurezza nazionale di Fox News, su X. "Ha anche detto a Hegseth di non aver mai presentato reclami al Pentagono o a Palantir per l'uso dei suoi modelli nel raid contro Maduro".

Claude è stato utilizzato per l'analisi dell'intelligence, la difesa informatica e la pianificazione operativa. I rapporti indicano che ha supportato la pianificazione e l'analisi in tempo reale durante l'operazione del 3 gennaio che ha portato alla cattura del presidente venezuelano Nicolás Maduro. Anthropic ha successivamente chiesto chiarimenti sul coinvolgimento del modello nell'ambito di una revisione interna della conformità, che i funzionari del Pentagono hanno interpretato come una critica.

Il 9 gennaio, Hegseth ha emesso una nota in cui esortava i fornitori di intelligenza artificiale (AI) a rimuovere quelle che descriveva come condizioni restrittive. Tale direttiva ha posto le basi per una rinegoziazione e, infine, per la riunione del 24 febbraio.

Il Pentagono ha fissato al 27 febbraio il termine ultimo per Anthropic per modificare i propri termini. Le possibili risposte includono l'invocazione del Defense Production Act per imporre la conformità o la designazione di Anthropic come rischio per la catena di approvvigionamento, una misura che potrebbe richiedere agli appaltatori di disinvestire dai sistemi relativi a Claude.

I funzionari riconoscono che separare Claude dall'infrastruttura esistente sarebbe operativamente complesso. Tuttavia, il dipartimento ha delle alternative. Concorrenti come xAI con il suo modello Grok, OpenAI con ChatGPT e Google con Gemini hanno contratti simili con il Dipartimento della Difesa e potrebbero essere in grado di espandere il loro ruolo se i colloqui dovessero fallire. La controversia mette in luce questioni più ampie relative alla governance dell'IA in ambito militare, in particolare poiché la legge federale continua ad evolversi intorno alle tecnologie emergenti. La posta in gioco è se gli sviluppatori privati di IA possano mantenere politiche etiche indipendenti quando i loro sistemi vengono integrati nelle operazioni di sicurezza nazionale.

La reazione sui social media è stata particolarmente schietta. "Torna la sorveglianza senza mandato", ha scritto un utente di X in risposta al post di Griffin. "Questa notizia dovrebbe avere molta più risonanza di quella che ha. C'è un serio rischio di violazioni costituzionali", ha risposto un altro utente al post di Griffin. Altri, con una dose di umorismo nero, hanno scherzato sul fatto che l'arrivo di Skynet potrebbe non essere lontano. "Skynet è qui… la linea temporale del 2029 è LIVE", ha commentato l'individuo. Entrambe le parti hanno definito la discussione del 24 febbraio come sostanziale. Il fatto che Anthropic modifichi o meno le sue misure di sicurezza prima della scadenza potrebbe determinare il futuro di una delle integrazioni di IA più avanzate del Pentagono.

FAQ 🤖

- Cosa è stato discusso durante la riunione del Pentagono del 24 febbraio? La riunione si è concentrata sulle restrizioni di Anthropic relative all'IA Claude e sulla possibilità che queste limitino le applicazioni militari legittime.

- Perché il Pentagono sta facendo pressione su Anthropic? I funzionari della difesa sostengono che le misure di sicurezza dell'azienda interferiscono con gli usi autorizzati per la sicurezza nazionale.

- Cosa potrebbe accadere se Anthropic non si conformasse? Il Pentagono potrebbe invocare il Defense Production Act o designare l'azienda come un rischio per la catena di approvvigionamento.

- Esistono alternative a Claude? Sì, i modelli di xAI, OpenAI e Google sono sotto contratto con il Dipartimento della Difesa e potrebbero essere ampliati se necessario.