I ricercatori di sicurezza stanno avvertendo che i browser e gli agenti con intelligenza artificiale (AI) di Perplexity, OpenAI e Anthropic affrontano rischi crescenti di attacchi nascosti di iniezione di prompt e violazioni della privacy, potenzialmente esponendo i dati degli utenti attraverso account connessi e API.

Browser AI sotto tiro: prompt Web nascosti possono dirottare il tuo agente e gli account connessi

Le vulnerabilità dei browser AI sollevano preoccupazioni per la sicurezza

I browser e gli agenti AI di Perplexity, OpenAI e Anthropic stanno ridefinendo come gli utenti interagiscono con il web—ma gli esperti dicono che la comodità ha un costo.

Secondo audit di sicurezza e ricerche esaminate, le vulnerabilità in questi sistemi permettono ad attori malintenzionati di inserire istruzioni nascoste nei siti web che gli strumenti AI potrebbero eseguire inconsapevolmente.

Questi attacchi, noti come iniezioni di prompt nascoste o indirette, possono manipolare gli agenti AI nel compiere azioni non autorizzate—come la divulgazione di informazioni sensibili, l’esecuzione di codice o il reindirizzamento degli utenti verso siti di phishing—senza il consenso esplicito dell’utente.

Come gli attacchi sfruttano gli agenti AI

In scenari di iniezione di prompt nascosti, gli attaccanti nascondono comandi malevoli all’interno del testo di una pagina web, nei metadati o anche in elementi invisibili. Una volta che un AI ingerisce quei dati, i comandi possono sovrascrivere l’intento dell’utente e causare all’agente di compiere azioni indesiderate. I test dimostrano che i browser AI non protetti possono cadere vittime di tali trucchi quasi una volta su quattro durante esperimenti controllati.

Perplexity, OpenAI, e Anthropic: Rischi chiave identificati

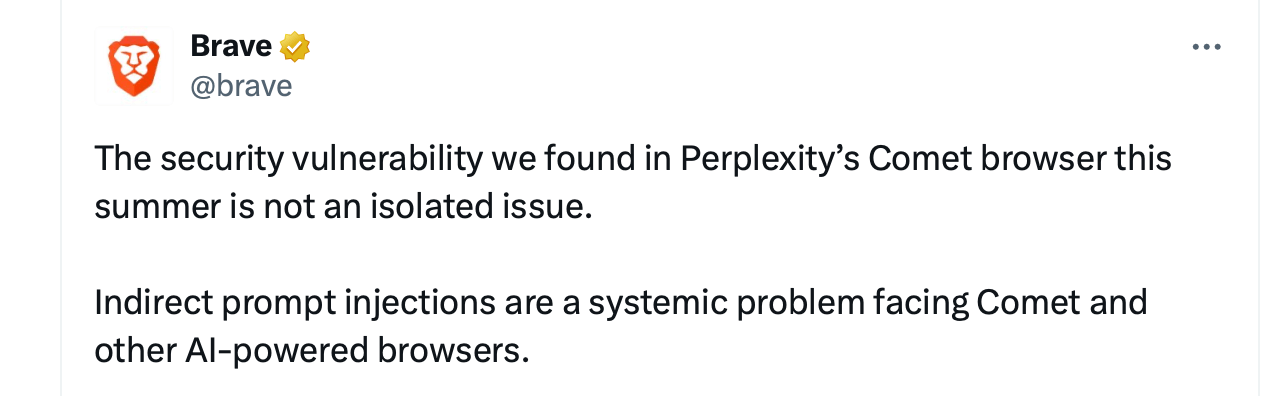

- Browser Comet di Perplexity: Gli audit di Brave e Guardio hanno scoperto che lo strumento poteva essere manipolato tramite post su Reddit o siti di phishing per eseguire script o estrarre dati degli utenti.

- Agenti di navigazione di OpenAI: Integrati nelle funzionalità agentiche di ChatGPT, hanno mostrato il rischio di accesso ad account connessi attraverso richieste malevoli via email o siti web.

- Estensione del browser Claude di Anthropic: Test di tipo red-team hanno rivelato che comandi nascosti nelle pagine web potrebbero attivare clic automatici su link dannosi.

Incidenti documentati e avvertimenti del settore

Ricercatori e società di sicurezza informatica, inclusi Brave, Guardio, e Malwarebytes, hanno pubblicato risultati mostrando che anche contenuti online semplici possono compromettere gli agenti AI. In un test, un post su Reddit ha forzato un browser AI a eseguire script di phishing. Rapporti da diverse principali pubblicazioni tecnologiche hanno avvertito che questi problemi potrebbero portare a accessi non autorizzati ai dati o persino a furti finanziari.

I pericoli dell’integrazione degli account

Gli analisti di sicurezza hanno sollevato bandiere rosse riguardo agli agenti AI collegati a password o API. Consentire tali integrazioni può esporre account email, drive cloud e piattaforme di pagamento. Techcrunch e Cybersecurity Dive entrambi hanno riportato istanze in cui gli agenti AI sono stati ingannati nel rivelare o manipolare informazioni sensibili tramite comandi iniettati.

Misure di sicurezza raccomandate e prospettive

Gli esperti esortano gli utenti a limitare le autorizzazioni, evitare di concedere agli agenti AI accessi a livello di password e monitorare i log AI per anomalie. Si consiglia inoltre agli sviluppatori di implementare sistemi di isolamento e filtri di prompt. Alcuni ricercatori raccomandano persino di utilizzare browser tradizionali per azioni sensibili fino a quando gli strumenti AI non riceveranno tutele più rigorose.

Mentre OpenAI, Anthropic e Perplexity hanno probabilmente sentito parlare delle sfide, i professionisti della sicurezza informatica avvertono che la navigazione AI rimane un’area ad alto rischio nel 2025. Poiché queste aziende spingono ulteriormente verso l’interazione web autonoma, gli osservatori del settore dicono che trasparenza e standard di sicurezza più forti sono essenziali prima che tali strumenti diventino di uso comune.

FAQ 🧭

- Cosa sono le iniezioni di prompt nascoste nei browser AI?

Sono comandi nascosti incorporati nei contenuti web che ingannano gli agenti AI facendoli eseguire azioni dannose senza il consenso dell’utente. - Quali strumenti AI delle aziende sono stati colpiti da queste vulnerabilità?

Il Comet di Perplexity, gli agenti di navigazione di ChatGPT di OpenAI e le funzionalità del browser Claude di Anthropic sono tutti stati citati nei recenti rapporti. - Quali rischi emergono collegando agenti AI ad account personali?

Connettere strumenti AI a drive, email o API può abilitare il furto di dati, phishing e accessi non autorizzati agli account. - Come possono gli utenti proteggersi dagli attacchi ai browser AI?

Limitare le autorizzazioni, evitare integrazioni di password, utilizzare modalità sandbox e rimanere aggiornati sugli avvisi di sicurezza.

Tag in questa storia

Scelte di Gioco Bitcoin

3,5% di Rakeback su Ogni Scommessa + Estrazioni Settimanali

425% fino a 5 BTC + 100 Giri Gratuiti

100% fino a $20K + Rakeback Giornaliero