Anthropic ha compiuto il passo straordinario di citare in giudizio il governo degli Stati Uniti dopo che il Pentagono ha etichettato l'azienda di intelligenza artificiale (AI) come "rischio per la sicurezza nazionale nella catena di approvvigionamento", scatenando uno scontro legale che potrebbe ridefinire il modo in cui Washington controlla i fornitori di intelligenza artificiale che lavorano con le forze armate.

Anthropic, l'azienda di Dario Amodei, fa causa al governo degli Stati Uniti, sostenendo che il Pentagono abbia messo in atto ritorsioni per le misure di sicurezza sull'intelligenza artificiale

Anthropic sfida il Dipartimento della Difesa in una storica causa legale sull'IA

Secondo diverse fonti, il 9 marzo Anthropic ha presentato due cause presso la corte federale contestando le azioni intraprese dal Dipartimento della Difesa degli Stati Uniti e dall'amministrazione Trump, sostenendo che il governo abbia intrapreso ritorsioni illegali contro l'azienda dopo che questa si è rifiutata di rimuovere le misure di sicurezza dal suo sistema di intelligenza artificiale Claude. Le cause prendono di mira una designazione che in genere si applica agli avversari stranieri sospettati di spionaggio o sabotaggio, non alle aziende tecnologiche nazionali.

La controversia risale alle trattative contrattuali tra Anthropic e il Pentagono su come il modello di intelligenza artificiale Claude dell'azienda potesse essere utilizzato dalle agenzie di difesa statunitensi. Anthropic aveva già sostenuto iniziative di sicurezza nazionale ed era diventata la prima azienda di intelligenza artificiale di frontiera a implementare modelli su reti classificate del governo statunitense nel giugno 2024, assistendo analisti e pianificatori militari nella revisione delle informazioni, nelle simulazioni, nella pianificazione operativa e nel lavoro di sicurezza informatica.

Le tensioni sono aumentate quando il Dipartimento della Difesa ha richiesto l'accesso illimitato a Claude per "tutti gli scopi legittimi" come parte del rinnovo del contratto. Anthropic ha accettato la maggior parte delle condizioni, ma ha insistito su due restrizioni: il divieto di utilizzare la sua IA per la sorveglianza di massa degli americani e l'impossibilità di implementarla in sistemi d'arma letali completamente autonomi.

I dirigenti dell'azienda hanno sostenuto che tali misure di sicurezza erano necessarie perché gli attuali modelli di IA all'avanguardia rimangono troppo inaffidabili per le armi autonome e perché i programmi di sorveglianza su larga scala potrebbero entrare in conflitto con le tutele costituzionali. Anthropic ha dichiarato che le restrizioni non hanno mai interferito con alcuna missione militare durante la sua precedente collaborazione con il governo.

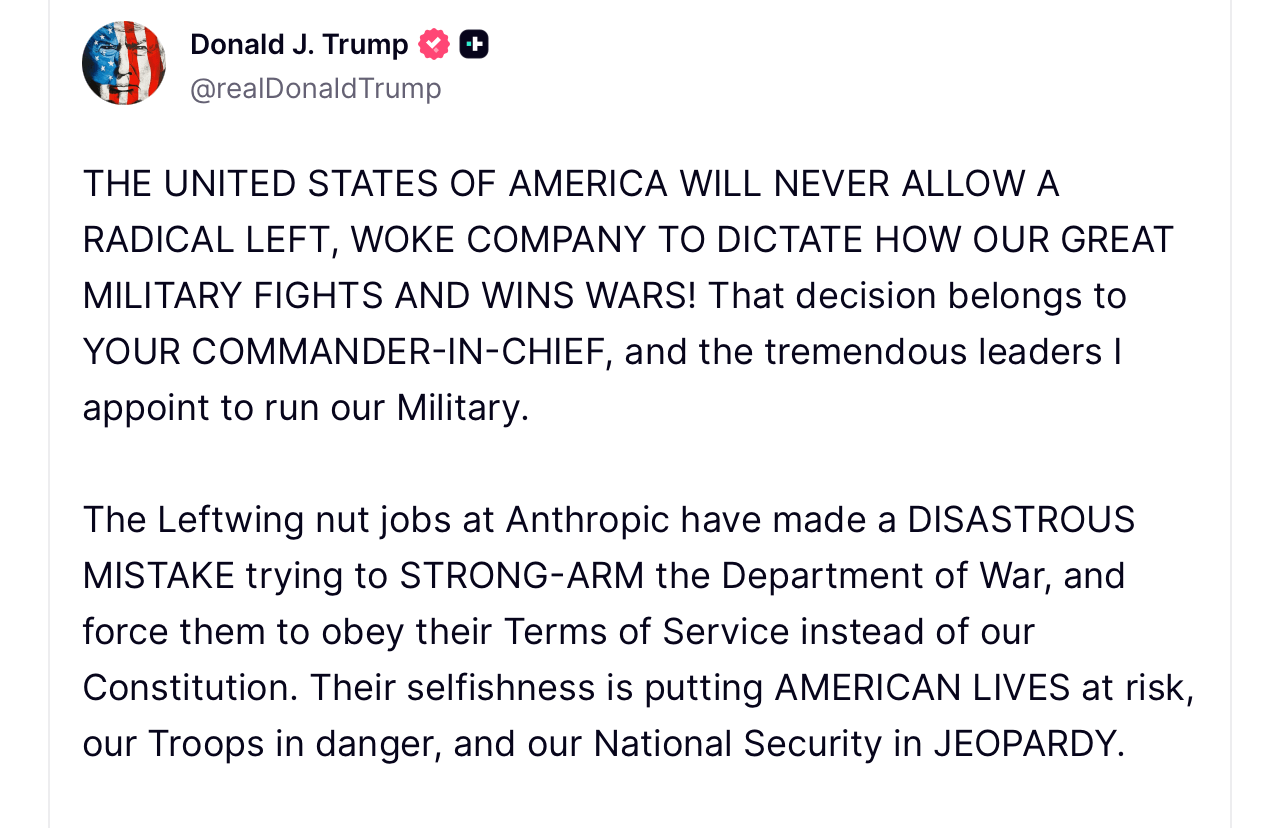

I negoziati sono falliti dopo un incontro del 24 febbraio tra il CEO di Anthropic Dario Amodei e il segretario alla Difesa Pete Hegseth. Alcuni giorni dopo, il 27 febbraio, il presidente Donald Trump ha pubblicato un post su Truth Social, ordinando alle agenzie federali di "cessare immediatamente" l'uso della tecnologia Anthropic, descrivendo il continuo affidamento alla società come un "errore disastroso".

Poco dopo, Hegseth ha deciso di classificare Anthropic come un rischio per la catena di approvvigionamento ai sensi dell'autorità federale in materia di appalti descritta nel 10 U.S.C. § 3252. La designazione, confermata in una lettera inviata all'azienda intorno al 4 marzo, limita l'uso da parte di alcuni appaltatori governativi di tecnologie considerate vulnerabili al sabotaggio o all'influenza straniera.

Anthropic sostiene che questa mossa estende lo statuto ben oltre lo scopo previsto. Nei documenti presentati in tribunale, l'azienda sostiene che la designazione era destinata alle minacce alla sicurezza legate all'estero piuttosto che ai disaccordi politici con i fornitori nazionali. Le cause legali sostengono che il governo non ha utilizzato i "mezzi meno restrittivi" richiesti dalla legge e ha invece imposto quella che l'azienda descrive come una lista nera non ufficiale.

I documenti legali sollevano anche questioni di costituzionalità. Anthropic sostiene che la designazione violi il Primo Emendamento, punendo l'azienda per aver pubblicamente sostenuto limiti all'uso dell'IA, come le armi autonome e la sorveglianza interna. Secondo la denuncia, etichettare l'azienda come un rischio per la sicurezza nazionale danneggia la sua reputazione e potrebbe mettere a rischio contratti per centinaia di milioni di dollari.

Anthropic chiede ai tribunali di bloccare l'applicazione della designazione, di ordinare alle agenzie federali di ritirare le direttive che interrompono i rapporti commerciali con l'azienda e di impedire azioni simili in futuro. L'azienda ha affermato che il suo obiettivo non è quello di costringere il governo ad acquistare la sua tecnologia, ma di impedire ritorsioni per divergenze politiche. "La richiesta di revisione giudiziaria non cambia il nostro impegno di lunga data a sfruttare l'IA per proteggere la nostra sicurezza nazionale", ha dichiarato un portavoce di Anthropic in una nota. "Ma questo è un passo necessario per proteggere la nostra attività, i nostri clienti e i nostri partner". I funzionari del Pentagono non hanno commentato pubblicamente il contenzioso, citando la politica relativa ai casi giudiziari in corso. Alcuni leader della difesa hanno precedentemente sostenuto che le agenzie militari devono mantenere la piena autorità operativa sulle tecnologie degli appaltatori durante le emergenze e non possono permettere ai fornitori di dettare le modalità di utilizzo dei sistemi.

Il weekend movimentato dell'IA: rivoluzione in OpenAI, scontro al Pentagono e robot che rifiutano di morire

I cambiamenti nell'IA si susseguono rapidamente: il caso OpenAI, lo scontro tra il Pentagono e Anthropic, il lancio di GPT-5.4, i robot autorigeneranti e i nuovi strumenti di sicurezza. read more.

Leggi ora

Il weekend movimentato dell'IA: rivoluzione in OpenAI, scontro al Pentagono e robot che rifiutano di morire

I cambiamenti nell'IA si susseguono rapidamente: il caso OpenAI, lo scontro tra il Pentagono e Anthropic, il lancio di GPT-5.4, i robot autorigeneranti e i nuovi strumenti di sicurezza. read more.

Leggi ora

Il weekend movimentato dell'IA: rivoluzione in OpenAI, scontro al Pentagono e robot che rifiutano di morire

Leggi oraI cambiamenti nell'IA si susseguono rapidamente: il caso OpenAI, lo scontro tra il Pentagono e Anthropic, il lancio di GPT-5.4, i robot autorigeneranti e i nuovi strumenti di sicurezza. read more.

La controversia arriva in un momento in cui si intensifica la corsa per assicurarsi i contratti militari relativi all'IA. Aziende rivali, tra cui OpenAI, hanno raggiunto accordi con il Pentagono più o meno nello stesso periodo in cui sono fallite le trattative con Anthropic. Nel frattempo, importanti partner tecnologici come Google e Microsoft hanno dichiarato che intendono continuare a collaborare con Anthropic su servizi commerciali non legati alla difesa.

Gli analisti del settore affermano che l'esito del caso potrebbe costituire un precedente per il modo in cui il governo federale esercita pressioni sulle aziende di IA affinché modifichino le politiche di sicurezza quando sono in gioco interessi di sicurezza nazionale. Per ora, i prodotti di consumo e i servizi commerciali di IA di Anthropic rimangono disponibili, mentre la battaglia legale sulla designazione del Pentagono inizia a farsi strada nei tribunali.

FAQ 🧭

- Perché Anthropic ha citato in giudizio il governo degli Stati Uniti? Anthropic ha intentato una causa sostenendo che il Pentagono ha illegittimamente etichettato l'azienda come un rischio per la catena di approvvigionamento della sicurezza nazionale dopo che questa si è rifiutata di rimuovere le restrizioni di sicurezza sull'IA.

- Cosa ha scatenato la controversia tra Anthropic e il Pentagono? Il conflitto è iniziato durante le trattative contrattuali, quando il Dipartimento della Difesa ha richiesto l'uso illimitato del sistema di IA Claude di Anthropic.

- Cosa significa la designazione "rischio per la catena di approvvigionamento"? L'etichetta può limitare l'uso della tecnologia di un'azienda da parte degli appaltatori governativi se i funzionari ritengono che essa comporti rischi per la sicurezza o gli appalti.

- I servizi di IA di Anthropic continueranno a funzionare durante la causa? Sì, i prodotti commerciali di IA e i servizi al consumatore di Anthropic rimangono disponibili mentre il caso legale procede.