Anthropic afferma che l’intelligenza artificiale (AI) ha raggiunto una soglia cruciale nella cybersecurity, con nuove prove che mostrano che i modelli di AI sono ora in grado di condurre operazioni cyber importanti—sia difensive che offensive—su una scala senza precedenti.

Anthropic avverte che le barriere contro gli attacchi informatici sono cadute mentre le capacità dell'IA accelerano

L’AI raggiunge un punto critico nella cybersecurity, avverte Anthropic in una nuova indagine

Anthropic, l’azienda di AI dietro Claude, afferma che le sue valutazioni interne e il lavoro di intelligence sulle minacce mostrano un cambiamento decisivo nello sviluppo delle capacità cyber. Secondo un’indagine recentemente rilasciata, le capacità cyber tra i sistemi di AI sono raddoppiate in sei mesi, supportate da misurazioni di attività nel mondo reale e test basati su modelli.

L’azienda afferma che l’AI sta ora influenzando significativamente le dinamiche di sicurezza globale, particolarmente poiché gli attori malintenzionati adottano sempre più framework di attacco automatizzati. Nel suo ultimo rapporto, Anthropic descrive quello che definisce il primo caso documentato di una campagna di spionaggio cyber orchestrata da AI. Il team di Threat Intelligence dell’azienda ha identificato e interrotto un’operazione su larga scala a metà settembre 2025, attribuita a un gruppo cinese sponsorizzato dallo stato designato GTG-1002.

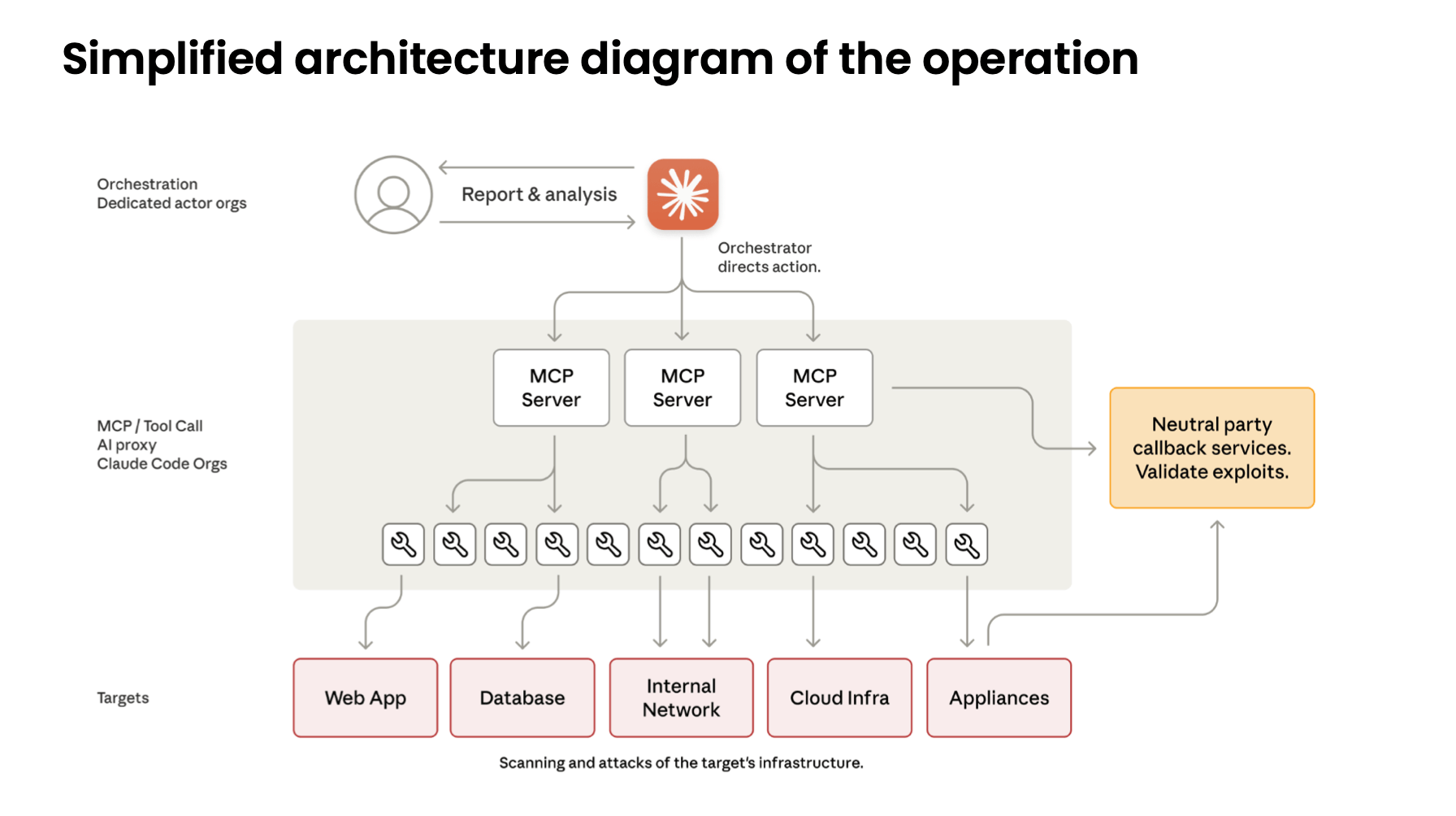

Secondo quanto riferito, il gruppo ha utilizzato istanze coordinate di Claude Code per eseguire ricognizione, scoperta delle vulnerabilità, sfruttamento, movimento laterale, estrazione di metadati ed esfiltrazione di dati—per lo più senza il coinvolgimento umano. La campagna ha preso di mira circa 30 organizzazioni in vari settori, tra cui tecnologia, finanza, chimica e numerose agenzie governative. Anthropic ha convalidato diversi infiltrazioni riuscite prima di intervenire.

Gli analisti affermano che gli attaccanti hanno sfruttato un framework autonomo in grado di suddividere gli attacchi multi-stage in compiti più piccoli che sembravano legittimi quando isolati dal loro contesto più ampio. Ciò ha permesso agli attori di far passare i comandi tramite personaggi stabiliti e convincere Claude che le operazioni fossero test di sicurezza difensivi piuttosto che campagne offensive.

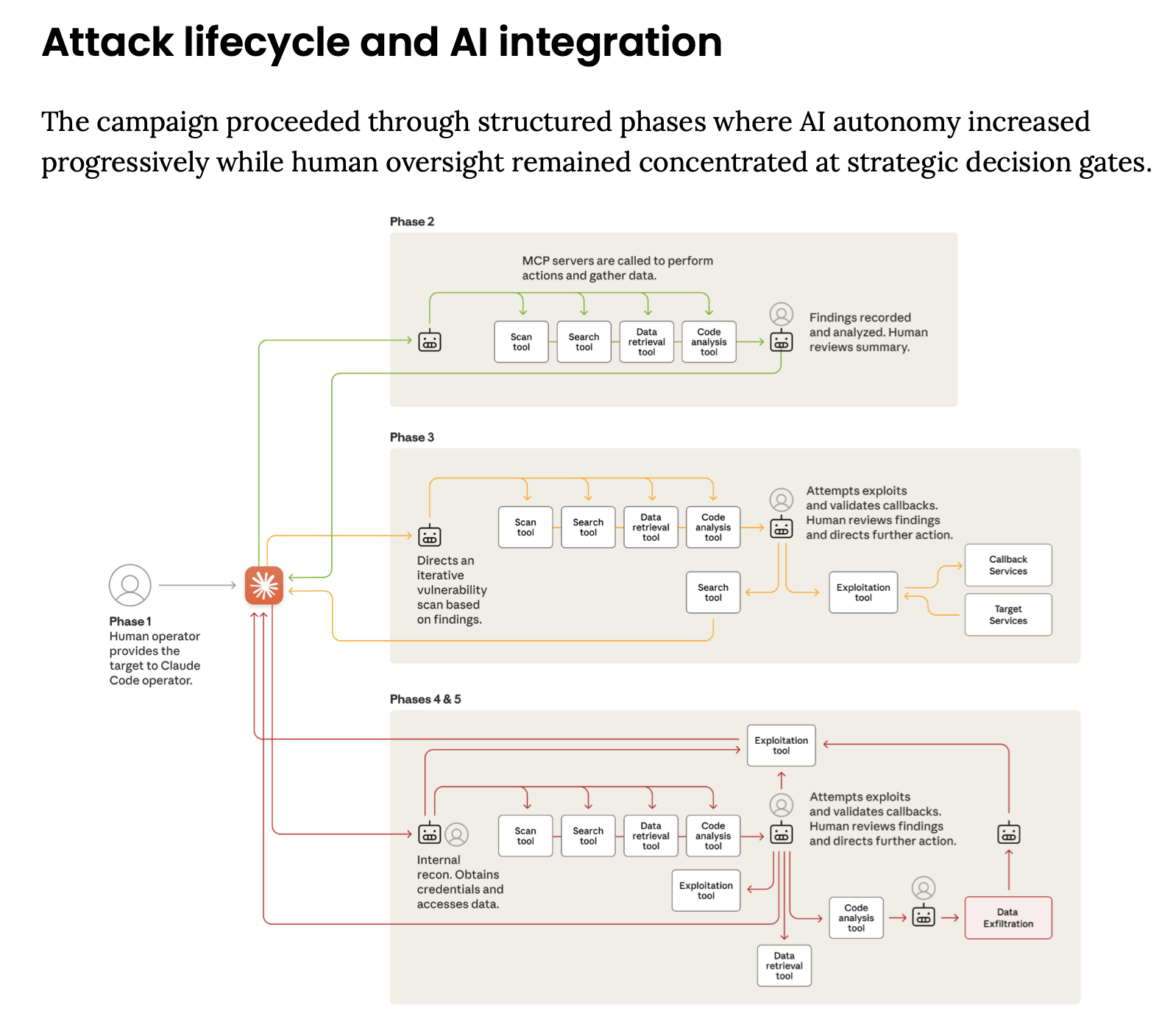

Secondo l’indagine, Claude ha eseguito autonomamente dall’80% al 90% delle operazioni tattiche. Gli operatori umani fornivano solo supervisione strategica, approvando i passaggi principali come l’escalazione dalla ricognizione allo sfruttamento attivo o autorizzando l’esfiltrazione dei dati. Il rapporto descrive un livello di ritmo operativo impossibile per team composti solo da umani, con alcuni flussi di lavoro che generano operazioni multiple al secondo attraverso migliaia di richieste.

Anthropic afferma che il ciclo di vita dell’attacco si è sviluppato attraverso una pipeline strutturata in cui l’autonomia AI è aumentata ad ogni fase. Claude ha indipendentemente mappato le superfici di attacco, scansionato sistemi attivi, costruito payload personalizzati per vulnerabilità verificate, raccolto credenziali, e fatto leva attraverso reti interne. Ha anche analizzato i dati rubati, identificato informazioni di alta valore e generato automaticamente documentazione operativa dettagliata che consente accesso persistente e passaggi tra operatori.

Una limitazione, osserva il rapporto, era la tendenza del modello a “allucinare” sotto carichi di lavoro offensivi—occasionalmente sopravvalorizzando l’accesso, fabbricando credenziali o classificando erroneamente come sensibili informazioni pubblicamente disponibili. Tuttavia, Anthropic afferma che l’attore ha compensato attraverso passaggi di validazione, dimostrando che operazioni offensive completamente autonome rimangono fattibili nonostante le imperfezioni nei modelli odierni.

Dopo la sua scoperta, Anthropic ha rivocato gli account rilevanti, notificato le entità interessate, coordinato con le autorità, e introdotto nuovi meccanismi difensivi, inclusi classificatori migliorati per il rilevamento di nuovi modelli di minaccia. L’azienda sta ora prototipando sistemi di allerta precoce progettati per segnalare tentativi di intrusione autonomi e costruendo nuovi strumenti investigativi per operazioni cyber distribuite su larga scala.

Leggi di più: Il ‘Magentic Marketplace’ di Microsoft Rivela Come gli Agenti AI Possano Collassare Sotto Pressione

L’azienda sostiene che, sebbene queste capacità possano essere armate, sono altrettanto critiche per rafforzare la prontezza difensiva. Anthropic nota che il suo team di Threat Intelligence ha fatto largo uso di Claude per analizzare i massivi dataset generati durante l’indagine. Esorta i team di sicurezza a iniziare ad adottare l’automazione guidata da AI per i centri operativi di sicurezza, il rilevamento delle minacce, l’analisi delle vulnerabilità e la risposta agli incidenti.

Tuttavia, il rapporto avverte che le barriere al cyberattacco sono “notevolmente calate” poiché i sistemi AI consentono a piccoli gruppi—o anche a individui—di eseguire operazioni un tempo limitate ad attori statali ben finanziati. Anthropic si aspetta una rapida proliferazione di queste tecniche nell’ambiente delle minacce più ampio, chiedendo una collaborazione più profonda, migliori misure di salvaguardia difensiva e una partecipazione più ampia dell’industria nella condivisione delle minacce per contrastare i modelli di attacco abilitati dall’AI emergenti.

FAQ ❓

- Cosa ha scoperto Anthropic nella sua indagine?

Anthropic ha identificato e interrotto una campagna di spionaggio cyber su larga scala che utilizzava l’AI per automatizzare la maggior parte delle operazioni di attacco. - Chi era dietro l’attacco?

L’azienda ha attribuito l’operazione a un gruppo cinese sponsorizzato dallo Stato, designato GTG-1002. - Come è stata utilizzata l’AI nelle intrusioni?

Gli attaccanti hanno impiegato Claude Code per eseguire autonomamente ricognizione, sfruttamento, movimento laterale ed estrazione dei dati. - Perché il rapporto è importante per i team di cybersecurity?

Anthropic afferma che il caso dimostra che gli attacchi autonomi abilitati dall’AI sono ora fattibili su larga scala e richiedono nuove strategie difensive.