Pete Hegseth védelmi miniszter kedden a Pentagonban találkozott Dario Amodeival, az Anthropic vezérigazgatójával, miközben a Védelmi Minisztérium arra sürgette az Anthropicot, hogy távolítsa el a Claude mesterséges intelligencia (MI) rendszerére vonatkozó korlátozásokat, különben lehetséges szankciókkal nézhet szembe.

Jelentés: Az Anthropic Claude AI-ja bizonytalan jövő elé néz a minősített Pentagon-rendszerekben

Katonai MI-irányítás próbája egy nagy téttel bíró pentagoni találkozón

A február 24-i találkozó hetek óta tartó feszültséget követett az Anthropic Claude-ra vonatkozó felhasználási irányelvei miatt; a Claude egy nagy nyelvi modell, amelyet egy 2025-ös, legfeljebb 200 millió dollár értékű kísérleti szerződés keretében integráltak a Védelmi Minisztérium minősített hálózataiba. A Claude jelenleg az egyetlen teljes mértékben engedélyezett nagy nyelvi modell, amely bizonyos biztonságos pentagoni rendszereken működik.

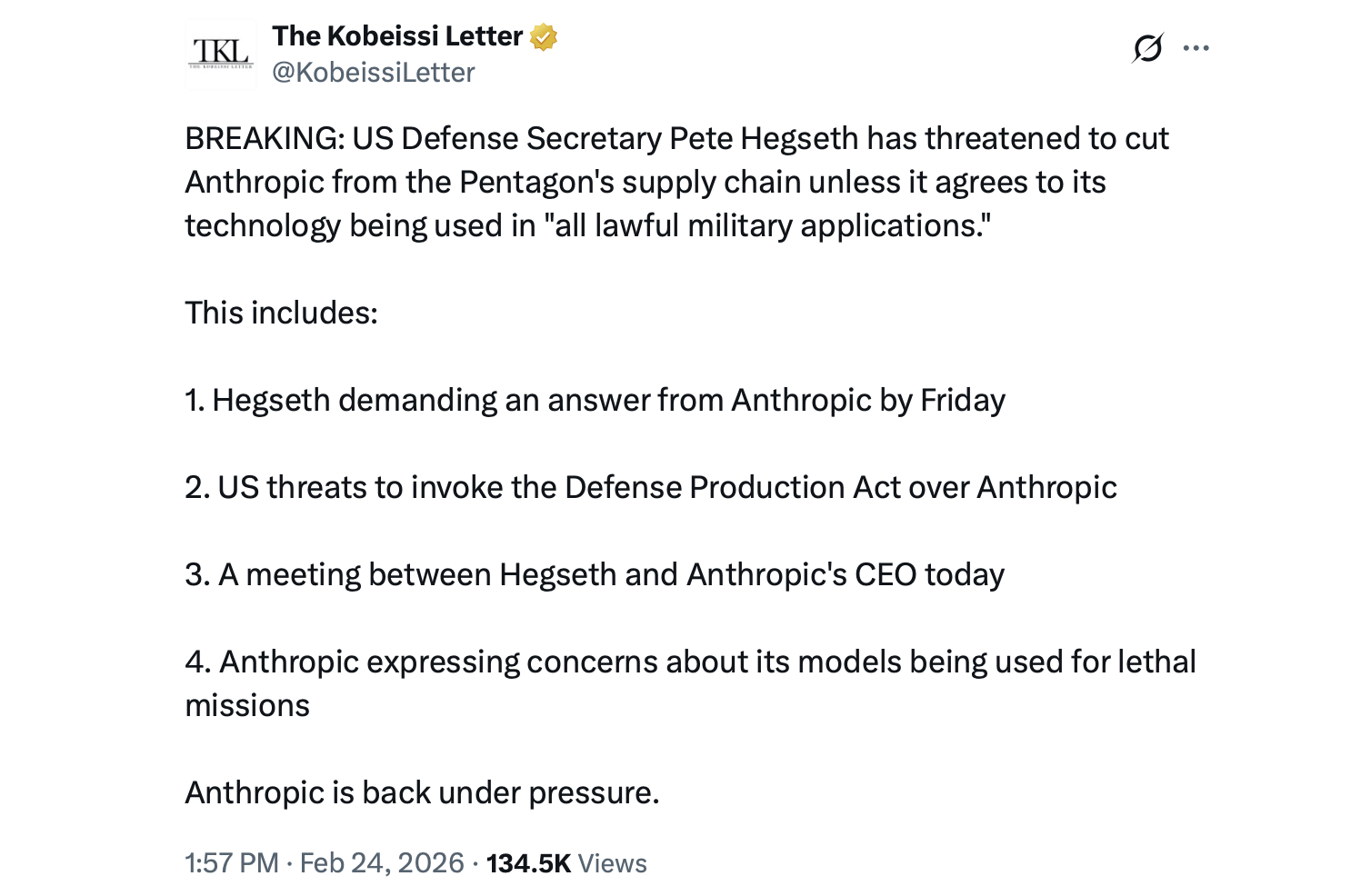

Az Axios beszámolója szerint Hegseth — a helyettes védelmi miniszter Steve Feinberg és a jogtanácsos Earl Matthews kíséretében — kifogásolta az Anthropic korlátozásait az amerikaiak tömeges megfigyelésével, valamint a teljesen autonóm, emberi felügyelet nélkül működő fegyverrendszerekkel kapcsolatban. Védelmi tisztviselők azzal érveltek, hogy ezek a korlátok gátolják a jogszerű katonai alkalmazásokat, és nem írhatják felül a kongresszusi és végrehajtói hatásköröket.

Az Anthropic kitart amellett, hogy védelmi korlátai a visszaélések megelőzését szolgálják, miközben továbbra is lehetővé teszik a nemzetbiztonsági felhasználásokat. A vállalat szerint irányelvei nem akadályozzák a legitim katonai használatot, de tiltják az olyan tevékenységeket, mint az egyének beleegyezés nélküli nyomon követése vagy a halálos rendszerek emberi irányítás nélküli telepítése.

„A tárgyalásokat ismerő egyik forrás szerint az Anthropic soha nem ellenezte modelljeinek ‘legitim katonai műveletekben’ való felhasználását” — jelentette X-en Jennifer Griffin, a Fox News vezető nemzetbiztonsági tudósítója. „Azt is közölte Hegsethhel, hogy soha nem panaszkodott a Pentagonnál vagy a Palantirnál a modelljei Maduro elleni rajtaütésben való használata miatt.”

A Claude-ot hírszerzési elemzésre, kiber-védelemre és műveleti tervezésre használták. Jelentések szerint támogatást nyújtott a tervezésben és a valós idejű elemzésben a január 3-i művelet során, amely Nicolás Maduro venezuelai elnök elfogásához vezetett. Az Anthropic később pontosítást kért a modell érintettségéről egy belső megfelelőségi felülvizsgálat részeként, amit a pentagoni tisztviselők bírálatként értelmeztek.

Január 9-én Hegseth feljegyzést adott ki, amelyben arra ösztönözte a mesterséges intelligencia (MI) szolgáltatókat, hogy távolítsák el az általa korlátozónak nevezett feltételeket. Ez az iránymutatás előkészítette a terepet az újratárgyalásokhoz, végül pedig a február 24-i találkozóhoz.

A Pentagon február 27-i határidőt szabott az Anthropicnak a feltételek módosítására. A lehetséges válaszlépések között szerepelhet a Defense Production Act alkalmazása a megfelelés kikényszerítésére, vagy az Anthropic ellátási lánc kockázataként való minősítése, ami olyan lépés, amely a beszállítóktól megkövetelheti a Claude-hoz kapcsolódó rendszerekből történő kivonulást.

A tisztviselők elismerik, hogy a Claude leválasztása a meglévő infrastruktúráról működésileg összetett lenne. Ennek ellenére a minisztériumnak vannak alternatívái. Olyan versenytársak, mint az xAI a Grok modelljével, az OpenAI a ChatGPT-vel, valamint a Google a Geminivel hasonló Védelmi Minisztériumi szerződések alatt állnak, és tárgyalások meghiúsulása esetén olyan helyzetbe kerülhetnek, hogy bővítsék szerepüket.

A vita szélesebb kérdéseket emel ki az MI katonai környezetben történő irányításáról, különösen miközben a szövetségi jog tovább fejlődik az új technológiák körül. A tét az, hogy a magán MI-fejlesztők fenn tudják-e tartani független etikai irányelveiket, amikor rendszereik beágyazódnak a nemzetbiztonsági műveletekbe.

A közösségi platformokon a reakciók feltűnően őszinték voltak. „Visszatért a bírói engedély nélküli megfigyelés” — írta egy X-felhasználó Griffin X-posztjára reagálva. „Ennek sokkal nagyobb hírnek kellene lennie annál, mint amekkora. Komoly esély van alkotmányos jogsértésekre” — válaszolta egy másik Griffin összefoglalójára. Mások sötét humorral viccelődtek, hogy a Skynet érkezése talán nincs is olyan messze. „A Skynet itt van… a 2029-es idővonal ÉLES” — jegyezte meg az illető.

Mindkét fél érdeminek nevezte a február 24-i egyeztetést. Az, hogy az Anthropic módosítja-e védelmi korlátait a határidő előtt, meghatározhatja a Pentagon egyik legfejlettebb MI-integrációjának jövőjét.

GYIK 🤖

- Miről volt szó a február 24-i pentagoni találkozón?

A találkozó az Anthropic Claude MI-re vonatkozó korlátozásaira összpontosított, és arra, hogy ezek korlátozzák-e a jogszerű katonai alkalmazásokat. - Miért gyakorol nyomást a Pentagon az Anthropicra?

A védelmi tisztviselők azzal érvelnek, hogy a vállalat védelmi korlátai beavatkoznak az engedélyezett nemzetbiztonsági felhasználásokba. - Mi történhet, ha az Anthropic nem tesz eleget?

A Pentagon alkalmazhatja a Defense Production Actet, vagy a vállalatot ellátási lánc kockázataként jelölheti meg. - Vannak alternatívák a Claude-ra?

Igen, az xAI, az OpenAI és a Google modelljei Védelmi Minisztériumi szerződések alatt állnak, és szükség esetén bővíthetik szerepüket.