Az Anthropic a rendkívüli lépésre szánta el magát, és beperelte az amerikai kormányt, miután a Pentagon „a nemzetbiztonság ellátási láncát fenyegető kockázatként” címkézte meg a mesterséges intelligenciával (MI) foglalkozó céget, jogi összecsapást kirobbantva, amely átalakíthatja azt, miként ellenőrzi Washington a hadsereggel együttműködő mesterségesintelligencia-beszállítókat.

Dario Amodei Anthropicja beperli az amerikai kormányt, azt állítva, hogy a Pentagon megtorlással válaszolt az MI-biztonsági korlátok miatt

Az Anthropic mérföldkőnek számító MI-perben száll szembe a Védelmi Minisztériummal

Több beszámoló szerint az Anthropic március 9-én két pert indított szövetségi bíróságon az Egyesült Államok Védelmi Minisztériuma és a Trump-adminisztráció intézkedései ellen, azt állítva, hogy a kormány jogellenesen megtorolta a vállalaton, miután az nem volt hajlandó eltávolítani a védőkorlátokat a Claude mesterségesintelligencia-rendszeréből. A perek egy olyan minősítést céloznak, amelyet tipikusan kémkedéssel vagy szabotázzsal gyanúsított külföldi ellenfelekre alkalmaznak, nem pedig belföldi technológiai cégekre.

A vita az Anthropic és a Pentagon közötti szerződéses tárgyalásokig nyúlik vissza arról, hogyan használhatnák a vállalat Claude MI-modelljét az amerikai védelmi ügynökségek. Az Anthropic korábban támogatta a nemzetbiztonsági kezdeményezéseket, és 2024 júniusában elsőként telepített határterületi (frontier) MI-modelleket minősített amerikai kormányzati hálózatokra, segítve elemzőket és katonai tervezőket hírszerzési áttekintésben, szimulációkban, műveleti tervezésben és kiberbiztonsági munkában.

A feszültség akkor fokozódott, amikor a Védelmi Minisztérium a szerződés megújításának részeként „minden jogszerű célra” korlátlan hozzáférést követelt Claude-hoz. Az Anthropic a legtöbb feltételbe beleegyezett, de ragaszkodott két korlátozáshoz: az MI amerikaiak elleni belföldi tömeges megfigyelésre való használatának tiltásához, illetve annak megakadályozásához, hogy teljesen autonóm, halálos fegyverrendszerekben telepítsék.

A cég vezetői azzal érveltek, hogy ezek a védőkorlátok szükségesek, mert a jelenlegi határterületi MI-modellek még túl megbízhatatlanok az autonóm fegyverekhez, és mert a nagyléptékű megfigyelési programok ütközhetnek az alkotmányos védelmekkel. Az Anthropic szerint a korlátozások korábbi kormányzati munkája során soha nem akadályoztak egyetlen katonai küldetést sem.

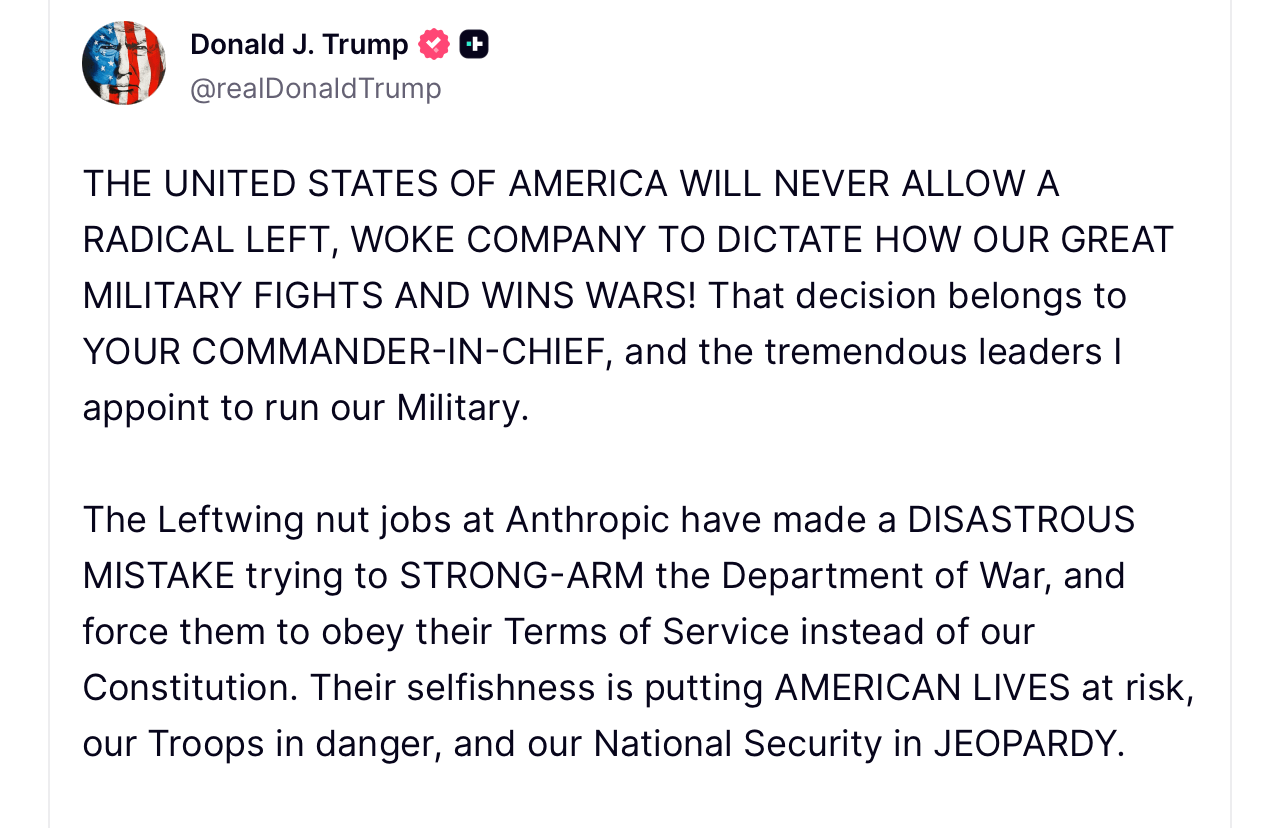

A tárgyalások egy február 24-i találkozó után omlottak össze Dario Amodei, az Anthropic vezérigazgatója és a védelmi miniszter, Pete Hegseth között. Néhány nappal később, február 27-én Donald Trump elnök a Truth Socialön közzétett bejegyzésében arra utasította a szövetségi ügynökségeket, hogy „azonnal szüntessék be” az Anthropic technológiájának használatát, és a vállalatra való további támaszkodást „katasztrofális hibának” nevezte.

Nem sokkal ezután Hegseth a 10 U.S.C. § 3252-ben rögzített szövetségi beszerzési felhatalmazás alapján ellátási lánc kockázatként kívánta minősíteni az Anthropic-ot. A minősítésről – amelyet a cégnek március 4. körül küldött levél erősített meg – bizonyos kormányzati vállalkozóknak megtiltja olyan technológia használatát, amelyet szabotázsnak vagy külföldi befolyásnak kiszolgáltatottnak tartanak.

Az Anthropic szerint ez a lépés a jogszabályt messze túlnyújtja az eredetileg szánt célján. A bírósági beadványokban a vállalat azt állítja, hogy a minősítést külföldi kötődésű biztonsági fenyegetésekre találták ki, nem pedig belföldi beszállítókkal fennálló szakpolitikai nézeteltérésekre. A perek szerint a kormány nem alkalmazta a törvény által megkövetelt „legkevésbé korlátozó eszközöket”, hanem ehelyett – a cég megfogalmazása szerint – egy nem hivatalos feketelistát vezetett be.

A jogi beadványok alkotmányos aggályokat is felvetnek. Az Anthropic szerint a minősítés sérti az első alkotmánykiegészítést, mert megbünteti a vállalatot amiatt, hogy nyilvánosan a MI-használat korlátozásai mellett érvelt, például az autonóm fegyverek és a belföldi megfigyelés terén. A kereset szerint a vállalat nemzetbiztonsági kockázatként való megbélyegzése rontja a hírnevét, és több százmillió dollárnyi szerződést veszélyeztethet.

Az Anthropic azt kéri a bíróságoktól, hogy tiltsák meg a minősítés végrehajtását, rendeljék el a szövetségi ügynökségek számára a vállalattal folytatott üzleti tevékenységet leállító irányelvek visszavonását, és akadályozzák meg a jövőben a hasonló lépéseket. A cég szerint a célja nem az, hogy rákényszerítse a kormányt technológiája megvásárlására, hanem hogy megelőzze a szakpolitikai nézetkülönbségek miatti megtorlást.

„A bírósági felülvizsgálat kérése nem változtat azon a régóta fennálló elkötelezettségünkön, hogy a MI-t nemzetbiztonságunk védelmében hasznosítsuk” – mondta közleményben az Anthropic szóvivője. „De ez szükséges lépés üzletünk, ügyfeleink és partnereink védelméhez.”

A Pentagon tisztviselői nem kommentálták nyilvánosan a pert, az aktív bírósági ügyekre vonatkozó irányelvre hivatkozva. Egyes védelmi vezetők korábban azzal érveltek, hogy vészhelyzetekben a katonai ügynökségeknek meg kell őrizniük a vállalkozók technológiái feletti teljes műveleti felhatalmazást, és nem engedhetik meg, hogy a beszállítók diktálják, miként használják a rendszereket.

Az MI vad hétvégéje: OpenAI-felfordulás, összecsapás a Pentagonnal, és a robotok, amelyek nem hajlandók meghalni

Az MI világát gyorsan felkavaró változások: OpenAI-dráma, a Pentagon összecsapása az Anthropiccal, a GPT-5.4 indulása, öngyógyító robotok és új biztonsági eszközök. read more.

Olvass most

Az MI vad hétvégéje: OpenAI-felfordulás, összecsapás a Pentagonnal, és a robotok, amelyek nem hajlandók meghalni

Az MI világát gyorsan felkavaró változások: OpenAI-dráma, a Pentagon összecsapása az Anthropiccal, a GPT-5.4 indulása, öngyógyító robotok és új biztonsági eszközök. read more.

Olvass most

Az MI vad hétvégéje: OpenAI-felfordulás, összecsapás a Pentagonnal, és a robotok, amelyek nem hajlandók meghalni

Olvass mostAz MI világát gyorsan felkavaró változások: OpenAI-dráma, a Pentagon összecsapása az Anthropiccal, a GPT-5.4 indulása, öngyógyító robotok és új biztonsági eszközök. read more.

A vita akkor éleződik, amikor fokozódik a katonai MI-szerződések megszerzéséért folyó verseny. Rivális vállalatok – köztük az OpenAI – nagyjából ugyanebben az időszakban kötöttek megállapodásokat a Pentagonnal, amikor az Anthropic tárgyalásai összeomlottak. Eközben a jelentős technológiai partnerek, például a Google és a Microsoft jelezték, hogy a védelemtől független, kereskedelmi szolgáltatások terén továbbra is együtt kívánnak működni az Anthropic-kal.

Iparági elemzők szerint az ügy kimenetele precedenst teremthet arra, miként gyakorol nyomást a szövetségi kormány az MI-cégekre, hogy módosítsák biztonsági irányelveiket, amikor nemzetbiztonsági érdekek forognak kockán. Egyelőre az Anthropic fogyasztói termékei és kereskedelmi MI-szolgáltatásai továbbra is elérhetők, miközben a Pentagon minősítése körüli jogi csata megkezdi útját a bíróságokon.

GYIK 🧭

- Miért perelte be az Anthropic az amerikai kormányt?

Az Anthropic olyan pereket indított, amelyek szerint a Pentagon jogellenesen minősítette a vállalatot nemzetbiztonsági ellátási lánc kockázatának, miután az nem volt hajlandó eltávolítani a MI-biztonsági korlátozásokat. - Mi váltotta ki a vitát az Anthropic és a Pentagon között?

A konfliktus a szerződéses tárgyalások során kezdődött, amikor a Védelmi Minisztérium az Anthropic Claude MI-rendszerének korlátlan használatát követelte. - Mit jelent az „ellátási lánc kockázata” minősítés?

A címke korlátozhatja, hogy kormányzati vállalkozók használják egy cég technológiáját, ha a tisztviselők úgy vélik, az biztonsági vagy beszerzési kockázatot jelent. - Működni fognak-e az Anthropic MI-szolgáltatásai a per ideje alatt is?

Igen, az Anthropic kereskedelmi MI-termékei és fogyasztói szolgáltatásai továbbra is elérhetők, amíg a jogi eljárás zajlik.