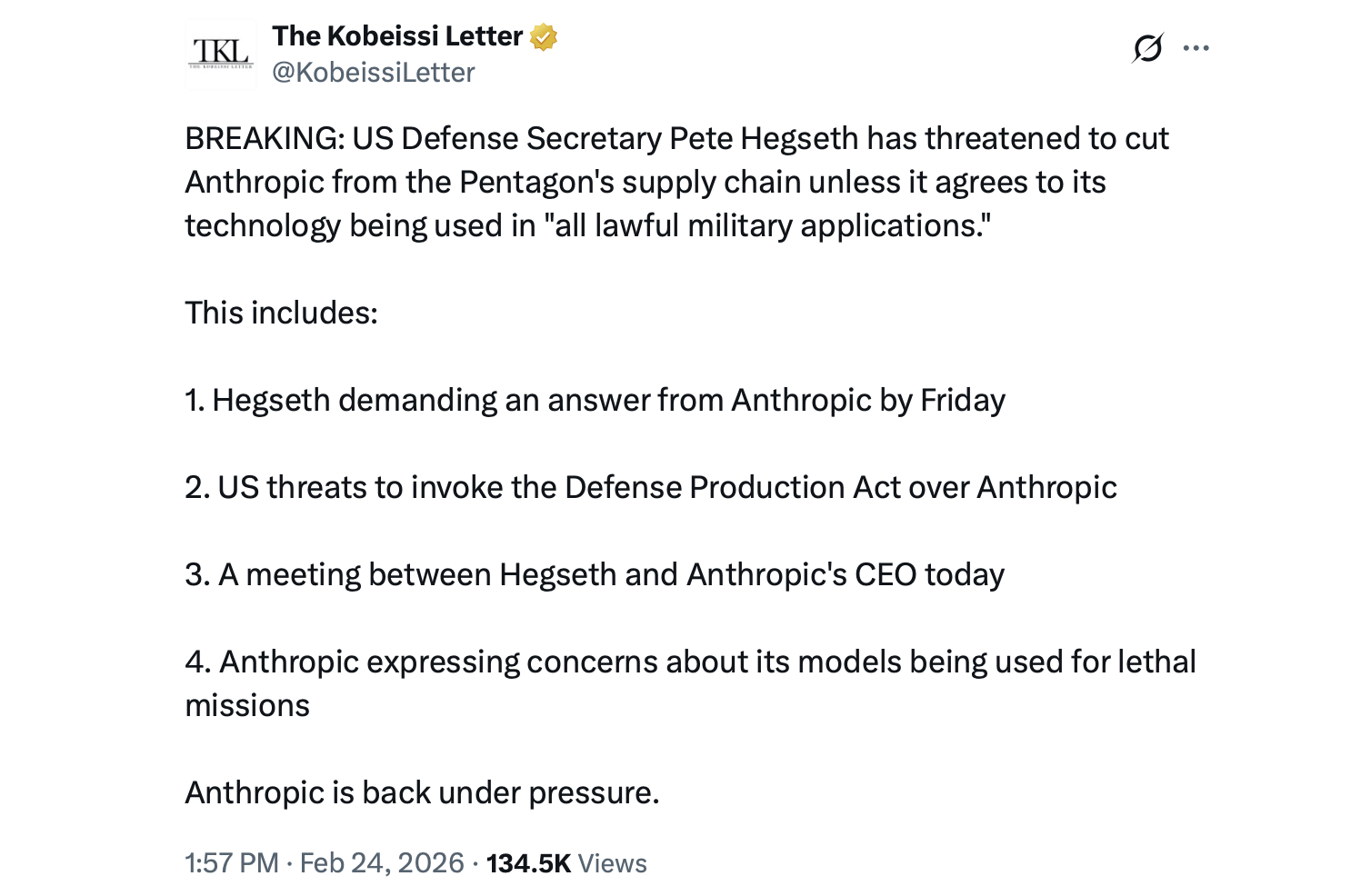

Ministar obrane Pete Hegseth sastao se u utorak u Pentagonu s izvršnim direktorom Anthropica Dariom Amodeijem, dok je Ministarstvo obrane pritiskalo Anthropic da ukloni ograničenja na svom sustavu umjetne inteligencije (AI) Claude ili se suoči s mogućim kaznama.

Izvješće: Anthropicov Claude AI suočava se s neizvjesnom budućnošću u povjerljivim sustavima Pentagona

Upravljanje vojnom umjetnom inteligencijom na kušnji u rizičnom sastanku u Pentagonu

Sastanak 24. veljače uslijedio je nakon tjedana napetosti oko Anthropicevih pravila korištenja za Claude, veliki jezični model integriran u klasificirane mreže Ministarstva obrane u okviru pilot-ugovora za 2025. vrijedan do 200 milijuna dolara. Claude je trenutačno jedini potpuno autorizirani veliki jezični model koji radi na određenim sigurnim sustavima Pentagona.

Prema Axiosovu izvještavanju, Hegseth, uz zamjenika ministra Stevea Feinberga i glavnog pravnog savjetnika Earla Matthewsa, usprotivio se Anthropicevim ograničenjima masovnog nadzora Amerikanaca i potpuno autonomnih oružanih sustava koji djeluju bez ljudskog nadzora. Dužnosnici obrane tvrdili su da ta ograničenja sputavaju zakonite vojne primjene i ne bi trebala nadjačati kongresne i izvršne ovlasti.

Anthropic tvrdi da su njegove zaštitne mjere osmišljene kako bi spriječile zloupotrebu, a istodobno omogućile primjene u nacionalnoj sigurnosti. Tvrtka navodi da njezina pravila ne blokiraju legitimnu vojnu uporabu, ali zabranjuju aktivnosti poput praćenja pojedinaca bez pristanka ili raspoređivanja smrtonosnih sustava bez ljudske kontrole.

“Prema izvoru upoznatom s razgovorima, Anthropic se nikada nije protivio korištenju svojih modela za ‘legitimne vojne operacije’”, izvijestila je na X-u glavna dopisnica Fox Newsa za nacionalnu sigurnost Jennifer Griffin. “Također je rekao Hegsethu da se nikada nije žalio Pentagonu ili Palantiru zbog korištenja svojih modela u raciji na Madura.”

Claude se koristio za obavještajnu analizu, kibernetičku obranu i operativno planiranje. Izvješća navode da je podržao planiranje i analizu u stvarnom vremenu tijekom operacije 3. siječnja koja je rezultirala zarobljavanjem venezuelanskog predsjednika Nicolása Madura. Anthropic je kasnije zatražio pojašnjenje o uključenosti modela u sklopu interne provjere usklađenosti, što su dužnosnici Pentagona protumačili kao kritiku.

Dana 9. siječnja Hegseth je izdao dopis kojim je pozvao pružatelje umjetne inteligencije (AI) da uklone ono što je opisao kao restriktivne uvjete. Ta je direktiva postavila temelje za ponovne pregovore i na koncu za sastanak 24. veljače.

Pentagon je postavio rok do 27. veljače da Anthropic izmijeni svoje uvjete. Mogući odgovori uključuju pozivanje na Zakon o obrambenoj proizvodnji (Defense Production Act) kako bi se prisililo na usklađivanje ili proglašavanje Anthropica rizikom za lanac opskrbe, korak koji bi mogao zahtijevati od izvođača da se povuku iz sustava povezanih s Claudeom.

Dužnosnici priznaju da bi razdvajanje Claudea od postojeće infrastrukture bilo operativno složeno. Ipak, odjel ima alternative. Konkurenti poput xAI-a sa svojim modelom Grok, OpenAI-a s ChatGPT-om te Googlea s Geminijem nalaze se pod sličnim ugovorima Ministarstva obrane i mogli bi biti u poziciji proširiti svoje uloge ako pregovori zapnu.

Spor ističe šira pitanja upravljanja umjetnom inteligencijom u vojnim okruženjima, osobito dok se federalni zakon nastavlja mijenjati u vezi s novim tehnologijama. Ulog je u tome mogu li privatni razvijatelji AI-ja zadržati neovisne etičke politike kada njihovi sustavi postanu ugrađeni u operacije nacionalne sigurnosti.

Reakcije na platformama društvenih mreža bile su osobito otvorene. “Nadzor bez naloga se vratio”, jedan je korisnik X-a napisao kao odgovor na Griffininu objavu na X-u. “Ovo mora biti puno veća vijest nego što jest. Postoji ozbiljna mogućnost ustavnih kršenja”, drugi je odgovorio na Griffininu objavu. Drugi su, uz dozu crnog humora, zbijali šale da Skynetov dolazak možda i nije daleko. “Skynet je ovdje… vremenska crta za 2029. je AKTIVNA”, primijetila je ta osoba.

Obje su strane razgovor 24. veljače okarakterizirale kao sadržajan. Hoće li Anthropic prilagoditi svoje zaštitne mjere prije roka moglo bi odrediti budućnost jedne od najnaprednijih integracija umjetne inteligencije u Pentagonu.

ČPP 🤖

- O čemu se raspravljalo na sastanku u Pentagonu 24. veljače?

Sastanak se usredotočio na Anthropiceva ograničenja za Claude AI i na to ograničavaju li ona zakonite vojne primjene. - Zašto Pentagon vrši pritisak na Anthropic?

Dužnosnici obrane tvrde da zaštitne mjere tvrtke ometaju odobrene uporabe u nacionalnoj sigurnosti. - Što bi se moglo dogoditi ako Anthropic ne postupi po zahtjevu?

Pentagon bi mogao pozvati se na Zakon o obrambenoj proizvodnji ili proglasiti tvrtku rizikom za lanac opskrbe. - Postoje li alternative Claudeu?

Da, modeli iz xAI-a, OpenAI-a i Googlea su pod ugovorima Ministarstva obrane i mogli bi se proširiti po potrebi.