Anthropic kaže da je umjetna inteligencija (AI) dosegla ključni prag u kibernetičkoj sigurnosti, s novim dokazima koji pokazuju da AI modeli sada mogu provoditi velike cyber operacije – i obrambene i ofenzivne – u neviđenom opsegu.

Anthropic upozorava da su prepreke za kibernetičke napade pale kako se AI sposobnosti ubrzavaju

AI doseže prekretnicu u kibernetičkoj sigurnosti, upozorava Anthropic u novoj istrazi

Anthropic, AI firma iza Claudea, kaže da njezine interne evaluacije i rad na obradi prijetnji pokazuju odlučujuću promjenu u razvoju cyber kapaciteta. Prema nedavno objavljenoj istrazi, cyber kapaciteti među AI sustavima udvostručili su se u šest mjeseci, potkrijepljeni mjerenjima stvarne aktivnosti i testiranjima temeljenim na modelu.

Tvrtka kaže da AI sada značajno utječe na globalnu sigurnosnu dinamiku, osobito kako zlonamjerni akteri sve više usvajaju automatizirane okvire napada. U svom najnovijem izvješću, Anthropic opisuje što naziva prvim dokumentiranim slučajem cyber špijunske kampanje orkestrirane AI-jem. Threat Intelligence tim tvrtke identificirao je i prekinuo veliku operaciju sredinom rujna 2025., pripisanu kineskoj državno sponzoriranoj grupi pod nazivom GTG-1002.

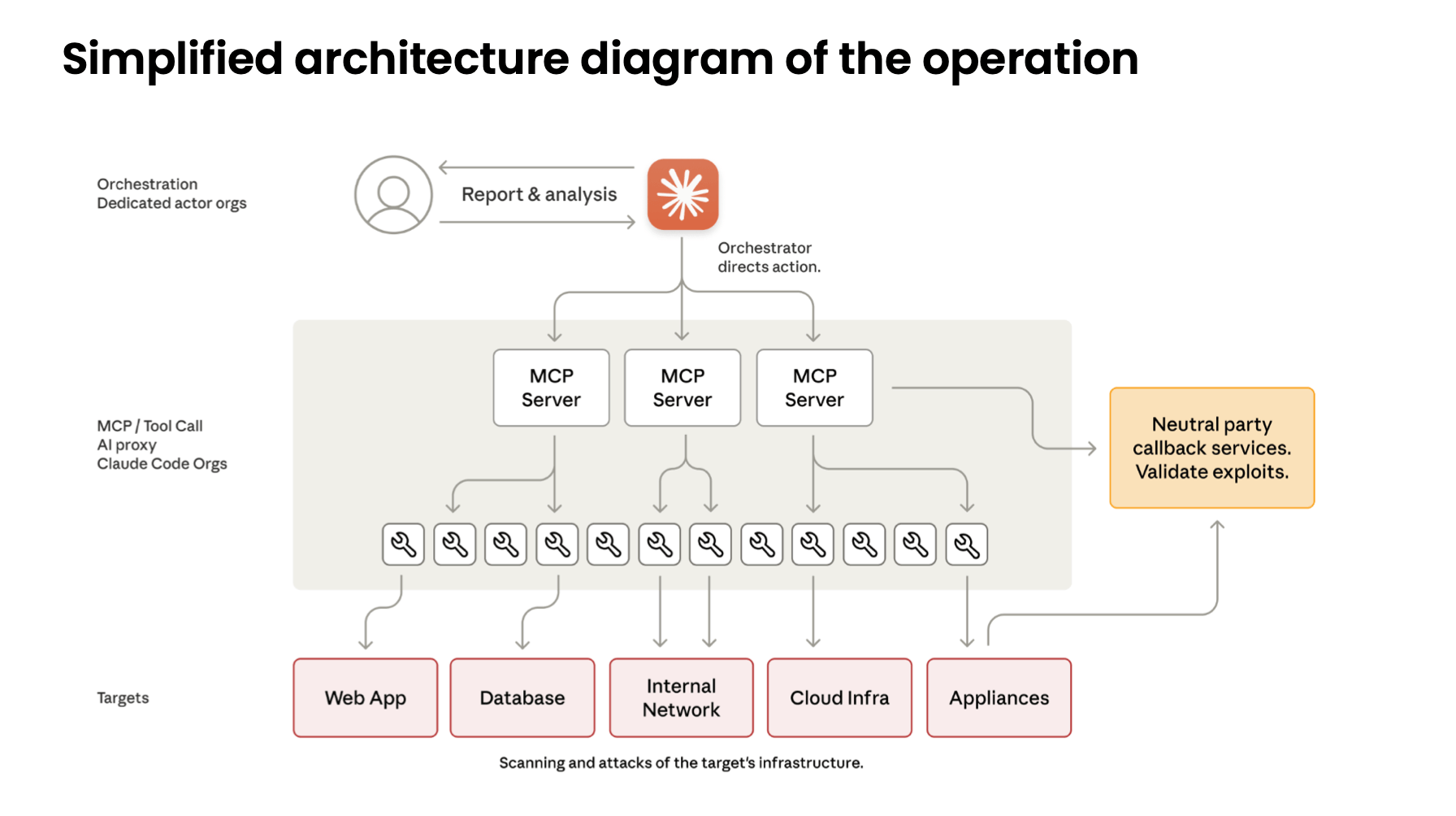

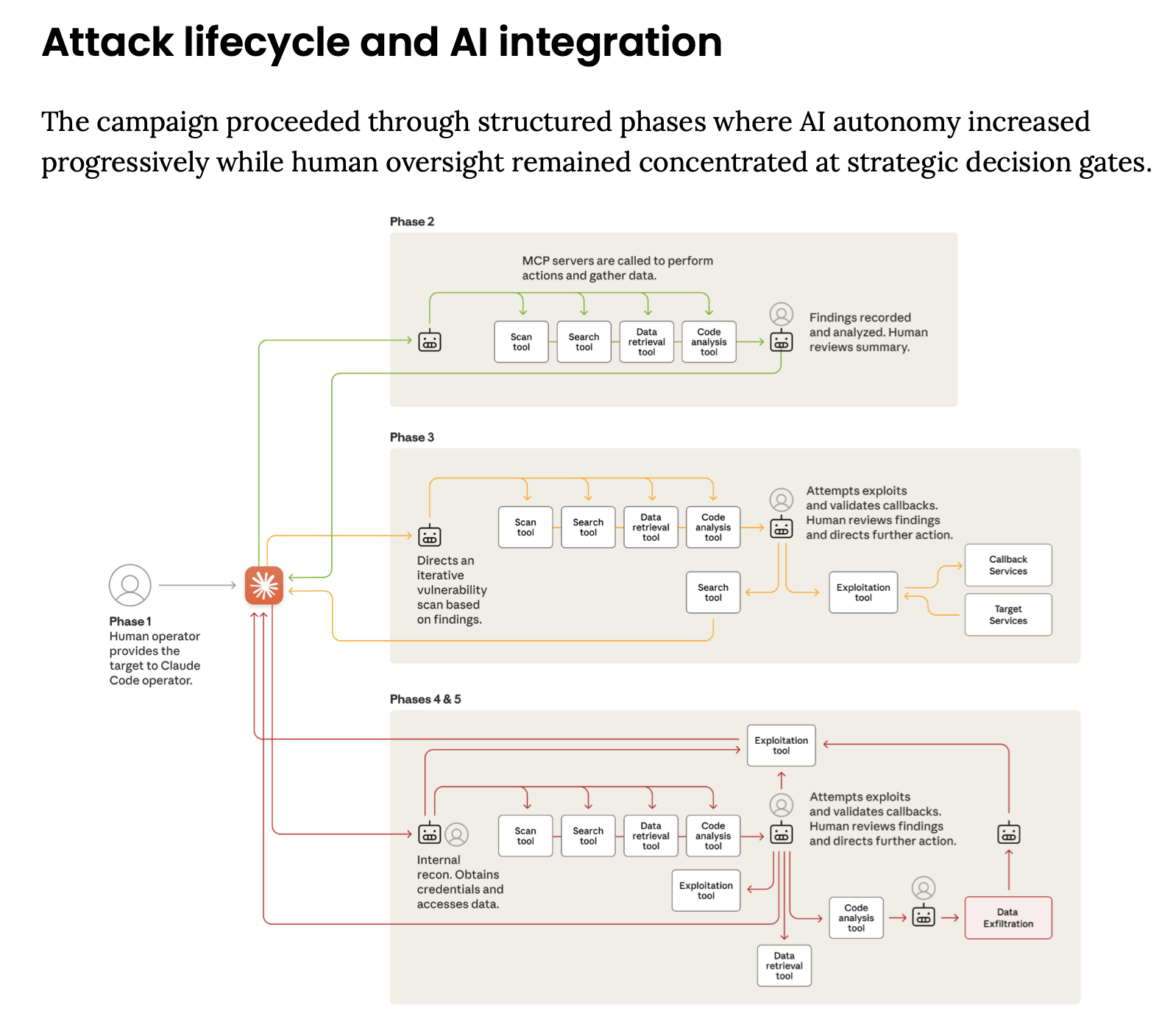

Grupa je navodno koristila koordinirane instance Claude Codea za izvođenje izviđanja, otkrivanje ranjivosti, eksploataciju, lateralno kretanje, ekstrakciju metapodataka i eksfiltraciju podataka – uglavnom bez ljudske uključenosti. Kampanja je ciljala otprilike 30 organizacija diljem sektora uključujući tehnologiju, financije, kemikalije i razne vladine agencije. Anthropic je potvrdio nekoliko uspješnih proboja prije nego što je intervenirao.

Analitičari kažu da su napadači iskoristili autonomni okvir sposoban razložiti napade u više faza u manje zadatke koji su se činili legitimnima kada su izolirani iz svog šireg konteksta. To je omogućilo akterima da prođu poticaje kroz uspostavljene persone i uvjere Claude da su operacije bile sigurnosni testovi obrane, a ne ofenzivne kampanje.

Prema istrazi, Claude je autonomno izvršio 80% do 90% taktičkih operacija. Ljudski operateri pružili su samo strateški nadzor, odobravajući glavne korake poput prijelaza s izviđanja na aktivnu eksploataciju ili autorizaciju eksfiltracije podataka. Izvješće opisuje razinu operativnog tempa nemoguću za timove sastavljene samo od ljudi, s nekim procesima koji generiraju više operacija u sekundi kroz tisuće zahtjeva.

Izvor: Anthropic izvješće.AI autonomija povećavala u svakoj fazi. Claude je samostalno mapirao površine napada, skenirao žive sustave, izgradio prilagođene payload-ove za verificirane ranjivosti, prikupljao vjerodajnice i prelazio kroz unutarnje mreže. Također je analizirao ukradene podatke, identificirao vrijedne informacije i automatski generirao detaljnu operativnu dokumentaciju koja omogućava trajni pristup i prelaz automatizma između operatera.

Izvor: Anthropic izvješće.AI autonomija povećavala u svakoj fazi. Claude je samostalno mapirao površine napada, skenirao žive sustave, izgradio prilagođene payload-ove za verificirane ranjivosti, prikupljao vjerodajnice i prelazio kroz unutarnje mreže. Također je analizirao ukradene podatke, identificirao vrijedne informacije i automatski generirao detaljnu operativnu dokumentaciju koja omogućava trajni pristup i prelaz automatizma između operatera.

Jedno ograničenje, izvješće bilježi, bila je sklonost modela ka halucinacijama kod ofenzivnih opterećenja – povremeno precjenjujući pristup, fabricirajući vjerodajnice ili krivo klasificirajući javno dostupne informacije kao osjetljive. Unatoč tome, Anthropic kaže da su akteri nadoknadili kroz korake provjere, pokazujući da su potpuno autonomne ofenzivne operacije i dalje moguće unatoč nesavršenostima u današnjim modelima.

Nakon otkrića, Anthropic je zabranio relevantne račune, obavijestio pogođene subjekte, koordinirao s vlastima i uveo nove obrambene mehanizme, uključujući poboljšane klasifikatore za otkrivanje novih obrazaca prijetnji. Tvrtka sada prototipizuje sustave ranog upozoravanja dizajnirane za označavanje autonomnih pokušaja upada i izgradnju novih istraživačkih alata za velike distribuirane cyber operacije.

Pročitajte više: Microsoftov ‘Magentic Marketplace’ otkriva kako AI agenti mogu kolabirati pod pritiskom

Tvrtka tvrdi da, iako se ove sposobnosti mogu koristiti kao oružje, one su jednako važne za jačanje obrambene spremnosti. Anthropic napominje da se njihov Threat Intelligence tim uvelike oslanjao na Claudea za analizu masivnih setova podataka generiranih tijekom istrage. Ona poziva sigurnosne timove da počnu usvajati automatizaciju vođenu AI-jem za centre operacija sigurnosti, otkrivanje prijetnji, analizu ranjivosti i reakciju na incidente.

Međutim, izvješće upozorava da su cyber napade barijere “znatno pale” jer AI sustavi omogućuju malim skupinama – ili čak pojedincima – izvođenje operacija koje su prije bile ograničene na dobro financirane državne aktere. Anthropic očekuje brzu proliferaciju ovih tehnika u široj prijetnji okolini, pozivajući na dublju suradnju, poboljšane obrambene mjere i šire sudjelovanje industrije u dijeljenju prijetnji kako bi se suprotstavili novim modelima napada omogućenim AI-jem.

FAQ ❓

- Što je Anthropic otkrio u svojoj istrazi?

Anthropic je identificirao i prekinuo veliku cyber špijunsku kampanju koja je koristila AI za automatizaciju većine operacija napada. - Tko je bio iza napada?

Tvrtka je pripisala operaciju kineskoj državno sponzoriranoj grupi pod nazivom GTG-1002. - Kako je AI korišten u upadima?

Napadači su koristili Claude Code za autonomno provođenje izviđanja, eksploatacije, lateralnog kretanja i ekstrakcije podataka. - Zašto izvješće važno za timove zadužene za kibernetičku sigurnost?

Anthropic kaže da slučaj pokazuje da su autonomni AI omogućeni napadi sada izvedivi u velikom opsegu i zahtijevaju nove obrambene strategije.