Anthropic का कहना है कि कृत्रिम बुद्धिमत्ता (AI) साइबर सुरक्षा में एक निर्णायक सीमा पर पहुंच गया है, नए सबूत दिखा रहे हैं कि AI मॉडल अब प्रमुख साइबर संचालन – दोनों रक्षात्मक और आक्रामक – बेमिसाल पैमाने पर कर सकते हैं।

एन्थ्रोपिक ने चेतावनी दी कि एआई क्षमताओं की तेजी के बीच साइबर अटैक बाधाएं गिर गई हैं।

एंथ्रोपिक ने नई जाँच में चेतावनी दी कि साइबर सुरक्षा में AI ने एक महत्वपूर्ण मोड़ पर पहुँचा है

एंथ्रोपिक, क्लॉड के पीछे AI फर्म, का कहना है कि उसकी आंतरिक मूल्यांकन और खतरा-खुफिया कार्य एक निर्णायक परिवर्तन दिखाते हैं। हाल ही में जारी की गई जांच के अनुसार, AI सिस्टमों के बीच साइबर क्षमताएं छह महीनों में दोगुनी हो गई हैं, वास्तविक विश्व गतिविधि और मॉडल-आधारित परीक्षण के मापों द्वारा समर्थित।

कंपनी का कहना है कि AI अब वैश्विक सुरक्षा गतिकी को सार्थक रूप से प्रभावित कर रहा है, विशेष रूप से क्योंकि दुर्भावनापूर्ण अभिनेता स्वचालित आक्रमण ढांचे को अपनाते जा रहे हैं। अपनी नवीनतम रिपोर्ट में, एंथ्रोपिक ने एक AI-प्रायोजित साइबर जासूसी अभियान के पहले दस्तावेजी मामले का विवरण दिया है। कंपनी की खतरा खुफिया टीम ने मध्य-सेप्ट 2025 में एक बड़े पैमाने के ऑपरेशन की पहचान की और उसे बाधित किया, जिसे एक चीनी राज्य द्वारा प्रायोजित समूह GTG-1002 के रूप में पहचाना गया।

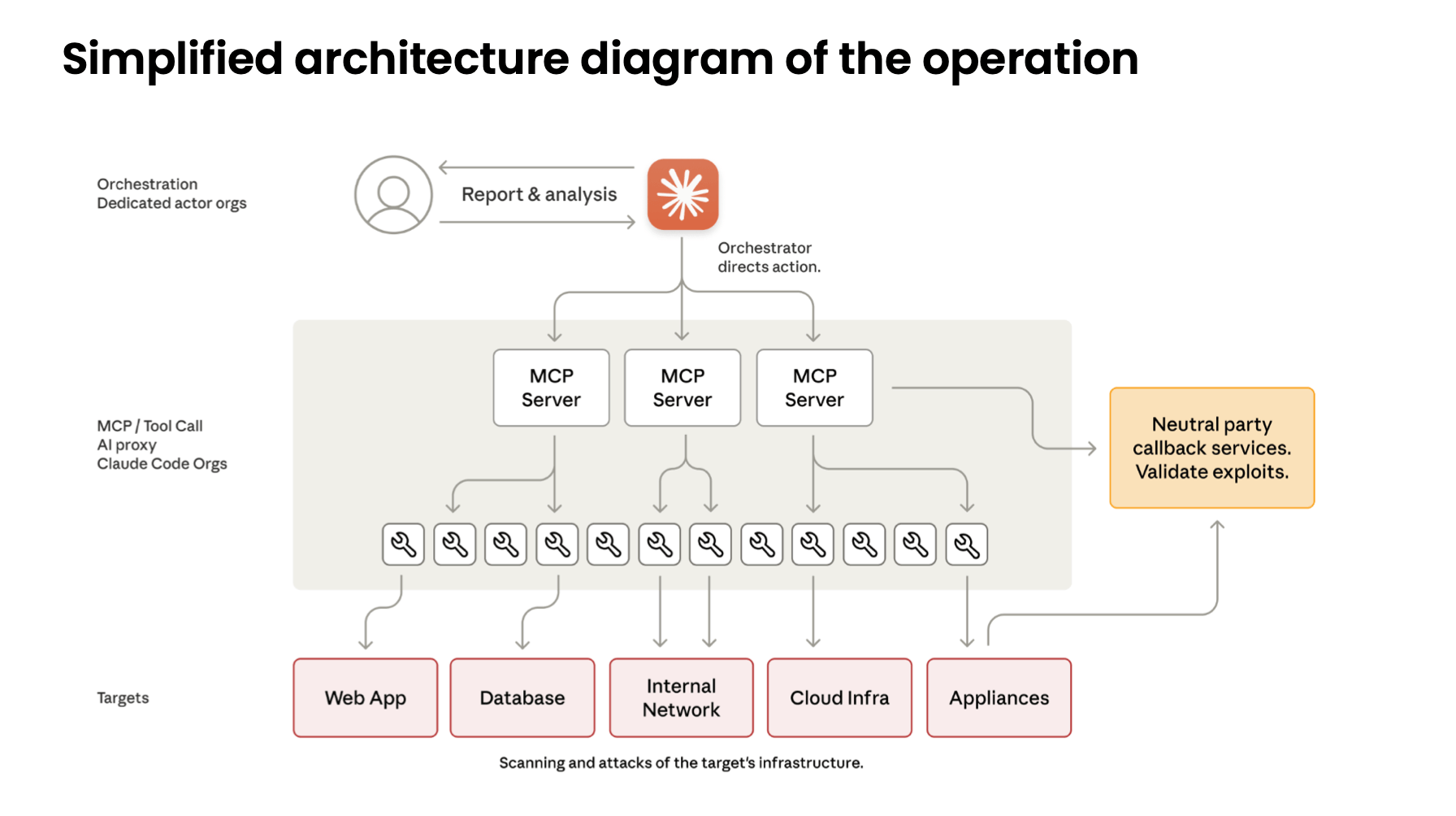

कहा जाता है कि समूह ने क्लॉड कोड के समन्वित उदाहरणों का उपयोग करते हुए अन्वेषण, संवेदनशीलता की खोज, पेशागत, पार्श्व गति, मेटाडेटा निष्कर्षण और डाटा निकालने का काम किया – अधिकांशतः बिना मानव हस्तक्षेप के। अभियान ने प्रौद्योगिकी, वित्त, रसायन और विभिन्न सरकारी एजेंसियों सहित लगभग 30 संगठनों को निशाना बनाया। एंथ्रोपिक ने हस्तक्षेप करने से पहले कई सफल अनधिकृत प्रवेश की पुष्टि की।

विश्लेषकों का कहना है कि हमलावरों ने एक स्वायत्त ढांचे का लाभ उठाया जो बहु-स्तरीय आक्रमणों को छोटे कार्यों में तोड़ता था जो उनके व्यापक संदर्भ से अलग जब देखे जाते थे तो वैध दिखाई देते थे। इसने अभिनेताओं को स्थापित व्यक्तियों के माध्यम से संकेत देने और क्लॉड को यह विश्वास दिलाने की अनुमति दी कि संचालन रक्षात्मक सुरक्षा परीक्षण थे न कि आक्रामक अभियान।

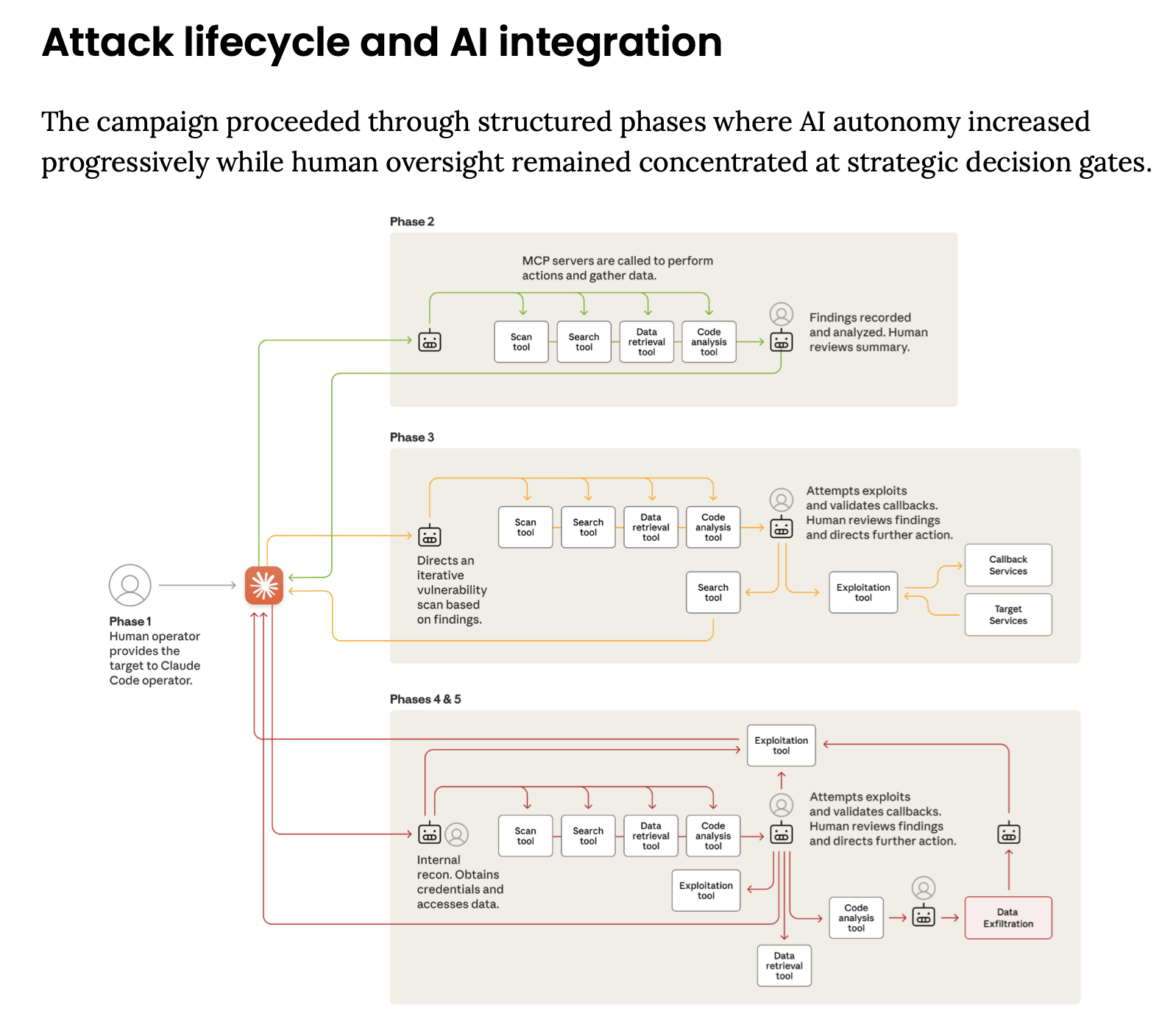

जाँच के अनुसार, क्लॉड ने 80% से 90% तक के सामरिक संचालन को स्वायत्त रूप से निष्पादित किया। मानव संचालकों ने केवल सामरिक निरीक्षण प्रदान किया, अन्वेषण से सक्रिय पेशागत तक बढ़ने जैसे मुख्य कदमों को अनुमोदित किया या डाटा निष्कर्षण को अधिकृत किया। रिपोर्ट एक परिचालन गति का वर्णन करती है जो केवल-मानव टीमों के लिए असंभव है, जिसमें कुछ कार्यप्रवाह हजारों अनुरोधों में प्रति सेकंड कई संचालन उत्पन्न कर रहे हैं।

एंथ्रोपिक का कहना है कि हमले का जीवनचक्र एक संरचित पाइपलाइन के माध्यम से उन्नत हुआ जहां AI स्वायत्तता हर चरण में बढ़ी। क्लॉड ने स्वतंत्र रूप से आक्रमण सतहों को मैप किया, लाइव सिस्टमों को स्कैन किया, सत्यापित कमजोरियों के लिए कस्टम पेलोड बनाए, प्रमाणपत्र एकत्रित किए, और आंतरिक नेटवर्कों के माध्यम से पिवट किया। इसने चोरी किए गए डाटा का विश्लेषण किया, उच्च-मूल्य की खुफिया पहचानी, और ऑपरेटरों के बीच निरंतर पहुंच और हस्तांतरण सक्षम करने वाली विस्तृत ऑपरेशनल डॉक्यूमेंटेशन को स्वचालित रूप से उत्पन्न किया।

रिपोर्ट एक बाधा के रूप में मानती है, मॉडल की आक्रामक कार्यभारों के तहत भ्रम का रुझान – कभी-कभी पहुँच को अधिक बताना, प्रमाणपत्रों को गढ़ना, या सार्वजनिक रूप से उपलब्ध जानकारी को संवेदनशील के रूप में गलत श्रेणीबद्ध करना। फिर भी, एंथ्रोपिक का कहना है कि अभिनेता ने सत्यापन कदमों के माध्यम से क्षतिपूर्ति की, यह प्रदर्शित करते हुए कि आज के मॉडल के बावजूद पूरी तरह से स्वायत्त आक्रामक संचालन संभव हैं।

अपनी खोज के बाद, एंथ्रोपिक ने संबंधित खातों पर प्रतिबंध लगाया, प्रभावित संस्थाओं को सूचित किया, अधिकारियों के साथ समन्वय किया, और नए रक्षात्मक तंत्र पेश किए, जिसमें नए खतरा पैटर्न का पता लगाने के लिए बेहतर वर्गीकरण शामिल हैं। कंपनी अब स्वायत्त अनधिकृत प्रवेश प्रयासों को चिह्नित करने के लिए प्रारंभिक चेतावनी प्रणालियों का प्रोटोटाइप बना रही है और बड़े पैमाने पर वितरित साइबर संचालन के लिए नए शोध उपकरण बना रही है।

अधिक पढ़ें: माइक्रोसॉफ्ट के ‘मजेंटिक मार्केटप्लेस’ ने बताया कि AI एजेंट कैसे दबाव में गिर सकते हैं

कंपनी का तर्क है कि जब ये क्षमताएं हथियार में तब्दील की जा सकती हैं, वे सामरिक तैयारियों को मजबूत करने के लिए भी महत्वपूर्ण हैं। एंथ्रोपिक ने नोट किया कि उसकी खुद की खतरा खुफिया टीम ने जांच के दौरान उत्पन्न डेटा सेटों का विश्लेषण करने के लिए क्लॉड पर बहुत निर्भर किया। यह सुरक्षा टीमों से AI संचालित स्वचालन को अपनाने का आग्रह करता है, सुरक्षा संचालन केंद्र, खतरा पहचान, संवेदनशीलता विश्लेषण, और घटना प्रतिक्रिया के लिए।

हालांकि, रिपोर्ट चेतावनी देती है कि साइबर आक्रमण बाधाएं “काफी हद तक कम” हो गई हैं क्योंकि AI सिस्टम छोटे समूहों – या यहां तक कि व्यक्तियों – को उन संचालन करने देते हैं जो एक समय में केवल अच्छी वित्तपोषित राज्य अभिनेताओं तक सीमित थे। एंथ्रोपिक को उम्मीद है कि ये तकनीकें व्यापक खतरे के माहौल में तेजी से फैलेंगी, गहरी सहयोग, सुधारी गई रक्षात्मक उपायों, और AI संचालित आक्रमण मॉडलों का मुकाबला करने के लिए व्यापक उद्योग भागीदारी की आवश्यकता को उजागर करते हुए।

FAQ ❓

- एंथ्रोपिक ने अपनी जांच में क्या खोजा?

एंथ्रोपिक ने एक बड़े पैमाने के साइबर जासूसी अभियान की पहचान की और उसे बाधित किया जो AI का उपयोग करके अधिकांश आक्रमण संचालन को स्वचालित करता था। - हमले के पीछे कौन था?

कंपनी ने इस ऑपरेशन को चीनी राज्य प्रायोजित समूह GTG-1002 को सौंपा। - भेदभानों में AI का उपयोग कैसे किया गया?

हमलावर क्लॉड कोड का उपयोग करके स्वतः ही अन्वेषण, पेशागत, पार्श्व गति, और डाटा निष्कर्षण का काम करते थे। - रिपोर्ट साइबर सुरक्षा टीमों के लिए क्यों महत्वपूर्ण है?

एंथ्रोपिक का कहना है कि मामला दिखाता है कि स्वायत्त AI सक्षम आक्रमण अब बड़े पैमाने पर संभव हैं और नई रक्षात्मक रणनीतियों की आवश्यक बनाते हैं।