אנתרופיק נקטה בצעד חריג במיוחד ותבעה את ממשלת ארה״ב לאחר שהפנטגון תייג את חברת הבינה המלאכותית (AI) כ״סיכון שרשרת אספקה לביטחון הלאומי״, מה שהצית עימות משפטי שעשוי לעצב מחדש את האופן שבו וושינגטון מפקחת על ספקי בינה מלאכותית העובדים עם הצבא.

אנתרופיק של דריו אמודיי תובעת את ממשלת ארה״ב, וטוענת כי הפנטגון נקם בעקבות מגבלות הבטיחות בתחום הבינה המלאכותית

אנתרופיק מתעמתת עם משרד ההגנה בתביעה תקדימית בתחום הבינה המלאכותית

לפי כמה דיווחים, אנתרופיק הגישה שתי תביעות ב-9 במרץ בבית משפט פדרלי, המאתגרות צעדים שננקטו על ידי משרד ההגנה של ארה״ב וממשל טראמפ, וטוענת שהממשלה נקמה בחברה שלא כדין לאחר שסירבה להסיר מנגנוני הגנה ממערכת הבינה המלאכותית Claude שלה. התביעות מכוונות נגד סיווג שבדרך כלל חל על יריבים זרים החשודים בריגול או בחבלה, ולא על חברות טכנולוגיה מקומיות.

המחלוקת נעוצה במשא ומתן חוזי בין אנתרופיק לפנטגון לגבי האופן שבו ניתן יהיה להשתמש במודל ה-AI Claude של החברה על ידי סוכנויות ההגנה של ארה״ב. אנתרופיק תמכה בעבר ביוזמות ביטחון לאומי והפכה לחברת AI מתקדמת (frontier) הראשונה שהטמיעה מודלים ברשתות ממשלת ארה״ב המסווגות ביוני 2024, וסייעה לאנליסטים ולמתכננים צבאיים בבדיקת מודיעין, סימולציות, תכנון מבצעי ועבודת סייבר.

המתיחות החריפה כאשר משרד ההגנה דרש גישה בלתי מוגבלת ל-Claude עבור „כל מטרה חוקית” במסגרת חידוש חוזה. אנתרופיק הסכימה לרוב התנאים אך התעקשה על שתי מגבלות: איסור שימוש ב-AI שלה לצורכי מעקב המוני פנימי אחר אזרחים אמריקאים, ומניעת פריסה במערכות נשק קטלניות אוטונומיות לחלוטין.

מנהלי החברה טענו כי מנגנוני ההגנה הללו נחוצים משום שמודלי AI מתקדמים כיום עדיין אינם אמינים דיים עבור נשק אוטונומי, ומשום שתוכניות מעקב רחבות היקף עלולות להתנגש עם הגנות חוקתיות. אנתרופיק מסרה כי המגבלות מעולם לא הפריעו לשום משימה צבאית במהלך עבודתה הקודמת עם הממשלה.

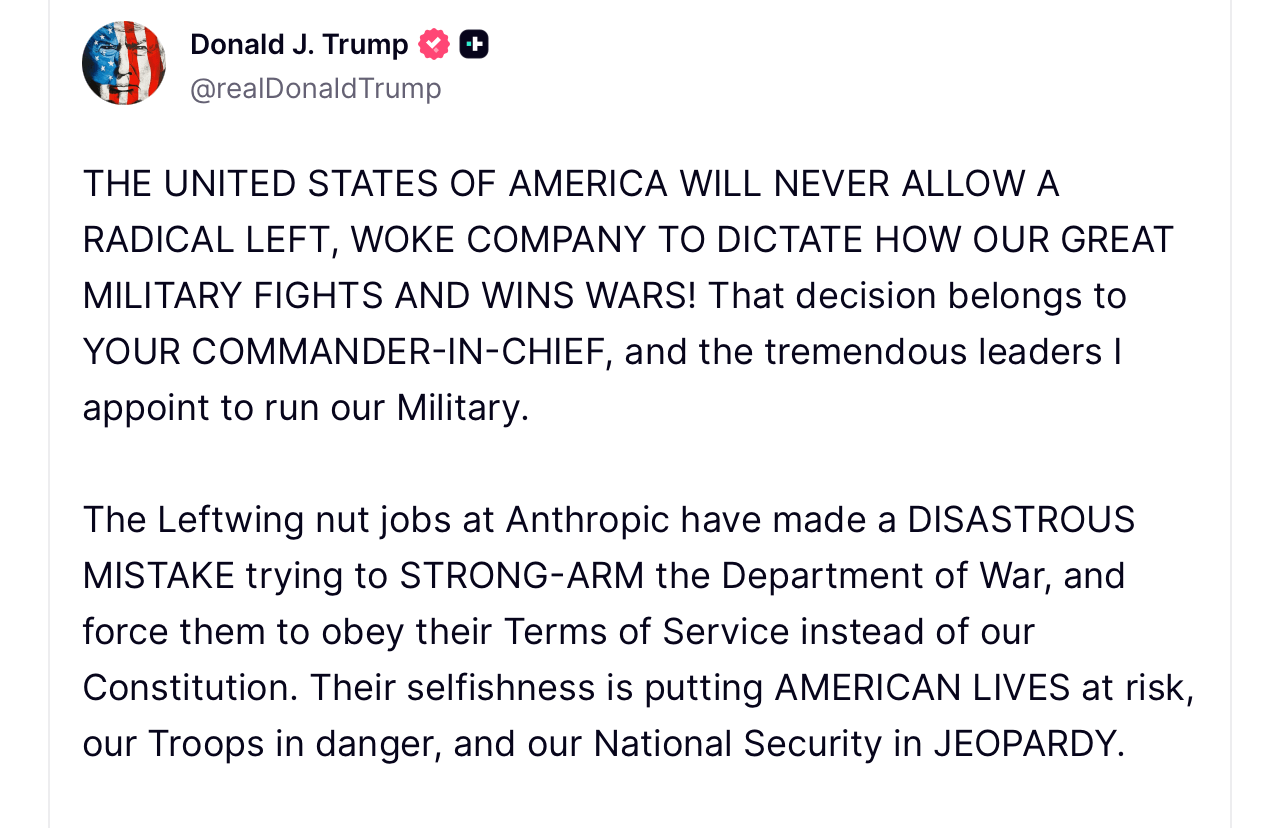

המשא ומתן קרס לאחר פגישה ב-24 בפברואר בין מנכ״ל אנתרופיק דריו אמודיי לבין שר ההגנה פיט הגסת׳. ימים לאחר מכן, ב-27 בפברואר, הנשיא דונלד טראמפ פרסם ב-Truth Social והורה לסוכנויות פדרליות „להפסיק מיד” להשתמש בטכנולוגיית אנתרופיק, ותיאר המשך הסתמכות על החברה כ„טעות הרסנית”.

זמן קצר לאחר מכן, הגסת׳ פעל לסווג את אנתרופיק כסיכון שרשרת אספקה מכוח סמכות רכש פדרלית המעוגנת בסעיף 10 U.S.C. § 3252. הסיווג, שאושר במכתב שנשלח לחברה סביב 4 במרץ, מגביל קבלנים ממשלתיים מסוימים מלהשתמש בטכנולוגיה שנחשבת פגיעה לחבלה או להשפעה זרה.

אנתרופיק טוענת כי המהלך מותח את החוק הרבה מעבר לתכליתו המקורית. במסמכי בית המשפט טוענת החברה כי הסיווג נועד לאיומים ביטחוניים הקשורים לגורמים זרים, ולא למחלוקות מדיניות עם ספקים מקומיים. התביעות טוענות שהממשלה לא השתמשה ב„האמצעי הפחות מגביל” הנדרש על פי חוק, ובמקום זאת הטילה מה שהחברה מתארת כרשימה שחורה בלתי רשמית.

המסמכים המשפטיים מעלים גם חששות חוקתיים. אנתרופיק טוענת שהסיווג מפר את התיקון הראשון לחוקה בכך שהוא מעניש את החברה על כך שבפומבי קידמה מגבלות על שימושי AI כגון נשק אוטונומי ומעקב פנימי. לפי כתב התביעה, תיוג החברה כסיכון לביטחון הלאומי פוגע במוניטין שלה ועלול לסכן חוזים בהיקף של מאות מיליוני דולרים.

אנתרופיק מבקשת מבתי המשפט לחסום את אכיפת הסיווג, להורות לסוכנויות פדרליות לבטל הנחיות המפסיקות עסקים עם החברה, ולמנוע צעדים דומים בעתיד. החברה מסרה שמטרתה אינה לכפות על הממשלה לרכוש את הטכנולוגיה שלה, אלא למנוע נקמה בשל חילוקי דעות מדיניים.

„בקשת ביקורת שיפוטית אינה משנה את מחויבותנו ארוכת השנים לרתום את הבינה המלאכותית כדי להגן על ביטחון המדינה שלנו,” אמר דובר אנתרופיק בהצהרה. „אבל זהו צעד הכרחי כדי להגן על העסק שלנו, על הלקוחות שלנו ועל השותפים שלנו.”

גורמים בפנטגון לא הגיבו בפומבי על ההליך המשפטי, תוך שהם מציינים מדיניות הנוגעת לתיקים פעילים בבתי המשפט. כמה ממנהיגי מערכת הביטחון טענו בעבר שסוכנויות צבאיות חייבות לשמור על סמכות מבצעית מלאה ביחס לטכנולוגיות של קבלנים בזמן חירום, ואינן יכולות לאפשר לספקים להכתיב כיצד נעשה שימוש במערכות.

סוף השבוע הפרוע של הבינה המלאכותית: טלטלה ב-OpenAI, עימות עם הפנטגון, ורובוטים שמסרבים למות

טלטלות ה-AI מתרחשות מהר: דרמת OpenAI, עימות של הפנטגון עם Anthropic, השקת GPT-5.4, רובוטים שמתקנים את עצמם וכלי אבטחה חדשים. read more.

קרא עכשיו

סוף השבוע הפרוע של הבינה המלאכותית: טלטלה ב-OpenAI, עימות עם הפנטגון, ורובוטים שמסרבים למות

טלטלות ה-AI מתרחשות מהר: דרמת OpenAI, עימות של הפנטגון עם Anthropic, השקת GPT-5.4, רובוטים שמתקנים את עצמם וכלי אבטחה חדשים. read more.

קרא עכשיו

סוף השבוע הפרוע של הבינה המלאכותית: טלטלה ב-OpenAI, עימות עם הפנטגון, ורובוטים שמסרבים למות

קרא עכשיוטלטלות ה-AI מתרחשות מהר: דרמת OpenAI, עימות של הפנטגון עם Anthropic, השקת GPT-5.4, רובוטים שמתקנים את עצמם וכלי אבטחה חדשים. read more.

המחלוקת מגיעה בזמן שהמרוץ להשגת חוזי AI צבאיים מתעצם. חברות מתחרות, כולל OpenAI, הגיעו להסכמים עם הפנטגון בערך באותו זמן שבו המשא ומתן עם אנתרופיק התפרק. בינתיים, שותפות טכנולוגיה גדולות כמו גוגל ומיקרוסופט ציינו שהן מתכוונות להמשיך לעבוד עם אנתרופיק על שירותים מסחריים שאינם קשורים לביטחון.

אנליסטים בתעשייה אומרים שתוצאת התיק עשויה לקבוע תקדים לאופן שבו הממשלה הפדרלית מפעילה לחץ על חברות AI לשנות מדיניות בטיחות כאשר מעורבים אינטרסים של ביטחון לאומי. לעת עתה, מוצרי הצרכן של אנתרופיק ושירותי ה-AI המסחריים שלה נותרים זמינים, בעוד הקרב המשפטי סביב סיווג הפנטגון מתחיל לפלס את דרכו בבתי המשפט.

שאלות נפוצות 🧭

- מדוע אנתרופיק תבעה את ממשלת ארה״ב?

אנתרופיק הגישה תביעות בטענה שהפנטגון תייג את החברה שלא כדין כסיכון שרשרת אספקה לביטחון הלאומי לאחר שסירבה להסיר מגבלות בטיחות של AI. - מה הצית את המחלוקת בין אנתרופיק לפנטגון?

הסכסוך החל במהלך משא ומתן חוזי כאשר משרד ההגנה דרש שימוש בלתי מוגבל במערכת ה-AI Claude של אנתרופיק. - מה המשמעות של סיווג „סיכון שרשרת אספקה”?

התווית יכולה להגביל קבלנים ממשלתיים מלהשתמש בטכנולוגיה של חברה אם גורמים רשמיים סבורים שהיא מציבה סיכוני אבטחה או רכש. - האם שירותי ה-AI של אנתרופיק ימשיכו לפעול במהלך התביעה?

כן, מוצרי ה-AI המסחריים של אנתרופיק ושירותי הצרכן שלה נשארים זמינים בזמן שההליך המשפטי מתקדם.