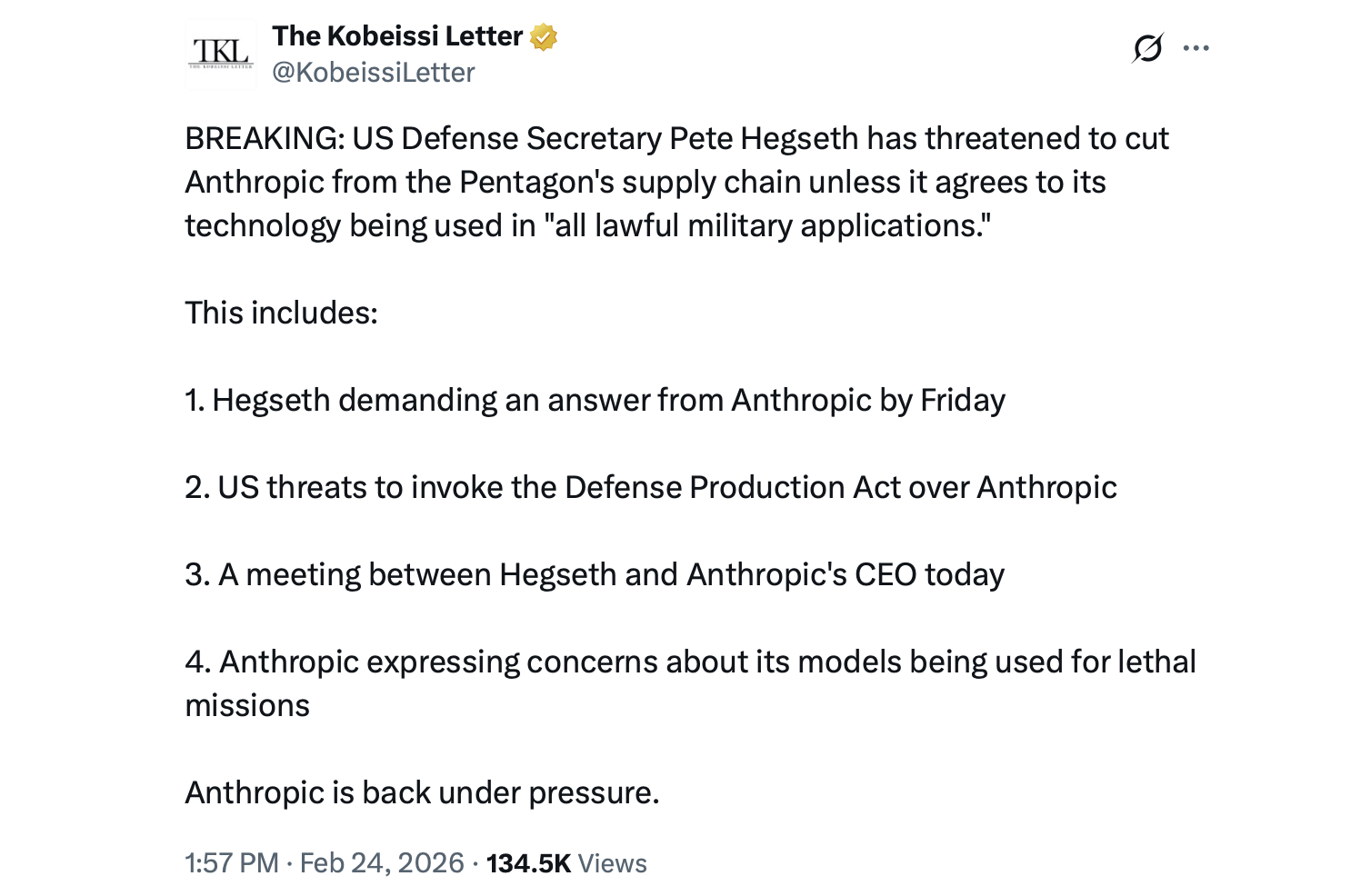

Le secrétaire à la Défense Pete Hegseth a rencontré mardi le PDG d'Anthropic, Dario Amodei, au Pentagone, alors que le ministère de la Défense faisait pression sur Anthropic pour qu'il lève les restrictions imposées à son système d'intelligence artificielle (IA) Claude, sous peine de sanctions éventuelles.

Rapport : L'avenir incertain de l'IA Claude d'Anthropic dans les systèmes classifiés du Pentagone

La gouvernance de l'IA militaire mise à l'épreuve lors d'une réunion à haut risque au Pentagone

La réunion du 24 février a fait suite à plusieurs semaines de tensions concernant les politiques d'utilisation de Claude par Anthropic, le grand modèle linguistique intégré aux réseaux classifiés du département de la Défense dans le cadre d'un contrat pilote de 2025 d'une valeur pouvant atteindre 200 millions de dollars. Claude est actuellement le seul grand modèle linguistique entièrement autorisé à fonctionner sur certains systèmes sécurisés du Pentagone.

Selon le rapport d'Axios, M. Hegseth, accompagné du secrétaire adjoint Steve Feinberg et du conseiller juridique Earl Matthews, s'est opposé aux restrictions imposées par Anthropic sur la surveillance de masse des Américains et sur les systèmes d'armes entièrement autonomes fonctionnant sans contrôle humain. Les responsables de la défense ont fait valoir que ces limites restreignent les applications militaires légales et ne devraient pas prévaloir sur l'autorité du Congrès et de l'exécutif.

Anthropic a maintenu que ses mesures de protection sont conçues pour empêcher toute utilisation abusive tout en permettant des applications liées à la sécurité nationale. La société affirme que ses politiques n'empêchent pas l'utilisation militaire légitime, mais interdisent des activités telles que le suivi d'individus sans leur consentement ou le déploiement de systèmes létaux sans contrôle humain.

« Selon une source proche des discussions, Anthropic ne s'est jamais opposée à l'utilisation de ses modèles pour des "opérations militaires légitimes" », a rapporté Jennifer Griffin, correspondante en chef de Fox News pour la sécurité nationale, sur X. « Elle a également déclaré à M. Hegseth qu'elle ne s'était jamais plainte au Pentagone ou à Palantir de l'utilisation de ses modèles lors du raid contre Maduro. »

Claude a été utilisé pour l'analyse du renseignement, la cyberdéfense et la planification opérationnelle. Selon certaines informations, il aurait soutenu la planification et l'analyse en temps réel lors de l'opération du 3 janvier qui a abouti à la capture du président vénézuélien Nicolás Maduro. Anthropic a ensuite demandé des éclaircissements sur l'implication du modèle dans le cadre d'un examen interne de conformité, ce que les responsables du Pentagone ont interprété comme une critique.

Le 9 janvier, M. Hegseth a publié une note de service exhortant les fournisseurs d'intelligence artificielle (IA) à supprimer ce qu'il a qualifié de conditions restrictives. Cette directive a ouvert la voie à de nouvelles négociations et, finalement, à la réunion du 24 février.

Le Pentagone a fixé au 27 février la date limite à laquelle Anthropic doit modifier ses conditions. Parmi les réponses possibles, on peut citer le recours à la loi sur la production de défense pour imposer la conformité ou la désignation d'Anthropic comme un risque pour la chaîne d'approvisionnement, une mesure qui pourrait obliger les sous-traitants à se désengager des systèmes liés à Claude.

Les responsables reconnaissent que le retrait de Claude de l'infrastructure existante serait complexe sur le plan opérationnel. Néanmoins, le département dispose d'alternatives. Des concurrents tels que xAI avec son modèle Grok, OpenAI avec ChatGPT et Google avec Gemini ont conclu des contrats similaires avec le département de la Défense et pourraient être en mesure d'étendre leur rôle si les négociations échouent. Ce différend soulève des questions plus larges concernant la gouvernance de l'IA dans le domaine militaire, d'autant plus que la législation fédérale continue d'évoluer autour des technologies émergentes. L'enjeu est de savoir si les développeurs privés d'IA peuvent maintenir des politiques éthiques indépendantes lorsque leurs systèmes sont intégrés dans des opérations de sécurité nationale.

Les réactions sur les réseaux sociaux ont été particulièrement franches. « La surveillance sans mandat est de retour », a écrit un utilisateur de X en réponse au message de Griffin. « Cela devrait faire beaucoup plus de bruit que ce n'est le cas. Il y a un risque sérieux de violation de la Constitution », a répondu un autre utilisateur à l'article de Griffin. D'autres, avec une dose d'humour noir, ont plaisanté en disant que l'arrivée de Skynet n'était peut-être pas loin. « Skynet est là… la chronologie de 2029 est EN COURS », a remarqué cette personne. Les deux parties ont qualifié la discussion du 24 février de substantielle. Le fait qu'Anthropic ajuste ou non ses mesures de protection avant la date limite pourrait déterminer l'avenir de l'une des intégrations d'IA les plus avancées du Pentagone.

FAQ 🤖

- Qu'est-ce qui a été discuté lors de la réunion du Pentagone du 24 février ? La réunion a porté sur les restrictions imposées par Anthropic à l'IA Claude et sur la question de savoir si elles limitent les applications militaires légales.

- Pourquoi le Pentagone fait-il pression sur Anthropic ? Les responsables de la défense affirment que les mesures de sécurité de l'entreprise interfèrent avec les utilisations autorisées en matière de sécurité nationale.

- Que pourrait-il se passer si Anthropic ne se conforme pas ? Le Pentagone pourrait invoquer la loi sur la production de défense ou désigner l'entreprise comme un risque pour la chaîne d'approvisionnement.

- Existe-t-il des alternatives à Claude ? Oui, les modèles de xAI, OpenAI et Google font l'objet de contrats avec le ministère de la Défense et pourraient être développés si nécessaire.