Anthropic a pris la décision extraordinaire de poursuivre le gouvernement américain en justice après que le Pentagone ait qualifié l'entreprise d'intelligence artificielle (IA) de « risque pour la sécurité nationale au niveau de la chaîne d'approvisionnement », déclenchant ainsi un conflit juridique qui pourrait redéfinir la manière dont Washington contrôle les fournisseurs d'intelligence artificielle travaillant avec l'armée.

Anthropic, la société de Dario Amodei, poursuit le gouvernement américain en justice, affirmant que le Pentagone a exercé des représailles à propos des mesures de sécurité relatives à l'IA.

Anthropic s'attaque au ministère de la Défense dans un procès historique sur l'IA

Selon plusieurs rapports, Anthropic a déposé deux plaintes le 9 mars devant un tribunal fédéral pour contester les mesures prises par le département américain de la Défense et l'administration Trump, arguant que le gouvernement avait illégalement exercé des représailles contre l'entreprise après qu'elle ait refusé de supprimer les mesures de sécurité de son système d'intelligence artificielle Claude. Les poursuites visent une désignation qui s'applique généralement aux adversaires étrangers soupçonnés d'espionnage ou de sabotage, et non aux entreprises technologiques nationales.

Le litige remonte aux négociations contractuelles entre Anthropic et le Pentagone sur la manière dont le modèle d'IA Claude de l'entreprise pourrait être utilisé par les agences de défense américaines. Anthropic avait précédemment soutenu des initiatives de sécurité nationale et était devenue la première entreprise d'IA de pointe à déployer des modèles sur les réseaux classifiés du gouvernement américain en juin 2024, aidant les analystes et les planificateurs militaires dans l'examen des renseignements, les simulations, la planification opérationnelle et le travail de cybersécurité.

Les tensions se sont intensifiées lorsque le ministère de la Défense a exigé un accès illimité à Claude à « toutes fins légales » dans le cadre du renouvellement du contrat. Anthropic a accepté la plupart des conditions, mais a insisté sur deux restrictions : l'interdiction d'utiliser son IA pour la surveillance massive des Américains et l'interdiction de la déployer dans des systèmes d'armes létales entièrement autonomes.

Les dirigeants de l'entreprise ont fait valoir que ces garde-fous étaient nécessaires car les modèles d'IA actuels restent trop peu fiables pour les armes autonomes et parce que les programmes de surveillance à grande échelle pourraient entrer en conflit avec les protections constitutionnelles. Anthropic a déclaré que ces restrictions n'avaient jamais interféré avec aucune mission militaire lors de ses précédentes collaborations avec le gouvernement.

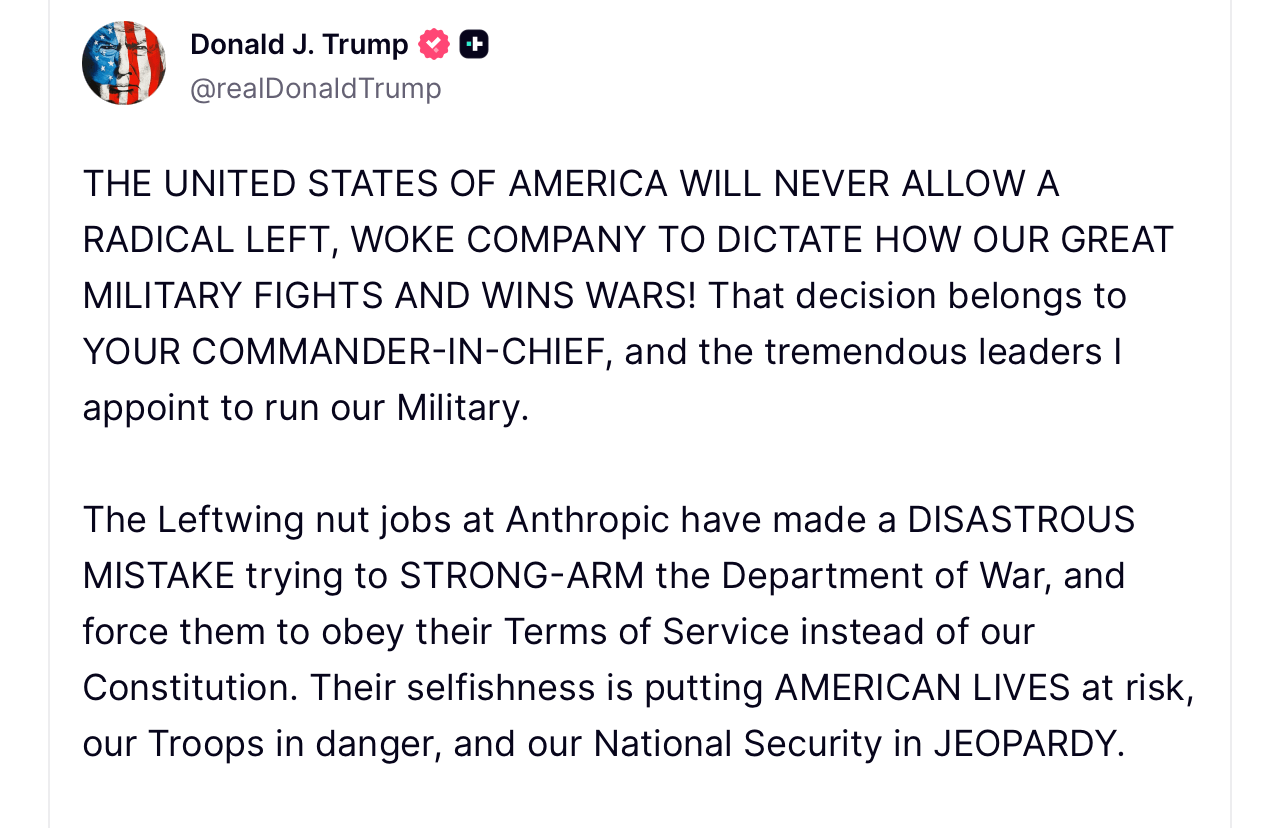

Les négociations ont échoué à la suite d'une réunion le 24 février entre le PDG d'Anthropic, Dario Amodei, et le secrétaire à la Défense, Pete Hegseth. Quelques jours plus tard, le 27 février, le président Donald Trump a publié un message sur Truth Social, ordonnant aux agences fédérales de « cesser immédiatement » d'utiliser la technologie d'Anthropic, qualifiant le fait de continuer à s'appuyer sur cette entreprise d'« erreur désastreuse ».

Peu après, M. Hegseth a décidé de classer Anthropic comme un risque pour la chaîne d'approvisionnement en vertu de l'autorité fédérale en matière de marchés publics définie dans 10 U.S.C. § 3252. Cette désignation, confirmée dans une lettre envoyée à l'entreprise vers le 4 mars, empêche certains prestataires du gouvernement d'utiliser des technologies considérées comme vulnérables au sabotage ou à l'influence étrangère.

Anthropic soutient que cette mesure étend la portée de la loi bien au-delà de son objectif initial. Dans ses conclusions déposées devant le tribunal, l'entreprise affirme que cette désignation était destinée à lutter contre les menaces pour la sécurité liées à l'étranger plutôt qu'à régler des désaccords politiques avec des fournisseurs nationaux. Les poursuites judiciaires allèguent que le gouvernement n'a pas utilisé les « moyens les moins restrictifs » requis par la loi et a plutôt imposé ce que l'entreprise décrit comme une liste noire non officielle.

Les documents juridiques soulèvent également des questions constitutionnelles. Anthropic soutient que cette désignation viole le premier amendement en punissant l'entreprise pour avoir publiquement préconisé des limites à l'utilisation de l'IA, notamment dans le domaine des armes autonomes et de la surveillance intérieure. Selon la plainte, le fait de qualifier l'entreprise de risque pour la sécurité nationale nuit à sa réputation et pourrait compromettre des contrats représentant des centaines de millions de dollars.

Anthropic demande aux tribunaux de bloquer l'application de cette désignation, d'ordonner aux agences fédérales de retirer les directives suspendant leurs relations commerciales avec l'entreprise et d'empêcher des actions similaires à l'avenir. L'entreprise a déclaré que son objectif n'était pas de forcer le gouvernement à acheter sa technologie, mais d'empêcher des représailles liées à des divergences politiques. « Le fait de demander un contrôle judiciaire ne change en rien notre engagement de longue date à exploiter l'IA pour protéger notre sécurité nationale », a déclaré un porte-parole d'Anthropic dans un communiqué. « Mais il s'agit d'une mesure nécessaire pour protéger notre entreprise, nos clients et nos partenaires. » Les responsables du Pentagone n'ont pas commenté publiquement le litige, invoquant la politique relative aux affaires judiciaires en cours. Certains responsables de la défense ont précédemment fait valoir que les agences militaires doivent conserver leur pleine autorité opérationnelle sur les technologies des sous-traitants en cas d'urgence et ne peuvent pas permettre aux fournisseurs de dicter la manière dont les systèmes sont utilisés.

Week-end mouvementé pour l'IA : bouleversements chez OpenAI, conflit avec le Pentagone et robots qui refusent de mourir

Les bouleversements dans le domaine de l'IA se succèdent à un rythme effréné : le drame OpenAI, le conflit entre le Pentagone et Anthropic, le lancement de GPT-5.4, les robots auto-réparateurs et les nouveaux outils de sécurité. read more.

Lire

Week-end mouvementé pour l'IA : bouleversements chez OpenAI, conflit avec le Pentagone et robots qui refusent de mourir

Les bouleversements dans le domaine de l'IA se succèdent à un rythme effréné : le drame OpenAI, le conflit entre le Pentagone et Anthropic, le lancement de GPT-5.4, les robots auto-réparateurs et les nouveaux outils de sécurité. read more.

Lire

Week-end mouvementé pour l'IA : bouleversements chez OpenAI, conflit avec le Pentagone et robots qui refusent de mourir

LireLes bouleversements dans le domaine de l'IA se succèdent à un rythme effréné : le drame OpenAI, le conflit entre le Pentagone et Anthropic, le lancement de GPT-5.4, les robots auto-réparateurs et les nouveaux outils de sécurité. read more.

Ce litige survient alors que la course pour obtenir des contrats militaires dans le domaine de l'IA s'intensifie. Des entreprises concurrentes, dont OpenAI, ont conclu des accords avec le Pentagone à peu près au moment où les négociations avec Anthropic ont échoué. Parallèlement, de grands partenaires technologiques tels que Google et Microsoft ont indiqué leur intention de continuer à travailler avec Anthropic sur des services commerciaux sans rapport avec la défense.

Selon les analystes du secteur, l'issue de cette affaire pourrait créer un précédent quant à la manière dont le gouvernement fédéral peut faire pression sur les entreprises d'IA pour qu'elles modifient leurs politiques de sécurité lorsque les intérêts de la sécurité nationale sont en jeu. Pour l'instant, les produits grand public et les services commerciaux d'IA d'Anthropic restent disponibles, tandis que la bataille juridique concernant la désignation du Pentagone commence à suivre son cours devant les tribunaux.

FAQ 🧭

- Pourquoi Anthropic a-t-il poursuivi le gouvernement américain ? Anthropic a intenté des poursuites judiciaires, affirmant que le Pentagone avait illégalement qualifié l'entreprise de risque pour la chaîne d'approvisionnement de la sécurité nationale après qu'elle ait refusé de lever les restrictions en matière de sécurité de l'IA.

- Qu'est-ce qui a déclenché le conflit entre Anthropic et le Pentagone ? Le conflit a débuté lors des négociations contractuelles, lorsque le ministère de la Défense a exigé l'utilisation sans restriction du système d'IA Claude d'Anthropic.

- Que signifie la désignation « risque pour la chaîne d'approvisionnement » ? Cette étiquette peut empêcher les prestataires du gouvernement d'utiliser la technologie d'une entreprise si les responsables estiment qu'elle présente des risques pour la sécurité ou l'approvisionnement.

- Les services d'IA d'Anthropic continueront-ils à fonctionner pendant le procès ? Oui, les produits commerciaux d'IA et les services aux consommateurs d'Anthropic restent disponibles pendant la durée du procès.