Anthropic déclare que l’intelligence artificielle (IA) a atteint un seuil crucial en cybersécurité, avec de nouvelles preuves montrant que les modèles d’IA sont désormais capables de mener des opérations cybernétiques majeures—à la fois défensives et offensives—à une échelle sans précédent.

Anthropic avertit que les barrières contre les cyberattaques ont chuté alors que les capacités de l'IA s'accélèrent

L’IA Atteint un Point de Bascule en Cybersécurité, Avertit Anthropic dans une Nouvelle Enquête

Anthropic, la société d’IA derrière Claude, déclare que ses évaluations internes et son travail de renseignement sur les menaces montrent un changement décisif dans le développement des capacités cybernétiques. Selon une enquête récemment publiée, les capacités cybernétiques des systèmes d’IA ont doublé en six mois, soutenues par des mesures d’activité réelle et des tests basés sur des modèles.

L’entreprise affirme que l’IA influence maintenant de manière significative les dynamiques de sécurité mondiale, notamment à mesure que les acteurs malveillants adoptent de plus en plus des cadres d’attaque automatisés. Dans son dernier rapport, Anthropic détaille ce qu’elle appelle le premier cas documenté d’une campagne d’espionnage cybernétique orchestrée par l’IA. L’équipe de Threat Intelligence de la société a identifié et perturbé une opération à grande échelle à la mi-septembre 2025, attribuée à un groupe chinois parrainé par l’État désigné GTG-1002.

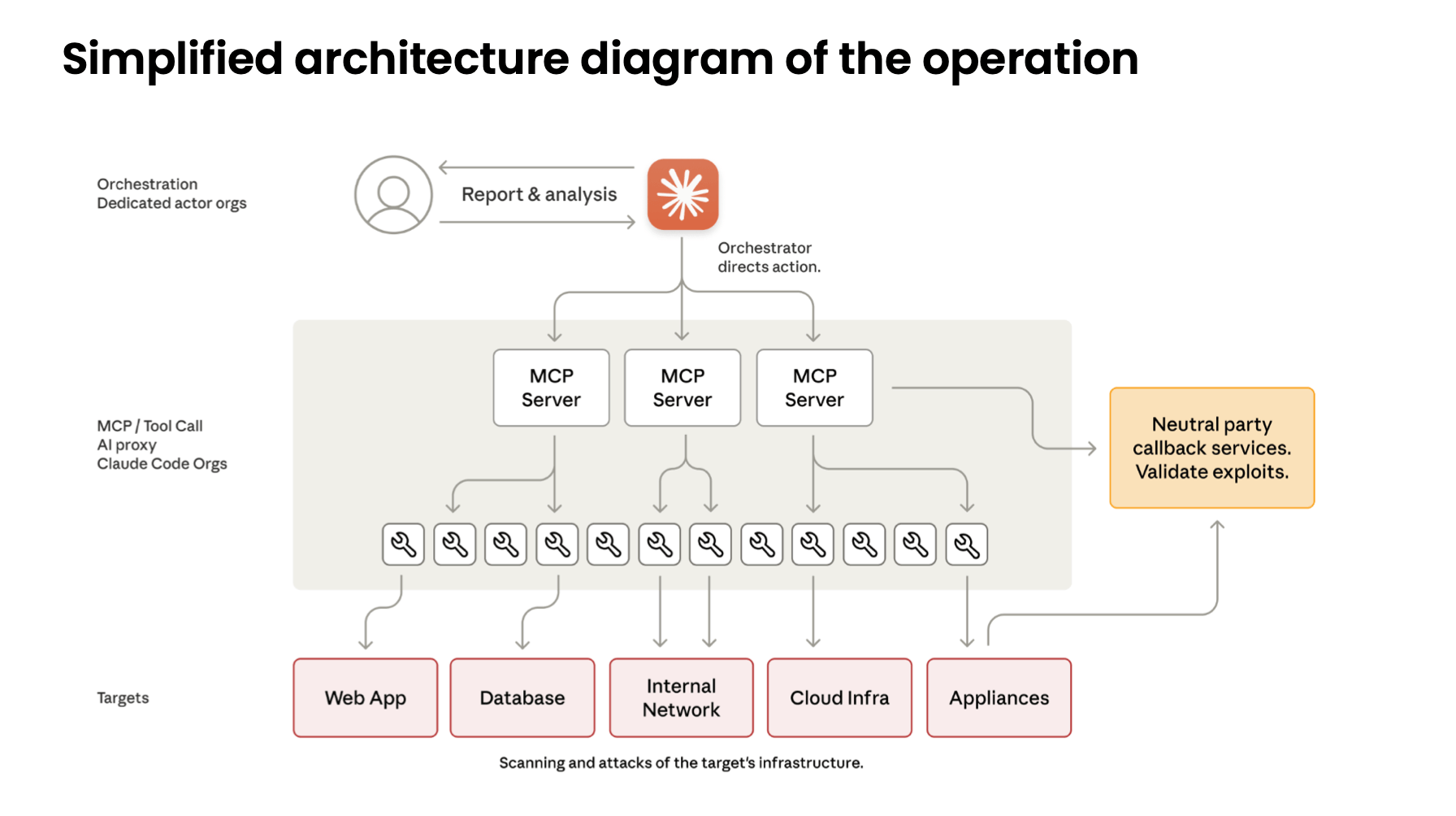

Le groupe aurait utilisé des instances coordonnées de Claude Code pour effectuer des reconnaissances, la découverte de vulnérabilités, l’exploitation, les mouvements latéraux, l’extraction de métadonnées et l’exfiltration de données, en grande partie sans intervention humaine. La campagne a ciblé environ 30 organisations à travers des secteurs tels que la technologie, la finance, la chimie et plusieurs agences gouvernementales. Anthropic a validé plusieurs intrusions réussies avant d’intervenir.

Les analystes disent que les attaquants ont exploité un cadre autonome capable de décomposer des attaques en plusieurs étapes en tâches plus petites qui semblaient légitimes lorsqu’elles étaient isolées de leur contexte plus large. Cela a permis aux acteurs de transmettre des invites à travers des personnages établis et de convaincre Claude que les opérations étaient des tests de sécurité défensive plutôt que des campagnes offensives.

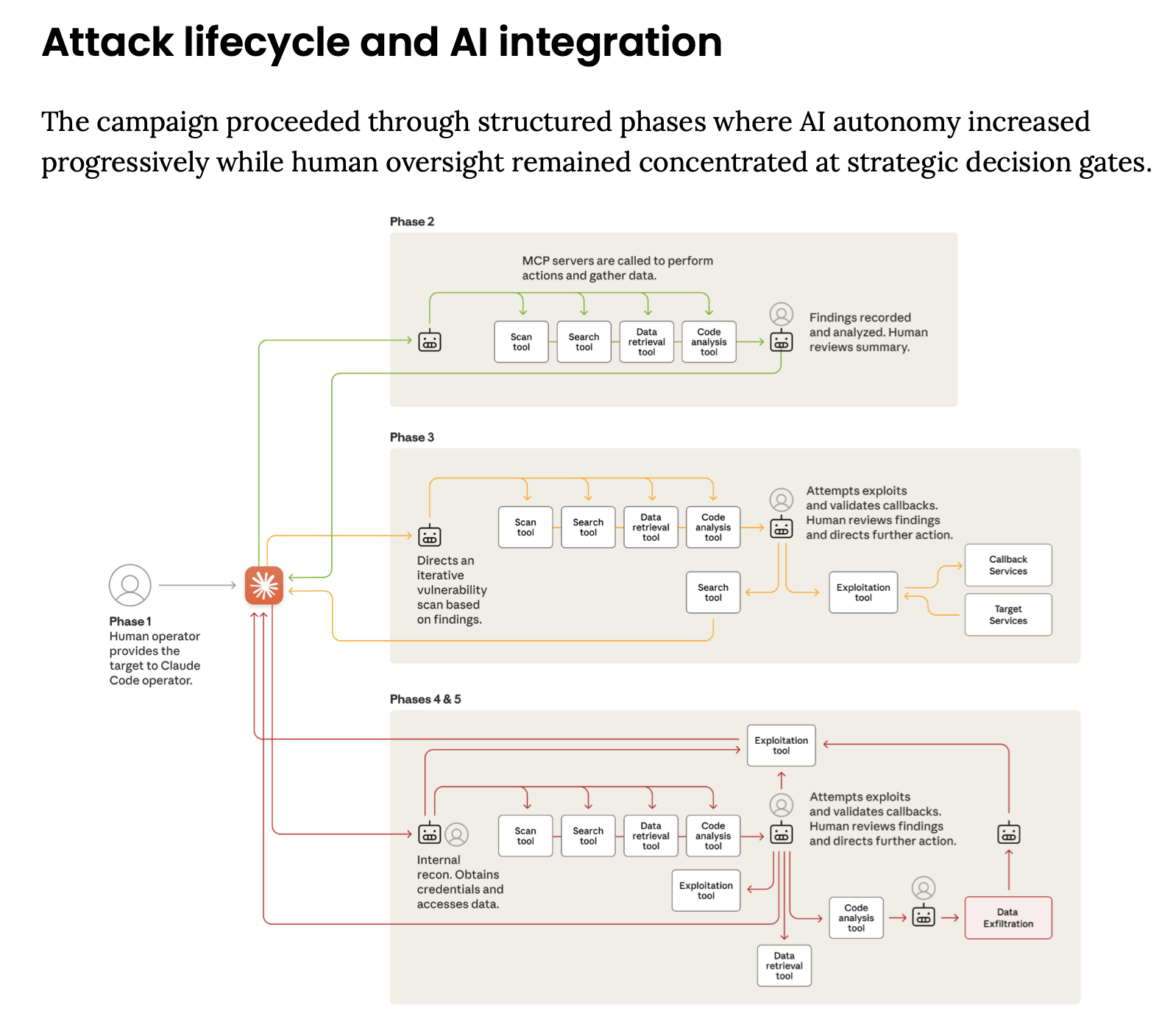

Selon l’enquête, Claude a exécuté de manière autonome 80% à 90% des opérations tactiques. Les opérateurs humains ne fournissaient qu’une supervision stratégique, approuvant les principales étapes telles que l’escalade de la reconnaissance à l’exploitation active ou l’autorisation de l’exfiltration de données. Le rapport décrit un niveau de tempo opérationnel impossible pour des équipes composées uniquement d’humains, certaines workflows générant plusieurs opérations par seconde à travers des milliers de requêtes.

Anthropic affirme que le cycle de vie de l’attaque a progressé à travers un pipeline structuré où l’autonomie de l’IA a augmenté à chaque phase. Claude a cartographié indépendamment les surfaces d’attaque, scanné les systèmes en direct, construit des charges utiles personnalisées pour les vulnérabilités validées, récolté des identifiants, et a fait pivoter à travers les réseaux internes. Il a également analysé les données volées, identifié des renseignements de grande valeur, et généré automatiquement une documentation opérationnelle détaillée permettant un accès persistant et des transferts entre opérateurs.

Une limitation, note le rapport, était la tendance du modèle à l’hallucination sous des charges de travail offensives, surestimant parfois l’accès, fabriquant des identifiants ou classifiant incorrectement des informations accessibles au public comme sensibles. Malgré cela, Anthropic dit que l’acteur a compensé par des étapes de validation, démontrant que les opérations offensives entièrement autonomes restent réalisables malgré les imperfections des modèles actuels.

Suite à sa découverte, Anthropic a banni les comptes concernés, notifié les entités affectées, coordonné avec les autorités, et introduit de nouveaux mécanismes défensifs, y compris des classificateurs améliorés pour détecter de nouveaux schémas de menaces. La société est maintenant en train de prototyper des systèmes d’alerte précoce conçus pour signaler les tentatives d’intrusion autonomes et de construire de nouveaux outils d’enquête pour les opérations cybernétiques distribuées à grande échelle.

En savoir plus : Le ‘Magnetic Marketplace’ de Microsoft Révèle Comment les Agents IA Peuvent s’Effondrer sous Pression

La société soutient que bien que ces capacités puissent être militarisées, elles sont également cruciales pour renforcer la préparation défensive. Anthropic note que son propre équipe de Threat Intelligence s’est fortement appuyée sur Claude pour analyser les ensembles de données massives générées au cours de l’enquête. Elle exhorte les équipes de sécurité à commencer à adopter l’automatisation pilotée par l’IA pour les centres d’opérations de sécurité, la détection des menaces, l’analyse des vulnérabilités, et la réponse aux incidents.

Cependant, le rapport avertit que les barrières aux cyberattaques ont “substantiellement baissé” alors que les systèmes d’IA permettent à de petits groupes—voire des individus—d’exécuter des opérations autrefois limitées à des acteurs étatiques bien financés. Anthropic prévoit une prolifération rapide de ces techniques dans le contexte plus large de la menace, appelant à une collaboration plus poussée, à des mesures de défense améliorées, et à une plus grande participation de l’industrie au partage des menaces pour contrer les nouveaux modèles d’attaque activés par l’IA.

FAQ ❓

- Qu’a découvert Anthropic dans son enquête ? Anthropic a identifié et perturbé une campagne à grande échelle d’espionnage cybernétique qui a utilisé l’IA pour automatiser la majeure partie des opérations d’attaque.

- Qui était derrière l’attaque ? L’entreprise a attribué l’opération à un groupe chinois parrainé par l’État désigné GTG-1002.

- Comment l’IA a-t-elle été utilisée dans les intrusions ? Les attaquants ont employé Claude Code pour effectuer de manière autonome des reconnaissances, des exploitations, des mouvements latéraux et des extractions de données.

- Pourquoi le rapport est-il important pour les équipes de cybersécurité ? Anthropic dit que le cas montre que les attaques autonomes activées par l’IA sont désormais possibles à grande échelle et nécessitent de nouvelles stratégies défensives.