Puolustusministeri Pete Hegseth tapasi tiistaina Pentagonissa Anthropicin toimitusjohtajan Dario Amodein, kun puolustusministeriö painosti Anthropicia poistamaan rajoituksia Claude-tekoälyjärjestelmästään (AI) tai kohtaamaan mahdollisia seuraamuksia.

Raportti: Anthropicin Claude-tekoäly kohtaa epävarman tulevaisuuden Pentagonin luokitelluissa järjestelmissä

Sotilaallisen tekoälyhallinnan rajapinta testissä korkean panoksen Pentagon-tapaamisessa

24. helmikuuta pidetty tapaaminen seurasi viikkojen jännitteitä Anthropicin Clauden käyttöpolitiikoista. Claude on suuri kielimalli, joka on integroitu puolustusministeriön salaisiin verkkoihin vuoden 2025 pilottisopimuksella, jonka arvo voi olla jopa 200 miljoonaa dollaria. Claude on tällä hetkellä ainoa täysin hyväksytty suuri kielimalli, joka toimii tietyissä Pentagonin suojatuissa järjestelmissä.

Axiosin raportoinnin mukaan Hegseth, mukanaan apulaispuolustusministeri Steve Feinberg ja oikeudellinen neuvonantaja Earl Matthews, vastusti Anthropicin rajoituksia amerikkalaisten massavalvonnalle sekä täysin autonomisille asejärjestelmille, jotka toimivat ilman ihmisen valvontaa. Puolustusviranomaiset väittivät, että nämä rajat rajoittavat laillisia sotilaallisia sovelluksia eikä niiden tulisi syrjäyttää kongressin ja toimeenpanovallan toimivaltaa.

Anthropic on pitänyt kiinni siitä, että sen suojaukset on suunniteltu estämään väärinkäyttöä ja samalla mahdollistamaan kansallisen turvallisuuden sovellukset. Yhtiön mukaan sen käytännöt eivät estä oikeutettua sotilaallista käyttöä, mutta kieltävät toimia, kuten yksilöiden seuraamisen ilman suostumusta tai tappavien järjestelmien käyttöönoton ilman ihmisen valvontaa.

”Neuvotteluja tuntevan lähteen mukaan Anthropic ei ole koskaan vastustanut mallien käyttöä ’legitiimeissä sotilasoperaatioissa’”, Fox Newsin kansallisen turvallisuuden pääkirjeenvaihtaja Jennifer Griffin kertoi X:ssä. ”Se myös kertoi Hegsethille, ettei se koskaan valittanut Pentagonille tai Palantirille mallien käytöstä Maduro-iskussa.”

Claudea on käytetty tiedusteluanalyysiin, kyberpuolustukseen ja operatiiviseen suunnitteluun. Raporttien mukaan se tuki suunnittelua ja reaaliaikaista analyysiä 3. tammikuuta toteutetussa operaatiossa, joka johti Venezuelan presidentti Nicolás Maduron pidätykseen. Anthropic haki myöhemmin selvennystä mallin osallisuudesta osana sisäistä vaatimustenmukaisuustarkastelua, minkä Pentagonin viranomaiset tulkitsivat arvosteluksi.

9. tammikuuta Hegseth antoi muistion, jossa hän kehotti tekoälyn (AI) tarjoajia poistamaan hänen kuvailemansa rajoittavat ehdot. Tämä ohje loi pohjan uudelleenneuvotteluille ja lopulta 24. helmikuuta pidetylle tapaamiselle.

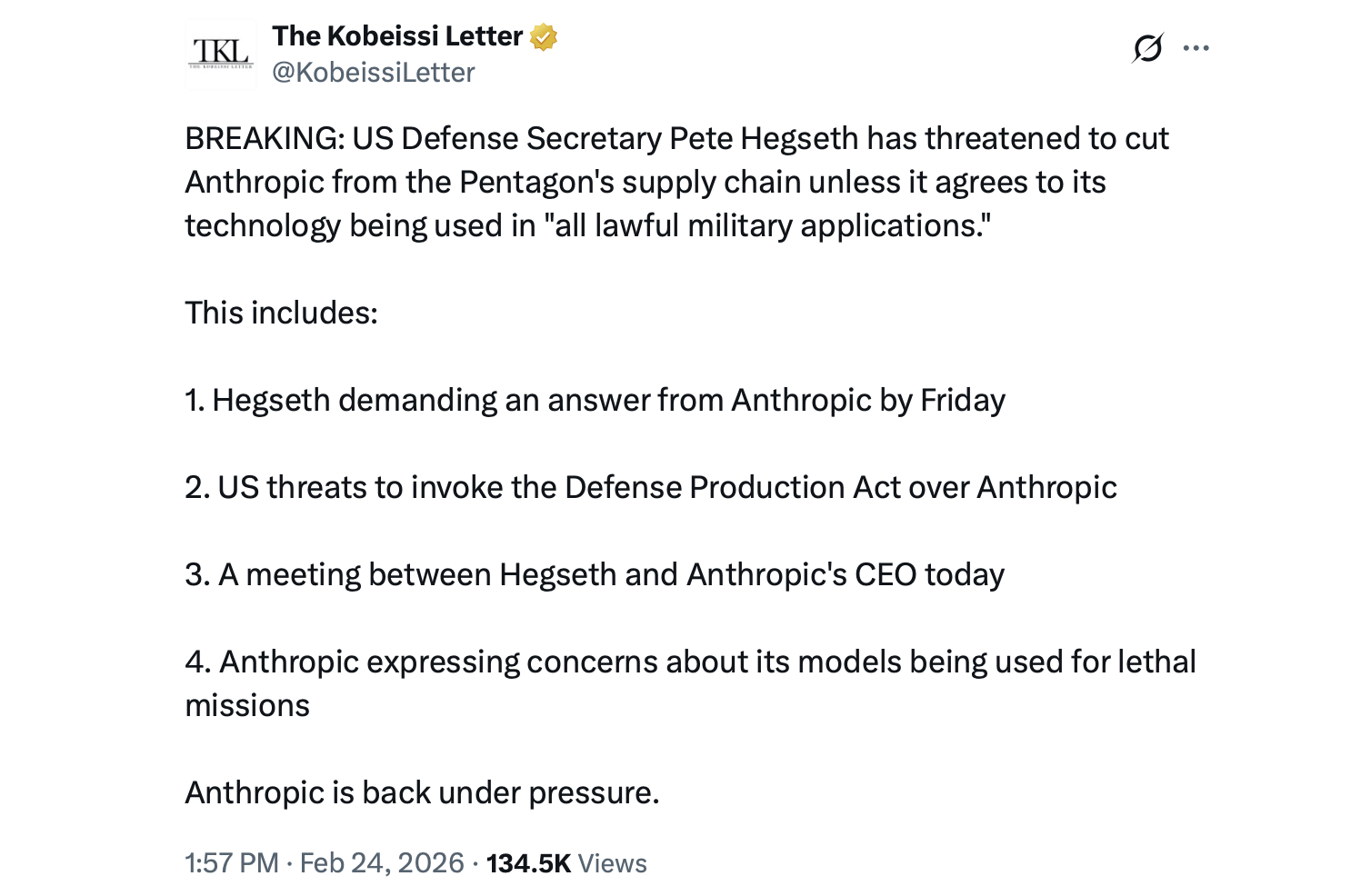

Pentagon on asettanut Anthropicin määräajaksi 27. helmikuuta ehtojensa muuttamiselle. Mahdollisia vastatoimia ovat muun muassa Defense Production Act -lain käyttöönotto vaatimustenmukaisuuden pakottamiseksi tai Anthropicin nimeäminen toimitusketjuriskiksi, mikä voisi edellyttää urakoitsijoilta luopumista Claudeen liittyvistä järjestelmistä.

Viranomaiset myöntävät, että Clauden irrottaminen olemassa olevasta infrastruktuurista olisi operatiivisesti monimutkaista. Silti ministeriöllä on vaihtoehtoja. Kilpailijat kuten xAI Grok-mallillaan, OpenAI ChatGPT:llä ja Google Geminiä tarjoavana ovat samankaltaisten puolustusministeriösopimusten piirissä ja saattavat olla asemissa laajentaakseen rooliaan, jos neuvottelut kariutuvat.

Kiista nostaa esiin laajempia kysymyksiä tekoälyn hallinnasta sotilaskäytössä, erityisesti kun liittovaltion lainsäädäntö jatkaa kehittymistään nousevien teknologioiden ympärillä. Panoksena on se, voivatko yksityiset tekoälykehittäjät ylläpitää riippumattomia eettisiä linjauksia silloin, kun heidän järjestelmistään tulee osa kansallisen turvallisuuden operaatioita.

Reaktiot sosiaalisen median alustoilla ovat olleet poikkeuksellisen suorasukaisia. ”Pidätysmääräyksetön valvonta on palannut”, eräs X-käyttäjä kirjoitti vastauksena Griffinin X-julkaisuun. ”Tämän pitäisi olla paljon suurempi uutinen kuin se on. Perustuslain rikkomuksiin on vakava mahdollisuus”, toinen vastasi Griffinin kirjoitukseen. Muut, ripauksella synkkää huumoria, vitsailivat, ettei Skynetin saapuminen ehkä ole kaukana. ”Skynet on täällä… vuoden 2029 aikajana on KÄYNNISSÄ”, henkilö totesi.

Molemmat osapuolet ovat luonnehtineet 24. helmikuuta käytyä keskustelua asialliseksi ja perusteelliseksi. Se, muuttaako Anthropic suojauksiaan ennen määräaikaa, voi määrittää yhden Pentagonin edistyneimmän tekoälyintegraation tulevaisuuden.

FAQ 🤖

- Mitä 24. helmikuuta pidetyssä Pentagon-tapaamisessa käsiteltiin?

Tapaamisessa keskityttiin Anthropicin Claude-tekoälyyn kohdistuviin rajoituksiin ja siihen, rajoittavatko ne laillisia sotilaallisia sovelluksia. - Miksi Pentagon painostaa Anthropicia?

Puolustusviranomaiset väittävät, että yhtiön suojaukset häiritsevät valtuutettuja kansallisen turvallisuuden käyttötarkoituksia. - Mitä voi tapahtua, jos Anthropic ei noudata vaatimuksia?

Pentagon voi ottaa käyttöön Defense Production Act -lain tai nimetä yhtiön toimitusketjuriskiksi. - Onko Claudelle vaihtoehtoja?

Kyllä, xAI:n, OpenAI:n ja Googlen mallit ovat puolustusministeriön sopimusten piirissä ja voivat tarvittaessa laajentua.