آنتروپیک گام فوقالعادهای برداشته و پس از آنکه پنتاگون شرکت هوش مصنوعی (AI) را «ریسک زنجیره تأمین برای امنیت ملی» نامید، از دولت آمریکا شکایت کرده است؛ اقدامی که یک رویارویی حقوقی را شعلهور کرده و میتواند شیوه کنترل واشینگتن بر فروشندگان هوش مصنوعیِ همکار با ارتش را دگرگون کند.

آنتروپیکِ داریو آمودی از دولت آمریکا شکایت کرد و گفت پنتاگون در واکنش به چارچوبهای حفاظتی ایمنی هوش مصنوعی تلافی کرده است

آنتروپیک در شکایتی تاریخی در حوزه هوش مصنوعی به سراغ وزارت دفاع میرود

طبق چندین گزارش، آنتروپیک در ۹ مارس دو دادخواست در دادگاه فدرال ثبت کرد و اقدامات وزارت دفاع آمریکا و دولت ترامپ را به چالش کشید؛ با این استدلال که دولت پس از آنکه این شرکت حاضر نشد حفاظهای ایمنی را از سامانه هوش مصنوعی کلود (Claude) حذف کند، بهطور غیرقانونی علیه آن تلافیجویی کرده است. این شکایتها یک برچسبگذاری را هدف میگیرد که معمولاً برای دشمنان خارجیِ مظنون به جاسوسی یا خرابکاری به کار میرود، نه شرکتهای فناوری داخلی.

این اختلاف به مذاکرات قراردادی میان آنتروپیک و پنتاگون درباره اینکه مدل هوش مصنوعی کلودِ شرکت چگونه میتواند توسط نهادهای دفاعی آمریکا استفاده شود بازمیگردد. آنتروپیک پیشتر از ابتکارهای امنیت ملی حمایت کرده بود و در ژوئن ۲۰۲۴ به نخستین شرکت هوش مصنوعی پیشرو تبدیل شد که مدلهایی را روی شبکههای طبقهبندیشده دولت آمریکا مستقر کرد؛ اقدامی که به تحلیلگران و برنامهریزان نظامی در بازبینی اطلاعات، شبیهسازیها، برنامهریزی عملیاتی و کارهای امنیت سایبری کمک میکرد.

تنشها زمانی بالا گرفت که وزارت دفاع، بهعنوان بخشی از تمدید قرارداد، خواستار دسترسی نامحدود به کلود برای «همه مقاصد قانونی» شد. آنتروپیک با بیشتر شرایط موافقت کرد اما بر دو محدودیت پافشاری کرد: ممنوعیت استفاده از هوش مصنوعیاش برای نظارت گسترده داخلی بر آمریکاییها و جلوگیری از بهکارگیری آن در سامانههای تسلیحاتی مرگبارِ کاملاً خودمختار.

مدیران شرکت استدلال کردند این گاردریلها ضروریاند، زیرا مدلهای کنونیِ هوش مصنوعی پیشرو هنوز برای سلاحهای خودمختار بیش از حد غیرقابلاعتماد هستند و همچنین برنامههای نظارتیِ گسترده میتواند با حمایتهای قانون اساسی در تعارض باشد. آنتروپیک اعلام کرد این محدودیتها در جریان همکاری قبلیاش با دولت، هرگز در هیچ مأموریت نظامی اختلال ایجاد نکردهاند.

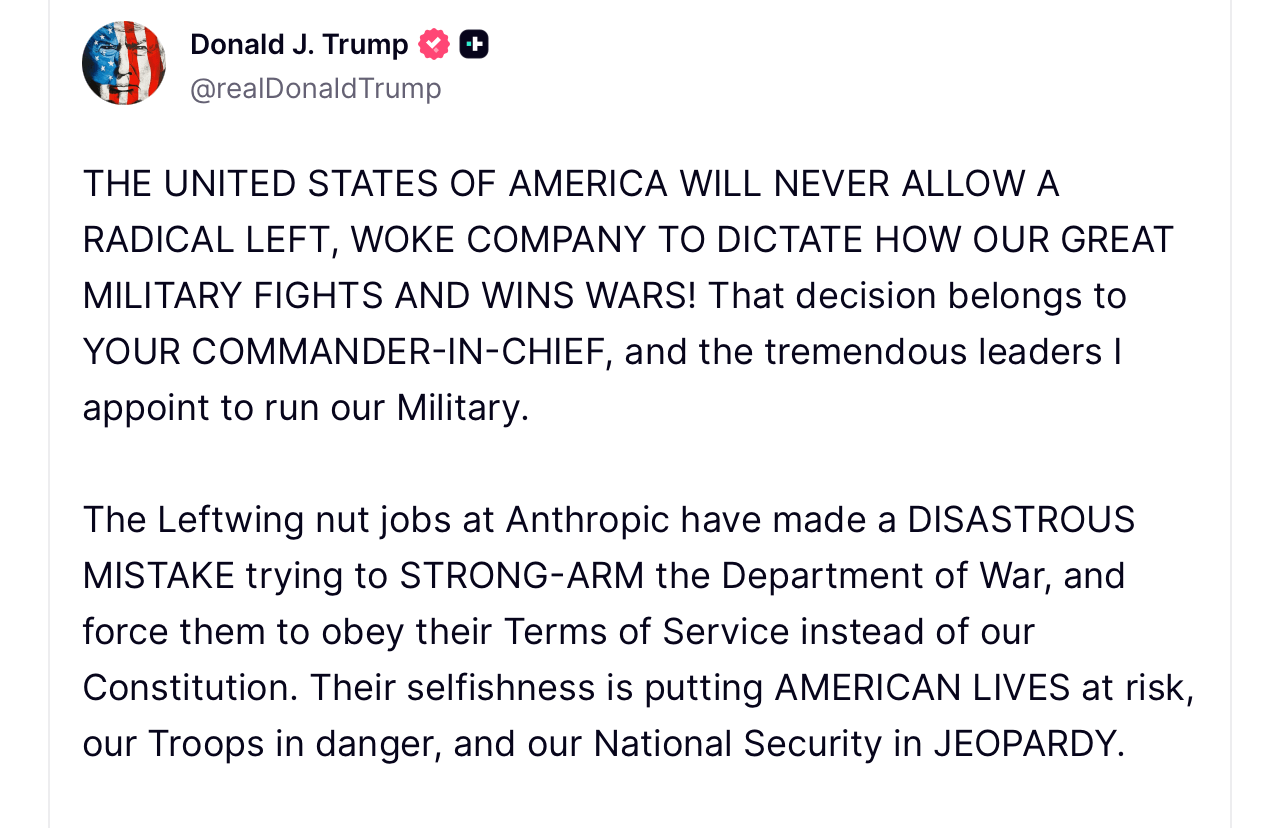

مذاکرات پس از جلسه ۲۴ فوریه میان مدیرعامل آنتروپیک، داریو آمودِی (Dario Amodei)، و وزیر دفاع پیت هگسِت به بنبست رسید. چند روز بعد، در ۲۷ فوریه، رئیسجمهور دونالد ترامپ در تروث سوشال پستی منتشر کرد و به نهادهای فدرال دستور داد «فوراً» استفاده از فناوری آنتروپیک را متوقف کنند و ادامه اتکا به این شرکت را «اشتباهی فاجعهبار» توصیف کرد.

اندکی بعد، هگست اقدام کرد تا آنتروپیک را تحت اختیار تدارکات فدرالِ مندرج در 10 U.S.C. § 3252 بهعنوان ریسک زنجیره تأمین طبقهبندی کند. این برچسبگذاری که در نامهای ارسالشده برای شرکت در حوالی ۴ مارس تأیید شد، برخی پیمانکاران دولتی را از استفاده از فناوریهایی که آسیبپذیر در برابر خرابکاری یا نفوذ خارجی تلقی میشوند محدود میکند.

آنتروپیک استدلال میکند این اقدام، قانون را بسیار فراتر از هدف مورد نظرش کش میدهد. در لوایح ارائهشده به دادگاه، شرکت میگوید این برچسبگذاری برای تهدیدهای امنیتیِ دارای پیوند خارجی در نظر گرفته شده بود، نه برای اختلافنظرهای سیاستی با تأمینکنندگان داخلی. در شکایتها آمده است دولت از «کممحدودکنندهترین ابزار» مورد الزام قانون استفاده نکرده و در عوض چیزی را اعمال کرده که شرکت آن را یک فهرست سیاهِ غیررسمی توصیف میکند.

لوایح حقوقی همچنین نگرانیهای قانون اساسی را مطرح میکنند. آنتروپیک میگوید این برچسبگذاری با مجازات کردن شرکت بهخاطر دفاع علنی از محدودیتهایی بر کاربردهای هوش مصنوعی مانند سلاحهای خودمختار و نظارت داخلی، متمم اول قانون اساسی را نقض میکند. طبق دادخواست، نامیدن این شرکت بهعنوان ریسک امنیت ملی به اعتبار آن آسیب میزند و میتواند صدها میلیون دلار قرارداد را به خطر بیندازد.

آنتروپیک از دادگاهها میخواهد اجرای این برچسبگذاری را متوقف کنند، به نهادهای فدرال دستور دهند بخشنامههای توقف کسبوکار با این شرکت را پس بگیرند، و از اقدامات مشابه در آینده جلوگیری کنند. شرکت گفته هدفش این نیست که دولت را مجبور به خرید فناوریاش کند، بلکه جلوگیری از تلافیجویی بر سر تفاوتهای سیاستی است.

«درخواست بازبینی قضایی تغییری در تعهد دیرینه ما برای بهکارگیری هوش مصنوعی در راستای حفاظت از امنیت ملیمان ایجاد نمیکند»، یک سخنگوی آنتروپیک در بیانیهای گفت. «اما این گامی ضروری برای حفاظت از کسبوکار ما، مشتریانمان و شرکایمان است.»

مقامهای پنتاگون با استناد به سیاست مربوط به پروندههای جاری در دادگاه، بهصورت عمومی درباره این دعوی حقوقی اظهار نظر نکردهاند. برخی رهبران دفاعی پیشتر استدلال کرده بودند که نهادهای نظامی باید در شرایط اضطراری اختیار عملیاتی کامل بر فناوریهای پیمانکاران را حفظ کنند و نمیتوانند اجازه دهند فروشندگان تعیین کنند سامانهها چگونه استفاده شوند.

آخر هفتهٔ پرهیاهوی هوش مصنوعی: تکانِ بزرگِ OpenAI، تقابل با پنتاگون، و رباتهایی که از کار افتادن را نمیپذیرند

تحولات هوش مصنوعی با سرعت رخ میدهند: حاشیههای OpenAI، درگیری پنتاگون با Anthropic، عرضه GPT-5.4، رباتهای خودترمیمگر و ابزارهای امنیتی جدید. read more.

اکنون بخوانید

آخر هفتهٔ پرهیاهوی هوش مصنوعی: تکانِ بزرگِ OpenAI، تقابل با پنتاگون، و رباتهایی که از کار افتادن را نمیپذیرند

تحولات هوش مصنوعی با سرعت رخ میدهند: حاشیههای OpenAI، درگیری پنتاگون با Anthropic، عرضه GPT-5.4، رباتهای خودترمیمگر و ابزارهای امنیتی جدید. read more.

اکنون بخوانید

آخر هفتهٔ پرهیاهوی هوش مصنوعی: تکانِ بزرگِ OpenAI، تقابل با پنتاگون، و رباتهایی که از کار افتادن را نمیپذیرند

اکنون بخوانیدتحولات هوش مصنوعی با سرعت رخ میدهند: حاشیههای OpenAI، درگیری پنتاگون با Anthropic، عرضه GPT-5.4، رباتهای خودترمیمگر و ابزارهای امنیتی جدید. read more.

این اختلاف در زمانی رخ میدهد که رقابت برای تضمین قراردادهای نظامیِ هوش مصنوعی شدت میگیرد. شرکتهای رقیب، از جمله OpenAI، تقریباً همزمان با شکست مذاکرات آنتروپیک به توافقهایی با پنتاگون دست یافتند. در همین حال، شرکای بزرگ فناوری مانند گوگل و مایکروسافت اعلام کردهاند قصد دارند همکاری با آنتروپیک را در خدمات تجاریِ نامرتبط با دفاع ادامه دهند.

تحلیلگران صنعت میگویند نتیجه این پرونده میتواند سابقهای ایجاد کند درباره اینکه دولت فدرال چگونه شرکتهای هوش مصنوعی را تحت فشار میگذارد تا وقتی پای منافع امنیت ملی در میان است، سیاستهای ایمنی خود را تغییر دهند. فعلاً محصولات مصرفی آنتروپیک و خدمات تجاری هوش مصنوعی آن همچنان در دسترس است، در حالی که نبرد حقوقی بر سر برچسبگذاری پنتاگون مسیر خود را در دادگاهها آغاز میکند.

FAQ 🧭

- چرا آنتروپیک از دولت آمریکا شکایت کرد؟

آنتروپیک دادخواستهایی ثبت کرد و مدعی شد پنتاگون پس از آنکه شرکت حاضر نشد محدودیتهای ایمنی هوش مصنوعی را حذف کند، بهطور غیرقانونی آن را بهعنوان ریسک زنجیره تأمینِ امنیت ملی برچسبگذاری کرده است. - چه چیزی اختلاف میان آنتروپیک و پنتاگون را آغاز کرد؟

این درگیری در جریان مذاکرات قرارداد آغاز شد، زمانی که وزارت دفاع خواستار استفاده نامحدود از سامانه هوش مصنوعی کلودِ آنتروپیک شد. - برچسب «ریسک زنجیره تأمین» به چه معناست؟

این برچسب میتواند استفاده پیمانکاران دولتی از فناوری یک شرکت را محدود کند اگر مقامها باور داشته باشند که این فناوری ریسکهای امنیتی یا تدارکاتی ایجاد میکند. - آیا خدمات هوش مصنوعی آنتروپیک در طول این دادخواست همچنان فعال خواهند بود؟

بله، محصولات تجاری هوش مصنوعی آنتروپیک و خدمات مصرفی آن در حالی که پرونده حقوقی پیش میرود همچنان در دسترس هستند.